Declaration officielle

Ce qu'il faut comprendre

Pourquoi les fondateurs de Google pensaient-ils leur moteur immunisé contre le spam ?

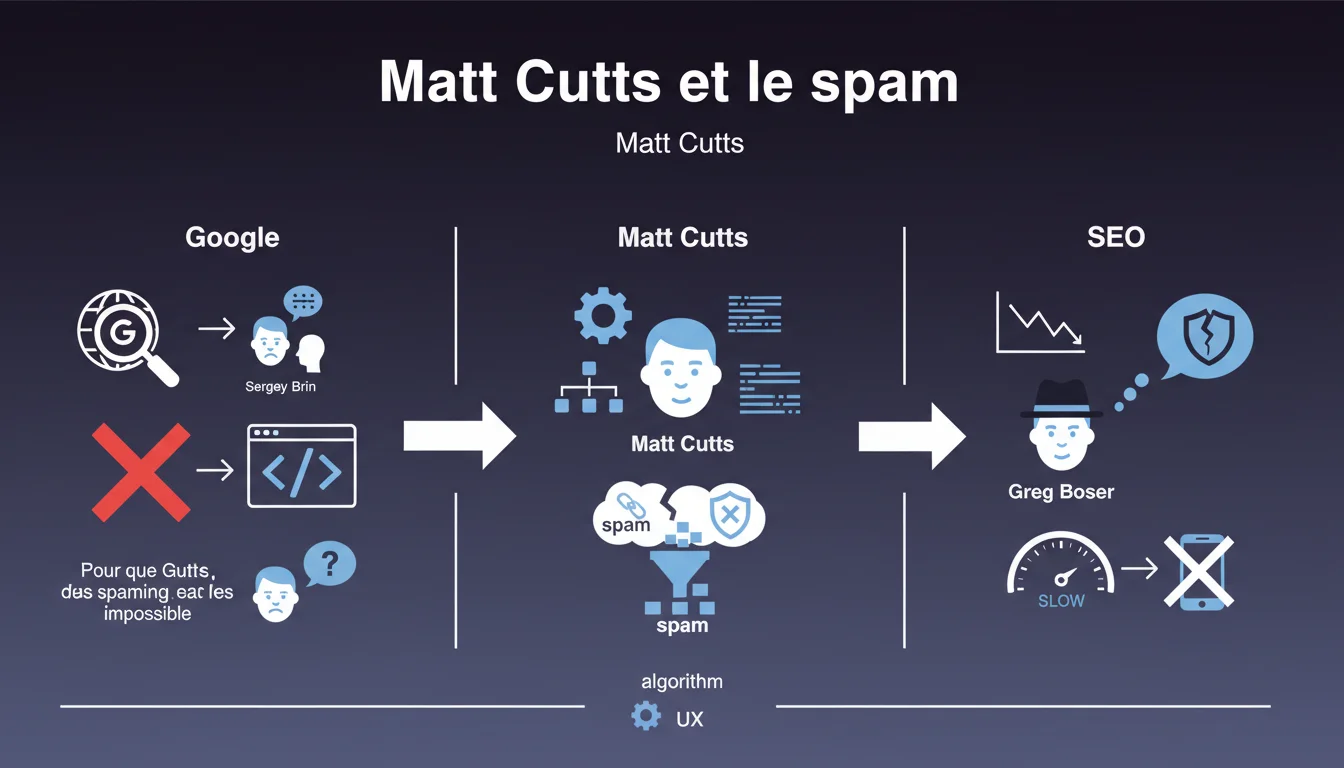

Aux débuts de Google, Sergey Brin et Larry Page étaient convaincus que leur algorithme était si sophistiqué qu'il ne pouvait pas être manipulé. Cette confiance reposait sur l'innovation du PageRank, qui évaluait la qualité des pages selon les liens entrants plutôt que simplement les mots-clés.

Matt Cutts, embauché comme responsable de l'équipe antispam, a dû prouver le contraire. Il a démontré concrètement que des techniques de manipulation pouvaient tromper l'algorithme, forçant Google à développer des systèmes de détection et de pénalisation qui sont aujourd'hui au cœur du référencement.

Qu'est-ce que cette anecdote révèle sur l'évolution du SEO ?

Cette histoire illustre un tournant majeur : le passage d'un moteur de recherche naïf à un écosystème complexe de surveillance. Les premières années de Google ont vu l'émergence du black hat SEO, avec des techniques comme le keyword stuffing, les fermes de liens ou le cloaking.

L'obstination initiale des fondateurs explique pourquoi Google a développé par la suite une approche quasi-militaire contre le spam. Chaque mise à jour majeure (Panda, Penguin, etc.) est une réponse directe à ces premières manipulations que l'équipe dirigeante n'avait pas anticipées.

- Leçon historique : Aucun algorithme n'est invulnérable aux manipulations

- Évolution nécessaire : Google a dû investir massivement dans l'antispam

- Réalité actuelle : La lutte contre le spam représente une part majeure des ressources de Google

- Impact durable : Cette expérience a façonné la politique de transparence limitée de Google sur son algorithme

Comment cette confession influence-t-elle notre compréhension actuelle de Google ?

Reconnaître cette vulnérabilité initiale nous aide à comprendre la paranoïa actuelle de Google concernant les manipulations. Le moteur de recherche maintient désormais une opacité volontaire sur ses critères de classement précisément pour éviter l'exploitation systématique.

Cette histoire contextualise également le rôle central de Matt Cutts dans l'histoire du SEO. Pendant des années, il a été l'interface entre Google et les référenceurs, établissant les bases des bonnes pratiques que nous suivons encore aujourd'hui.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. Avec 15 ans d'expérience en SEO, je peux confirmer que cette anecdote explique parfaitement la dynamique actuelle entre Google et les référenceurs. Le moteur reste en état d'alerte permanent contre toute tentative de manipulation.

L'arrogance initiale de Sergey Brin a laissé place à une méfiance systématique. Chaque nouvelle technique SEO, même white hat, est scrutée pour détecter d'éventuels abus. Cette vigilance explique pourquoi Google pénalise parfois des sites légitimes par sur-précaution.

La victoire de Matt Cutts dans ce débat a façonné la philosophie punitive de Google. Plutôt que de simplement ignorer les manipulations, l'algorithme applique des pénalités sévères qui peuvent détruire le trafic d'un site en quelques heures.

Quelles nuances faut-il apporter à cette vision historique ?

Il faut reconnaître que les techniques de spam d'époque étaient beaucoup plus grossières qu'aujourd'hui. Le keyword stuffing, les pages satellites ou les réseaux de liens évidents sont désormais facilement détectables. Le spam moderne est bien plus sophistiqué.

Par ailleurs, l'algorithme actuel intègre des centaines de critères et du machine learning qui le rendent effectivement plus difficile à manipuler durablement. La confiance originelle de Brin n'était pas totalement infondée, juste prématurée de 20 ans.

Quelle leçon les praticiens SEO doivent-ils tirer de cette anecdote ?

La principale leçon est que l'équilibre entre optimisation et manipulation reste au cœur du métier. Google n'a jamais fait confiance aux SEO depuis cette prise de conscience, ce qui explique les directives strictes et les mises à jour algorithmiques fréquentes.

Comprendre cette méfiance historique aide à anticiper les réactions de Google face aux nouvelles pratiques. Chaque innovation SEO sera examinée sous l'angle du potentiel d'abus, même si elle apporte une valeur réelle aux utilisateurs.

Impact pratique et recommandations

Que faut-il faire concrètement suite à cette révélation ?

Adoptez une approche defensive dans votre stratégie SEO. Puisque Google part du principe que toute optimisation peut être du spam, assurez-vous que chaque action soit justifiable par l'expérience utilisateur.

Documentez vos pratiques SEO et maintenez une transparence totale. En cas de pénalité, vous devez pouvoir démontrer que vos optimisations visaient l'amélioration du site, pas la manipulation de l'algorithme.

Diversifiez vos sources de trafic pour ne pas dépendre uniquement de Google. Cette résilience stratégique vous protège contre les changements algorithmiques imprévisibles nés de cette paranoïa historique.

Quelles erreurs éviter absolument dans ce contexte ?

Ne tentez jamais de techniques grey hat ou black hat, même si elles semblent fonctionner à court terme. L'histoire montre que Google investit massivement pour détecter et pénaliser ces pratiques, avec un temps de retard qui se réduit constamment.

Évitez les sur-optimisations qui peuvent déclencher des alertes algorithmiques. Un ancrage de liens trop parfait, une densité de mots-clés trop élevée ou des schémas de liens artificiels sont des signaux rouge vif pour les systèmes antispam.

Ne suivez pas aveuglément les conseils SEO trouvés en ligne sans vérifier leur légitimité. Beaucoup de pratiques présentées comme efficaces sont en réalité des techniques risquées héritées de l'ère pré-Cutts.

- Auditez régulièrement votre profil de liens pour identifier les backlinks toxiques

- Privilégiez toujours le contenu de qualité orienté utilisateur plutôt que moteur

- Utilisez la Search Console pour surveiller les alertes et actions manuelles

- Maintenez un rythme de publication naturel sans pic suspect d'activité

- Variez vos ancres de liens de manière organique et contextuelle

- Investissez dans l'expérience utilisateur (vitesse, mobile, Core Web Vitals)

- Créez des liens naturels par le mérite du contenu, pas par l'achat ou l'échange

- Restez informé des mises à jour algorithmiques et adaptez votre stratégie

Comment construire une stratégie SEO durable face à cette réalité ?

Concentrez-vous sur la création d'un écosystème de contenu solide qui attire naturellement les liens et les visites. Cette approche long terme résiste mieux aux évolutions algorithmiques que les tactiques d'optimisation agressive.

Investissez dans les signaux de qualité mesurables : autorité thématique, engagement des utilisateurs, fraîcheur du contenu, et expertise démontrée (E-E-A-T). Ces critères sont difficilement manipulables et alignés avec les objectifs de Google.

💬 Commentaires (0)

Soyez le premier à commenter.