Declaration officielle

Autres déclarations de cette vidéo 15 ▾

- □ Les attributs ARIA améliorent-ils vraiment le SEO de votre site ?

- □ Faut-il vraiment rediriger les URL canonicalisées pour améliorer son référencement ?

- □ Google ignore-t-il vraiment les fragments d'URL (#) pour le référencement ?

- □ Pourquoi l'optimisation technique seule ne fait-elle plus ranker un site ?

- □ Comment vérifier si votre site est sous pénalité manuelle dans Search Console ?

- □ Pourquoi le balisage Product ne sert à rien pour l'immobilier ?

- □ Hreflang fonctionne-t-il vraiment pour du contenu non traduit mais ciblant des pays différents ?

- □ Le contraste des couleurs impacte-t-il vraiment le référencement naturel ?

- □ La balise HTML <article> améliore-t-elle vraiment le référencement ?

- □ Liens relatifs vs absolus : y a-t-il vraiment un impact SEO ?

- □ Faut-il vraiment imposer l'anglais dans les données structurées pour les jours de la semaine ?

- □ Comment vérifier qu'un crawler est réellement Googlebot et bloquer les imposteurs ?

- □ Faut-il vraiment utiliser prefetch et prerender pour améliorer son SEO ?

- □ Faut-il vraiment oublier le cache Google pour diagnostiquer l'indexation ?

- □ Pourquoi Google indexe-t-il du contenu qui n'existe pas sur votre site ?

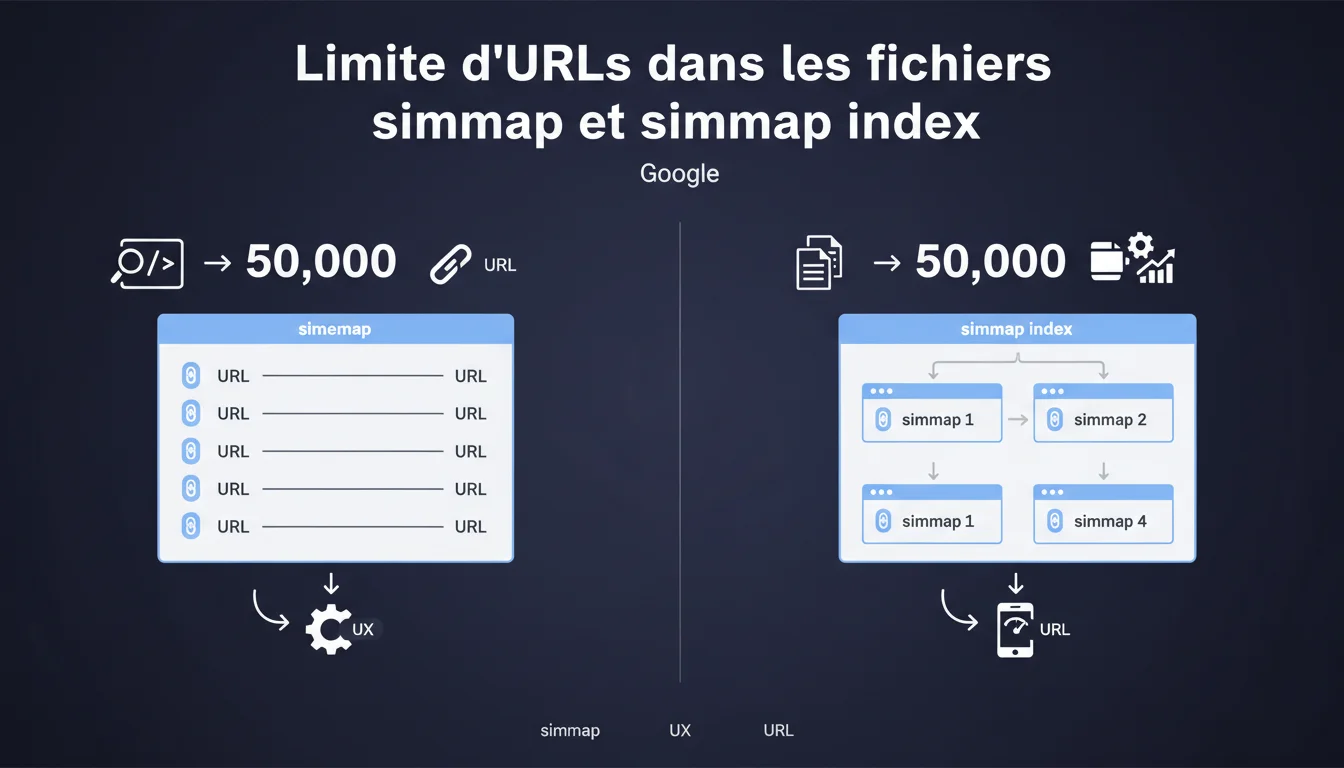

Google impose une limite stricte de 50 000 URLs par fichier sitemap XML. Cette même contrainte s'applique aux fichiers sitemap index, qui ne peuvent référencer que 50 000 autres sitemaps. Pour les gros sites, cette règle oblige à structurer intelligemment l'arborescence de sitemaps.

Ce qu'il faut comprendre

Cette limite de 50 000 URLs est-elle vraiment contraignante ?

Oui, surtout pour les sites e-commerce ou médias qui génèrent des milliers de pages. Un site avec 500 000 produits devra découper ses sitemaps en au moins 10 fichiers distincts, puis les référencer via un sitemap index.

Le problème se corse quand on dépasse les millions d'URLs. Avec 2 millions de pages, vous aurez besoin de 40 sitemaps individuels — et si vous utilisez un sitemap index pour les organiser, celui-ci ne pourra pointer que vers maximum 50 000 autres fichiers sitemap. Concrètement, ça laisse une marge énorme, mais la structure devient un casse-tête organisationnel.

Pourquoi Google impose-t-il cette limite technique ?

Question de performance serveur et de parsing. Un fichier XML de plusieurs centaines de milliers d'URLs pèserait lourd, ralentirait le crawl, et pourrait poser des problèmes de timeout côté Googlebot. En fragmentant, Google s'assure que chaque requête reste gérable.

Cette limite existe depuis les premières versions du protocole sitemap. Elle n'a jamais été relevée, même si la puissance serveur a explosé. Google préfère maintenir une architecture stable plutôt que d'adapter constamment ses specs.

La limite s'applique-t-elle aussi à la taille en Mo ?

Oui. Au-delà du nombre d'URLs, Google impose aussi une limite de 50 Mo non compressé (10 Mo compressé en gzip). Si votre sitemap dépasse l'une de ces deux contraintes — URLs ou poids —, il faut le scinder.

En pratique, vous atteindrez presque toujours la limite d'URLs avant celle du poids, sauf si vos balises <lastmod>, <priority> et <changefreq> alourdissent chaque entrée. Mais ces balises sont largement ignorées par Google, donc autant les virer.

- Maximum 50 000 URLs par sitemap XML

- Maximum 50 000 sitemaps référencés dans un sitemap index

- Limite de poids : 50 Mo non compressé, 10 Mo compressé

- Obligation de fragmenter pour les gros sites

- Aucune exception officielle documentée

Avis d'un expert SEO

Cette règle est-elle respectée par tous les CMS et générateurs de sitemaps ?

Non, et c'est là que ça coince. Certains plugins WordPress ou PrestaShop génèrent des sitemaps monolithiques qui dépassent allègrement les 50 000 URLs. Google les crawle quand même, mais tronque au-delà de la limite — ce qui signifie que des URLs ne seront jamais découvertes via le sitemap.

J'ai vu des sites avec 80 000 produits et un seul sitemap. Résultat : 30 000 URLs ignorées, sans alerte dans Search Console. [A vérifier] : Google ne remonte pas systématiquement d'erreur explicite quand un sitemap dépasse la limite — il traite simplement les premières 50 000 entrées et s'arrête.

La limite des sitemap index est-elle vraiment problématique ?

Soyons honnêtes : très rarement. Avoir 50 000 fichiers sitemap distincts, c'est gérer plusieurs millions d'URLs. À ce stade, le vrai enjeu n'est plus la limite technique, mais la gouvernance : comment maintenir cette arborescence sans se perdre ?

Par contre, la règle oblige à réfléchir la structure dès le départ. Un site qui génère un nouveau sitemap par jour (stratégie courante pour les médias) devra anticiper le volume sur plusieurs années. Après 137 ans, vous dépasserez la limite — bon, OK, personne ne s'en soucie.

Google communique-t-il des stats sur les sitemaps rejetés pour dépassement ?

Non, et c'est frustrant. Search Console affiche des erreurs génériques type "sitemap illisible" ou "trop volumineux", mais ne précise jamais si c'est lié au nombre d'URLs ou au poids. Impossible de savoir combien de sites sont impactés.

[A verifier] : On observe terrain que Google crawle parfois au-delà de 50 000 URLs si le sitemap est bien formé et que le serveur répond vite. Mais compter là-dessus, c'est jouer à la roulette — officiellement, la limite tient.

Impact pratique et recommandations

Que faut-il faire concrètement pour rester conforme ?

Fragmentez vos sitemaps avant d'atteindre la limite. Si vous avez 30 000 URLs aujourd'hui, prévoyez déjà la structure pour 100 000. Créez des sitemaps thématiques (produits, catégories, articles) ou temporels (par mois, par année).

Utilisez un sitemap index pour orchestrer le tout. Déclarez-le dans le robots.txt et dans Search Console. Testez la structure avec un validateur XML pour vérifier qu'aucun fichier ne dépasse les seuils.

Quelles erreurs éviter absolument ?

Ne jamais générer un sitemap unique pour un gros site. Ne jamais imbriquer plusieurs niveaux de sitemap index. Ne jamais oublier de compresser en gzip — ça réduit la bande passante et améliore les temps de réponse.

Évitez aussi de bourrer vos sitemaps d'URLs inutiles : pages dupliquées, canonicalisées ailleurs, bloquées par robots.txt, ou avec noindex. Chaque URL compte dans la limite des 50 000, autant n'inclure que celles qui méritent d'être crawlées.

Comment vérifier que mon site respecte ces règles ?

Inspectez vos sitemaps avec un outil comme Screaming Frog ou un simple grep sur le XML. Comptez le nombre de balises <url> ou <sitemap>. Vérifiez le poids des fichiers avant et après compression.

Dans Search Console, surveillez les erreurs de type "sitemap trop volumineux" ou "URL manquante". Si vous constatez que certaines pages n'apparaissent jamais dans l'index malgré leur présence dans le sitemap, c'est souvent le signe d'un dépassement silencieux.

- Scinder les sitemaps au-delà de 40 000 URLs pour garder une marge

- Créer un sitemap index pour orchestrer les fichiers multiples

- Compresser systématiquement en gzip

- Déclarer le sitemap index dans robots.txt et Search Console

- Exclure les URLs canonicalisées, noindexées ou bloquées

- Automatiser la génération pour éviter les oublis lors des mises à jour

- Monitorer les erreurs dans Search Console chaque semaine

❓ Questions frequentes

Que se passe-t-il si mon sitemap dépasse 50 000 URLs ?

Puis-je imbriquer plusieurs niveaux de sitemap index ?

La limite de 50 Mo concerne-t-elle le fichier compressé ou non ?

Faut-il inclure les balises lastmod, priority et changefreq ?

Comment structurer mes sitemaps pour un site de plusieurs millions de pages ?

🎥 De la même vidéo 15

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 09/08/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.