Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Comment Google analyse-t-il vraiment votre contenu lors de l'indexation ?

- □ Google corrige-t-il vraiment vos erreurs HTML pour l'indexation ?

- □ Comment Google choisit-il quelle version d'une page en double indexer ?

- □ Comment Google choisit-il quelle page indexer parmi vos contenus dupliqués ?

- □ Comment Google regroupe-t-il vraiment les pages au contenu similaire ?

- □ Pourquoi Google accorde-t-il plus de poids à certains signaux SEO qu'à d'autres ?

- □ Comment Google choisit-il LA page canonique dans un cluster de doublons ?

- □ Google sert-il vraiment des versions alternatives de vos pages selon le contexte de recherche ?

- □ Comment Google décide-t-il vraiment si votre page mérite l'index ?

- □ Qu'est-ce que Google stocke vraiment dans son index pour une page canonique ?

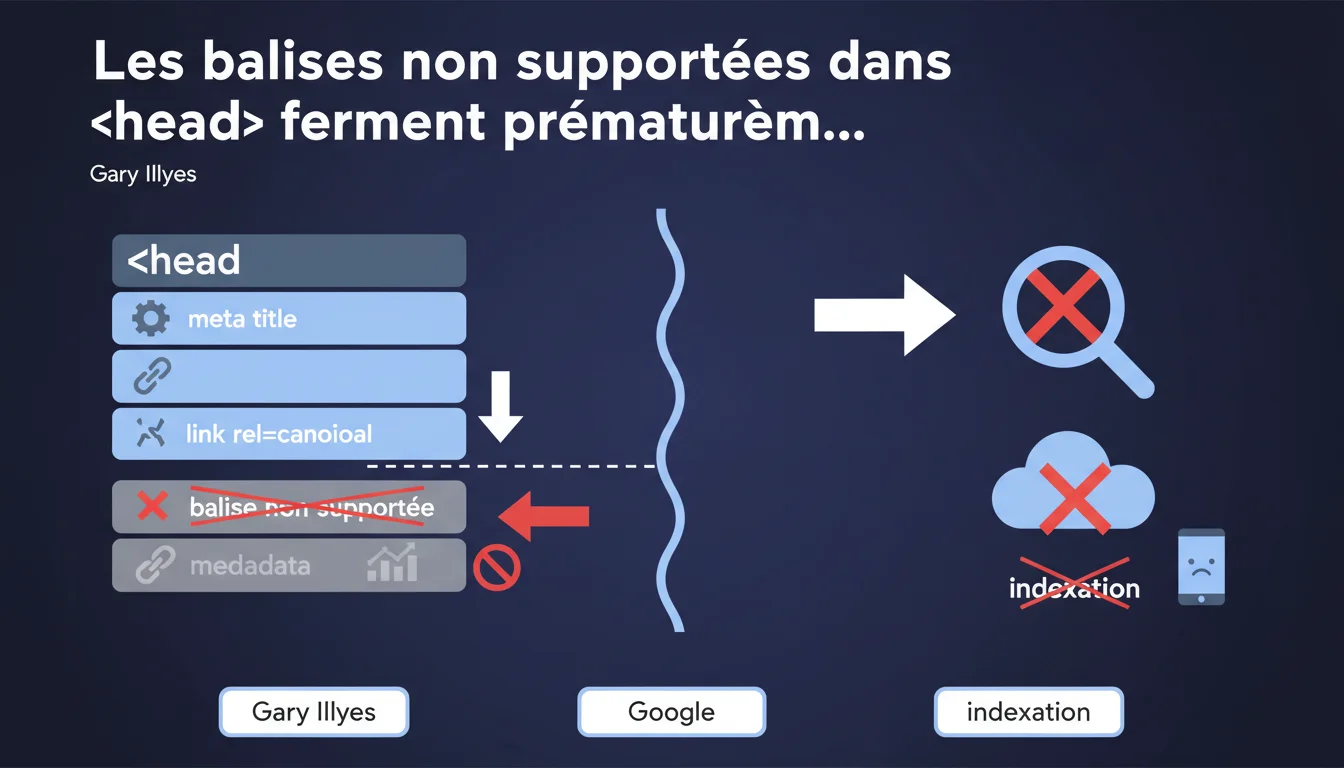

Google ferme automatiquement l'élément <head> dès qu'il rencontre une balise non supportée. Toutes les métadonnées positionnées après cette balise (meta, link, JSON-LD) deviennent invisibles pour l'indexation. C'est un piège silencieux qui peut neutraliser vos efforts SEO sans générer d'alerte visible dans Search Console.

Ce qu'il faut comprendre

Pourquoi une simple balise invalide peut-elle saborder votre indexation ?

Le mécanisme de parsing HTML de Google suit des règles strictes. Quand le crawler détecte une balise non autorisée dans le

— typiquement un élément de contenu comme unConcrètement ? Tout ce qui suit cette balise intrusive bascule dans le

. Vos balises canonical, vos hreflang, votre JSON-LD structuré — tout devient inutile pour l'indexation si ça se retrouve après l'erreur.Quelles balises sont réellement considérées comme non supportées ?

La spécification HTML définit une liste restrictive d'éléments autorisés dans

: title, meta, link, style, script, base, noscript. Tout le reste provoque la fermeture prématurée.Les coupables fréquents ? Des div cachés insérés par des outils tiers, des balises de tracking mal positionnées, des commentaires HTML contenant du code mal échappé. Parfois, c'est un simple espace ou caractère invisible qui suffit à tout dérailler.

Les navigateurs modernes réagissent-ils de la même façon ?

Oui, et c'est justement le problème — ou la cohérence, selon le point de vue. Chrome, Firefox, Safari appliquent tous la même logique de correction d'erreur définie par le standard HTML. Googlebot ne fait qu'imiter ce comportement.

Ça signifie qu'un audit visuel via DevTools peut révéler le problème : si votre balise canonical apparaît dans le DOM hors du , c'est qu'elle a été éjectée.

- Google ferme automatiquement le dès qu'une balise non supportée apparaît

- Les métadonnées suivantes (canonical, hreflang, JSON-LD) deviennent invisibles pour l'indexation

- Le comportement est identique sur tous les navigateurs modernes

- Aucune erreur explicite n'est générée dans Search Console

- Le problème est souvent causé par des scripts tiers ou des outils de tracking mal intégrés

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument, et c'est un angle mort classique en audit SEO. J'ai vu des sites perdre 30% de leur trafic organique parce qu'un script de consentement cookies injectait un

Le piège ? Ça ne génère aucune erreur visible. Search Console ne signale rien. L'URL s'indexe normalement — mais avec les mauvaises métadonnées ou sans signaux critiques. [A vérifier] : Google ne précise pas si le contenu du JSON-LD déplacé dans le

est quand même partiellement interprété.Quelles nuances faut-il apporter à cette règle ?

Premier point — la position exacte de l'élément intrus compte. Si votre canonical est en ligne 5 et qu'un

Deuxième nuance : certains CMS ou frameworks injectent du code dynamiquement. Un thème WordPress peut sembler propre en mode édition, mais générer du HTML invalide côté serveur. Il faut tester le rendu final, pas le template.

Dans quels cas cette règle pose-t-elle des problèmes inattendus ?

Les sites avec gestion de consentement (RGPD) sont ultra-exposés. Beaucoup d'outils injectent leurs scripts de façon agressive, sans respecter la structure HTML. Si le script de Cookiebot ou Didomi insère une modal avant la déclaration de charset, vous avez un problème.

Autre cas vicieux : les commentaires conditionnels pour Internet Explorer. Techniquement obsolètes, mais encore présents dans certains templates legacy. S'ils contiennent du HTML mal formaté, ils peuvent déclencher la fermeture prématurée du

.Impact pratique et recommandations

Comment vérifier si votre site est affecté par ce problème ?

Première étape : inspectez le DOM rendu dans Chrome DevTools. Ouvrez une page stratégique, faites Ctrl+Shift+C, et vérifiez que toutes vos balises meta, link et JSON-LD sont bien enfants directs de . Si certaines apparaissent dans

, vous êtes touché.Deuxième vérification : utilisez Screaming Frog ou un crawler équivalent pour extraire le code source brut. Comparez avec le rendu JavaScript activé. Si des différences apparaissent dans la structure du

, c'est qu'un script modifie le DOM de façon problématique.Quelles erreurs éviter lors de l'intégration de balises dans ?

Ne jamais insérer d'éléments de contenu (div, span, p, img) dans le

, même cachés en CSS. C'est invalide par définition. Si vous devez charger un pixel de tracking, utilisez une balise ou positionnez-le en début de .Méfiez-vous des injections asynchrones. Un tag manager mal configuré peut insérer du code à un moment imprévisible du parsing. Forcez le placement des scripts critiques SEO (JSON-LD, canonical) en dur dans le template, pas via JavaScript.

Que faut-il faire concrètement pour corriger la situation ?

Auditez la séquence de chargement complète. Désactivez temporairement les scripts tiers un par un pour identifier le coupable. Une fois repéré, soit vous le déplacez, soit vous le remplacez par une solution compatible.

Pour les sites complexes avec multiples environnements (dev, staging, prod), mettez en place un test automatisé qui vérifie la validité du

après chaque déploiement. Un simple script Puppeteer peut détecter les régressions avant qu'elles n'impactent l'indexation.- Inspectez le DOM rendu dans Chrome DevTools pour vérifier la position réelle des métadonnées

- Crawlez votre site avec Screaming Frog en mode JavaScript activé

- Identifiez les scripts tiers qui injectent du code dans le

- Déplacez les balises critiques (canonical, hreflang, JSON-LD) en début de

- Validez le HTML avec le validateur W3C pour détecter les éléments non supportés

- Mettez en place des tests automatisés post-déploiement

- Documentez l'ordre d'insertion des scripts dans vos guidelines techniques

❓ Questions frequentes

Est-ce que Google signale ce problème dans Search Console ?

Les balises JSON-LD déplacées dans le <body> sont-elles quand même interprétées ?

Un simple commentaire HTML peut-il provoquer ce problème ?

Comment tester ce problème avant un déploiement en production ?

Les scripts de consentement cookies sont-ils souvent responsables ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 04/04/2024

🎥 Voir la vidéo complète sur YouTube →Declarations similaires

Recevez une analyse complète en temps réel des dernières déclarations de Google

Soyez alerté à chaque nouvelle déclaration officielle Google SEO — avec l'analyse complète incluse.

💬 Commentaires (0)

Soyez le premier à commenter.