Declaration officielle

Autres déclarations de cette vidéo 2 ▾

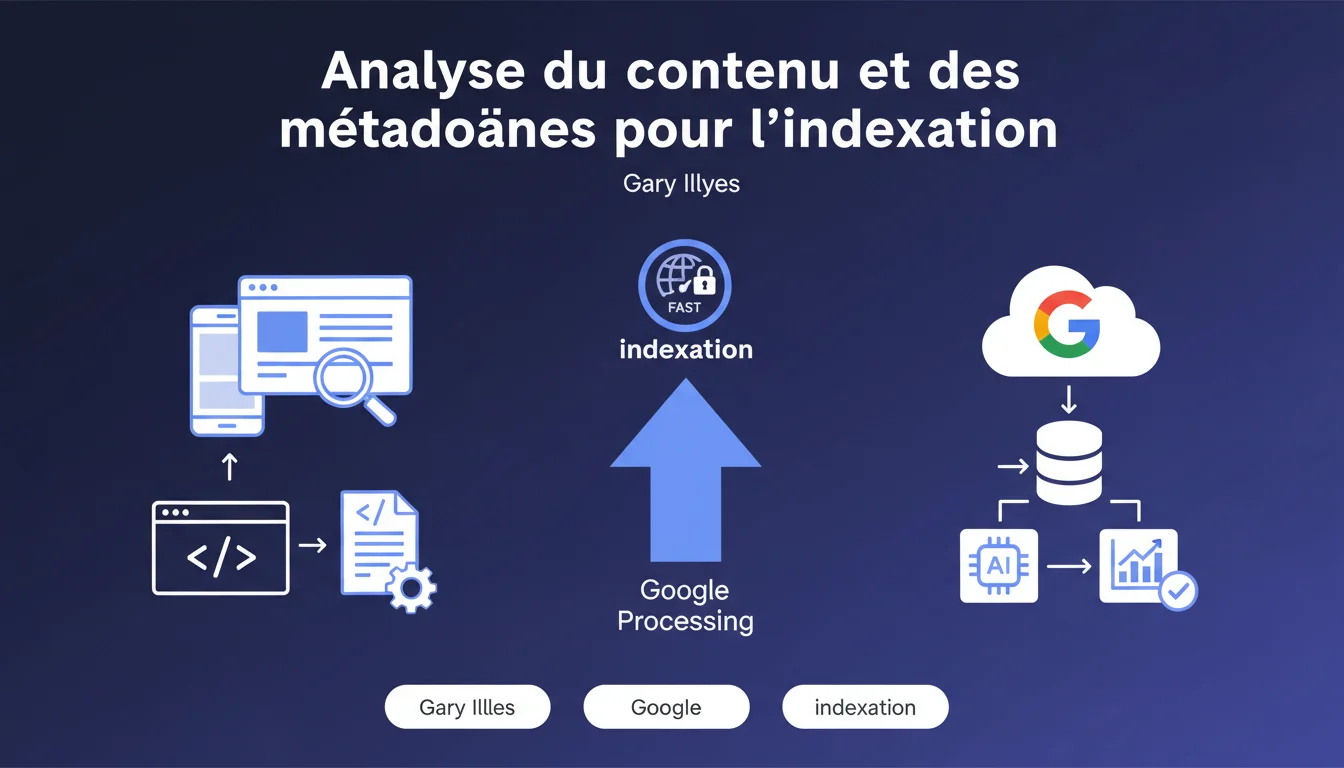

Google traite et analyse obligatoirement le contenu ET les métadonnées d'une page web avant toute décision d'indexation. Pas d'analyse = pas d'indexation possible. Cette étape de traitement préalable conditionne donc la visibilité de toutes vos pages dans les résultats de recherche.

Ce qu'il faut comprendre

Pourquoi cette étape d'analyse est-elle un prérequis absolu ?

Google ne peut pas indexer ce qu'il ne comprend pas. L'analyse du contenu et des métadonnées constitue la phase préliminaire qui permet au moteur de déterminer de quoi parle votre page, quelle est sa qualité, et si elle mérite d'être ajoutée à l'index.

Cette déclaration de Gary Illyes rappelle un principe fondamental : l'indexation n'est jamais automatique. Elle résulte d'une décision algorithmique qui s'appuie sur cette phase d'analyse. Sans traitement préalable, votre page reste invisible dans les SERP — peu importe sa qualité.

Que signifie concrètement « traiter et analyser » ?

Le traitement englobe plusieurs opérations techniques : parsing du HTML, extraction du texte visible, analyse sémantique du contenu, détection de la langue, évaluation des signaux de qualité. Google décortique littéralement votre page pour en extraire du sens.

L'analyse des métadonnées couvre les balises title, meta description, structured data, canonical, hreflang, robots... Tous ces éléments sont passés au crible avant indexation. Ils influencent directement la décision d'indexer ou non.

Quelle est la différence entre crawl, traitement et indexation ?

Le crawl, c'est la découverte — Googlebot accède à votre URL. Le traitement/analyse, c'est la compréhension — Google extrait et interprète votre contenu. L'indexation, c'est la décision finale — votre page rejoint (ou non) l'index consultable.

Ces trois phases sont séquentielles et chacune peut être un point de blocage. Une page crawlée n'est pas forcément traitée ; une page traitée n'est pas forcément indexée.

- Le crawl seul ne garantit rien — il faut que Google puisse analyser votre contenu

- Les métadonnées comptent autant que le contenu dans cette phase d'analyse

- L'indexation est conditionnelle — elle dépend du résultat de cette analyse préalable

- Une page bloquée au niveau du traitement (JavaScript mal géré, contenu inaccessible) ne sera jamais indexée

- Google ne se contente pas de « lire » votre page — il l'évalue et la juge avant de l'indexer

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, et c'est même un rappel bienvenu. On observe régulièrement des sites avec des pages crawlées mais jamais indexées — souvent parce que le contenu n'est pas accessible ou compréhensible pour Googlebot. JavaScript mal implémenté, contenu chargé dynamiquement sans rendu côté serveur, ressources bloquées par le robots.txt : autant de cas où le crawl a lieu mais l'analyse échoue.

La précision « contenu ET métadonnées » est importante. Google ne se fie pas qu'au texte visible — il croise plusieurs signaux pour décider. Un title cohérent avec le H1, des données structurées valides, un canonical bien posé : tout ça facilite l'analyse et améliore vos chances d'indexation.

Quelles nuances faut-il apporter à cette affirmation ?

Gary Illyes reste très général — comme souvent. Il ne précise pas quels critères déterminent si une page passe ou non cette étape d'analyse. Est-ce une question de qualité du contenu ? De duplicate content ? De crawl budget ? [A vérifier] — Google ne donne jamais les seuils exacts.

Autre point : cette déclaration ne dit rien sur le timing. Combien de temps entre le crawl et l'analyse complète ? Entre l'analyse et la décision d'indexation ? Sur des sites massifs ou avec un crawl budget limité, ce délai peut être significatif — et certaines pages peuvent rester en « queue d'attente » indéfiniment.

Dans quels cas cette règle ne s'applique-t-elle pas vraiment ?

Soyons honnêtes : il existe des cas limites. Les pages de très faible qualité, le spam manifeste, les contenus dupliqués à l'identique — Google peut décider de ne pas indexer sans analyse approfondie. Le filtre peut intervenir très tôt dans le pipeline, avant même un traitement complet.

Les pages soumises via la Search Console (inspection d'URL) bénéficient parfois d'un traitement prioritaire — mais même là, aucune garantie d'indexation. Google peut analyser et refuser quand même.

Impact pratique et recommandations

Que faut-il faire concrètement pour faciliter cette analyse ?

Rendez votre contenu accessible sans friction. Google doit pouvoir parser votre HTML facilement, accéder au texte visible, charger les ressources critiques. Si votre site repose massivement sur JavaScript, assurez-vous que le rendu côté serveur ou la pré-génération statique fonctionne — testez avec l'outil de test des résultats enrichis ou la Search Console.

Optimisez vos métadonnées comme si elles étaient lues par un humain pressé. Title unique et descriptif, meta description pertinente, balises canonical claires, structured data valides. Cohérence entre le contenu et les métadonnées — Google déteste les signaux contradictoires.

Quelles erreurs éviter absolument ?

Ne bloquez jamais les ressources nécessaires au rendu dans le robots.txt — CSS, JavaScript critique, images essentielles à la compréhension. Google a besoin de voir votre page comme un utilisateur la voit pour l'analyser correctement.

Évitez les contenus inaccessibles sans interaction utilisateur : accordéons fermés par défaut contenant le texte principal, tabs cachés, lazy loading mal implémenté sur du contenu stratégique. Si Google doit « cliquer » pour voir votre contenu, il ne le fera probablement pas.

- Vérifier que Googlebot peut accéder au HTML complet (outil d'inspection d'URL Search Console)

- Tester le rendu JavaScript avec l'outil de test des résultats enrichis

- Auditer les métadonnées : title, description, canonical, hreflang, robots sur chaque type de page

- Valider les données structurées avec le validateur Schema.org

- Contrôler que le robots.txt ne bloque pas de ressources critiques

- Identifier les pages crawlées mais non indexées dans la Search Console et analyser pourquoi

- Mesurer le temps entre crawl et indexation pour détecter des problèmes de traitement

- Éliminer les contenus dupliqués ou de très faible qualité qui ralentissent l'analyse globale du site

Comment vérifier que vos pages sont correctement traitées et analysées ?

La Search Console reste votre meilleur allié. Surveillez les rapports de couverture et le statut des pages (crawlées mais non indexées, découvertes mais non crawlées...). Ces statuts révèlent souvent des problèmes dans la phase d'analyse.

Utilisez l'outil d'inspection d'URL pour voir exactement ce que Google récupère — HTML brut, HTML rendu, ressources chargées. Comparez avec ce que vous voyez dans votre navigateur. Tout décalage est un red flag.

❓ Questions frequentes

Une page crawlée est-elle forcément indexée ?

Quelles métadonnées Google analyse-t-il avant l'indexation ?

Comment savoir si Google a correctement analysé ma page ?

Pourquoi certaines pages restent crawlées mais jamais indexées ?

Le JavaScript bloque-t-il cette phase d'analyse ?

🎥 De la même vidéo 2

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 04/04/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.