Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Le Web Rendering Service de Google suit-il vraiment toutes les dernières fonctionnalités de Chrome ?

- □ Pourquoi Google peine-t-il à indexer correctement les sites qui utilisent des Web Workers ?

- □ Pourquoi les SEO et développeurs doivent-ils absolument travailler ensemble ?

- □ Les core updates de Google sont-elles vraiment des rappels à l'ordre sur les guidelines ?

- □ Les core updates sont-elles vraiment neutres ou cachent-elles des pénalités déguisées ?

- □ Core update : pourquoi Google refuse-t-il de donner des détails spécifiques ?

- □ Les core updates de Google sont-elles vraiment conçues pour améliorer l'expérience utilisateur ou pour redistribuer les positions ?

- □ Pourquoi Google refuse-t-il de révéler ce que contiennent vraiment les core updates ?

- □ Les core updates de Google affectent-ils vraiment tous les sites ?

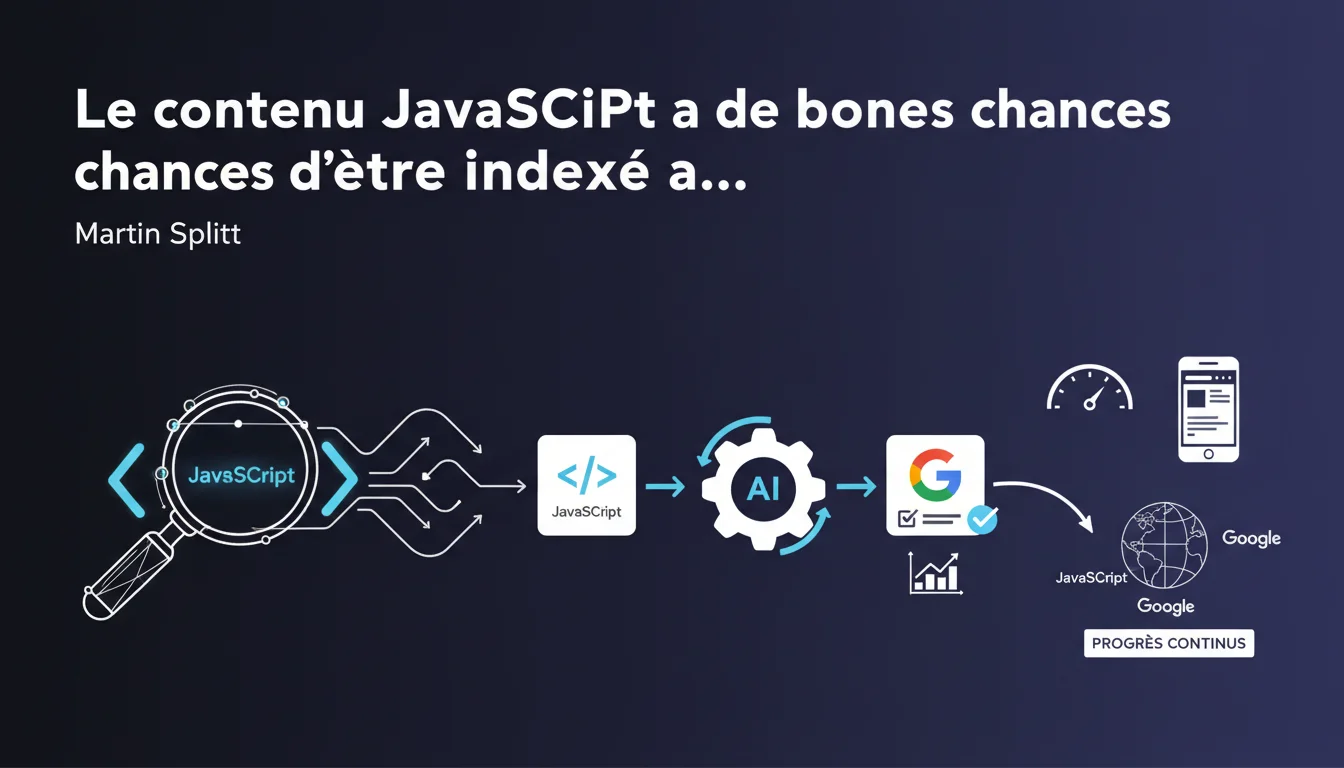

Google affirme que le contenu généré en JavaScript a désormais de bonnes chances d'être indexé, même si le sujet n'est pas totalement résolu. L'indexation JS s'est nettement améliorée ces dernières années, mais reste un défi technique avec des zones grises. Concrètement ? Miser uniquement sur JavaScript reste risqué pour du contenu critique.

Ce qu'il faut comprendre

Que signifie vraiment « de bonnes chances d'être indexé » ?

Cette formulation prudente de Martin Splitt trahit une réalité terrain : l'indexation JavaScript n'est pas garantie à 100%. Google a effectivement progressé sur le rendu côté client, mais « bonnes chances » n'équivaut pas à « certitude absolue ».

Le problème central reste le budget crawl et le coût du rendering. Google doit d'abord crawler la page HTML brute, puis attendre que le JavaScript s'exécute pour récupérer le contenu final. Ce processus en deux temps peut générer des retards d'indexation, voire des échecs purs et simples si les ressources sont limitées.

Pourquoi Google parle-t-il d'« énormes progrès » ?

Historiquement, Google ne savait pas du tout traiter JavaScript. Tout contenu dynamique était invisible pour Googlebot. Depuis l'introduction de son moteur de rendu basé sur Chromium, les choses ont changé.

Mais soyons honnêtes : « énormes progrès » ne signifie pas « problème résolu ». Les sites complexes avec du JS lourd, des frameworks React/Vue/Angular mal configurés ou des temps de chargement prohibitifs rencontrent encore des difficultés. Le rendering différé peut prendre plusieurs jours — ou ne jamais se produire.

Quels sont les points essentiels à retenir ?

- L'indexation JavaScript fonctionne mieux qu'avant, mais reste imprévisible pour du contenu stratégique

- Google utilise un processus en deux étapes : crawl HTML brut, puis rendering JS si budget disponible

- Les sites avec ressources limitées (faible autorité, crawl budget réduit) subissent davantage de retards

- Le SSR (Server-Side Rendering) ou l'hydratation reste la solution la plus fiable pour garantir l'indexation

- JavaScript n'est pas un « non » catégorique, mais un « oui sous conditions »

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées terrain ?

Oui et non. Sur des sites bien optimisés avec un bon crawl budget, Google indexe effectivement beaucoup de contenu JS. Mais dès qu'on sort des sentiers battus — sites récents, faible autorité, JS mal structuré — les problèmes surgissent.

Les tests empiriques montrent que le contenu critique ne doit jamais dépendre uniquement de JavaScript. Même avec les « énormes progrès » mentionnés, on observe encore des pages où le contenu JS n'apparaît qu'après plusieurs semaines. [A vérifier] : Google ne communique aucune métrique précise sur le taux de succès du rendering JS, ce qui rend difficile toute évaluation chiffrée.

Quelles nuances faut-il apporter à cette annonce ?

Splitt parle de « bonnes chances », pas de garantie. C'est crucial. Le rendering JS dépend de multiples facteurs : budget crawl, complexité du code, temps d'exécution, ressources serveur. Un site peut parfaitement fonctionner en JS pour l'utilisateur et rester partiellement invisible pour Google.

Et c'est là que ça coince. Les frameworks modernes (Next.js, Nuxt) proposent du SSR ou du SSG justement parce qu'ils savent que le CSR pur reste aléatoire. Si ces outils existent, c'est bien que le problème n'est pas « résolu ».

Dans quels cas cette règle ne s'applique-t-elle pas ?

Pour les sites à faible autorité ou les pages profondes avec peu de backlinks, le rendering JS reste un pari risqué. Google alloue moins de ressources à ces pages, donc le contenu dynamique peut simplement ne jamais être rendu.

Même chose pour les sites e-commerce avec des milliers de pages produits générées en JS. Le crawl budget explose, le rendering traîne, et certaines pages restent invisibles pendant des semaines. Le SSR ou l'hydratation partielle deviennent alors indispensables.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

D'abord, auditer votre implémentation JavaScript actuelle. Utilisez la Search Console pour vérifier que Google voit bien le contenu final après rendering. Comparez le HTML brut avec le rendu complet via l'outil d'inspection d'URL.

Ensuite, identifiez le contenu critique — titres, méta-descriptions, textes principaux, liens internes. Ce contenu ne doit jamais dépendre uniquement de JavaScript. Préférez le SSR, le SSG, ou au minimum une hydratation progressive.

Quelles erreurs éviter absolument ?

Ne vous fiez pas aveuglément aux déclarations de Google. « Bonnes chances » n'est pas une promesse contractuelle. Tester, mesurer, vérifier — c'est la seule approche fiable.

Évitez aussi de générer des éléments SEO critiques (balises title, méta-descriptions, données structurées) uniquement en JS. Même si Google peut les récupérer, le délai de rendering peut pénaliser l'indexation initiale.

- Vérifier que le contenu principal apparaît dans le HTML brut (View Source)

- Tester le rendering avec l'outil d'inspection d'URL de la Search Console

- Privilégier SSR/SSG pour les pages stratégiques (accueil, catégories, fiches produits)

- Monitorer le crawl budget et les erreurs de rendering via Search Console

- Implémenter un fallback HTML pour le contenu essentiel

- Éviter les frameworks JS lourds sans optimisation préalable

Comment garantir une indexation fiable du contenu dynamique ?

La solution la plus robuste reste le Server-Side Rendering ou la génération statique. Next.js, Nuxt, SvelteKit offrent ces options nativement. Vous servez du HTML complet dès la première requête, Google indexe immédiatement.

Si le SSR n'est pas envisageable, optez pour une hydratation progressive : le contenu essentiel arrive en HTML, le JS enrichit ensuite l'expérience utilisateur. C'est un compromis acceptable.

❓ Questions frequentes

Google indexe-t-il tout le contenu JavaScript sans exception ?

Le SSR est-il obligatoire pour être bien référencé en JS ?

Comment vérifier que Google voit bien mon contenu JS ?

Les frameworks modernes comme React sont-ils compatibles avec le SEO ?

Combien de temps Google met-il pour rendre une page JavaScript ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 11/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.