Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ JavaScript et indexation : Google est-il vraiment capable de tout indexer ?

- □ Le Web Rendering Service de Google suit-il vraiment toutes les dernières fonctionnalités de Chrome ?

- □ Pourquoi Google peine-t-il à indexer correctement les sites qui utilisent des Web Workers ?

- □ Pourquoi les SEO et développeurs doivent-ils absolument travailler ensemble ?

- □ Les core updates de Google sont-elles vraiment des rappels à l'ordre sur les guidelines ?

- □ Les core updates sont-elles vraiment neutres ou cachent-elles des pénalités déguisées ?

- □ Core update : pourquoi Google refuse-t-il de donner des détails spécifiques ?

- □ Les core updates de Google sont-elles vraiment conçues pour améliorer l'expérience utilisateur ou pour redistribuer les positions ?

- □ Les core updates de Google affectent-ils vraiment tous les sites ?

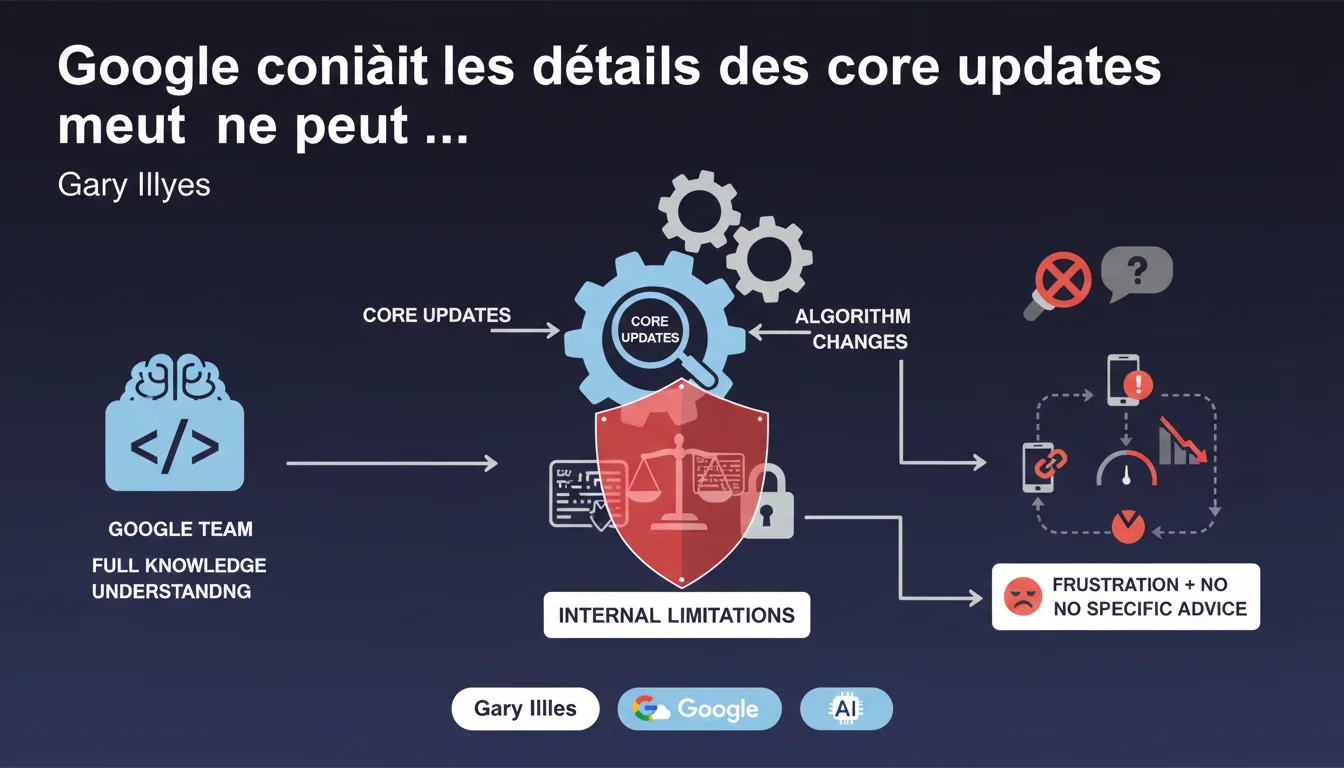

L'équipe de Google sait exactement ce qui change lors des core updates mais ne peut légalement ou stratégiquement pas le divulguer. La seule ligne officielle reste la recommandation de suivre les guidelines — une réponse qui frustre l'industrie SEO depuis des années.

Ce qu'il faut comprendre

Pourquoi cette déclaration de Gary Illyes est-elle importante ?

Gary Illyes admet ici ce que beaucoup soupçonnaient : Google dispose d'informations précises sur les core updates mais choisit délibérément de ne pas les partager. Ce n'est pas un manque de connaissance — c'est une limitation imposée, probablement pour des raisons juridiques, concurrentielles ou pour éviter la manipulation des algorithmes.

Cette transparence partielle crée une asymétrie d'information frustrante. Les SEO doivent travailler à l'aveugle avec des corrélations et des hypothèses, pendant que Google détient le mode d'emploi complet.

Que signifie « ne peut pas communiquer » dans ce contexte ?

Le terme « ne peut pas » suggère une contrainte externe plutôt qu'un refus arbitraire. Plusieurs hypothèses sont plausibles : obligations antitrust (ne pas favoriser certains acteurs), protection de la propriété intellectuelle, ou éviter que des stratégies de manipulation émergent avant que les systèmes anti-spam ne soient prêts.

Résultat : les équipes Search sont coincées entre leur expertise technique et l'impossibilité de la partager. D'où cette communication générique répétée à chaque update.

Les « guidelines » sont-elles vraiment la seule boussole valable ?

En théorie, oui. Les Quality Rater Guidelines et les principes E-E-A-T restent la documentation officielle la plus complète. Mais dans la pratique, ces documents sont trop généraux pour diagnostiquer une chute de trafic post-update.

La réalité du terrain montre que certains facteurs techniques (temps de chargement, structure, crawl efficace) jouent un rôle déterminant — même si Google préfère parler de « contenu de qualité ».

- Google connaît les détails exacts des core updates mais ne les communiquera jamais publiquement

- Cette limitation n'est pas un choix de l'équipe Search mais une contrainte imposée

- Les guidelines restent le seul cadre officiel, malgré leur caractère générique

- L'industrie SEO doit continuer à travailler par hypothèses et corrélations terrain

Avis d'un expert SEO

Cette politique de silence est-elle tenable à long terme ?

Honnêtement ? Probablement oui, mais au prix d'une frustration croissante de l'industrie. Google a survécu à des décennies de réclamations pour plus de transparence sans céder. La position dominante du moteur lui permet de maintenir cette asymétrie.

Le problème, c'est que cette opacité alimente les théories du complot et les fausses certitudes. Des « experts » vendent des formules magiques basées sur des corrélations douteuses, pendant que les vrais signaux restent enfouis dans du bruit statistique.

Observe-t-on réellement une cohérence entre les guidelines et les résultats terrain ?

Pas toujours. Les guidelines parlent de contenu utile, d'expertise et d'expérience utilisateur — mais certains sites techniquement médiocres avec du contenu moyen rankent mieux que des ressources expertes mal optimisées techniquement. [À vérifier] : la pondération réelle entre signaux de qualité et signaux techniques reste floue.

Les observations post-update montrent souvent des patterns (augmentation de l'importance des liens internes, valorisation du contenu « frais », etc.) que Google ne confirmera jamais officiellement. On travaille par triangulation.

Faut-il accepter cette opacité ou continuer à réclamer plus de détails ?

Les deux. Réclamer de la transparence maintient une pression publique qui peut au moins influencer les communications futures. Mais pragmatiquement, il faut accepter qu'on n'aura jamais la recette complète.

La vraie compétence SEO aujourd'hui, c'est de savoir interpréter les signaux faibles, tester méthodiquement et ajuster rapidement — pas d'attendre que Google publie un mode d'emploi.

Impact pratique et recommandations

Que faire concrètement face à cette absence d'informations précises ?

D'abord, arrêter de chercher une recette magique. Si Google ne peut pas communiquer les détails, aucun « gourou SEO » ne les connaît non plus. Méfiez-vous des certitudes absolues vendues comme des vérités révélées.

Ensuite, adoptez une approche basée sur les fondamentaux documentés : architecture technique solide, contenu aligné avec l'intention de recherche, expérience utilisateur fluide, signaux E-E-A-T clairs. Ces piliers traversent tous les updates sans exception.

Comment adapter sa stratégie SEO dans ce contexte d'opacité ?

Privilégiez la mesure et l'expérimentation. Mettez en place des tests A/B sur des segments de pages, suivez les corrélations entre vos actions et vos performances, documentez vos observations après chaque core update.

Diversifiez vos sources d'information : études de cas terrain, analyses de corrélation à grande échelle (type Semrush Sensor ou Sistrix), retours de la communauté SEO. La vérité émerge souvent de la convergence de plusieurs signaux indépendants.

Quelles erreurs éviter face à l'incertitude des core updates ?

Ne paniquez pas à chaque fluctuation. Les core updates prennent souvent plusieurs semaines pour se stabiliser. Attendre 2-3 semaines avant de réagir évite des décisions hâtives basées sur du bruit.

Évitez les sur-optimisations brutales. Modifier massivement un site après une chute peut aggraver la situation si vous partez sur de mauvaises hypothèses. Procédez par itérations mesurées et documentées.

- Auditez régulièrement votre conformité aux Quality Rater Guidelines et aux principes E-E-A-T

- Mettez en place un suivi granulaire de vos KPIs SEO pour détecter rapidement les impacts d'update

- Documentez vos hypothèses et testez-les méthodiquement sur des échantillons de pages

- Investissez dans une architecture technique robuste (crawl, indexation, Core Web Vitals)

- Construisez une expertise sectorielle démontrable plutôt que de multiplier les contenus génériques

- Restez connecté aux observations de la communauté SEO pour croiser les signaux

❓ Questions frequentes

Pourquoi Google ne peut-il pas révéler les détails des core updates ?

Les Quality Rater Guidelines suffisent-elles vraiment pour optimiser son site ?

Comment réagir à une chute de trafic après un core update sans savoir ce qui a changé ?

Peut-on faire confiance aux analyses de corrélation post-update publiées par les outils SEO ?

Cette opacité de Google va-t-elle évoluer un jour ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 11/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.