Declaration officielle

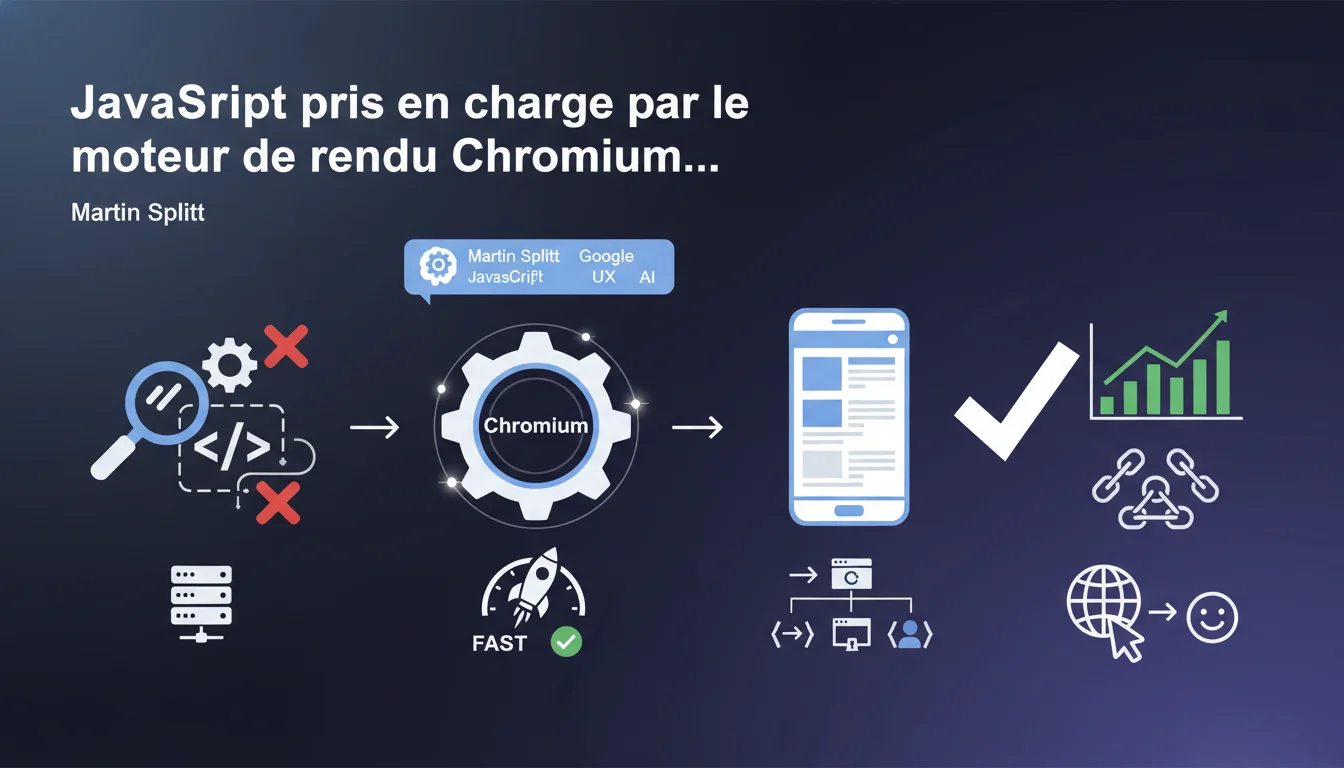

Google utilise désormais un moteur de rendu Chromium moderne pour traiter le JavaScript, abandonnant l'ancien système basé sur Chrome 41. Cette évolution améliore considérablement la compatibilité avec les frameworks modernes (React, Vue, Angular) et réduit les risques d'indexation partielle. Pour autant, cela ne dispense pas d'une approche structurée : le budget crawl reste limité, et certains sites complexes nécessitent toujours du SSR ou de la prérendu.

Ce qu'il faut comprendre

Qu'est-ce qui a réellement changé dans le moteur de rendu de Google ?

Pendant des années, Googlebot s'appuyait sur Chrome 41, une version datant de 2015. Cela posait d'énormes problèmes de compatibilité avec les frameworks JavaScript modernes qui exploitent des fonctionnalités ES6+ non supportées par ce vieux moteur.

Désormais, Google a migré vers un moteur Chromium evergreen, c'est-à-dire une version régulièrement mise à jour. Concrètement ? Les promesses, async/await, les modules ES6, les API modernes — tout ça passe sans nécessiter de transpilation aggressive.

Cela signifie-t-il que tous les sites JavaScript sont désormais crawlés parfaitement ?

Non. Le moteur de rendu moderne améliore la compatibilité technique, mais ne résout pas les problèmes structurels : temps de chargement excessifs, contenu généré après interactions utilisateur, dépendances à des ressources bloquées par robots.txt.

Si votre site nécessite trois secondes de calculs JS avant d'afficher le contenu principal, même un moteur récent n'y changera rien — le budget crawl sera épuisé avant que Googlebot ne voie l'essentiel.

Quels frameworks et technologies bénéficient le plus de cette évolution ?

Les Single Page Applications (SPA) construites avec React, Vue, Angular sont les grandes gagnantes. Les syntaxes modernes, les web components, les lazy-loading natifs — tout ce qui réclamait auparavant des polyfills lourds fonctionne désormais nativement.

Mais attention : cela ne transforme pas magiquement une architecture client-side en solution SEO-proof. Le SSR (Server-Side Rendering) ou le static generation restent des approches plus fiables pour les contenus critiques.

- Migration Chromium evergreen : Google abandonne Chrome 41 pour un moteur régulièrement mis à jour

- Meilleure compatibilité ES6+ : async/await, promesses, modules — plus besoin de transpiler agressivement

- Frameworks modernes supportés : React, Vue, Angular bénéficient d'un rendu plus fiable

- Limites persistantes : le budget crawl, les ressources bloquées, les délais de rendu restent des freins réels

- SSR/SSG toujours recommandés : pour les contenus critiques, le rendu côté serveur reste la stratégie la plus sûre

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui et non. Sur des sites à architecture simple, on observe effectivement une amélioration du rendu depuis cette migration. Les erreurs liées aux incompatibilités ES6 ont drastiquement diminué dans Search Console.

Mais sur des sites complexes — notamment les marketplaces, les SaaS avec dashboards lourds — on constate toujours des problèmes d'indexation partielle. Le moteur moderne rend mieux, mais si le contenu nécessite plusieurs requêtes API chaînées, Googlebot abandonne souvent avant la fin. [A vérifier] : Google n'a jamais publié de métriques précises sur les timeouts et limites de rendu par page.

Quelles nuances faut-il apporter à cette annonce ?

Martin Splitt répète depuis des années que « JavaScript fonctionne », mais il omet systématiquement de parler du coût en budget crawl. Oui, Chromium moderne rend mieux — mais il consomme aussi plus de ressources serveur, ce qui peut ralentir la fréquence de crawl sur des sites à forte volumétrie.

Autre point : cette migration ne concerne que le rendu final. Si votre site charge du contenu via fetch() déclenché par un scroll ou un clic, ce contenu reste invisible pour Googlebot. L'amélioration porte sur l'exécution du JavaScript initial, pas sur les interactions utilisateur.

Dans quels cas cette amélioration ne change-t-elle rien ?

Si vous utilisez du lazy-loading agressif avec intersection observers, si votre contenu dépend d'événements scroll, si vos ressources critiques sont bloquées par robots.txt — le moteur moderne ne résoudra rien.

De même, les sites avec authentification obligatoire, les contenus derrière des paywalls JS, ou les SPAs sans fallback HTML restent problématiques. Le moteur exécute mieux le code, mais il ne simule pas un utilisateur réel qui clique et scrolle.

Impact pratique et recommandations

Que faut-il faire concrètement si votre site utilise beaucoup de JavaScript ?

Première étape : testez vos pages critiques avec l'outil d'inspection d'URL dans Search Console. Comparez le HTML initial (View Crawled Page > More Info > View HTML) avec le rendu final. Si des blocs de contenu manquent, c'est qu'ils ne sont pas visibles pour Googlebot.

Ensuite, analysez vos Core Web Vitals côté serveur. Un LCP supérieur à 2,5 secondes signale souvent un problème de rendu qui pénalisera l'indexation, même avec un moteur moderne.

Quelles erreurs éviter absolument avec JavaScript et SEO ?

Ne bloquez jamais les fichiers CSS et JS critiques dans robots.txt — c'est la source n°1 de problèmes de rendu. Google a besoin de ces ressources pour afficher correctement la page.

Évitez de placer votre contenu principal derrière des événements utilisateur (click, scroll). Si votre H1 ou vos paragraphes clés apparaissent après un clic sur « Voir plus », Googlebot ne les verra jamais.

N'utilisez pas de redirections JavaScript (window.location) pour gérer les canonicals ou les variantes mobiles. Google les détecte mal et cela crée des chaînes de redirection invisibles dans les logs serveur.

Comment vérifier que votre implémentation JavaScript est SEO-compatible ?

Mettez en place un monitoring régulier via l'API Search Console pour détecter les pages indexées avec du contenu manquant. Comparez le nombre de mots indexés (via l'outil d'inspection) avec le nombre réel sur le site.

Utilisez des tests de rendu automatisés avec Puppeteer ou Playwright pour simuler le comportement de Googlebot. Vérifiez que le contenu critique apparaît dans le DOM sans interaction utilisateur.

- Tester toutes les pages critiques avec l'outil d'inspection d'URL de Search Console

- Vérifier que les fichiers CSS/JS critiques ne sont pas bloqués dans robots.txt

- S'assurer que le contenu principal apparaît dans le HTML initial ou après exécution JS simple

- Mesurer le temps de rendu avec Lighthouse et viser un LCP < 2,5s

- Éviter les redirections JavaScript pour les canonicals et variantes mobiles

- Implémenter du SSR ou du static generation pour les contenus à forte valeur SEO

- Monitorer régulièrement les écarts entre HTML source et rendu final via API Search Console

- Mettre en place des alertes sur les baisses soudaines d'indexation de pages JS-heavy

❓ Questions frequentes

Le moteur Chromium moderne de Google indexe-t-il tout le JavaScript automatiquement ?

Faut-il encore transpiler son code JavaScript pour Googlebot ?

Comment savoir si Google rend correctement mes pages JavaScript ?

Les SPAs (Single Page Applications) sont-elles désormais SEO-friendly grâce à Chromium ?

Quels frameworks JavaScript bénéficient le plus de cette évolution ?

🎥 De la même vidéo 3

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 23/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.