Declaration officielle

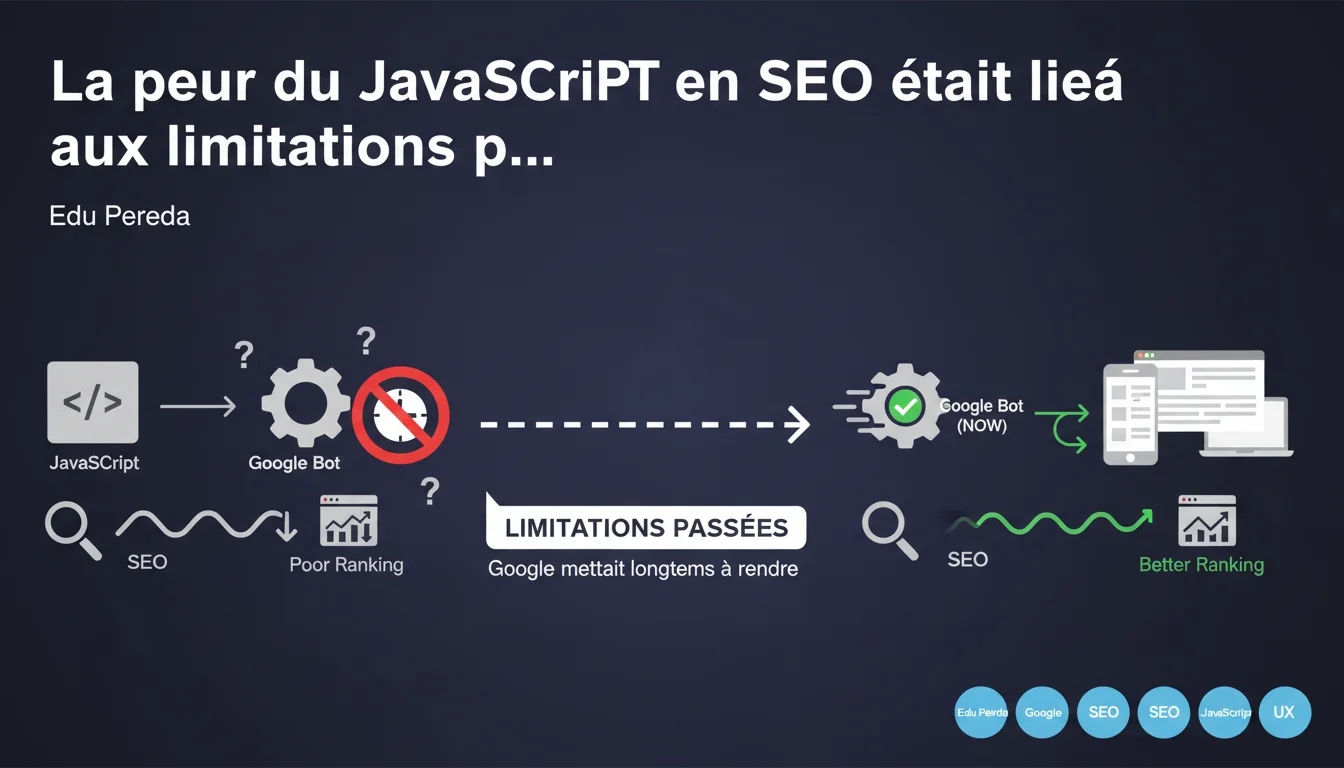

Google reconnaît que la méfiance historique des SEO envers JavaScript venait de ses propres limitations techniques : le moteur mettait trop de temps à rendre les pages dynamiques. Cette époque est révolue — le rendering JavaScript est désormais géré efficacement, même si des précautions restent nécessaires pour éviter les pièges classiques.

Ce qu'il faut comprendre

Edu Pereda, représentant de Google, admet ici une vérité que beaucoup de praticiens connaissaient déjà : la crainte du JavaScript en SEO n'était pas un mythe inventé par des développeurs paranoïaques, mais une réaction légitime aux limitations techniques réelles de Googlebot.

Pendant des années, le moteur de recherche peinait à exécuter correctement le code JavaScript, créant des délais de rendering aberrants et des risques d'indexation partielle. Les sites en JavaScript framework (React, Vue, Angular) se retrouvaient souvent avec des pages vides côté serveur, obligeant Google à faire un double travail : crawler, puis attendre le rendering.

Qu'est-ce qui a changé dans le traitement du JavaScript par Google ?

Google a progressivement amélioré son moteur de rendering basé sur Chromium. Le temps de traitement s'est réduit, la compatibilité avec les frameworks modernes s'est renforcée. Concrètement, Googlebot peut maintenant exécuter du JavaScript complexe sans bloquer l'indexation pendant des jours.

Mais attention — cette amélioration ne signifie pas que tout est parfait. Des problèmes persistent : budget de crawl consommé par le rendering, délais d'indexation pour les nouvelles pages, risques si le JavaScript échoue silencieusement.

Cette déclaration invalide-t-elle les bonnes pratiques SSR/SSG ?

Non. Google dit simplement que ses capacités techniques se sont améliorées, pas que le Server-Side Rendering ou la génération statique sont devenus inutiles. Pour les sites à forte volumétrie ou les pages critiques (landing pages, fiches produits e-commerce), le SSR reste une assurance-vie.

Le rendering côté serveur offre des performances supérieures, une indexation quasi-instantanée et zéro dépendance aux aléas du rendering Google. Pourquoi prendre le risque quand l'alternative existe ?

- Limitation historique reconnue : Google admet que ses propres faiblesses techniques ont créé la peur du JavaScript.

- Amélioration technique réelle : le rendering JavaScript fonctionne mieux qu'avant, mais pas parfaitement.

- SSR/SSG toujours pertinents : ces solutions restent recommandées pour les contenus critiques et les gros volumes.

- Contexte compte : un blog personnel en React n'a pas les mêmes enjeux qu'un site e-commerce avec 100k références.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, dans les grandes lignes. Les tests montrent effectivement que Googlebot gère mieux le JavaScript qu'il y a cinq ans. Les sites SPA (Single Page Applications) s'indexent correctement, les frameworks modernes sont supportés.

Mais — et c'est un gros mais — « mieux » ne veut pas dire « sans friction ». Sur des sites avec des milliers de pages dynamiques, on observe encore des délais d'indexation significatifs, des incohérences entre versions desktop/mobile, des cas où le rendering échoue sans notification claire. Google a progressé, c'est factuel. Mais affirmer que la peur était uniquement liée au passé ? C'est minimiser les risques actuels.

Quelles nuances faut-il apporter à cette affirmation ?

Première nuance : Google parle de ses capacités techniques, pas de ses priorités. Le moteur peut rendre du JavaScript, certes. Mais quand il doit choisir entre crawler 1000 pages HTML statiques ou 100 pages JavaScript nécessitant du rendering, le budget de crawl favorise systématiquement le statique. C'est de la logique pure : moins de ressources serveur consommées.

Deuxième nuance : tous les JavaScripts ne se valent pas. Un script léger qui injecte du contenu dans le DOM après chargement ? Aucun problème. Un framework complexe avec du lazy-loading, des appels API multiples et du state management ? Terrain miné. Google ne précise jamais où se situe la limite tolérable — et c'est là que le bât blesse.

Troisième nuance : cette déclaration reste déclarative. Edu Pereda ne fournit aucune métrique, aucun benchmark, aucun cas d'usage précis. [À vérifier] donc en conditions réelles, site par site.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si ton site génère du contenu critique via JavaScript après interaction utilisateur (click, scroll, hover), Google ne verra rien. Le crawler ne simule pas ces actions. C'est une limite connue, documentée, et qui n'a pas disparu avec les améliorations du rendering.

Autre cas : les sites avec authentification ou contenu personnalisé. Google crawle en utilisateur non connecté — si ton JavaScript charge du contenu différent selon le profil, le moteur n'indexera que la version publique. Évident, mais souvent oublié.

Impact pratique et recommandations

Que faut-il faire concrètement si mon site utilise JavaScript ?

Première étape : vérifier que Googlebot voit bien ton contenu. Utilise l'outil d'inspection d'URL dans Search Console, compare le HTML brut et le rendu. Si des blocs de texte, des liens internes ou des images n'apparaissent que dans la version rendue, tu dépends entièrement du bon vouloir du rendering Google.

Deuxième étape : auditer les temps de chargement JavaScript. Si ton framework met plus de 3-4 secondes à afficher le contenu principal, Google risque de timeout ou de crawler la page avant que le contenu ne soit visible. Les Core Web Vitals (LCP notamment) sont un bon proxy ici.

Troisième étape : privilégier le contenu critique en HTML statique. Titres, paragraphes principaux, maillage interne, métadonnées — tout ça doit être présent dans le DOM initial, avant exécution JavaScript. Le reste peut être enrichi dynamiquement.

Quelles erreurs éviter avec JavaScript et SEO ?

Erreur classique : bloquer les ressources JavaScript dans robots.txt. Certains développeurs bloquent les fichiers .js pour « protéger » le code ou réduire le crawl. Résultat : Googlebot ne peut plus rendre la page correctement. C'est du suicide SEO.

Autre piège : lazy-loading agressif sur le contenu textuel. Charger les images en lazy, OK. Charger les paragraphes de texte uniquement au scroll ? Google ne scrolle pas — ton contenu devient invisible.

Dernière erreur : faire confiance aveugle aux déclarations Google. Teste, mesure, vérifie. Ce n'est pas parce que Google dit « on gère le JavaScript » que ton implémentation spécifique sera crawlée et indexée sans accroc.

- Comparer systématiquement HTML brut vs rendu dans Search Console

- Mesurer le temps d'exécution JavaScript (< 3s idéalement)

- Placer le contenu SEO critique dans le HTML initial, pas dans le JS

- Ne jamais bloquer les ressources JavaScript dans robots.txt

- Éviter le lazy-loading sur le contenu textuel principal

- Implémenter SSR ou SSG pour les pages à fort enjeu business

- Tester l'indexation en conditions réelles, pas seulement en théorie

Google a effectivement progressé dans le traitement du JavaScript — c'est indéniable. Mais cette amélioration ne dispense pas d'une architecture technique solide et d'une surveillance continue de l'indexation.

Les sites complexes avec des enjeux SEO élevés gagneront toujours à privilégier le rendu côté serveur ou la génération statique. Pour les autres, une vigilance technique accrue suffit — mais elle demande des compétences pointues et un suivi régulier. Si ces optimisations te semblent complexes ou chronophages, faire appel à une agence SEO spécialisée peut s'avérer judicieux : un audit technique approfondi et un accompagnement personnalisé permettront d'éviter les écueils classiques et de sécuriser ton indexation sur le long terme.

❓ Questions frequentes

Google indexe-t-il vraiment tout le contenu chargé en JavaScript ?

Le SSR est-il encore nécessaire pour un site React ou Vue ?

Comment vérifier que Googlebot voit bien mon contenu JavaScript ?

Le lazy-loading JavaScript pose-t-il problème pour le SEO ?

Peut-on bloquer les fichiers JavaScript dans robots.txt sans impact SEO ?

🎥 De la même vidéo 3

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 23/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.