Declaration officielle

Ce qu'il faut comprendre

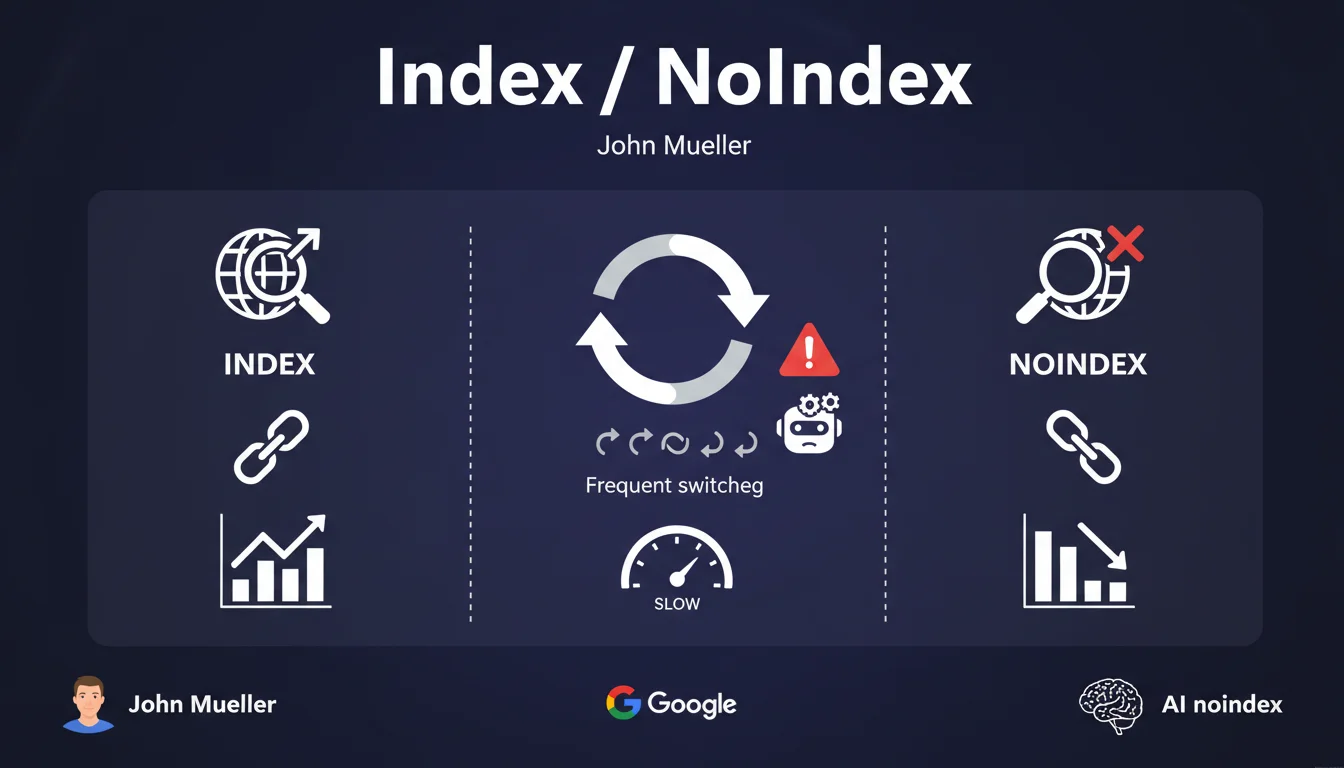

Pourquoi Google met-il en garde contre les changements fréquents de statut index/noindex ?

Google explique qu'une alternance répétée entre les états indexé et désindexé pour une même URL crée une confusion algorithmique. Le moteur de recherche ne parvient plus à déterminer l'intention réelle du propriétaire du site.

Cette incertitude pousse Google à ralentir le crawl de ces pages, car il interprète ces changements comme un manque de stabilité éditoriale. Les ressources de crawl sont alors réallouées vers des contenus jugés plus stables.

Quelles situations provoquent généralement ces basculements ?

Le cas le plus fréquent concerne les produits e-commerce en rupture de stock. Certains sites désindexent automatiquement ces pages, puis les réindexent lors du réapprovisionnement.

D'autres situations incluent les contenus saisonniers, les événements récurrents, ou les pages dont la pertinence varie selon des critères métier temporaires. Ces pratiques semblent logiques d'un point de vue éditorial mais posent problème techniquement.

Quels sont les risques concrets pour le référencement ?

- Ralentissement du crawl : Google diminue la fréquence de visite de ces URLs instables

- Perte de positionnement : Les pages réindexées ne retrouvent pas immédiatement leur visibilité antérieure

- Dilution du budget crawl : Les ressources sont gaspillées sur des pages à statut incertain

- Signal de qualité dégradé : L'instabilité peut être interprétée comme un manque de professionnalisme

- Indexation ralentie : Les nouvelles versions mettent plus de temps à être prises en compte

Avis d'un expert SEO

Cette recommandation est-elle cohérente avec les observations terrain ?

Absolument. Les analyses de logs montrent systématiquement une corrélation entre instabilité indexable et baisse de crawl. Google accorde sa confiance aux sites qui maintiennent des directives claires et stables.

Les sites e-commerce pratiquant le noindex/index cyclique constatent effectivement des délais de réindexation anormalement longs, parfois plusieurs semaines. Cette pénalité n'est pas manuelle mais algorithmique : le site perd en priorité de crawl.

Quelles nuances faut-il apporter à cette directive ?

La notion de "trop souvent" reste volontairement floue. Un changement ponctuel (une ou deux fois par an) ne pose généralement pas de problème. C'est la récurrence mensuelle ou hebdomadaire qui devient problématique.

Il faut également distinguer les changements massifs des modifications isolées. Basculer 5 000 URLs simultanément chaque mois aura un impact bien plus négatif que quelques pages individuelles.

Dans quels cas exceptionnels cette règle peut-elle être assouplie ?

Pour les sites d'actualité ou d'événementiel, Google comprend mieux la nature temporaire des contenus. La logique éditoriale justifie certaines variations.

Les sites avec une autorité très établie et un budget crawl confortable subissent moins de conséquences. Leur crawl reste généralement prioritaire malgré quelques incohérences.

Impact pratique et recommandations

Que faut-il faire concrètement pour gérer les produits en rupture de stock ?

La solution recommandée consiste à maintenir la page indexée mais à modifier son contenu. Indiquez clairement la rupture temporaire et proposez des alternatives (produits similaires, notification de retour en stock).

Pour les ruptures définitives, privilégiez une redirection 301 vers une catégorie pertinente plutôt qu'un noindex. Cette approche préserve l'équité de lien et maintient l'expérience utilisateur.

Si le noindex est vraiment nécessaire, assurez-vous que la page reste désindexée suffisamment longtemps (minimum 3-6 mois) avant toute réindexation. Évitez les cycles courts.

Quelles erreurs techniques faut-il absolument éviter ?

- Ne jamais automatiser les basculements index/noindex basés uniquement sur le stock disponible

- Éviter de combiner noindex avec une balise canonical pointant vers une autre URL (signaux contradictoires)

- Ne pas utiliser le noindex comme solution temporaire pour masquer du contenu de faible qualité

- Vérifier que les scripts JavaScript ne modifient pas dynamiquement la balise robots selon les sessions

- S'assurer que le fichier robots.txt ne bloque pas les URLs en noindex (Google doit pouvoir les crawler pour voir la directive)

- Auditer régulièrement les logs pour détecter les pages à statut instable

Comment vérifier et corriger les problèmes existants sur mon site ?

Commencez par un audit historique des directives d'indexation. Analysez vos logs crawl sur 6-12 mois pour identifier les URLs ayant changé fréquemment de statut. La Search Console peut également révéler des pages oscillant entre "indexée" et "exclue".

Créez une politique éditoriale claire définissant quand utiliser le noindex, les redirections ou le maintien en index avec modification de contenu. Documentez ces règles pour l'ensemble de l'équipe technique et éditoriale.

Pour les sites complexes avec des milliers de produits ou de contenus dynamiques, établir une stratégie cohérente et surveiller sa bonne application peut s'avérer particulièrement délicat. Ces optimisations touchent souvent à plusieurs systèmes (CMS, ERP, scripts) et nécessitent une coordination technique pointue. Dans ce contexte, faire appel à une agence SEO spécialisée permet de bénéficier d'une expertise transversale et d'un accompagnement personnalisé pour mettre en place des processus robustes et pérennes.

💬 Commentaires (0)

Soyez le premier à commenter.