Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Faut-il vraiment compter sur les service workers pour le SEO ?

- □ Googlebot ignore-t-il vraiment les service workers sur votre site ?

- □ Comment diagnostiquer les problèmes d'indexation causés par les service workers dans Search Console ?

- □ Comment les outils de test en direct de Google révèlent-ils les failles de rendu de votre site ?

- □ La console JavaScript révèle-t-elle vraiment les problèmes de rendu critiques pour le SEO ?

- □ Pourquoi la collaboration avec les développeurs est-elle la clé pour débloquer les problèmes d'indexation ?

- □ Faut-il vraiment injecter des console.log pour diagnostiquer les échecs de rendu côté Googlebot ?

- □ Pourquoi les service workers peuvent-ils rendre votre contenu invisible pour Googlebot ?

- □ Faut-il vraiment vérifier le HTML rendu dans Search Console pour diagnostiquer vos problèmes d'indexation ?

- □ Votre page indexée mais invisible : problème technique ou simplement mal classée ?

- □ Comment désactiver un service worker pour diagnostiquer des problèmes SEO ?

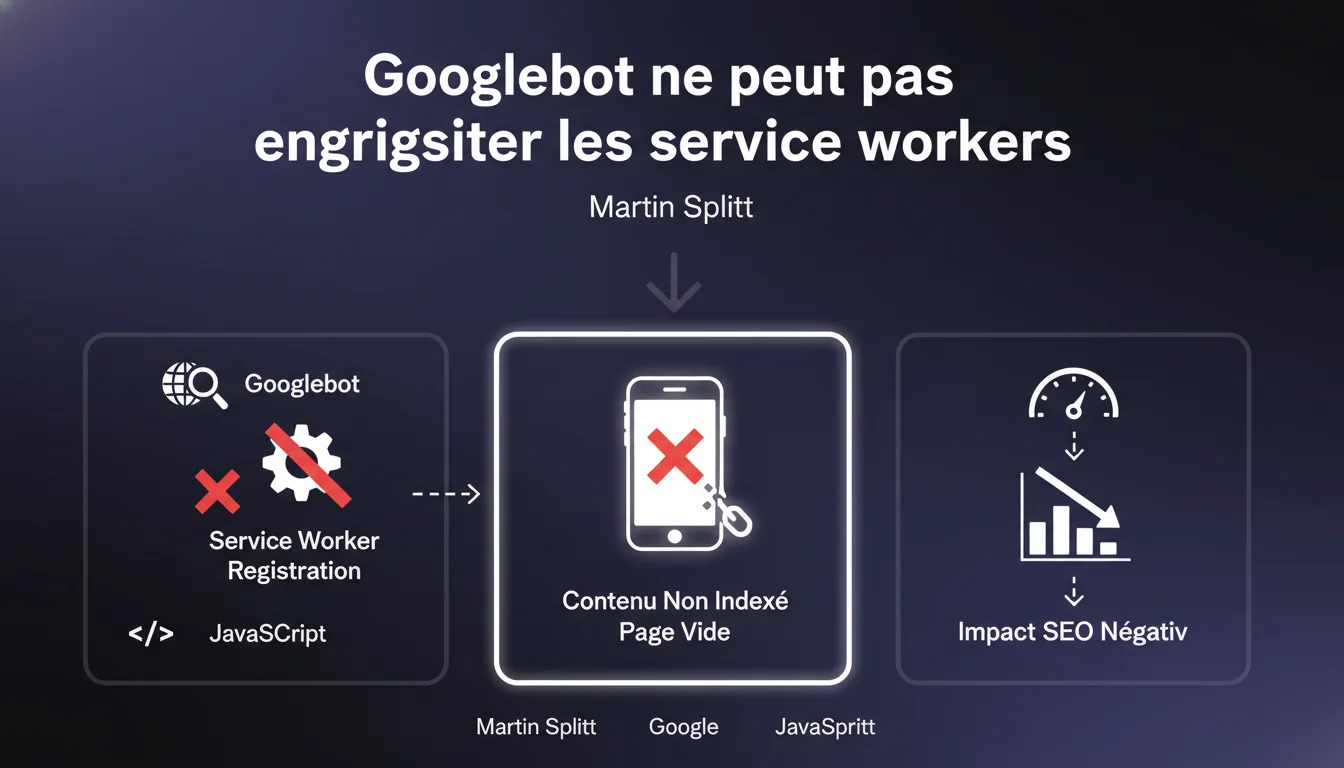

Googlebot ne peut pas enregistrer les service workers. Si votre site conditionne l'affichage du contenu principal à l'enregistrement d'un service worker via JavaScript côté client, Google verra des pages vides et n'indexera rien. C'est un piège mortel pour les Progressive Web Apps mal configurées.

Ce qu'il faut comprendre

Cette déclaration de Martin Splitt cible un problème technique spécifique qui touche surtout les Progressive Web Apps (PWA) et certaines architectures JavaScript avancées. Le service worker est un script qui s'exécute en arrière-plan du navigateur, indépendamment de la page web elle-même.

Il permet notamment de gérer le cache, les notifications push et le mode hors ligne. Mais voilà — Googlebot ne peut tout simplement pas l'enregistrer.

Pourquoi Googlebot refuse-t-il d'enregistrer les service workers ?

Google n'a jamais donné de raison technique détaillée publiquement. On peut supposer que c'est lié à la complexité d'exécution dans un environnement de crawl distribué et à des questions de sécurité. Les service workers ont accès à des API puissantes — intercepter les requêtes réseau, modifier les réponses, stocker des données.

Dans un contexte de rendu JavaScript où Google traite des milliards de pages, autoriser l'enregistrement de service workers créerait probablement un risque incontrôlable. Trop de variables, trop de surface d'attaque potentielle, trop de complexité pour une infrastructure qui doit rester prévisible.

Quel est le vrai danger pour l'indexation ?

Le problème surgit quand un développeur configure une PWA de cette façon : d'abord enregistrer le service worker, puis charger le contenu principal via JavaScript. Si Googlebot arrive sur la page, il ne peut pas enregistrer le worker. Le script attend donc un événement qui ne se produira jamais.

Résultat : page blanche pour Google. Rien à indexer, rien à classer. Votre site disparaît purement et simplement des SERP, même si tout fonctionne parfaitement côté utilisateur dans Chrome ou Firefox.

Tous les sites utilisant des service workers sont-ils concernés ?

Non. Si votre service worker gère uniquement le cache en arrière-plan ou les notifications push, sans conditionner l'affichage initial du contenu, vous ne risquez rien. Le danger existe seulement quand le contenu principal dépend de l'enregistrement réussi du worker.

C'est une question d'architecture : si le HTML initial contient déjà le contenu (ou si le JavaScript le charge sans attendre le service worker), Google voit la page normalement. Le service worker peut échouer silencieusement sans impact SEO.

- Googlebot ne peut pas enregistrer les service workers, c'est une limitation technique définitive

- Le contenu ne doit jamais être conditionné à l'enregistrement du service worker

- Les PWA doivent servir le contenu dans le HTML initial ou via JS indépendant du worker

- Un service worker qui gère cache/notifications en arrière-plan ne pose aucun problème

- L'erreur typique : attendre l'événement

navigator.serviceWorker.readyavant de charger le DOM principal

Avis d'un expert SEO

Cette limitation est-elle cohérente avec ce qu'on observe sur le terrain ?

Absolument. J'ai vu plusieurs PWA disparaître des résultats Google après une refonte technique qui plaçait justement le service worker au centre de l'architecture. Les outils de test de Google (Mobile-Friendly Test, URL Inspection Tool) montrent clairement des pages vides quand ce pattern est utilisé.

Ce qui surprend, c'est que Google promeut activement les PWA et les service workers côté développeur… mais impose cette contrainte côté crawl. Il y a une incohérence de communication entre les équipes. Les développeurs suivent les best practices Google pour les PWA, puis découvrent que leur site est invisible pour Googlebot.

Quelles nuances faut-il apporter à cette déclaration ?

La déclaration de Splitt est précise mais ne détaille pas les workarounds. En pratique, vous pouvez utiliser des service workers sans problème si vous respectez un principe : le contenu doit être accessible avant que le worker ne soit sollicité.

Concrètement, servez une version SSR (Server-Side Rendering) ou du HTML statique avec le contenu essentiel. Le service worker s'enregistre ensuite en parallèle pour améliorer l'expérience utilisateur — cache, offline, etc. — sans bloquer l'indexation. [A vérifier] : on manque de données officielles sur la manière dont Googlebot gère les tentatives d'enregistrement échouées dans les logs.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si votre site n'utilise pas de service workers du tout, évidemment. Mais aussi si vous utilisez un framework moderne (Next.js, Nuxt, SvelteKit) configuré avec SSR ou SSG activé par défaut — ces outils génèrent du HTML complet côté serveur, donc Googlebot voit le contenu immédiatement.

Le piège concerne surtout les PWA custom développées from scratch ou avec des configurations exotiques. Si vous déployez une app React/Vue/Angular en mode SPA pur + service worker pour tout gérer, là oui, vous êtes en danger.

Impact pratique et recommandations

Comment vérifier que mon site est conforme ?

Première étape : utilisez l'outil d'inspection d'URL dans Google Search Console. Demandez un test en direct, puis regardez la capture d'écran du rendu. Si la page est vide ou incomplète alors qu'elle s'affiche normalement dans votre navigateur, vous avez un problème de dépendance au service worker.

Deuxième vérification : ouvrez votre site en navigation privée avec le JavaScript désactivé. Si vous voyez le contenu principal (textes, titres, structure), c'est bon signe — cela signifie que le HTML initial contient l'essentiel. Si tout disparaît, vous dépendez probablement trop du JS… et peut-être du service worker.

Que faut-il faire concrètement pour corriger le tir ?

Restructurez l'architecture pour que le contenu soit servi indépendamment du service worker. Si vous utilisez une PWA, passez à un modèle SSR ou SSG : Next.js, Nuxt, Gatsby, Eleventy, etc. Ces frameworks génèrent du HTML complet côté serveur ou au build.

Le service worker peut ensuite s'enregistrer après le chargement initial, en mode progressive enhancement. L'utilisateur bénéficie du cache et de l'expérience offline, mais Google voit le contenu dès le premier rendu HTML. Tout le monde y gagne.

Si votre stack ne permet pas de SSR facilement, envisagez une solution hybride : servez le contenu critique en HTML statique (via un build Webpack/Vite qui injecte le contenu), puis hydratez avec JavaScript. Le service worker ne doit jamais bloquer l'affichage initial.

Quelles erreurs éviter absolument ?

- Ne conditionnez jamais l'affichage du contenu principal à

navigator.serviceWorker.ready - N'utilisez pas de spinner ou d'écran de chargement qui attend l'enregistrement du worker avant de montrer le DOM

- Évitez les configurations PWA par défaut de certains plugins sans vérifier leur impact sur le rendu initial

- Ne comptez pas sur le service worker pour injecter du contenu critique via

fetchintercepté - Testez systématiquement le rendu Googlebot dans la Search Console après chaque modification technique majeure

En résumé : les service workers sont puissants pour améliorer l'UX, mais ne doivent jamais conditionner l'indexation. Servez le contenu en HTML initial ou via SSR, et laissez le worker s'occuper du cache en arrière-plan.

Ce type de refonte technique — passage d'une SPA pure à une architecture SSR/SSG compatible SEO — peut vite devenir complexe, surtout si vous avez une stack custom ou des contraintes legacy. Si vous n'êtes pas certain de maîtriser tous les enjeux d'indexation et de rendu JavaScript, il peut être judicieux de vous faire accompagner par une agence SEO spécialisée qui connaît ces problématiques et pourra auditer votre architecture avant qu'elle ne pénalise votre visibilité.

❓ Questions frequentes

Est-ce que tous les sites PWA sont impactés par cette limitation ?

Puis-je utiliser des service workers pour gérer le cache sans risque SEO ?

Comment tester si Googlebot voit bien mon contenu malgré le service worker ?

Quel framework choisir pour une PWA compatible SEO ?

Google prévoit-il de supporter les service workers dans Googlebot un jour ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/11/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.