Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Faut-il vraiment compter sur les service workers pour le SEO ?

- □ Googlebot peut-il indexer un site qui dépend de service workers pour afficher son contenu ?

- □ Googlebot ignore-t-il vraiment les service workers sur votre site ?

- □ Comment les outils de test en direct de Google révèlent-ils les failles de rendu de votre site ?

- □ La console JavaScript révèle-t-elle vraiment les problèmes de rendu critiques pour le SEO ?

- □ Pourquoi la collaboration avec les développeurs est-elle la clé pour débloquer les problèmes d'indexation ?

- □ Faut-il vraiment injecter des console.log pour diagnostiquer les échecs de rendu côté Googlebot ?

- □ Pourquoi les service workers peuvent-ils rendre votre contenu invisible pour Googlebot ?

- □ Faut-il vraiment vérifier le HTML rendu dans Search Console pour diagnostiquer vos problèmes d'indexation ?

- □ Votre page indexée mais invisible : problème technique ou simplement mal classée ?

- □ Comment désactiver un service worker pour diagnostiquer des problèmes SEO ?

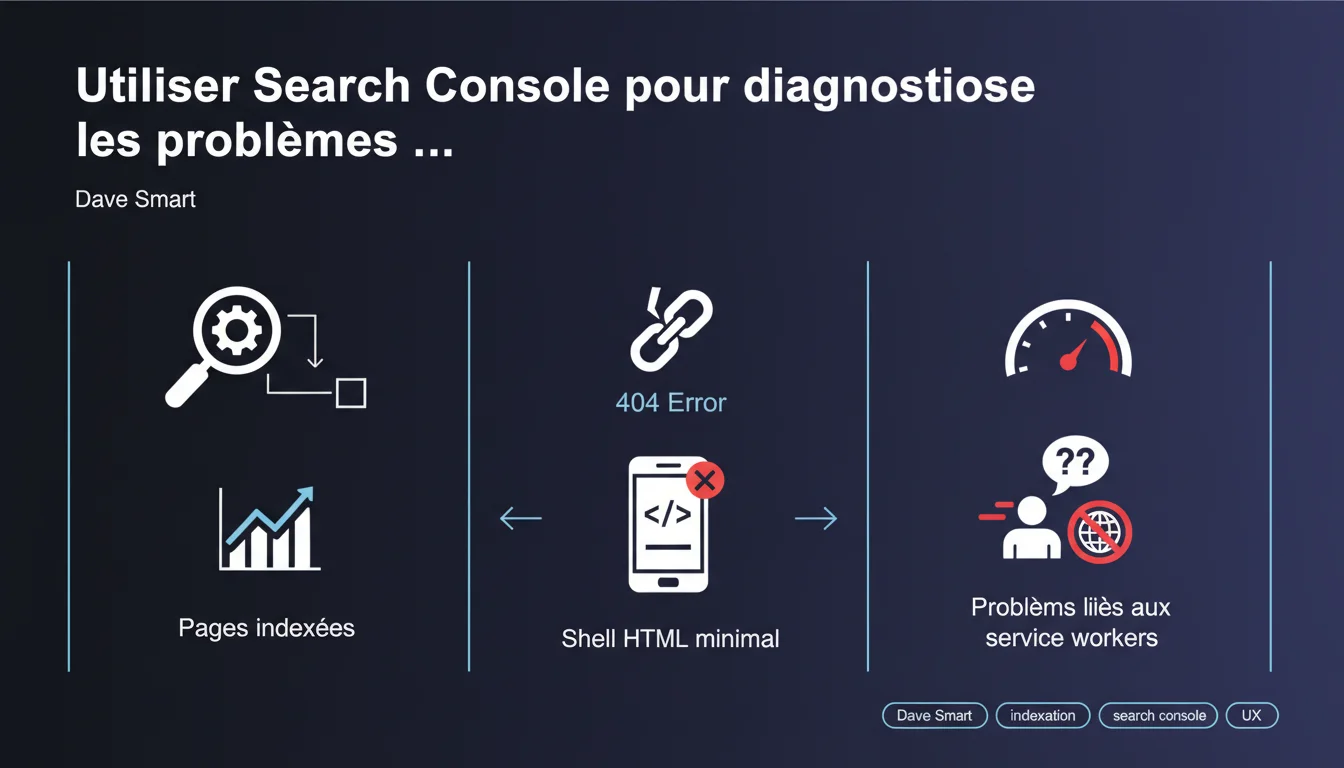

Google recommande d'utiliser Search Console pour identifier les problèmes d'indexation liés aux service workers. L'approche consiste à vérifier le nombre de pages indexées, traquer les erreurs 404 et détecter si seul le shell HTML minimal est crawlé au lieu du contenu réel. Un diagnostic souvent négligé qui peut cacher de sérieux problèmes d'indexation.

Ce qu'il faut comprendre

Pourquoi les service workers posent-ils des problèmes d'indexation ?

Les service workers sont des scripts JavaScript qui agissent comme proxy entre le navigateur et le réseau. Ils permettent de créer des Progressive Web Apps (PWA) avec fonctionnalités offline et cache avancé.

Le hic ? Googlebot peut crawler une version cachée ou un shell HTML vide si le service worker n'est pas correctement configuré. Résultat : votre contenu principal n'est jamais vu par le moteur de recherche.

Que signifie concrètement "shell HTML minimal" ?

Un shell HTML minimal, c'est la structure de base de votre page — header, footer, navigation — sans le contenu textuel principal qui fait la valeur SEO de la page. Si seul ce shell est indexé, vous perdez toute votre visibilité sur les requêtes cibles.

Google peut indexer cette coquille vide parce que le service worker sert une version intermédiaire avant que le JavaScript ne charge le contenu réel. Et Googlebot, malgré ses progrès sur le rendu JS, peut encore rater le timing.

Quels sont les indicateurs clés à surveiller dans Search Console ?

- Nombre de pages indexées : une chute brutale peut signaler que le service worker bloque l'indexation

- Erreurs 404 : le service worker peut servir des 404 pour des ressources qu'il ne trouve pas en cache

- Contenu rendu : via l'outil d'inspection d'URL, vérifiez que le HTML indexé contient bien votre contenu principal

- Couverture des pages : des pages marquées "Explorée, actuellement non indexée" peuvent trahir un problème de contenu vide

Avis d'un expert SEO

Cette recommandation est-elle vraiment suffisante pour diagnostiquer le problème ?

Soyons honnêtes : dire "utilisez Search Console" est un conseil générique. [À vérifier] car Google ne précise pas comment interpréter les signaux contradictoires — par exemple, une page marquée indexée mais dont le contenu rendu est vide.

Sur le terrain, j'ai vu des cas où Search Console affichait "Valide" alors que l'outil d'inspection d'URL révélait un shell vide. La discordance entre le statut d'indexation et le contenu réellement crawlé n'est pas rare — et Google ne donne aucune méthode claire pour la détecter.

Les service workers sont-ils vraiment le coupable principal ?

Dans la majorité des sites que j'audite, les problèmes d'indexation JavaScript viennent d'autres causes : timeout de rendu, lazy loading mal configuré, contenu chargé après interaction utilisateur. Les service workers sont rarement le point de blocage initial.

Quand un service worker pose problème, c'est souvent sur des sites PWA mal architecturés où le cache sert systématiquement une version obsolète ou incomplète. Et là, le diagnostic via Search Console seul ne suffit pas — il faut croiser avec des tests en conditions réelles (Mobile-Friendly Test, Screaming Frog en mode JavaScript).

Pourquoi Google ne fournit-il pas d'alerte spécifique pour ce cas ?

C'est la question qui dérange. Si les service workers sont un problème connu d'indexation, pourquoi Search Console n'a-t-il pas de message d'erreur dédié du type "Service worker détecté, contenu principal non rendu" ?

Ma lecture : Google préfère rester vague pour ne pas avoir à supporter tous les edge cases de configurations PWA exotiques. Résultat, c'est au SEO de jouer les détectives avec des outils partiels.

Impact pratique et recommandations

Comment vérifier concrètement si vos service workers bloquent l'indexation ?

Première étape : utilisez l'outil d'inspection d'URL de Search Console sur vos pages stratégiques. Comparez le HTML brut avec le HTML rendu — si le rendu n'affiche que la structure sans le contenu, vous avez un problème.

Deuxième étape : crawlez votre site avec Screaming Frog en mode JavaScript activé. Filtrez les pages dont le word count est anormalement bas ou qui contiennent uniquement des balises structurelles. Ces pages sont vos cibles prioritaires.

Quelles actions correctives mettre en place immédiatement ?

- Désactivez temporairement le service worker et recrawlez vos pages clés pour vérifier si l'indexation s'améliore

- Configurez le service worker pour qu'il serve une stratégie network-first à Googlebot plutôt que cache-first

- Utilisez des directives

X-Robots-Tagpour exclure les ressources cachées qui ne doivent pas être indexées - Vérifiez que le service worker n'intercepte pas les requêtes de Googlebot via un test User-Agent

- Implémentez un server-side rendering (SSR) ou pre-rendering pour les pages critiques si le JavaScript est complexe

- Surveillez les métriques de couverture dans Search Console après chaque modification

Faut-il abandonner les service workers pour le SEO ?

Non. Les service workers bien configurés n'empêchent pas l'indexation — c'est la mauvaise implémentation qui pose problème. Si votre site PWA a une architecture correcte avec SSR ou pre-rendering, vous pouvez conserver les avantages UX sans sacrifier le SEO.

Le vrai danger, c'est de combiner service workers + Single Page Application (SPA) + lazy loading agressif sans aucune solution de rendu côté serveur. Là, vous entrez en zone rouge.

❓ Questions frequentes

Comment savoir si mon site utilise un service worker ?

Les erreurs 404 causées par un service worker impactent-elles le ranking ?

Peut-on exclure Googlebot du service worker ?

Le pre-rendering résout-il tous les problèmes de service workers ?

Search Console affiche mes pages comme indexées mais le trafic a chuté, que faire ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/11/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.