Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Les Core Web Vitals sont-ils vraiment un facteur de classement Google ?

- □ Faut-il vraiment passer des mois à optimiser les Core Web Vitals ?

- □ Les Core Web Vitals sont-ils vraiment un facteur de classement SEO ?

- □ Google est-il vraiment patient avec le rendering JavaScript ou faut-il s'inquiéter de la vitesse ?

- □ Une page ultra-rapide mais vide peut-elle ranker grâce aux Core Web Vitals ?

- □ Les Core Web Vitals ont-ils vraiment transformé l'écosystème web comme le prétend Google ?

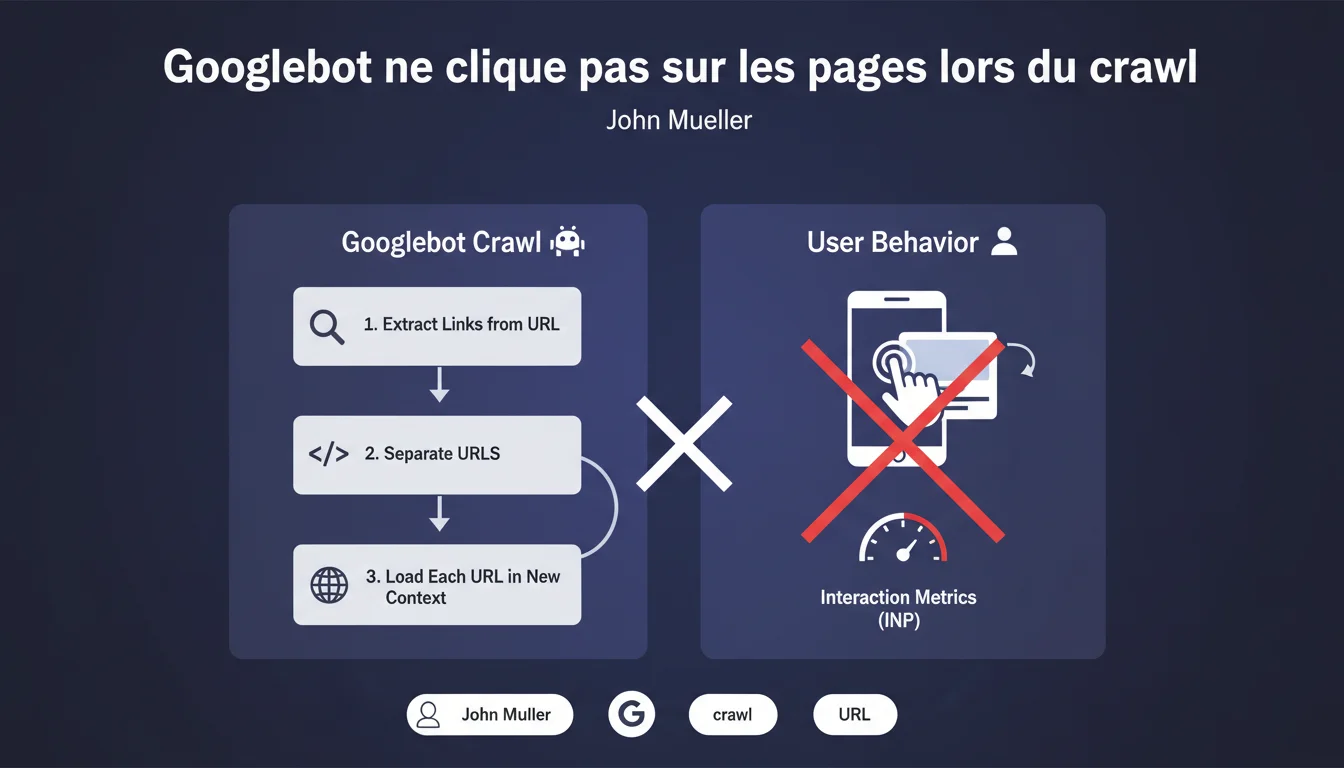

Googlebot ne navigue pas en cliquant de page en page comme un utilisateur. Chaque URL est chargée dans un contexte de navigateur isolé après extraction des liens. Les métriques d'interaction utilisateur type INP ne reflètent donc pas ce que vit réellement le crawler.

Ce qu'il faut comprendre

Comment Googlebot explore-t-il concrètement un site ?

Le comportement de Googlebot diffère radicalement de celui d'un visiteur humain. Aucun clic n'est simulé — le bot extrait d'abord tous les liens présents dans le code HTML, puis charge chaque URL découverte dans un environnement de rendu totalement vierge.

Chaque page crawlée démarre dans un contexte de navigateur frais, sans historique de navigation ni état de session persistant. Concrètement, Googlebot ne maintient pas de cookies entre deux URLs, ne garde pas de cache JavaScript actif d'une page à l'autre, et ne simule aucune interaction DOM comme le ferait un script Selenium.

Pourquoi cette distinction impacte-t-elle les Core Web Vitals ?

L'INP (Interaction to Next Paint) mesure la réactivité aux interactions utilisateur — clics, appuis clavier, touches tactiles. Or Googlebot ne génère aucune interaction lors du crawl. Il charge passivement le contenu rendu, point.

Cette métrique provient exclusivement des données CrUX (Chrome User Experience Report), c'est-à-dire de vrais utilisateurs Chrome naviguant sur votre site. Le crawler lui-même ne contribue jamais à ces statistiques d'interaction. Il observe le rendu final, mais n'évalue pas la fluidité des interactions.

Quels sont les points essentiels à retenir ?

- Isolation totale : chaque URL crawlée démarre dans un nouvel environnement de rendu

- Aucun clic simulé : Googlebot extrait les liens du HTML/JavaScript puis charge directement les URLs

- INP non mesuré par le crawler : seules les données utilisateurs réels (CrUX) comptent pour cette métrique

- Pas de persistance de session : cookies, localStorage, cache JavaScript ne portent pas d'une page crawlée à l'autre

- Le rendu reste important : même sans clic, Googlebot exécute JavaScript et attend le DOM stable

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. Les logs serveur montrent que Googlebot charge les URLs de manière parallèle, sans respecter l'ordre d'apparition dans le DOM ni simuler un parcours utilisateur. Deux pages liées entre elles peuvent être crawlées à plusieurs heures d'intervalle, voire par des instances Googlebot différentes.

Les tests avec des liens JavaScript déclenchés au clic confirment que le bot ne simule aucune interaction. Il extrait les URLs du code source (HTML initial + JavaScript rendu), mais ne déclenche jamais d'événements onclick, onmouseover ou touch. Si votre lien n'apparaît que suite à un hover ou un clic, Googlebot ne le trouvera pas.

Dans quels cas cette isolation pose-t-elle problème ?

Les architectures SPA (Single Page Application) mal conçues prennent cher. Si votre navigation repose sur des transitions JavaScript qui modifient l'état global de l'app sans mettre à jour l'URL, Googlebot ne verra que la page d'entrée. Chaque URL doit être crawlable indépendamment.

Les sites avec authentification progressive ou paywalls dynamiques doivent aussi revoir leur copie. Googlebot ne maintient pas de session — si votre contenu se dévoile après une séquence d'interactions, le crawler n'y accédera jamais. [À vérifier] : certains sites rapportent des comportements étranges avec des contenus lazy-loadés déclenchés par scroll, mais Google reste flou sur le niveau exact de simulation du scroll vertical.

Faut-il encore optimiser l'INP pour le SEO ?

Évidemment — mais pas pour Googlebot. L'INP fait partie des Core Web Vitals utilisés comme signal de ranking, donc il impacte directement votre positionnement. Simplement, cette métrique provient de CrUX, pas du crawler lui-même.

La nuance compte : optimiser l'INP améliore l'expérience utilisateur réelle, ce qui peut indirectement booster le SEO via des signaux comportementaux (taux de rebond, temps sur site, etc.). Mais ne perdez pas de temps à essayer de "tromper" Googlebot avec des interactions — il ne clique jamais, donc il ne mesure rien.

Impact pratique et recommandations

Que faut-il vérifier immédiatement sur son site ?

Testez l'accessibilité de vos liens sans interaction. Ouvrez votre site avec JavaScript désactivé ou dans un outil de rendu headless — tous les liens critiques doivent apparaître dans le HTML initial ou après exécution JS, mais sans nécessiter de clic préalable.

Auditez vos Single Page Applications : chaque route doit correspondre à une URL unique crawlable. Les transitions purement client-side qui modifient le DOM sans toucher à l'URL sont invisibles pour Googlebot. Implémentez le SSR (Server-Side Rendering) ou du pre-rendering si nécessaire.

Quelles erreurs courantes éviter absolument ?

Ne cachez jamais de contenu stratégique derrière des déclencheurs d'événements — onclick, onhover, onscroll infini non détectable. Googlebot extrait les liens présents dans le code, point. Si un lien n'existe pas avant interaction, il n'existe pas pour le crawler.

Arrêtez de compter sur la persistance de session entre pages crawlées. Les cookies ne suivent pas Googlebot d'une URL à l'autre — chaque contexte est vierge. Si votre architecture suppose un état partagé (variable globale JS, localStorage), elle cassera au crawl.

Comment adapter sa stratégie SEO technique ?

- Assurez-vous que tous les liens importants existent dans le HTML rendu sans nécessiter d'interaction

- Implémentez des URLs uniques pour chaque page/état d'application — bannissez les transitions purement JS

- Optimisez l'INP pour les utilisateurs réels (CrUX), pas pour un hypothétique "crawl interactif"

- Testez votre site avec des outils headless (Puppeteer, Playwright) pour simuler le comportement isolé de Googlebot

- Auditez les logs serveur : si des pages liées sont crawlées à des heures différentes, c'est normal — adaptez votre crawl budget

- Vérifiez que le contenu critique se charge sans dépendre d'un état de session ou de cookies persistants

❓ Questions frequentes

Googlebot exécute-t-il le JavaScript même sans cliquer ?

Les métriques INP impactent-elles le SEO si Googlebot ne clique pas ?

Mon site SPA avec routing client-side est-il crawlable correctement ?

Les cookies fonctionnent-ils d'une page crawlée à l'autre ?

Faut-il optimiser les interactions pour améliorer le crawl ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 28/03/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.