Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Les Core Web Vitals sont-ils vraiment un facteur de classement Google ?

- □ Faut-il vraiment passer des mois à optimiser les Core Web Vitals ?

- □ Les Core Web Vitals sont-ils vraiment un facteur de classement SEO ?

- □ Googlebot clique-t-il vraiment sur vos pages comme un utilisateur ?

- □ Une page ultra-rapide mais vide peut-elle ranker grâce aux Core Web Vitals ?

- □ Les Core Web Vitals ont-ils vraiment transformé l'écosystème web comme le prétend Google ?

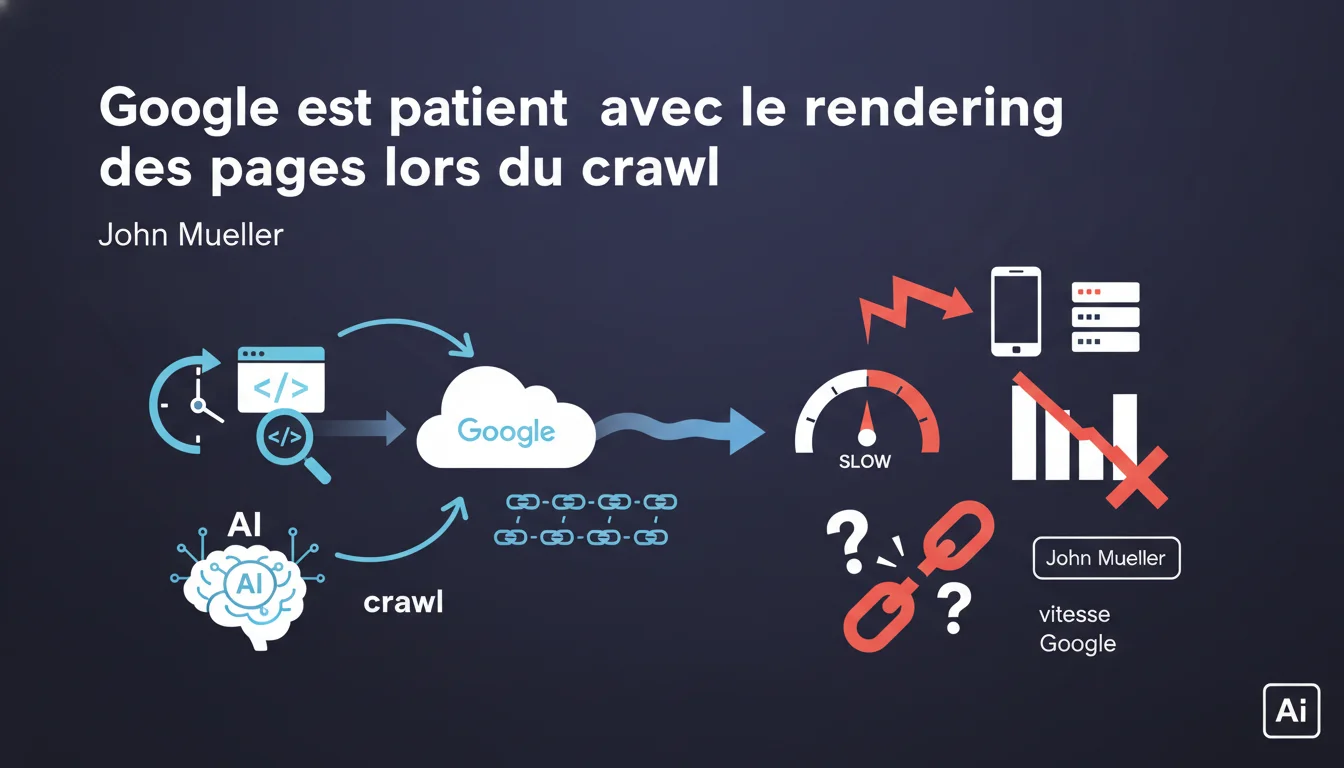

Google affirme être très patient lors du rendering des pages, même si elles sont lentes à charger. La corrélation entre lenteur serveur et visibilité existe, mais Google reconnaît qu'il est difficile d'identifier précisément quel facteur bloque réellement le crawl. Un aveu d'opacité qui complique le diagnostic pour les propriétaires de sites.

Ce qu'il faut comprendre

Que signifie concrètement cette « patience » de Google ?

Quand Google parle de patience lors du rendering, il évoque sa capacité à attendre que le JavaScript s'exécute complètement avant d'indexer le contenu. Contrairement au crawl HTML classique qui est quasi instantané, le rendering nécessite que Googlebot charge les ressources, exécute le JS, puis analyse le DOM final.

Cette étape supplémentaire mobilise des ressources et du temps. Google affirme ne pas sanctionner immédiatement une page lente, mais cette « patience » a des limites — surtout sur des sites avec des milliers de pages. La question du budget de rendering devient alors critique, même si Google ne communique pas de seuil précis.

Pourquoi cette corrélation floue entre vitesse et visibilité ?

Mueller reconnaît qu'une page lente à charger peut entraîner une visibilité retardée dans les SERP. Mais — et c'est là que ça coince — il admet qu'identifier le facteur exact (serveur lent, JS bloquant, waterfall de ressources) reste difficile côté propriétaire de site.

Cette déclaration est révélatrice : Google lui-même ne fournit pas d'outils suffisamment granulaires pour diagnostiquer ces problèmes. La Search Console affiche des erreurs de rendering, mais rarement les causes profondes. Les audits doivent donc être menés manuellement avec des outils tiers.

Quels sont les points essentiels à retenir ?

- Google attend le rendering complet avant d'indexer, mais ce délai a un coût en termes de crawl budget

- Une corrélation existe entre lenteur serveur et visibilité, sans que Google détaille les seuils critiques

- Le diagnostic des problèmes de vitesse reste complexe et peu outillé côté Google

- Le rendering JavaScript consomme plus de ressources que le crawl HTML classique

- Aucune donnée chiffrée fournie sur le niveau de « patience » acceptable

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Sur le principe, oui. On observe effectivement que Google indexe des sites React ou Vue.js entièrement renderisés côté client, preuve qu'il exécute bien le JavaScript. Mais la réalité est plus nuancée : les sites avec un Time to Interactive supérieur à 5-7 secondes montrent souvent des problèmes d'indexation partielle ou retardée.

La « patience » dont parle Mueller n'est pas infinie. Sur des architectures complexes (SPA mal optimisés, infinite scroll non paginé, lazy loading excessif), on constate des contenus non indexés malgré leur présence dans le DOM final. La corrélation floue qu'il évoque cache surtout un manque de transparence sur les timeouts réels appliqués par Googlebot.

Quelles nuances faut-il apporter à cette affirmation ?

Premier point : Mueller parle de « patience » mais ne donne aucun chiffre. [À vérifier] Les tests montrent que Googlebot attend environ 5 secondes pour le rendering initial, mais ce seuil varie selon la priorité de la page (homepage vs page profonde). Les timeouts semblent dynamiques et non documentés.

Deuxième nuance : affirmer qu'il est « difficile de déterminer quel élément cause les problèmes » est un aveu d'impuissance. En réalité, avec un audit technique rigoureux (Lighthouse, WebPageTest, logs serveur analysés), on identifie précisément les goulots. Google pourrait améliorer drastiquement la Search Console sur ce point — mais ne le fait pas.

Dans quels cas cette « patience » ne suffit-elle pas ?

Sur les sites e-commerce avec catalogues de plusieurs dizaines de milliers de références, le budget de rendering devient un vrai problème. Google ne va pas attendre indéfiniment sur chaque fiche produit, surtout si le serveur met 3 secondes à répondre avant même l'exécution du JS.

Autre cas limite : les infinite scroll sans pagination HTML. Google peut charger la page initiale, mais n'exécutera pas forcément le scroll automatique pour découvrir les contenus en lazy loading. La « patience » s'arrête souvent au viewport initial, sauf si vous implémentez des liens de pagination classiques en fallback.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser le rendering ?

D'abord, mesurer le temps réel de rendering avec les bons outils. Utilisez Screaming Frog en mode rendering JavaScript ou Oncrawl pour comparer le contenu HTML brut vs le DOM final. Si l'écart est significatif et que le rendering prend plus de 5 secondes, il y a urgence.

Ensuite, réduisez le poids et le nombre de requêtes JS. Code splitting, tree shaking, lazy loading des modules non critiques — tout ce qui accélère le Time to Interactive améliore aussi la capacité de Google à crawler efficacement. Le SSR (Server-Side Rendering) ou le pré-rendering restent les solutions les plus robustes pour les sites à fort enjeu SEO.

Quelles erreurs éviter absolument ?

Ne vous fiez pas uniquement au rapport « Couverture » de la Search Console. Google peut indexer une URL sans pour autant avoir bien extrait tout le contenu si le rendering a échoué partiellement. Validez manuellement le contenu indexé via un site:exemple.com combiné à une recherche sur un extrait de texte unique.

Autre erreur classique : bloquer des ressources JS/CSS dans le robots.txt en pensant accélérer le crawl. C'est contre-productif — Googlebot a besoin de ces ressources pour le rendering. Si vous avez des soucis de budget de crawl, travaillez plutôt sur la réduction des URLs inutiles (paramètres, doublons) et l'optimisation du maillage interne.

Comment vérifier que votre site est conforme ?

- Testez vos templates clés avec l'outil de test d'optimisation mobile et l'outil d'inspection d'URL dans la Search Console

- Comparez le HTML source (curl) avec le DOM final (Puppeteer/Playwright) pour identifier les écarts

- Mesurez le Time to Interactive avec Lighthouse et visez un TTI < 3,8s sur mobile

- Auditez les logs serveur pour détecter les timeouts ou erreurs 5xx lors des passages de Googlebot-Rendering

- Implémentez du pre-rendering ou SSR pour les contenus critiques (fiches produits, articles de blog)

- Monitorer le taux d'indexation réel (Search Console) vs le nombre d'URLs crawlables (sitemap XML)

- Nettoyez le code JS : éliminez les bibliothèques inutilisées, optimisez les bundles Webpack/Vite

❓ Questions frequentes

Combien de temps Google attend-il réellement lors du rendering d'une page JavaScript ?

Faut-il privilégier le SSR ou le pré-rendering pour optimiser le SEO JavaScript ?

La Search Console indique que ma page est indexée, mais le contenu JS n'apparaît pas dans les résultats. Pourquoi ?

Le lazy loading d'images ou de modules JS impacte-t-il négativement le rendering pour Googlebot ?

Bloquer les fichiers CSS/JS dans le robots.txt améliore-t-il le crawl budget ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 28/03/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.