Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ L'expérience de page suffit-elle vraiment à garantir une bonne UX pour Google ?

- □ Faut-il vraiment penser aux utilisateurs avant les machines en SEO ?

- □ Tirets vs underscores dans les URLs : pourquoi Google préfère-t-il l'un à l'autre ?

- □ Le contenu masqué dans les accordéons pénalise-t-il votre référencement ?

- □ Le contenu caché est-il devenu aussi important que le contenu visible pour Google ?

- □ Googlebot peut-il vraiment indexer du contenu caché derrière des clics utilisateur ?

- □ Pourquoi Google ignore-t-il votre navigation si elle n'utilise pas de vrais liens anchor ?

- □ Les Core Web Vitals suffisent-ils vraiment à mesurer l'expérience utilisateur ?

- □ Les URLs lisibles et cohérentes sont-elles vraiment un critère de ranking ?

- □ L'accessibilité web influence-t-elle directement le classement dans Google ?

- □ Lighthouse rate-t-il vraiment la qualité de vos ancres de liens ?

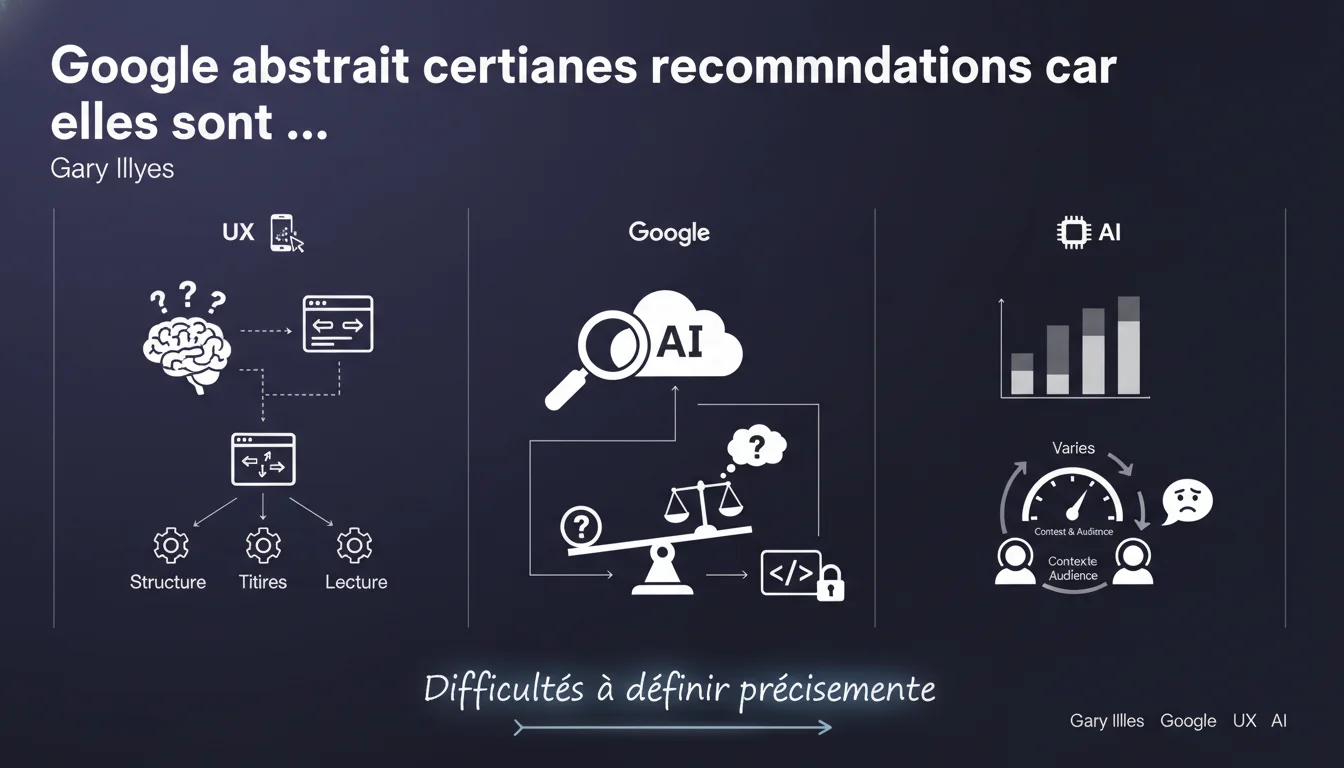

Google assume de rester volontairement flou sur des critères UX comme la navigation, les titres ou le niveau de lecture. Leur argument : ces aspects dépendent trop du contexte et de l'audience pour être standardisés. Une position qui laisse les SEO se débrouiller avec des zones grises — encore une fois.

Ce qu'il faut comprendre

Qu'est-ce que Google entend exactement par "difficile à définir" ?

Gary Illyes justifie l'absence de recommandations précises sur certains éléments d'expérience utilisateur en invoquant la variabilité contextuelle. Une structure de navigation optimale pour un site e-commerce n'a rien à voir avec celle d'un blog technique. Un niveau de lecture adapté à une audience scientifique serait incompréhensible pour le grand public.

Le problème, c'est que cette logique s'applique à presque tout en SEO. Pourquoi alors Google donne-t-il des seuils précis pour les Core Web Vitals mais reste muet sur ce qui constitue une "bonne" hiérarchie de titres ? La frontière entre "trop complexe à définir" et "on préfère garder le contrôle" reste floue.

Quels aspects UX sont concernés par cette abstraction ?

Illyes cite trois exemples : la structure de navigation, les titres (probablement Hn et balises title), et le niveau de lecture. Concrètement, Google ne dira jamais "votre menu doit avoir maximum 7 entrées" ou "visez un niveau de lecture Flesch-Kincaid de 8".

Cette position est cohérente avec l'approche historique de Google : éviter les prescriptions trop rigides qui pourraient être détournées en recettes automatisées. Mais elle force aussi les SEO à naviguer à vue sur des critères pourtant classés comme "importants" par Google lui-même.

Est-ce une nouveauté dans la communication de Google ?

Non, c'est une confirmation explicite d'une pratique établie. Google a toujours alterné entre recommandations chiffrées (temps de chargement, CLS, etc.) et zones grises volontaires (contenu de qualité, expertise, satisfaction utilisateur).

La nuance ici, c'est qu'Illyes assume ouvertement cette stratégie d'abstraction. Il ne prétend pas que les données manquent — il dit que définir un standard serait contre-productif. C'est une position philosophique, pas technique.

- Google reconnaît ne pas pouvoir standardiser certains critères UX sans créer de contre-effets

- Les exemples cités (navigation, titres, lisibilité) sont pourtant des signaux évoqués dans les guidelines qualité

- Cette approche force les SEO à privilégier l'analyse contextuelle plutôt que l'application de règles universelles

- La ligne de séparation entre "critères mesurables" et "critères subjectifs" reste à la discrétion de Google

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui et non. Sur le principe, l'argument tient : un site gouvernemental n'a pas les mêmes contraintes de navigation qu'un média viral. Mais dans la pratique, Google pénalise bien des sites pour des problèmes de structure ou de lisibilité — sans jamais expliquer précisément quel seuil a été franchi.

On observe régulièrement des cas où une refonte de navigation améliore drastiquement les performances organiques, ou à l'inverse où un niveau de lecture inadapté plombe le taux de satisfaction (mesuré indirectement via le comportement utilisateur). Google utilise ces signaux, mais refuse d'en donner les règles du jeu. C'est frustrant mais stratégiquement logique pour eux.

Quelles zones grises cette position entretient-elle volontairement ?

Le vrai enjeu, c'est que Google peut invoquer ces critères "contextuels" pour justifier n'importe quel ajustement algorithmique sans avoir à se justifier. Un site perd du trafic ? Peut-être que sa navigation est devenue "inadaptée". Mais comment le prouver si aucun standard n'existe ?

[À vérifier] : Il serait intéressant de comparer cette déclaration avec les brevets Google sur l'analyse de la structure de site. On sait que des métriques comme la profondeur de clic, la densité de liens internes ou la cohérence sémantique des ancres sont mesurées. Pourquoi ne pas donner au moins des fourchettes acceptables ?

L'hypothèse la plus probable : Google veut décourager l'optimisation mécanique au profit d'une vraie réflexion UX. Mais sans guidelines minimales, les sites avec moins de ressources sont pénalisés face à ceux qui peuvent se payer des tests utilisateurs approfondis.

Dans quels cas cette règle du "contexte avant tout" pourrait-elle ne pas s'appliquer ?

Soyons honnêtes : il existe des anti-patterns universels en navigation et en lisibilité. Un menu avec 50 entrées au même niveau, c'est objectivement mauvais pour tout type de site. Un texte bourré de jargon incompréhensible pour 95% de l'audience cible, c'est un problème identifiable.

Google pourrait très bien définir des seuils d'alerte (ex: "au-delà de X niveaux de profondeur, l'accessibilité devient critique") sans imposer de standard universel. Mais ils ne le font pas — probablement pour garder une marge de manœuvre algorithmique maximale.

Impact pratique et recommandations

Que faut-il faire concrètement en l'absence de recommandations chiffrées ?

Première règle : arrêter de chercher LA bonne pratique universelle. Si Google dit qu'il n'y en a pas, c'est probablement vrai — ou du moins cohérent avec leur approche. La vraie question devient : quelle navigation/quel niveau de lecture/quelle hiérarchie fonctionne pour votre audience ?

Concrètement, ça veut dire investir dans du testing utilisateur réel : heatmaps, enregistrements de sessions, tests A/B sur les structures de navigation. Les outils existent (Hotjar, Microsoft Clarity, etc.) et donnent des données plus fiables que n'importe quelle checklist SEO générique.

Pour le niveau de lecture, utilisez des outils comme Hemingway ou les scores de lisibilité intégrés à Yoast/Rank Math — mais adaptez les seuils à votre audience. Un site médical grand public doit viser Flesch-Kincaid 8-10, un journal scientifique peut monter à 14-16. Le contexte prime.

Quelles erreurs éviter face à cette zone grise ?

Erreur n°1 : appliquer des "best practices" copiées-collées sans réfléchir. Le fait que Zalando ait une navigation à 3 niveaux ne signifie pas que c'est optimal pour votre boutique de niche.

Erreur n°2 : ignorer complètement ces aspects sous prétexte que Google ne donne pas de critères. L'absence de standard ne signifie pas l'absence d'impact — juste que vous devez mesurer vous-même ce qui fonctionne.

Erreur n°3 : sur-optimiser pour un robot au détriment de l'utilisateur réel. Si votre menu est parfait pour les crawlers mais incompréhensible pour vos visiteurs, vous perdez sur les deux tableaux (taux de rebond, temps sur site, conversions — autant de signaux indirects que Google capte).

Comment valider que vos choix UX sont alignés avec les attentes de Google ?

Surveillez les métriques comportementales dans la Search Console : taux de clics, temps passé sur site (visible indirectement via les requêtes de marque et le trafic récurrent), pages par session. Une dégradation de ces métriques après une refonte est un signal d'alerte.

Analysez le crawl budget : si Google abandonne le crawl à mi-parcours de votre arborescence, c'est probablement que votre structure pose problème — même sans critère chiffré officiel.

Testez avec de vrais utilisateurs représentatifs de votre cible. Les études qualitatives (5-10 personnes suffisent pour identifier 80% des problèmes majeurs) sont plus révélatrices que n'importe quelle checklist SEO.

- Auditez votre structure de navigation avec un outil de crawl (Screaming Frog, Oncrawl) pour repérer les profondeurs excessives et les orphelins

- Mesurez le niveau de lecture de vos pages principales avec un outil adapté à votre langue (Flesch-Kincaid, Gunning Fog, etc.)

- Comparez ces scores avec ceux de vos concurrents bien classés — pas pour copier, mais pour identifier les écarts significatifs

- Installez un outil de heatmap/session recording pour observer comment les utilisateurs naviguent réellement

- Menez des tests A/B sur les structures de navigation critiques (menu, filtres, pagination)

- Surveillez les métriques GSC post-modifications pour détecter les impacts positifs ou négatifs

- Documentez vos choix et leurs rationales — face à l'absence de standards, la cohérence interne devient un atout

❓ Questions frequentes

Google ne donne aucun critère chiffré pour la navigation, les titres ou la lisibilité ?

Est-ce que cela signifie que ces éléments n'ont pas d'impact sur le classement ?

Comment savoir si ma structure de navigation est adaptée sans critères de référence ?

Faut-il quand même viser un niveau de lecture spécifique ?

Cette position de Google est-elle cohérente avec leur approche globale du SEO ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/06/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.