Declaration officielle

Ce qu'il faut comprendre

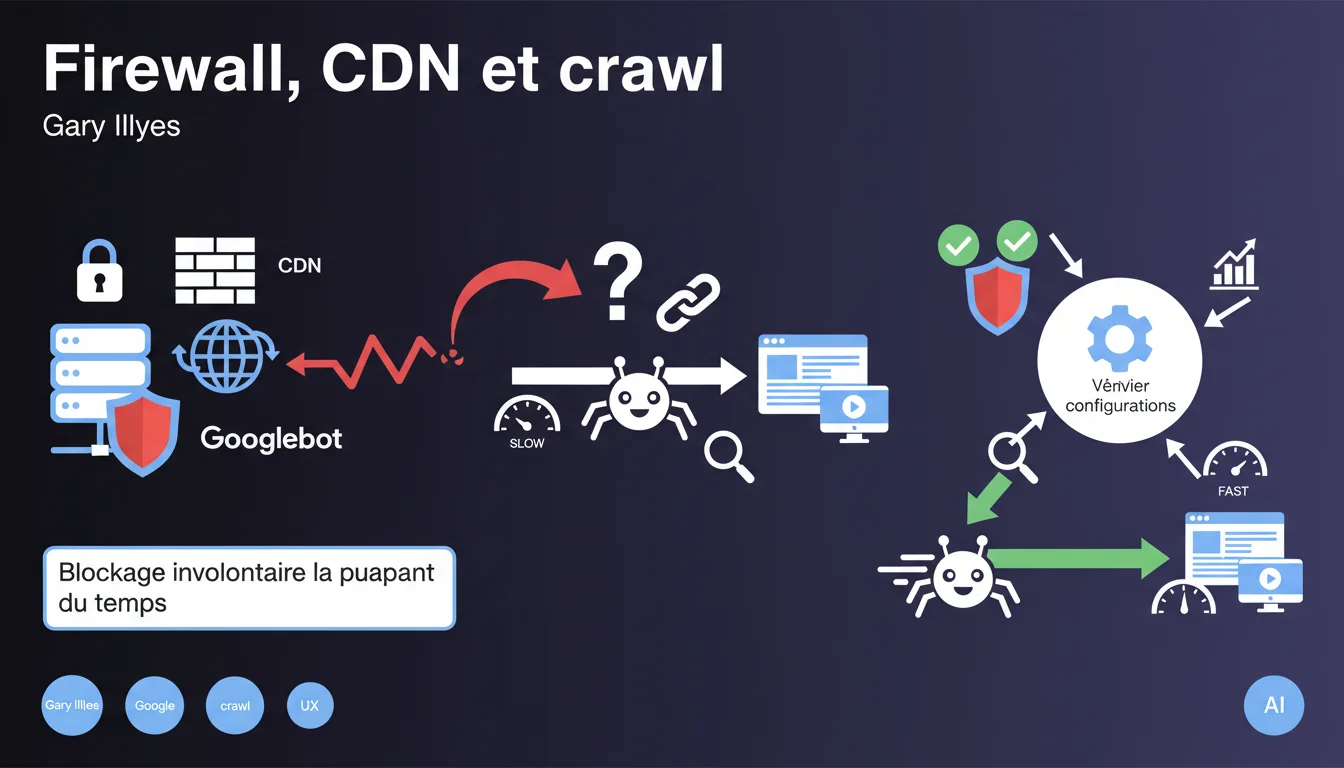

Les infrastructures de sécurité comme les CDN (Content Delivery Networks) et les firewalls sont devenues incontournables pour protéger les sites web modernes. Pourtant, ces mêmes outils peuvent constituer un frein majeur au référencement naturel.

Selon cette déclaration officielle, les mauvaises configurations de CDN et de firewalls représentent les deux obstacles les plus fréquemment rencontrés par Googlebot lors du crawl des sites. Le problème est que ces blocages sont généralement involontaires : les équipes techniques ne réalisent pas qu'elles empêchent le robot de Google d'accéder au contenu.

Cette situation crée un paradoxe pour les praticiens SEO. D'un côté, les mesures de sécurité strictes protègent contre le scraping, les attaques DDoS et le vol de contenu. De l'autre, elles peuvent littéralement rendre un site invisible pour Google si elles ne sont pas correctement paramétrées.

- Les CDN et firewalls mal configurés sont les deux principales barrières techniques au crawl

- Les blocages de Googlebot sont majoritairement involontaires et non détectés par les équipes

- La vérification régulière des règles de filtrage est indispensable pour éviter des pertes de visibilité

- L'équilibre sécurité/accessibilité doit être une priorité dans toute stratégie technique SEO

Avis d'un expert SEO

Cette observation correspond parfaitement à ce que nous constatons sur le terrain lors des audits techniques. Les outils de crawl professionnels se heurtent régulièrement à des configurations de sécurité trop restrictives, et si nos crawlers rencontrent ces obstacles, Googlebot les rencontre également.

Un point particulièrement préoccupant concerne les solutions CDN populaires comme Cloudflare qui disposent de modes de protection anti-bot très agressifs. Lorsque ces modes sont activés au niveau « Under Attack » ou avec des règles WAF (Web Application Firewall) trop strictes, même Googlebot peut être temporairement bloqué ou ralenti, surtout lors de pics de crawl.

Il faut également nuancer selon le contexte : certains sites e-commerce avec des milliers de pages filtrées peuvent volontairement limiter le crawl de certaines sections pour optimiser le budget crawl. Dans ces cas, le blocage est intentionnel et stratégique. La distinction entre blocage intentionnel et accidentel nécessite une analyse approfondie des logs serveur et des données Search Console.

Impact pratique et recommandations

- Auditez immédiatement vos règles CDN et firewall pour identifier les potentiels blocages de Googlebot (user-agent, rate limiting, géolocalisation)

- Whitelistez explicitement les user-agents de Google dans vos règles de sécurité (Googlebot, Googlebot-Image, Googlebot-News, etc.)

- Vérifiez les adresses IP de Googlebot et assurez-vous qu'elles ne sont pas bloquées par vos règles géographiques ou de réputation IP

- Analysez vos logs serveur régulièrement pour détecter les codes d'erreur 403, 429 ou 503 renvoyés à Googlebot

- Configurez des alertes dans Search Console pour être notifié immédiatement en cas d'augmentation des erreurs de crawl

- Testez avec l'outil « Inspection d'URL » de Search Console pour vérifier l'accessibilité réelle de vos pages critiques

- Documentez toutes les règles de sécurité et établissez un processus de validation SEO avant toute modification

- Évitez les challenges JavaScript systématiques qui peuvent retarder ou empêcher le crawl de certaines pages

- Configurez des règles de rate limiting intelligentes qui distinguent Googlebot des scrapers malveillants

- Établissez une communication régulière entre les équipes SEO, DevOps et sécurité pour maintenir l'équilibre optimal

En résumé : La configuration correcte des CDN et firewalls représente un enjeu technique majeur pour le SEO moderne. Les blocages involontaires de Googlebot peuvent passer inaperçus pendant des mois et causer des pertes de trafic significatives.

Ces optimisations techniques requièrent une expertise pointue à la croisée du SEO, de la sécurité informatique et de l'architecture web. La complexité des configurations multi-couches (serveur, CDN, WAF, DDoS protection) rend l'intervention délicate et risquée sans une méthodologie éprouvée.

Pour les sites à enjeux, un accompagnement par une agence SEO spécialisée dans les problématiques techniques peut s'avérer judicieux. Cette expertise permet d'auditer en profondeur les configurations existantes, d'identifier les blocages invisibles et de mettre en place une surveillance continue, tout en préservant le niveau de sécurité indispensable à votre activité.

💬 Commentaires (0)

Soyez le premier à commenter.