Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Pourquoi exporter vos données Search Console peut transformer votre stratégie SEO ?

- □ Comment exploiter pleinement les exports de données dans Search Console ?

- □ Pourquoi Google limite-t-il l'export Search Console à seulement 1000 lignes ?

- □ Comment analyser efficacement les performances SEO de chaque section de votre site ?

- □ Faut-il vraiment piloter son budget SEO par analyse géographique ?

- □ Comment utiliser les métriques Search Console pour identifier vos marchés à fort potentiel ?

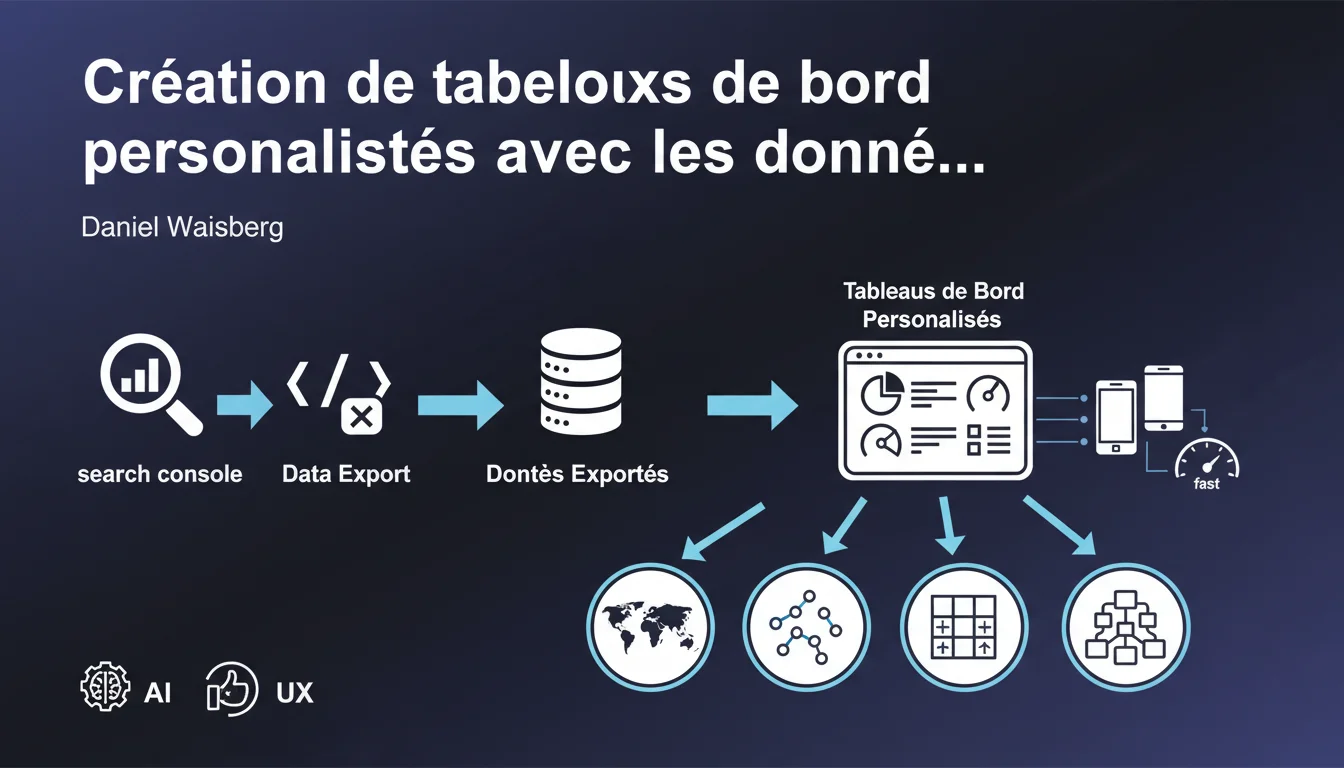

Google confirme que les données exportées de Search Console peuvent alimenter des visualisations non disponibles nativement : cartes géographiques, graphiques en aires, nuages de points, tableaux croisés dynamiques, graphiques en arbre. L'export ouvre des possibilités d'analyse avancée que l'interface standard ne propose pas.

Ce qu'il faut comprendre

Pourquoi Google évoque-t-il explicitement ces formats de visualisation ?

Search Console offre des graphiques standards — courbes temporelles, barres comparatives — mais reste limité dans sa capacité à croiser les dimensions. Google reconnaît ici que l'export des données brutes (via API ou CSV) permet de construire des dashboards personnalisés avec des outils tiers comme Data Studio, Tableau, Power BI ou Python.

La liste donnée — cartes géographiques, graphiques en aires, nuages de points, tableaux croisés dynamiques, graphiques en arbre — n'est pas anodine. Elle cible des cas d'usage analytiques précis : distribution géographique des impressions, corrélations CTR/position, segmentation multidimensionnelle des pages.

Quelles sont les limites de l'interface Search Console native ?

L'interface standard impose des filtres mutuellement exclusifs et ne permet pas de visualiser simultanément plusieurs dimensions complexes. Impossible, par exemple, de générer une heatmap des requêtes par pays et device en un clic.

L'export contourne ces restrictions. Tu récupères les données brutes et tu les structures comme bon te semble — agrégation personnalisée, calculs de métriques dérivées, jointures avec d'autres sources (Analytics, logs serveur, CRM).

Quels outils exploitent concrètement ces exports ?

Les praticiens utilisent majoritairement Google Data Studio (gratuit, connecteur natif API), Tableau ou Power BI pour les grosses structures, et des scripts Python/R pour des analyses statistiques poussées. Certains agrègent même Search Console + Analytics + données de ranking tiers dans un seul dashboard unifié.

- Export API ou CSV : les deux fonctionnent, mais l'API permet l'automatisation et la fraîcheur des données

- Visualisations avancées : cartes géo, scatter plots (CTR vs position), treemaps (répartition du trafic par catégorie)

- Tableaux croisés dynamiques : Excel/Sheets suffisent pour croiser requêtes × pages × pays en quelques clics

- Limites des dashboards natifs : Google confirme implicitement qu'ils ne couvrent pas tous les besoins analytiques

Avis d'un expert SEO

Cette déclaration révèle-t-elle une faiblesse de Search Console ?

Oui, et Google ne s'en cache pas. Si l'export vers des outils tiers est officiellement encouragé, c'est que l'interface native ne suffit pas pour une analyse sérieuse. Les dashboards Search Console restent orientés « monitoring basique », pas « investigation approfondie ».

Concrètement ? Tu ne peux pas croiser facilement « requêtes de longue traîne + CTR < 2 % + position 5-10 + mobile + France » sans exporter les données. C'est un aveu : l'outil interne reste volontairement bridé.

Les visualisations citées sont-elles vraiment utiles en SEO ?

Ça dépend de ton niveau d'analyse. Un nuage de points CTR/position permet d'identifier les requêtes sous-performantes (position 3 mais CTR de position 8). Un treemap révèle quelles catégories de pages génèrent 80 % du trafic. Une carte géographique montre les zones où ton site perd en visibilité.

Mais soyons honnêtes : beaucoup de SEO se contentent de l'interface native et s'en sortent très bien. Ces visualisations avancées deviennent indispensables sur des sites à forte volumétrie (e-commerce > 10K produits, médias nationaux, plateformes SaaS multilingues). En dessous, c'est du nice-to-have.

Google pousse-t-il vers Data Studio pour verrouiller l'écosystème ?

Data Studio (renommé Looker Studio) bénéficie d'un connecteur API Search Console natif, ce qui simplifie drastiquement l'intégration. Coïncidence ? Peu probable. Google facilite l'adoption de son propre outil BI tout en restant ouvert aux solutions tierces.

Le risque : devenir dépendant d'un écosystème Google end-to-end (Search Console → Looker Studio → BigQuery). Rien d'interdit, mais ça mérite réflexion si tu valorises l'indépendance technologique. [A vérifier] : aucune donnée officielle sur le taux d'adoption de Looker Studio vs Tableau chez les SEO.

Impact pratique et recommandations

Que faut-il faire concrètement pour exploiter ces exports ?

Première étape : identifier tes besoins analytiques non couverts par l'interface native. Si tu te retrouves régulièrement à copier-coller des données Search Console dans Excel pour faire des calculs, c'est un signal clair.

Ensuite, choisis ton outil. Pour débuter : Looker Studio (gratuit, courbe d'apprentissage douce). Pour des analyses statistiques : Python + pandas + matplotlib. Pour des dashboards corporate : Tableau ou Power BI. L'API Search Console est documentée, les connecteurs existent pour tous ces outils.

Quelles visualisations prioriser selon ton contexte ?

Si tu gères un site e-commerce international : carte géographique pour comparer la visibilité par pays, treemap pour identifier les catégories de produits sous-performantes. Si tu pilotes un média national : graphiques en aires pour suivre l'évolution du trafic par rubrique, scatter plots pour détecter les articles à fort potentiel (position moyenne correcte, CTR faible).

Pour un site vitrine local : l'interface Search Console suffit probablement. Ne sur-complexifie pas pour le plaisir — les dashboards custom ont un coût de maintenance non négligeable.

Quelles erreurs éviter lors de la mise en place ?

Erreur classique : agréger des données incompatibles. Search Console anonymise les requêtes à faible volume — si tu croises trop de dimensions, tu obtiens des trous dans tes données. Respecte les seuils de confidentialité, sinon tes visualisations seront biaisées.

Autre piège : ne pas automatiser les rafraîchissements. Un dashboard qui affiche des données vieilles de trois semaines ne sert à rien. Configure des ETL (Extract-Transform-Load) via API ou via les connecteurs natifs pour garantir la fraîcheur.

- Auditer les limites analytiques de l'interface Search Console native pour ton site

- Choisir un outil de visualisation adapté à ton niveau technique et ton budget

- Configurer l'export API (ou CSV si volume faible) avec authentification OAuth

- Tester les visualisations citées par Google (carte géo, scatter plot, treemap) sur un échantillon

- Automatiser le rafraîchissement des données pour éviter les dashboards obsolètes

- Documenter les calculs de métriques dérivées (CTR moyen pondéré, taux de cannibalisation, etc.)

- Former les équipes à l'interprétation des nouvelles visualisations

❓ Questions frequentes

Faut-il utiliser l'API ou l'export CSV pour alimenter un dashboard personnalisé ?

Quels outils de visualisation sont compatibles avec les données Search Console ?

Les visualisations avancées révèlent-elles des insights impossibles à détecter autrement ?

Y a-t-il des limites aux données exportées de Search Console ?

Un dashboard personnalisé remplace-t-il totalement l'interface Search Console ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 28/02/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.