Declaration officielle

Ce qu'il faut comprendre

Quelle est la position de Google sur le contenu dupliqué interne ?

Google ne pénalise pas automatiquement le contenu dupliqué interne, mais il gaspille votre budget crawl et dilue votre autorité. Selon les déclarations officielles, le moteur de recherche privilégie l'efficacité du crawl.

La recommandation est claire : les corrections ponctuelles n'ont qu'un impact marginal. Seules les actions à grande échelle produisent des résultats mesurables en termes de performances SEO.

Pourquoi le volume de duplication est-il plus important que la perfection ?

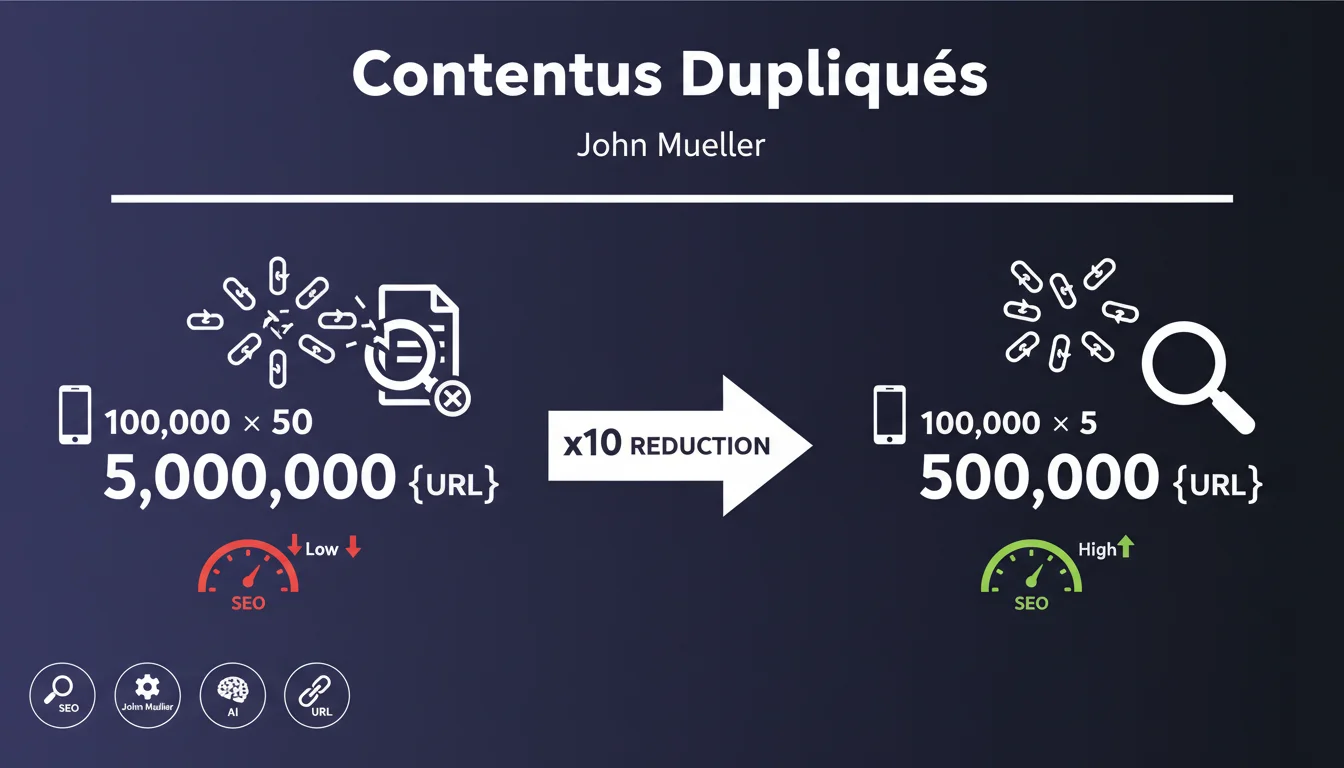

L'exemple donné illustre un principe fondamental : passer de 5 millions d'URL à 500 000 URL représente une amélioration significative du ratio signal/bruit. Google peut ainsi concentrer son crawl sur vos pages à forte valeur ajoutée.

En revanche, corriger 50 pages dupliquées sur un site de 100 000 pages n'aura aucun effet perceptible. Le changement doit être substantiel pour impacter l'indexation et le classement.

Quel est le seuil minimal pour qu'une action anti-duplication soit efficace ?

L'indicateur clé est une réduction d'au moins 90% du volume de pages dupliquées. C'est ce facteur 10 mentionné qui permet de franchir le seuil de rentabilité SEO.

- Prioriser les duplications massives plutôt que les cas isolés

- Viser une réduction drastique du nombre total d'URL indexables

- Concentrer le budget crawl sur les pages stratégiques

- Mesurer l'impact en termes de ratio pages/produits

Avis d'un expert SEO

Cette approche du « tout ou rien » est-elle vraiment adaptée à tous les sites ?

Cette recommandation s'applique parfaitement aux sites e-commerce de grande envergure avec des milliers de produits. Dans ce contexte, la duplication provient souvent des facettes de navigation, filtres et variantes.

Pour les sites plus modestes (moins de 10 000 pages), même des corrections partielles peuvent produire des résultats tangibles. L'échelle change tout : sur un site de 500 pages, éliminer 100 duplications représente 20% d'amélioration.

Quelles sont les exceptions qui méritent une attention immédiate ?

Certaines duplications doivent être corrigées immédiatement, quel que soit leur volume. Les pages dupliquées qui cannibalisent vos mots-clés stratégiques affectent directement votre visibilité sur les requêtes prioritaires.

De même, les duplications entre domaines (www/non-www, http/https, versions mobiles séparées) nécessitent une action urgente car elles fragmentent votre autorité.

Comment identifier si votre problème de duplication justifie une action prioritaire ?

Calculez votre ratio pages indexées/pages de qualité. Si Google indexe 50 000 pages alors que vous n'en avez que 5 000 de réellement uniques, vous avez un problème majeur qui mérite une action d'envergure.

Analysez également votre taux de crawl gaspillé dans la Search Console. Si plus de 50% des URLs crawlées sont des duplications ou variantes, vous franchissez le seuil critique évoqué par Google.

Impact pratique et recommandations

Comment prioriser efficacement ses actions anti-duplication ?

Commencez par un audit exhaustif pour cartographier les sources de duplication : paramètres d'URL, pagination, filtres, sessions, variantes produits. Identifiez les générateurs massifs de pages.

Utilisez la Search Console pour extraire toutes les URLs indexées et comparez avec votre sitemap idéal. L'écart vous indique l'ampleur du problème et si vous atteignez le facteur 10 nécessaire.

- Auditer les URLs indexées via Search Console et logs serveurs

- Identifier les patterns de duplication à grande échelle (facettes, filtres, paramètres)

- Calculer le ratio actuel : URLs totales / URLs légitimes

- Évaluer si une action massive peut atteindre le facteur 10 de réduction

- Implémenter des canonicals cohérents sur tous les patterns identifiés

- Utiliser robots.txt et meta noindex pour les URLs sans valeur SEO

- Configurer les paramètres d'URL dans Search Console si applicable

- Monitorer l'évolution du crawl budget et de l'indexation post-intervention

Quelles erreurs éviter lors de la déduplication à grande échelle ?

La plus grande erreur est de bloquer trop brutalement des milliers d'URLs sans phase de test. Commencez par un échantillon représentatif et vérifiez l'impact sur 2-3 semaines avant de généraliser.

Évitez également les canonicals en chaîne ou circulaires qui annulent leur effet. Chaque URL dupliquée doit pointer directement vers la version canonique, sans intermédiaire.

Que faire si votre site ne justifie pas une action massive ?

Pour les sites sous le seuil critique, concentrez-vous sur la prévention plutôt que la correction. Établissez des règles strictes de publication pour éviter de créer de nouvelles duplications.

Traitez en priorité les duplications qui affectent vos landing pages stratégiques, même en petit nombre. L'impact sur vos conversions justifie l'effort, indépendamment du volume global.

La gestion du contenu dupliqué nécessite une approche stratégique et proportionnée. Pour les sites de grande envergure, seules les actions massives (facteur 10) produisent des résultats SEO mesurables. Pour les sites plus modestes, privilégiez la prévention et concentrez-vous sur les duplications qui impactent vos pages prioritaires.

Ces optimisations techniques à grande échelle requièrent une expertise pointue et des outils spécialisés pour éviter les erreurs coûteuses. Face à la complexité de ces interventions, particulièrement sur les plateformes e-commerce avec des dizaines de milliers d'URLs, l'accompagnement par une agence SEO expérimentée permet de sécuriser la démarche et d'obtenir des résultats durables sans risquer de dégrader votre visibilité existante.

💬 Commentaires (0)

Soyez le premier à commenter.