Declaration officielle

Ce qu'il faut comprendre

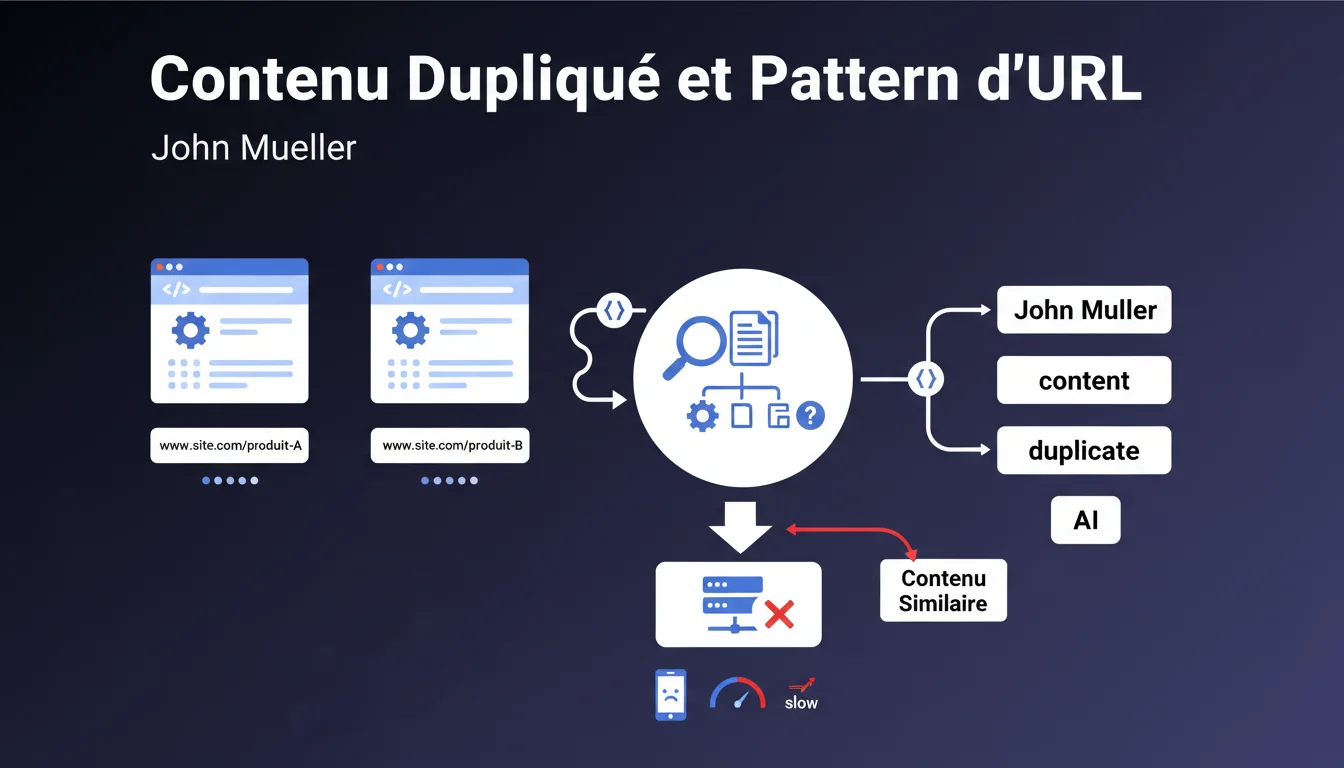

Comment Google détecte-t-il le contenu dupliqué via les URL ?

Google utilise une approche prédictive basée sur l'analyse des patterns d'URL pour identifier potentiellement du contenu dupliqué. Le moteur examine la structure des adresses web et cherche des schémas récurrents.

Lorsque deux pages présentent à la fois des URL structurellement proches et du contenu similaire, l'algorithme peut extrapoler cette observation. Il risque alors de catégoriser l'ensemble des pages suivant ce pattern comme du duplicate content, même si leurs contenus diffèrent réellement.

Pourquoi cette méthode pose-t-elle problème aux SEO ?

Cette détection par patterns crée un risque de faux positifs. Des pages légitimement différentes peuvent être considérées comme dupliquées uniquement à cause de leur structure d'URL similaire.

Le problème devient critique quand vous gérez des sites multi-localisations ou des catalogues produits avec des variations. Une architecture d'URL logique et cohérente peut paradoxalement devenir un handicap.

Quels sont les cas typiques concernés par ce phénomène ?

Les sites locaux avec déclinaisons par ville sont les premiers concernés. Par exemple : /plombier-paris, /plombier-lyon, /plombier-marseille avec des contenus quasi-identiques.

Les fiches produits avec variantes (couleurs, tailles) ou les pages de services déclinées géographiquement sont également vulnérables à cette détection algorithmique.

- Google analyse les patterns structurels des URL pour détecter le duplicate content

- Des URL trop similaires + contenus proches = risque de classification erronée de toutes les pages du même pattern

- Cette méthode prédictive peut générer des faux positifs pénalisants

- Les sites multi-localisations et catalogues produits sont particulièrement exposés

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Cette affirmation de John Mueller correspond parfaitement aux problématiques récurrentes observées sur les sites multi-villes ou franchises. De nombreux sites locaux voient leurs pages géolocalisées désindexées ou cannibalisées malgré des efforts de différenciation.

Les outils d'analyse comme Search Console montrent régulièrement des pages marquées comme "Exclue : Page dupliquée" alors que le webmaster a tenté de personnaliser le contenu. Le pattern d'URL reste le signal déclencheur principal pour l'algorithme.

Quelles nuances faut-il apporter à cette règle ?

La qualité et l'unicité réelle du contenu restent déterminantes. Si vos pages locales proposent vraiment du contenu différencié (témoignages locaux, références spécifiques, informations géographiques uniques), Google finira généralement par les distinguer.

Le problème survient principalement quand on combine URL similaires + contenu templété faiblement différencié. Un seul de ces facteurs est gérable, les deux ensemble créent un signal trop fort de duplication.

Dans quels contextes cette problématique est-elle surestimée ?

Pour les très grandes marques ou sites avec une forte autorité de domaine, Google semble plus tolérant. L'algorithme accorde davantage de crédit à ces acteurs établis et analyse plus finement leurs contenus.

Les sites proposant des contenus réellement uniques et longs (plus de 800-1000 mots par page) avec des variations substantielles échappent généralement à cette catégorisation automatique, même avec des URL similaires.

Impact pratique et recommandations

Que faut-il faire concrètement pour éviter ce piège ?

Privilégiez une architecture d'URL diversifiée pour vos pages similaires. Évitez les structures trop prévisibles comme /service-ville-1, /service-ville-2, etc. Variez les niveaux de profondeur et les dénominations.

Investissez massivement dans la différenciation réelle du contenu. Chaque page géolocalisée doit contenir des éléments véritablement uniques : témoignages clients locaux, données statistiques régionales, photos spécifiques, actualités locales.

Utilisez les balises canonical de manière stratégique pour indiquer explicitement à Google quelle version privilégier. Pour les pages réellement différentes, assurez-vous qu'elles pointent vers elles-mêmes.

Quelles erreurs absolument éviter dans cette situation ?

Ne créez jamais de pages géolocalisées automatiquement en changeant simplement le nom de ville dans un template. C'est la recette parfaite pour déclencher cette détection par pattern.

Évitez de multiplier les pages similaires sans justification search volume réelle. Si une ville génère 10 recherches/mois, la page dédiée risque plus de nuire qu'aider à cause du signal de duplication.

N'utilisez pas de techniques de cloaking ou texte caché pour tenter de différencier artificiellement vos contenus. Google détecte ces manipulations et la sanction sera bien plus sévère.

Comment auditer et corriger un site déjà impacté ?

Analysez dans Google Search Console les pages marquées comme exclues pour duplication. Identifiez les patterns d'URL communs à ces pages pour comprendre ce que Google a détecté.

Effectuez un test de différenciation : comparez le contenu de vos pages similaires avec des outils de comparaison textuelle. Si la similarité dépasse 70-80%, vous êtes en zone dangereuse.

Priorisez vos corrections : conservez uniquement les pages géolocalisées à fort potentiel (volume de recherche, conversion) et consolidez ou supprimez les autres. Redirigez les pages supprimées vers une page locale générique.

- Diversifier consciemment les structures d'URL pour éviter les patterns trop évidents

- Créer du contenu réellement unique pour chaque page géolocalisée (minimum 40-50% de différence)

- Implémenter correctement les balises canonical pour guider Google

- Auditer régulièrement la Search Console pour détecter les exclusions pour duplication

- Éviter la multiplication de pages similaires sans justification de volume de recherche

- Supprimer ou fusionner les pages à faible valeur ajoutée créant du bruit algorithmique

- Enrichir chaque page locale avec des éléments spécifiques : avis, photos, données régionales

- Varier les niveaux de profondeur et structures d'URL plutôt que suivre un modèle unique

💬 Commentaires (0)

Soyez le premier à commenter.