Declaration officielle

Ce qu'il faut comprendre

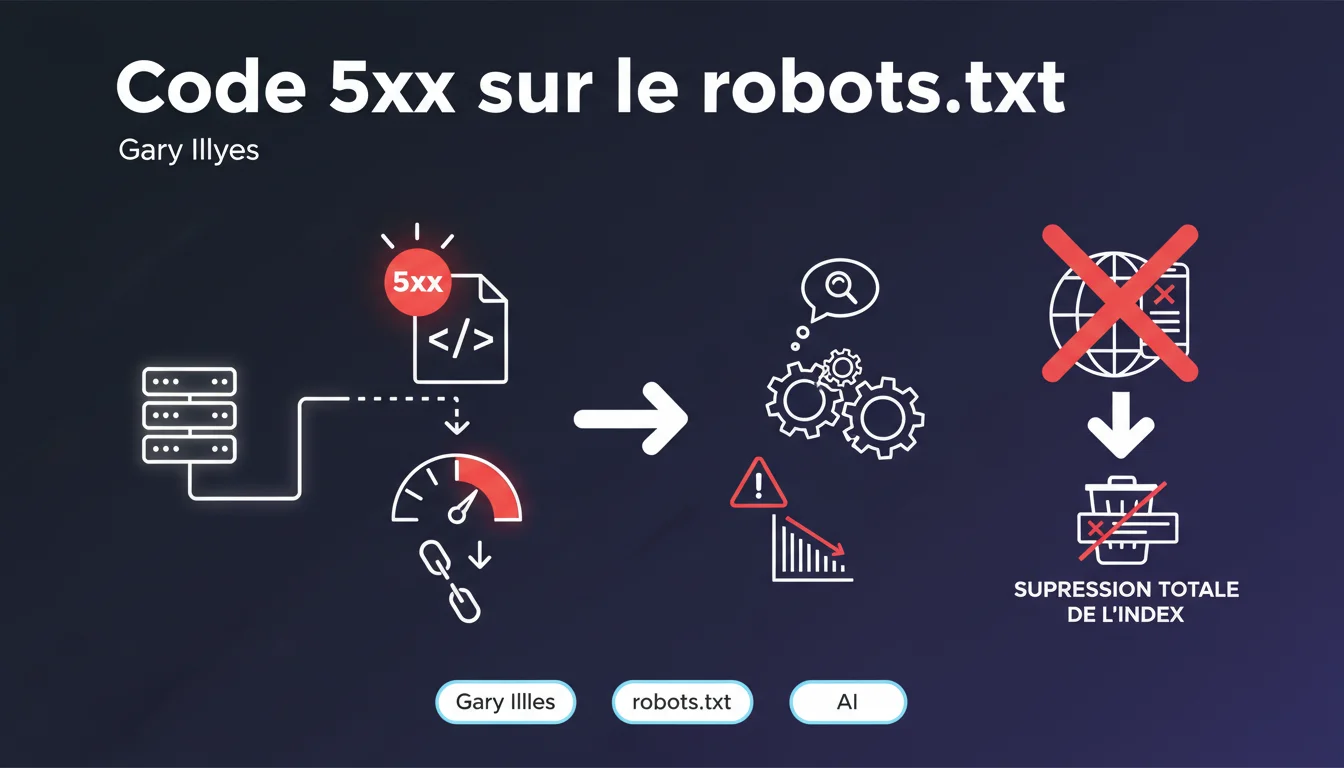

Qu'est-ce qu'un code d'erreur 5xx et pourquoi concerne-t-il le robots.txt ?

Un code d'erreur 5xx indique un problème côté serveur : il ne peut pas traiter la requête du robot d'exploration. Les codes les plus courants sont le 500 (erreur interne du serveur) et le 503 (service temporairement indisponible).

Lorsque Googlebot tente d'accéder à votre fichier robots.txt et reçoit une erreur 5xx, il se retrouve dans une situation délicate. Il ne sait pas s'il a le droit ou non d'explorer votre site, car le fichier qui contient ces instructions est inaccessible.

Pourquoi Google supprimerait-il un site complet de l'index pour ce problème ?

La logique de Google repose sur un principe de précaution. Si le robots.txt est inaccessible de manière prolongée, Google suppose qu'il pourrait contenir des directives interdisant l'exploration du site.

Plutôt que de risquer d'explorer des contenus potentiellement interdits, Google choisit progressivement de désindexer l'ensemble du site. Cette décision est prise après plusieurs tentatives infructueuses sur une période prolongée, généralement plusieurs jours.

Quelle est la différence avec un code 404 sur le robots.txt ?

Un code 404 (non trouvé) signifie clairement qu'aucun fichier robots.txt n'existe. Dans ce cas, Google considère que toutes les pages peuvent être explorées librement, ce qui est la configuration par défaut.

À l'inverse, un code 5xx est ambigu : le fichier existe peut-être, mais il est temporairement inaccessible. Cette incertitude pousse Google à adopter une approche conservatrice qui peut aboutir à la désindexation.

- Code 200 : fichier robots.txt accessible et lu normalement (situation idéale)

- Code 404 : pas de robots.txt, toutes les pages sont explorables (acceptable)

- Code 5xx : erreur serveur, risque de désindexation progressive (critique)

- La durée d'exposition au problème est déterminante dans la décision de Google

- Un code 5xx ponctuel ne causera généralement pas de problème immédiat

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, cette information correspond parfaitement aux cas observés en situation réelle. De nombreux sites ont effectivement été désindexés suite à des problèmes serveur prolongés affectant le robots.txt, notamment lors de migrations mal préparées ou de pannes d'hébergement.

Ce qui est particulièrement notable, c'est la rapidité de la désindexation une fois le processus enclenché. Contrairement à ce que beaucoup imaginent, Google ne patiente pas indéfiniment. Après 3 à 7 jours d'erreurs 5xx persistantes, les premiers signes de désindexation apparaissent généralement.

Quels sont les cas particuliers où ce problème se manifeste ?

Les migrations de sites représentent le scénario le plus risqué. Lors d'un changement d'hébergeur ou d'infrastructure, des configurations incorrectes peuvent générer des erreurs 5xx temporaires qui passent inaperçues jusqu'à ce qu'il soit trop tard.

Les mises à jour de serveur ou de CMS constituent également un moment critique. Un plugin de sécurité mal configuré ou une modification des règles du serveur web peuvent bloquer l'accès au robots.txt spécifiquement pour les bots.

Existe-t-il des situations où l'impact serait moins sévère ?

Pour les sites très établis avec une forte autorité, Google peut faire preuve d'un peu plus de patience. Un site comme Wikipédia ou un grand média bénéficiera probablement de quelques jours supplémentaires avant désindexation complète.

Cependant, même pour ces sites, le risque reste majeur et le délai de grâce limité. Il ne faut jamais compter sur son autorité pour négliger la surveillance technique du robots.txt. La différence se compte en jours, pas en semaines.

Impact pratique et recommandations

Comment vérifier que votre robots.txt fonctionne correctement ?

La première étape consiste à tester manuellement l'accès à votre fichier en visitant votredomaine.com/robots.txt dans un navigateur. Vous devez voir le contenu du fichier s'afficher avec un code de réponse HTTP 200.

Utilisez ensuite l'outil de test du robots.txt dans Google Search Console. Cet outil vous permet de voir exactement comment Googlebot interprète votre fichier et signale immédiatement les erreurs d'accès ou de syntaxe.

Pour un monitoring continu, configurez des alertes avec des outils comme Uptime Robot, Pingdom ou StatusCake qui vérifient spécifiquement l'URL de votre robots.txt toutes les quelques minutes et vous préviennent en cas d'erreur.

Quelles actions correctives mettre en place immédiatement ?

Si vous détectez des erreurs 5xx sur votre robots.txt, la priorité absolue est de résoudre le problème serveur sous-jacent : vérifiez les logs d'erreur, les permissions de fichiers, et la configuration du serveur web.

En attendant la résolution, certains préfèrent temporairement supprimer le fichier robots.txt pour qu'il retourne un 404 plutôt qu'un 5xx. C'est une solution d'urgence qui permet à Google de continuer l'exploration, mais elle doit rester exceptionnelle.

Une fois le problème résolu, utilisez la fonction "Demander une exploration" dans Search Console pour accélérer la reconnaissance du retour à la normale par Google. Surveillez ensuite attentivement votre indexation pendant les jours suivants.

Quelle stratégie préventive adopter sur le long terme ?

- Mettez en place une surveillance automatisée 24/7 de l'accessibilité de votre robots.txt avec alertes email/SMS

- Documentez la configuration de votre robots.txt dans votre procédure de déploiement et vérifiez-la systématiquement après chaque mise à jour

- Configurez correctement vos CDN, WAF et systèmes de sécurité pour autoriser explicitement les user-agents des moteurs de recherche

- Testez votre robots.txt avec plusieurs outils différents (Search Console, Screaming Frog, outils en ligne) pour une validation croisée

- Prévoyez un plan de secours : sachez comment désactiver rapidement votre robots.txt en cas d'urgence

- Intégrez la vérification du robots.txt dans vos processus de migration et de maintenance planifiée

- Effectuez des audits techniques trimestriels incluant spécifiquement la vérification des codes HTTP de tous les fichiers critiques

💬 Commentaires (0)

Soyez le premier à commenter.