Declaration officielle

Autres déclarations de cette vidéo 5 ▾

- □ Google propose-t-il enfin une formation SEO avancée à la hauteur des attentes des praticiens ?

- □ Les Deep Dive SEO de Google vont-ils enfin remplacer les conférences superficielles ?

- □ Faut-il privilégier les experts SEO locaux plutôt que les déclarations officielles de Google ?

- □ Comment Google utilise-t-il vraiment vos retours pour concevoir ses événements SEO ?

- □ Search Central Live débarque en Afrique : pourquoi cette expansion géographique change-t-elle la donne pour les SEO locaux ?

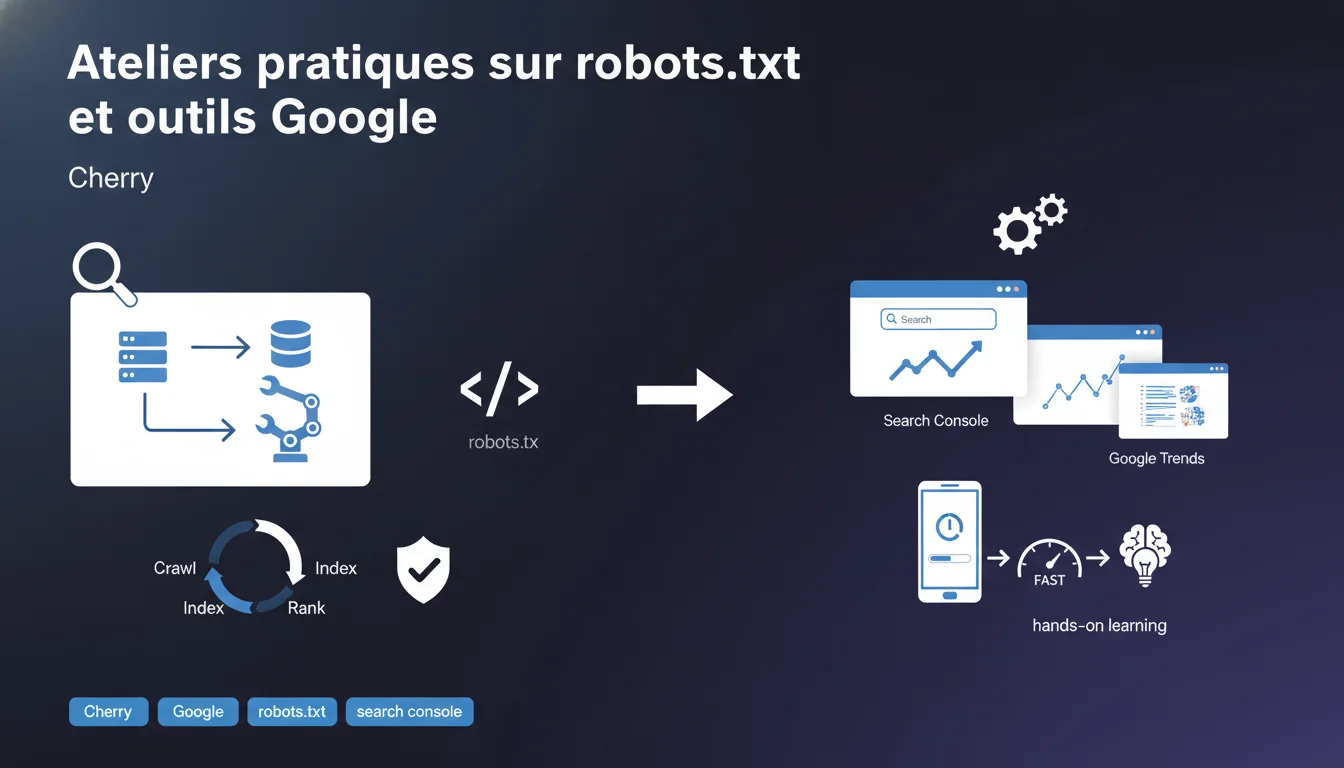

Google lance des ateliers Deep Dive axés sur la pratique : Search Console, Google Trends, robots.txt. L'objectif affiché est de remplacer les présentations théoriques par des sessions hands-on. Une approche qui pourrait enfin combler le fossé entre les déclarations officielles et la réalité terrain.

Ce qu'il faut comprendre

Qu'est-ce que ces ateliers Deep Dive changent par rapport aux formats classiques ?

Google multiplie les canaux de communication depuis des années — blogs, vidéos, webinars — mais la critique récurrente reste la même : trop de théorie, pas assez de concret. Les ateliers Deep Dive promettent une rupture : des sessions pratiques où les participants manipulent directement les outils (Search Console, Google Trends) et traitent des sujets techniques (robots.txt) en situation réelle.

L'idée est simple : apprendre en faisant. Au lieu d'écouter passivement un speaker répéter des guidelines déjà disponibles en ligne, les participants sont censés bosser sur des cas concrets, poser des questions au fil de l'eau, et repartir avec des compétences actionnables.

Pourquoi Google pousse-t-il ce format maintenant ?

Deux raisons probables. D'abord, la complexité croissante de l'écosystème Search : entre Core Web Vitals, structured data, indexation sélective et signaux E-E-A-T, les propriétaires de sites sont perdus. Les contenus théoriques ne suffisent plus — il faut monter en compétence sur les outils.

Ensuite, Google a tout intérêt à ce que davantage de sites utilisent correctement Search Console et optimisent leur crawl via robots.txt. Moins de tickets support, moins de sites mal configurés qui polluent l'index. Former directement les praticiens, c'est investir dans la qualité globale du web crawlable.

Quels sujets sont couverts par ces ateliers ?

Trois axes annoncés :

- Search Console — probablement analyse de performance, diagnostic des erreurs d'indexation, utilisation avancée des rapports (couverture, expérience, Core Web Vitals)

- Google Trends — exploitation des données de recherche pour comprendre les tendances, affiner le ciblage sémantique, détecter la saisonnalité

- robots.txt et sujets techniques — configuration du fichier, gestion du crawl budget, diagnostic des blocages involontaires, impact sur l'indexation

Avis d'un expert SEO

Cette initiative est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui et non. Google a toujours encouragé l'utilisation de Search Console, mais force est de constater que beaucoup de sites sous-exploitent l'outil — faute de formation. Un atelier pratique peut combler ce gap, surtout si les formateurs vont au-delà du superficiel.

En revanche, sur robots.txt, l'historique de Google est ambigu. Pendant des années, les recommandations officielles ont varié : ne bloquez pas les ressources, puis autorisez le JavaScript, puis laissez crawler les CSS… Les praticiens ont dû ajuster leurs configurations au gré des changements. Si l'atelier se contente de répéter les guidelines actuelles sans aborder les nuances terrain (crawl budget réel, impact des directives Allow vs priorité du Disallow, comportement sur les sites à fort volume), ça restera du vernis théorique habillé en pratique.

Quelles sont les limites probables de ce format ?

Le principal risque : que ces ateliers restent calibrés pour un public généraliste, avec des cas d'usage simplifiés. Un praticien SEO aguerri n'a pas besoin qu'on lui explique comment connecter un site à Search Console — il veut savoir comment interpréter un effondrement brutal de pages indexées, ou pourquoi certaines URLs en noindex apparaissent encore dans les rapports.

[À vérifier] : la profondeur technique réelle des sessions. Si les animateurs sont des Product Managers qui ne font pas de SEO au quotidien, le format risque de décevoir. Si ce sont des ingénieurs crawl ou des spécialistes internes qui traitent des edge cases, là ça devient intéressant.

Dans quels cas ce type d'atelier ne suffit-il pas ?

Pour tout site avec des enjeux complexes : architecture multilingue, gestion de facettes dynamiques, migration technique, refonte de site sous forte pression SEO. Ces situations nécessitent une expertise sur-mesure, pas un atelier standardisé.

De même, si votre site subit des pénalités algorithmiques, des problèmes d'indexation chroniques ou une érosion de trafic inexpliquée, un atelier généraliste ne résoudra rien. Il faut un audit technique approfondi, mené par quelqu'un qui connaît votre secteur et votre CMS.

Impact pratique et recommandations

Que faut-il faire concrètement si on participe à ces ateliers ?

Préparez-vous en amont. Identifiez les points bloquants spécifiques à votre site : pages non indexées malgré un sitemap propre, sections bloquées par erreur dans robots.txt, rapports Search Console que vous ne savez pas interpréter. Notez vos questions précises.

Pendant l'atelier, ne vous contentez pas de suivre les exercices. Posez des questions sur vos cas réels. Si l'animateur esquive ou reste vague, insistez — ou au minimum, notez le sujet pour creuser ensuite avec un expert.

Quelles erreurs éviter après avoir suivi un atelier Deep Dive ?

Erreur n°1 : appliquer aveuglément une recommandation générique sans la contextualiser à votre site. Robots.txt est un levier puissant — mal configuré, il peut désindexer des sections entières. Testez toujours dans un environnement de staging avant de déployer en prod.

Erreur n°2 : croire qu'un atelier de quelques heures fait de vous un expert. Search Console et robots.txt sont des outils avec des ramifications complexes. Ce que vous apprenez est une base — la maîtrise vient avec la pratique répétée, l'analyse de cas réels, les erreurs (et leur correction).

- Lister vos questions spécifiques avant l'atelier

- Tester toute modification de robots.txt en staging avant production

- Vérifier l'impact dans Search Console sous 7-14 jours après toute modif

- Documenter vos configurations et changements (versioning, commentaires dans le fichier)

- Croiser les données Search Console avec vos logs serveur pour validation

- Ne jamais bloquer par erreur des sections stratégiques (produits, catégories, blog)

Comment s'assurer que votre site tire vraiment parti de ces optimisations ?

Mettez en place un suivi régulier : rapports Search Console hebdomadaires, monitoring des pages indexées, alertes sur les erreurs critiques. Comparez avant/après chaque ajustement technique. Si vous ne voyez pas d'amélioration mesurable sous 30 jours, c'est soit que la modif n'était pas nécessaire, soit qu'elle a été mal appliquée.

❓ Questions frequentes

Les ateliers Deep Dive sont-ils accessibles à tous les professionnels SEO ?

Un atelier robots.txt peut-il vraiment aider sur des sites complexes ?

Google Trends est-il vraiment utile pour le SEO au quotidien ?

Faut-il obligatoirement maîtriser Search Console pour faire du SEO efficace ?

Ces ateliers vont-ils remplacer les Google Webmaster Hangouts ou les Search Central Office Hours ?

🎥 De la même vidéo 5

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/05/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.