Declaration officielle

Ce qu'il faut comprendre

Pourquoi cette confusion autour de Penguin 4.0 et le machine learning ?

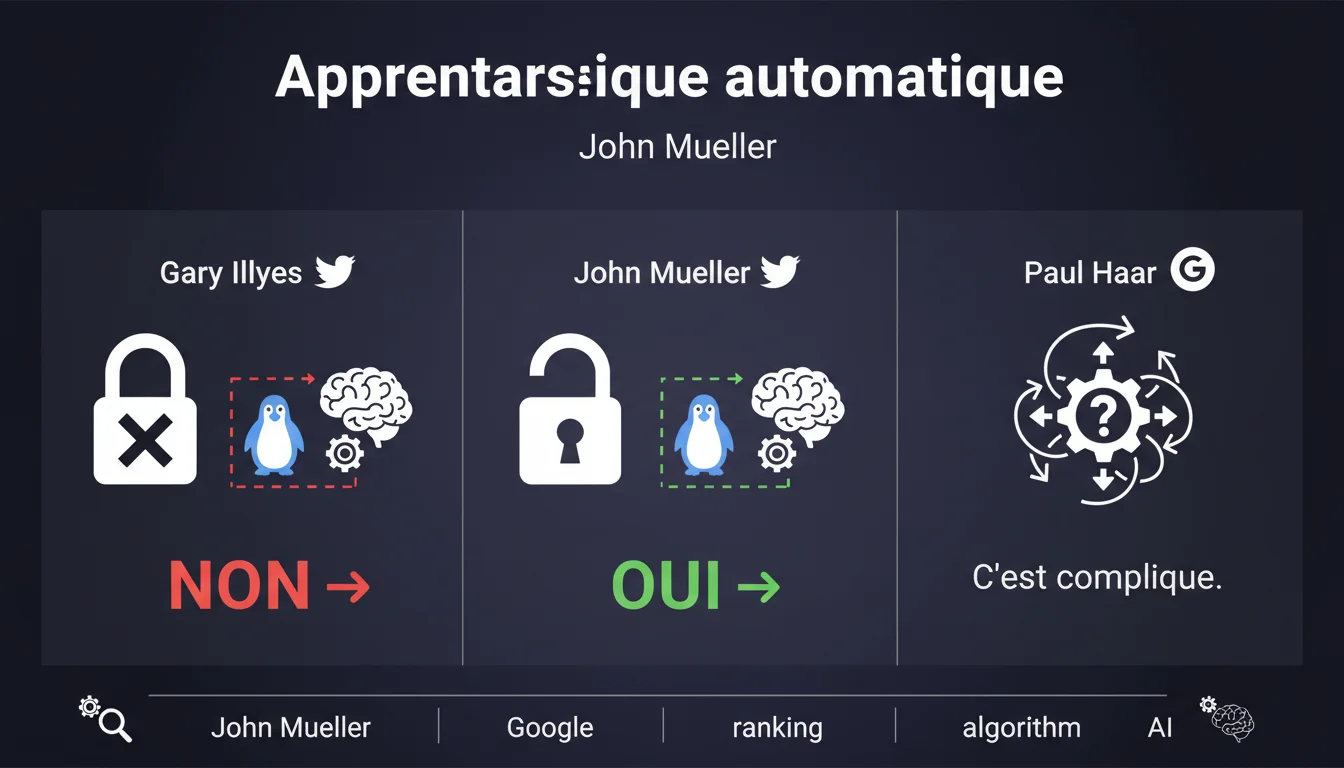

Cette déclaration met en lumière une contradiction flagrante entre plusieurs porte-paroles officiels de Google. Gary Illyes affirme que Penguin 4.0 ne repose pas sur du machine learning, tandis que John Mueller soutient le contraire.

Paul Haar, responsable du ranking, a tranché avec un laconique "c'est compliqué". Cette ambiguïté révèle soit une complexité technique réelle, soit un problème de communication interne chez Google concernant les technologies employées dans leurs algorithmes.

Qu'est-ce que Penguin 4.0 exactement ?

Penguin 4.0 est la dernière version majeure du filtre anti-spam de Google, lancée en 2016. Il cible spécifiquement les sites utilisant des techniques de netlinking manipulateur et des ancres sur-optimisées.

Cette version est devenue temps réel et intégrée au cœur de l'algorithme. Elle fonctionne désormais page par page plutôt que de pénaliser l'ensemble d'un site.

Que signifie concrètement l'utilisation du machine learning dans un filtre ?

Si Penguin utilise le machine learning, cela signifie qu'il apprend continuellement de nouveaux patterns de spam sans intervention humaine. L'algorithme s'adapterait automatiquement aux nouvelles techniques de manipulation.

Sans machine learning, Penguin fonctionnerait avec des règles prédéfinies par les ingénieurs Google. La différence est capitale pour comprendre comment l'algorithme évolue et détecte les abus.

- Contradictions officielles entre Gary Illyes et John Mueller sur la technologie utilisée

- Penguin 4.0 est temps réel et analyse page par page depuis 2016

- Le machine learning permettrait une adaptation automatique aux nouvelles techniques de spam

- La réponse "c'est compliqué" suggère une architecture hybride possible

Avis d'un expert SEO

Cette incohérence révèle-t-elle un problème de communication ou une réalité technique ?

En tant qu'expert SEO, j'observe que cette confusion reflète probablement une réalité hybride. Penguin 4.0 utilise vraisemblablement des composantes avec et sans machine learning.

La détection de base repose sans doute sur des règles algorithmiques classiques (analyse des ancres, diversité des liens, patterns suspects). Mais des couches de machine learning affinent probablement l'évaluation dans les cas limites.

Cette architecture expliquerait pourquoi Paul Haar dit "c'est compliqué". Les différents ingénieurs se focalisent sur leur partie du système, d'où des visions divergentes de la même technologie.

Quelles observations terrain confirment ou infirment l'usage du machine learning ?

Les tests pratiques montrent que Penguin réagit de manière plus nuancée qu'auparavant. Certains liens autrefois pénalisants sont désormais simplement ignorés, signe d'une granularité accrue.

On observe également que des sites avec des profils de liens similaires sont traités différemment selon leur contexte global. Cette contextualisation suggère effectivement une forme d'apprentissage automatique.

Cependant, les patterns de pénalité restent relativement prévisibles pour un expert, ce qui indique que les règles de base demeurent classiques et stables.

Faut-il adapter sa stratégie de liens selon cette information ?

Que Penguin utilise ou non du machine learning ne change fondamentalement pas les bonnes pratiques. Une stratégie de netlinking naturelle et qualitative reste la meilleure approche dans tous les cas.

Si le machine learning est présent, il détectera plus finement les manipulations sophistiquées. Si ce sont des règles classiques, elles sont déjà suffisamment efficaces pour identifier les abus flagrants. Dans les deux cas, la qualité prime.

Impact pratique et recommandations

Que faut-il faire concrètement pour son profil de liens ?

Concentrez-vous sur l'acquisition de liens éditoriaux naturels issus de sites thématiquement pertinents. Variez vos ancres de manière organique, en privilégiant les ancres de marque et génériques.

Évitez toute forme d'automatisation excessive dans la création de liens. Même si Penguin n'utilise pas de machine learning avancé, les patterns robotiques restent facilement détectables par des algorithmes classiques.

Auditez régulièrement votre profil de backlinks pour identifier les liens potentiellement toxiques. Désavouez uniquement les liens clairement spammeurs et manipulateurs.

Quelles erreurs absolument éviter face à Penguin 4.0 ?

Ne tentez jamais de "tester les limites" de l'algorithme, car même sans machine learning, Penguin est suffisamment sophistiqué pour détecter les abus. Les pénalités sont difficiles à inverser.

Évitez les ancres exactes sur-optimisées (plus de 5% de votre profil). C'est le signal le plus évident de manipulation que Penguin cible en priorité.

Ne comptez pas sur les PBN (Private Blog Networks) ou réseaux de sites factices. Même si certains passent temporairement, ils représentent un risque majeur et croissant.

- Privilégier les liens éditoriaux obtenus naturellement via du contenu de qualité

- Maintenir un ratio d'ancres naturel : 70% marque/URL, 20% génériques, 10% optimisées

- Diversifier les sources de liens (médias, blogs, institutions, partenaires)

- Auditer son profil de backlinks trimestriellement avec des outils professionnels

- Désavouer uniquement les liens clairement toxiques, pas ceux simplement de faible qualité

- Documenter toutes les actions de netlinking pour assurer la traçabilité

- Surveiller les fluctuations de positions corrélées aux mises à jour Penguin

💬 Commentaires (0)

Soyez le premier à commenter.