Declaration officielle

Ce qu'il faut comprendre

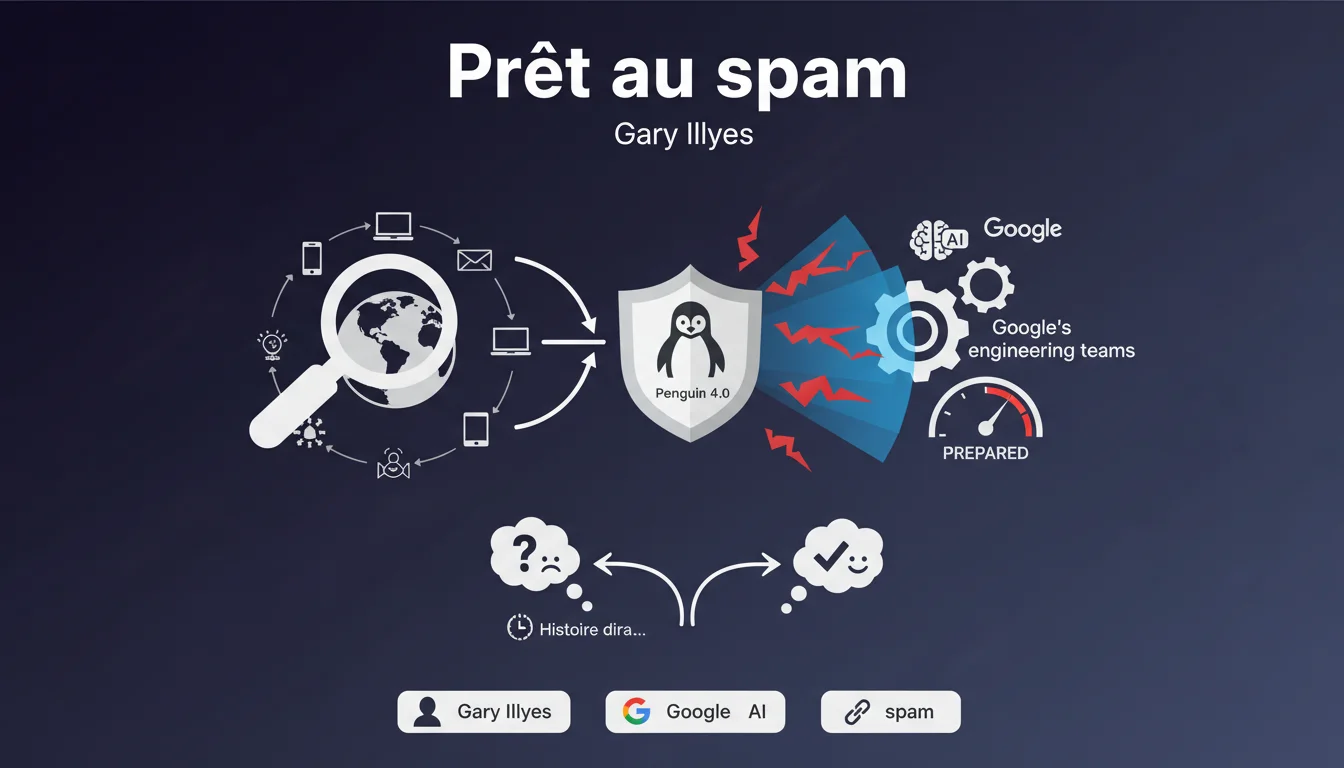

Qu'est-ce que Penguin 4.0 et pourquoi Google s'inquiétait-il du spam ?

Penguin 4.0 était une mise à jour majeure du filtre anti-spam de Google lancée en 2016. Ce filtre visait à pénaliser les sites utilisant des techniques de netlinking artificiel et de sur-optimisation d'ancres.

La déclaration de Gary Illyes révèle que Google anticipait des tentatives de manipulation de ce nouveau filtre. Les SEO black hat cherchent toujours à identifier les failles des algorithmes pour les exploiter, d'où cette préparation proactive des équipes.

Quelles équipes étaient mobilisées chez Google ?

Google avait déployé des équipes d'ingénieurs dédiées spécifiquement pour surveiller et contrer les tentatives de spam. Cette approche montre que chaque mise à jour algorithmique majeure s'accompagne d'une phase de surveillance intensive.

Cette mobilisation n'est pas anodine : elle confirme que Google ne se contente pas de lancer un filtre, mais l'affine en temps réel selon les comportements observés.

Pourquoi cette déclaration est-elle importante pour les praticiens SEO ?

Cette annonce confirme que Google adopte une posture défensive proactive face aux manipulations. Chaque nouvelle mise à jour est suivie d'une période d'ajustement où les tentatives de contournement sont traquées.

- Penguin 4.0 fonctionnait en temps réel, intégré au cœur de l'algorithme

- Google surveillait activement les patterns de manipulation post-lancement

- Les techniques de spam identifiées déclenchaient des ajustements rapides du filtre

- Cette approche s'applique à toutes les mises à jour majeures, pas seulement Penguin

- La période suivant une mise à jour est particulièrement risquée pour les pratiques limites

Avis d'un expert SEO

Cette surveillance active de Google s'applique-t-elle encore aujourd'hui ?

Absolument. Six ans après Penguin 4.0, cette approche s'est même intensifiée et systématisée. Chaque Core Update, chaque lancement de fonctionnalité s'accompagne désormais d'une surveillance algorithmique et humaine accrue.

Les systèmes de machine learning permettent aujourd'hui à Google d'identifier encore plus rapidement les tentatives de manipulation. Ce qui prenait des semaines en 2016 se détecte désormais en quelques jours, voire heures pour certains patterns flagrants.

Quelles nuances faut-il apporter à cette déclaration ?

Si la vigilance de Google est réelle, elle n'est pas infaillible ni instantanée. Des techniques de spam échappent toujours temporairement aux filtres, créant des opportunités pour les manipulateurs les plus sophistiqués.

Le vrai risque réside dans la durabilité. Une technique qui fonctionne aujourd'hui peut déclencher une pénalité rétroactive demain. C'est particulièrement vrai pour le netlinking : un profil de liens suspect peut mettre des mois à être sanctionné, puis provoquer une chute brutale.

Cette approche défensive révèle-t-elle une faiblesse des algorithmes Google ?

Paradoxalement, oui. Le fait que Google mobilise des équipes entières pour surveiller les tentatives de manipulation montre que les algorithmes seuls ne suffisent pas. Il existe toujours un décalage temporel entre l'innovation des spammeurs et la réponse algorithmique.

C'est pourquoi Google combine désormais détection automatique, actions manuelles et ajustements algorithmiques continus. Cette stratégie multicouche explique pourquoi certains sites sont pénalisés manuellement quand d'autres subissent des baisses algorithmiques pour des pratiques similaires.

Impact pratique et recommandations

Que faut-il faire concrètement après chaque mise à jour majeure ?

Adoptez une posture d'observation prudente pendant au moins 3 mois après toute annonce Google significative. C'est la période où les ajustements sont les plus fréquents et où les comportements suspects sont scrutés.

Documentez méticuleusement vos actions SEO pour pouvoir identifier rapidement ce qui aurait pu déclencher une baisse. Gardez un historique des campagnes de netlinking, des optimisations on-page et des changements techniques majeurs.

Quelles erreurs éviter absolument dans la période post-mise à jour ?

Ne tentez jamais d'exploiter massivement une faille identifiée juste après une mise à jour. Ce qui ressemble à une opportunité est souvent un piège : Google collecte des données sur ces comportements pour affiner ses filtres.

Évitez les sur-corrections brutales. Si votre site perd des positions, ne supprimez pas massivement des liens ou ne modifiez pas radicalement votre contenu immédiatement. Analysez calmement les causes réelles avant d'agir.

- Maintenez un profil de liens naturel avec une croissance régulière et progressive

- Diversifiez vos ancres de liens en privilégiant les ancres de marque et génériques

- Surveillez votre profil de backlinks avec des outils professionnels (Ahrefs, Majestic, Semrush)

- Désavouez les liens toxiques avant qu'ils ne posent problème, pas après une pénalité

- Documentez chaque action SEO significative dans un journal de bord

- Privilégiez les stratégies à long terme plutôt que les gains rapides

- Testez les nouvelles tactiques sur des projets secondaires, jamais sur votre site principal

- Restez informé des communications officielles de Google via leurs canaux

Comment construire une stratégie SEO résiliente face à ces évolutions ?

La clé est de diversifier vos sources de trafic et de ne jamais dépendre d'une seule technique. Un site résilient combine contenu de qualité, autorité naturelle, expérience utilisateur optimale et présence multi-canal.

Investissez dans la création de vraies relations avec votre écosystème : partenaires, médias, influenceurs. Ces liens authentiques résistent à toutes les mises à jour car ils sont légitimes par nature.

💬 Commentaires (0)

Soyez le premier à commenter.