Declaration officielle

Ce qu'il faut comprendre

Qu'est-ce que ce formulaire spécial de demande de crawl auprès de Google ?

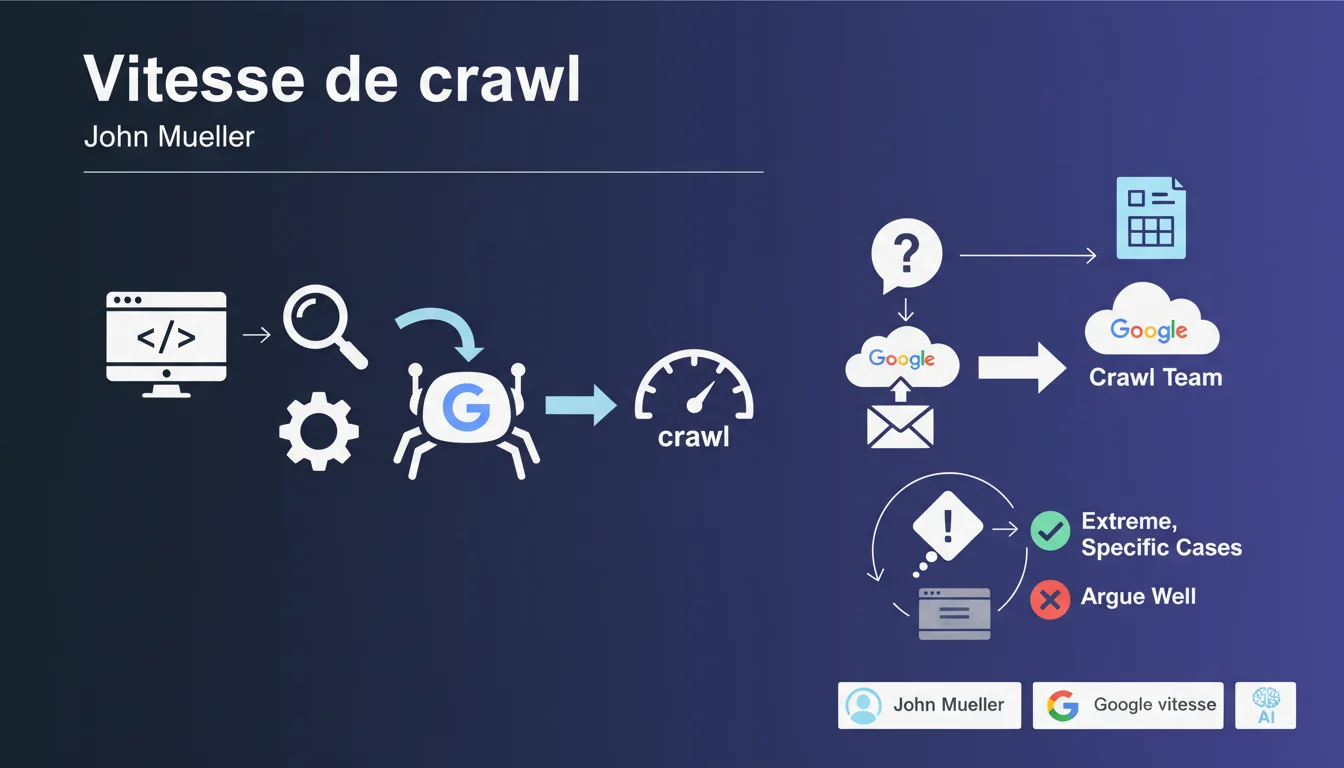

Google dispose d'un formulaire confidentiel permettant aux webmasters de contacter directement l'équipe crawl pour des situations exceptionnelles. Ce canal de communication n'est pas publiquement documenté car Google souhaite éviter son usage abusif.

Ce formulaire permet de poser des questions techniques précises sur la façon dont Googlebot explore votre site, ou de demander une exploration ciblée dans des cas très particuliers. Il ne s'agit pas d'un outil de crawl à la demande, mais d'un mécanisme de résolution de problèmes pour des situations critiques.

Dans quelles situations extrêmes peut-on utiliser ce formulaire ?

Les cas d'usage légitimes concernent des problèmes techniques majeurs affectant l'indexation. Par exemple : un site entier qui n'est plus crawlé suite à une migration, des erreurs de crawl massives inexpliquées, ou des problèmes de budget crawl critiques pour un site de grande envergure.

Il peut également s'agir de situations urgentes à fort impact business : lancement de produits stratégiques nécessitant une indexation rapide, correction de contenu critique déjà indexé, ou problèmes techniques complexes que les outils standards ne résolvent pas.

Pourquoi faut-il argumenter particulièrement bien sa demande ?

L'équipe crawl de Google reçoit un volume considérable de demandes et doit prioriser les cas réellement exceptionnels. Une demande mal argumentée sera simplement ignorée ou redirigée vers les outils classiques comme la Search Console.

- Réservé aux situations exceptionnelles et techniquement complexes

- Nécessite une argumentation détaillée avec preuves techniques

- Ne remplace pas les outils standards (Search Console, inspection d'URL)

- Permet de contacter directement l'équipe crawl de Google

- Destiné aux problèmes critiques affectant l'indexation globale du site

Avis d'un expert SEO

Cette option est-elle vraiment accessible à tous les webmasters ?

Dans la pratique, ce formulaire est rarement nécessaire pour la majorité des sites. Google a considérablement amélioré ses outils de diagnostic via la Search Console, et la plupart des problèmes de crawl peuvent être résolus par ces canaux standards.

L'existence de ce formulaire révèle surtout que Google reconnaît que son système n'est pas parfait et que des situations exceptionnelles nécessitent une intervention humaine. Cependant, l'accès réel à l'équipe crawl reste un privilège implicite pour les sites de grande envergure ou les cas vraiment problématiques.

Quels risques existe-t-il à utiliser ce formulaire de manière inappropriée ?

Un usage abusif ou injustifié peut conduire à ce que vos futures demandes légitimes soient ignorées. Google pourrait également considérer que vous ne maîtrisez pas les bases du SEO technique, ce qui décrédibilise votre site.

De plus, solliciter Google pour des problèmes qui relèvent de votre propre responsabilité technique (robots.txt mal configuré, temps de réponse serveur trop lent, architecture mal pensée) ne fera qu'exposer vos lacunes sans apporter de solution.

Dans quels cas cette procédure pourrait-elle réellement faire la différence ?

Les situations où cette intervention peut s'avérer décisive concernent principalement les sites de très grande taille (millions de pages) avec des problèmes de budget crawl complexes que les ajustements classiques ne résolvent pas.

Elle peut aussi être pertinente pour des bugs manifestes de Googlebot (comportement aberrant documenté et reproductible), ou lors de migrations techniques majeures où malgré toutes les précautions, l'indexation ne reprend pas normalement après plusieurs semaines.

Impact pratique et recommandations

Que faut-il vérifier avant même de penser à utiliser ce formulaire ?

Commencez par un audit technique complet de votre site. Vérifiez que tous les fichiers techniques (robots.txt, sitemap XML) sont correctement configurés et que votre serveur répond rapidement à toutes les requêtes.

Analysez en détail les rapports de la Search Console : statistiques de couverture, erreurs de crawl, performances du site. Utilisez l'outil d'inspection d'URL pour vérifier que Googlebot peut accéder et indexer vos pages prioritaires.

Assurez-vous que le problème persiste depuis au moins 2-3 semaines et qu'il ne s'agit pas d'un délai normal de traitement par Google. Documentez précisément tous vos constats avec captures d'écran et données chiffrées.

Comment rédiger une demande qui a une chance d'être prise en compte ?

Votre demande doit être extrêmement structurée et factuelle. Présentez le contexte (type de site, taille, secteur), décrivez précisément le problème observé avec des données quantifiées (pages concernées, chute de crawl observée).

Listez toutes les actions correctives déjà entreprises et leurs résultats. Joignez des preuves techniques : logs serveur montrant les requêtes de Googlebot, captures de la Search Console, exemples d'URLs problématiques.

Expliquez clairement l'impact business critique du problème et pourquoi il nécessite une intervention exceptionnelle. Restez professionnel, concis et technique dans votre formulation.

Quelles alternatives concrètes privilégier en priorité ?

- Optimiser votre architecture de liens internes pour faciliter le crawl naturel

- Réduire le temps de réponse serveur à moins de 200ms pour Googlebot

- Soumettre un sitemap XML optimisé avec uniquement les URLs prioritaires

- Utiliser l'outil d'inspection d'URL pour les pages les plus critiques

- Corriger tous les problèmes remontés dans le rapport de couverture

- Éliminer les chaînes de redirections et les erreurs 5xx/4xx

- Mettre en place un monitoring des logs serveur pour analyser le comportement de Googlebot

- Augmenter la fréquence de mise à jour du contenu stratégique

💬 Commentaires (0)

Soyez le premier à commenter.