Declaration officielle

Autres déclarations de cette vidéo 4 ▾

- □ Search Essentials : Google change-t-il vraiment ses règles ou juste l'emballage ?

- □ Les graphiques à bulles de Search Console changent-ils vraiment votre analyse SEO ?

- □ Pourquoi les dimensions d'image dans le HTML sont-elles devenues incontournables pour le CLS ?

- □ Faut-il vraiment supprimer plutôt que réparer les éléments qui posent problème en SEO ?

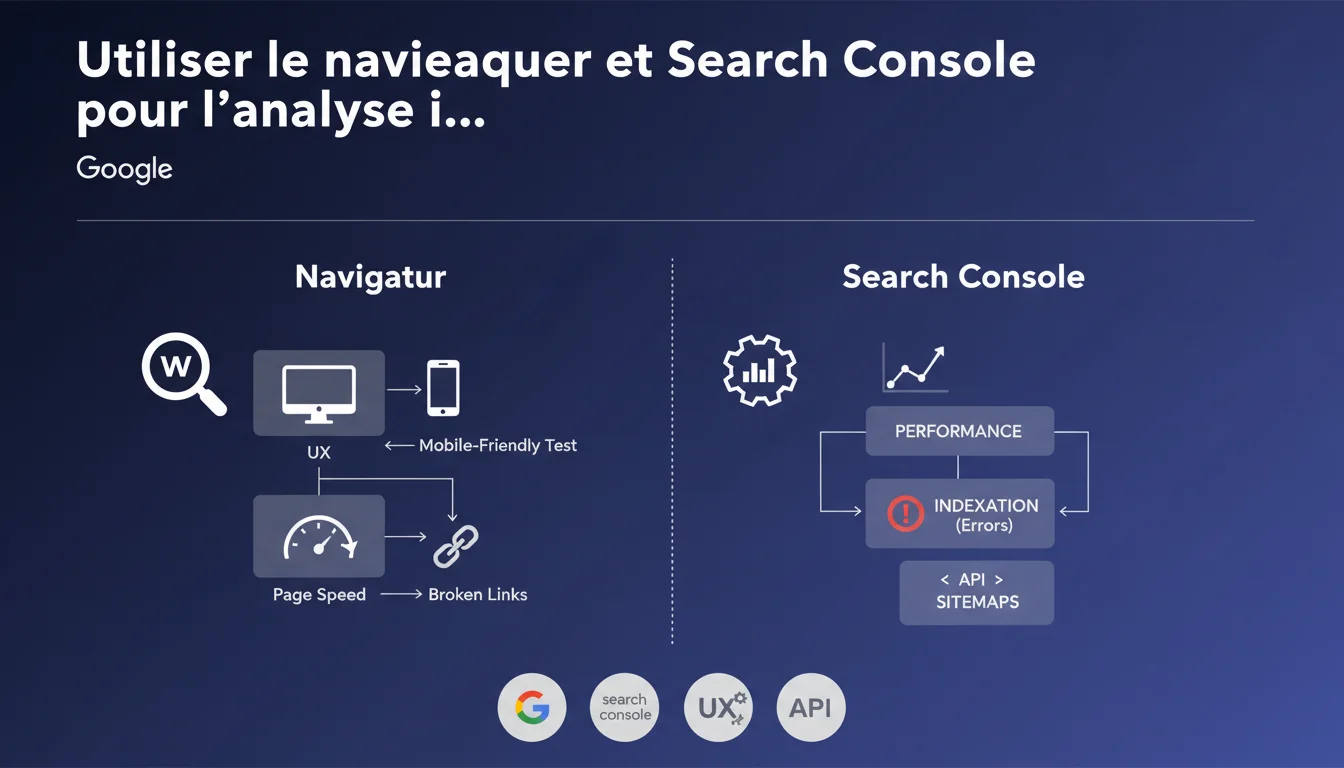

Google recommande de démarrer toute analyse SEO par une combinaison navigateur + Search Console avant d'explorer d'autres outils ou dimensions du référencement. L'idée : obtenir rapidement une vision terrain de ce que voit réellement le moteur et identifier les problèmes critiques sans se noyer dans des métriques secondaires. Une approche qui privilégie l'efficacité sur l'exhaustivité lors de la phase de diagnostic initial.

Ce qu'il faut comprendre

Pourquoi Google met-il l'accent sur cette approche minimaliste ?

La recommandation vise à éviter la paralysie analytique. Trop de SEO perdent des heures dans des outils tiers avant même de comprendre ce que Google voit réellement. Le navigateur révèle l'expérience utilisateur brute — temps de chargement, affichage mobile, accessibilité des contenus. Search Console, lui, expose les données directement issues du crawl et de l'indexation.

Cette combinaison offre un diagnostic rapide des dysfonctionnements majeurs : pages non indexées, erreurs 404 massives, problèmes de Core Web Vitals, écarts entre le contenu rendu et le HTML source. Autant de signaux d'alarme qui nécessitent une action immédiate avant toute optimisation fine.

Que peut-on vraiment détecter avec cette méthode ?

Le navigateur en mode inspection permet de vérifier le rendu JavaScript, la structure HTML effective, les balises meta, la hiérarchie des titres. C'est l'équivalent d'un contrôle visuel terrain — ce que voient réellement les utilisateurs et Googlebot.

Search Console complète avec les données de performance : requêtes générant des impressions, taux de clic, couverture d'indexation, signaux d'expérience page. L'outil révèle aussi les erreurs d'exploration, les problèmes de sitemap, les anomalies de robots.txt. C'est la vision Google pure, sans filtre ni interprétation tierce.

- Rendu client vs serveur : identifier les contenus invisibles pour Googlebot si le JS ne s'exécute pas correctement

- Écarts d'indexation : pages soumises mais exclues, canonicalisations non désirées, soft 404

- Signaux UX critiques : LCP, CLS, FID directement mesurés sur terrain réel

- Opportunités de CTR : requêtes avec impressions élevées mais clics faibles, balises title/meta à retravailler

- Erreurs techniques bloquantes : ressources non disponibles, temps de réponse serveur excessifs

Cette approche suffit-elle pour un audit complet ?

Non, et Google ne prétend pas le contraire. Il s'agit d'une analyse initiale, pas d'un audit exhaustif. L'objectif est de détecter les problèmes structurels majeurs et d'établir un plan d'action priorisé.

Pour une analyse approfondie, il faudra forcément croiser avec d'autres sources : logs serveur pour comprendre le comportement réel de Googlebot, outils de crawl pour cartographier l'architecture, analytics pour mesurer l'engagement, backlink checkers pour évaluer le profil de liens. Mais commencer par le duo navigateur + GSC permet de gagner du temps et d'éviter les fausses pistes.

Avis d'un expert SEO

Cette recommandation est-elle cohérente avec les pratiques terrain observées ?

Absolument. Les audits les plus efficaces que j'ai menés démarraient systématiquement par un crawl manuel via navigateur + une plongée dans Search Console. Trop de consultants se jettent directement sur Screaming Frog ou Semrush sans avoir vérifié que Google indexe réellement les pages stratégiques.

Le risque ? Optimiser pendant des semaines des contenus que Googlebot ne voit même pas correctement. J'ai croisé des sites où 40% des pages n'étaient pas indexées à cause d'un render blocking JavaScript mal géré — problème détectable en 5 minutes avec Chrome DevTools, mais invisible dans la plupart des crawlers classiques.

Quelles limites faut-il garder en tête ?

Search Console ne remonte que les données des 16 derniers mois et agrège parfois de manière frustrante. Certaines métriques manquent de granularité — impossible par exemple de segmenter les Core Web Vitals par type de device ou par template de page avec la précision nécessaire.

Le navigateur, lui, ne montre qu'une vision instantanée. Un site peut afficher un LCP correct lors de ton test manuel, puis s'effondrer en conditions réelles (réseau lent, device bas de gamme, cache vide). Les field data de la Search Console compensent partiellement, mais restent agrégées.

[A vérifier] La recommandation de Google reste volontairement floue sur la fréquence de cette analyse. S'agit-il d'un audit ponctuel ou d'un monitoring continu ? Pour un site e-commerce de 50 000 pages, cette approche manuelle atteint vite ses limites — il faut automatiser une partie du processus.

Dans quels cas cette méthode montre-t-elle ses failles ?

Sur les gros sites à forte volumétrie, analyser page par page via navigateur devient impraticable. Il faut alors échantillonner intelligemment : templates critiques, top landing pages, nouvelles catégories. Mais l'échantillonnage introduit un biais — on peut rater des problèmes localisés.

Les sites avec contenus générés côté serveur selon le user-agent posent aussi problème. Si le rendu diffère entre Googlebot et un navigateur classique (cloaking involontaire, par exemple), l'analyse manuelle via Chrome ne révèlera pas l'écart. Il faut alors passer par l'outil d'inspection d'URL de la GSC pour forcer un fetch Googlebot.

Impact pratique et recommandations

Que faut-il faire concrètement dès maintenant ?

Commence par ouvrir ton site dans Chrome DevTools (F12), onglet Network, et simule une connexion 3G lente. Regarde quelles ressources bloquent le rendu, combien de temps met le LCP à s'afficher, si des erreurs JavaScript cassent l'expérience. Fais ça sur les 5-10 templates clés de ton site.

Ensuite, plonge dans Search Console : section Couverture pour identifier les pages exclues, section Performance pour repérer les requêtes à fort potentiel mais faible CTR, section Expérience pour mesurer les Core Web Vitals en conditions réelles. Exporte les données, croise-les, priorise les quick wins.

- Vérifie que les pages stratégiques apparaissent bien dans l'index Google (requête site: ou outil d'inspection d'URL)

- Compare le HTML source (Ctrl+U) avec le rendu final (Inspect) pour détecter les contenus injectés en JS non vus par Googlebot

- Identifie les erreurs 404 ou soft 404 massives dans GSC > Couverture et corrige ou redirige

- Repère les pages avec impressions élevées mais CTR faible — retravaille title et meta description

- Analyse les Core Web Vitals par groupes d'URL et concentre-toi sur les pages à fort trafic d'abord

- Vérifie que ton sitemap XML est à jour et que toutes les URLs importantes y figurent

- Teste le rendu mobile via l'outil de test d'optimisation mobile de Google — c'est ce que voit le mobile-first index

Quelles erreurs éviter lors de cette analyse initiale ?

Ne te fie pas uniquement au rendu navigateur depuis ton poste de travail. Googlebot utilise une version spécifique de Chrome, et le rendu peut varier selon les conditions réseau, le cache, les cookies. Utilise systématiquement l'outil d'inspection d'URL de la GSC pour voir exactement ce que Google a indexé.

Autre piège classique : analyser uniquement la homepage et quelques pages corporate. Les vrais problèmes se nichent souvent dans les pages profondes — fiches produits, articles de blog anciens, pages de catégories paginées. Échantillonne intelligemment pour couvrir tous les types de templates.

Enfin, ne confonds pas corrélation et causalité. Si une page est mal classée ET a un mauvais LCP, ce n'est pas forcément le LCP le problème principal. Croise avec les données de backlinks, la qualité du contenu, la concurrence sur la requête. Search Console + navigateur donnent des indices, pas des verdicts absolus.

Comment structurer cette analyse pour qu'elle soit exploitable ?

Documente tout dans un tableur : URL testée, problème détecté, niveau de sévérité (bloquant/moyen/faible), action corrective recommandée, statut. Priorise selon l'impact SEO potentiel et la complexité de mise en œuvre.

Pour un site complexe ou de grande taille, cette phase de diagnostic peut vite révéler des chantiers techniques lourds — migrations JavaScript mal gérées, architectures de liens en silo défaillantes, problèmes de performances serveur. Si les compétences internes manquent ou que le volume de corrections dépasse vos capacités, il peut être judicieux de vous faire accompagner par une agence SEO spécialisée qui saura prioriser les actions et orchestrer les corrections avec vos équipes techniques.

❓ Questions frequentes

Peut-on se passer totalement d'outils tiers si on utilise Search Console et le navigateur ?

Search Console affiche des données différentes de mes analytics — laquelle croire ?

Comment savoir si Googlebot voit bien mon contenu JavaScript ?

Faut-il analyser chaque page du site manuellement via le navigateur ?

Les données de Core Web Vitals dans Search Console suffisent-elles pour optimiser la performance ?

🎥 De la même vidéo 4

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 16/02/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.