Declaration officielle

Par conséquent, si deux URLs avec des casses différentes affichent le même contenu, Google essaiera généralement de les regrouper comme doublons. Mais, miser sur cet « espoir » n’est pas une stratégie SEO viable. Il est donc fortement conseillé d’être cohérent dans l’utilisation des majuscules/minuscules dans toutes les URLs du site.

Idem pour le fichier robots.txt : les règles ne s’appliquent que si la casse correspond exactement ; il faut prévoir tous les cas ou uniformiser.

Ce qu'il faut comprendre

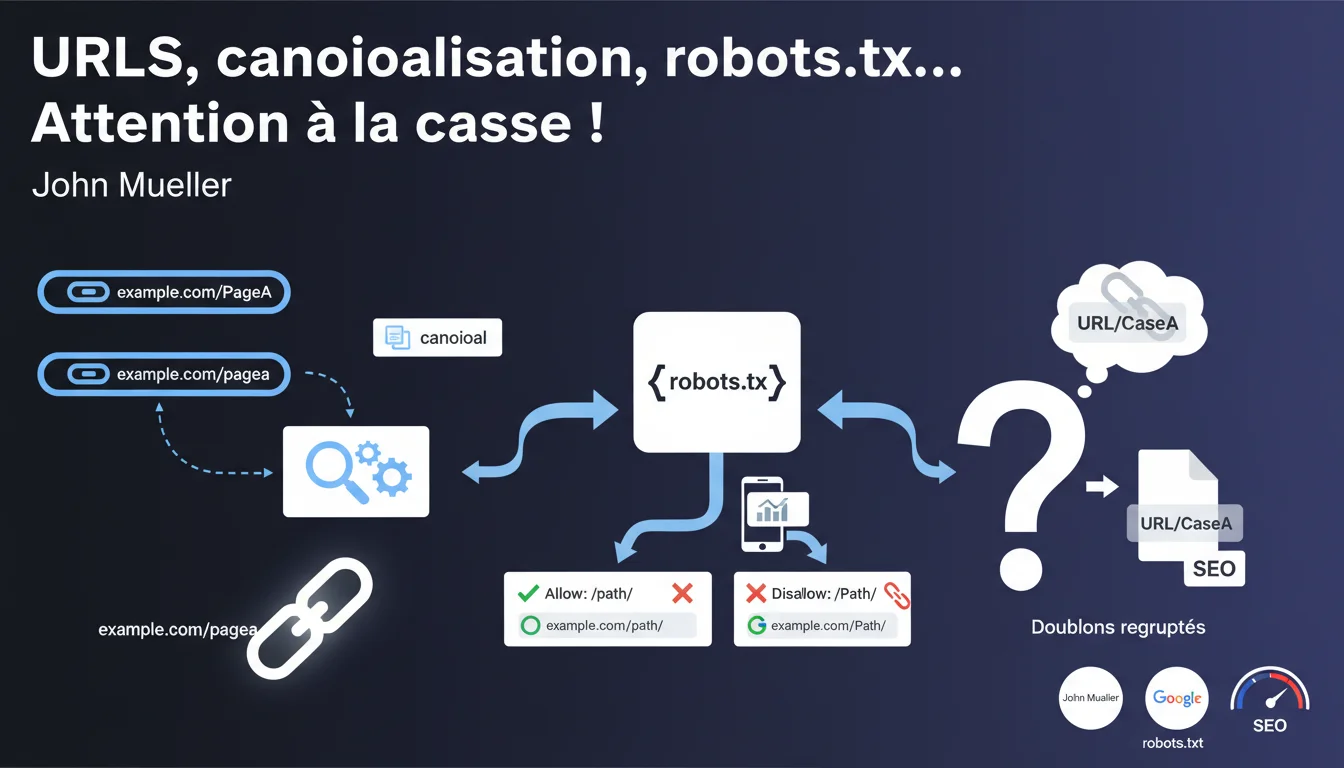

John Mueller rappelle un principe technique souvent négligé : la sensibilité à la casse des URLs joue un rôle déterminant dans plusieurs aspects du SEO. Contrairement à une idée reçue, Google fait bien la distinction entre majuscules et minuscules dans les adresses web.

Concrètement, cela signifie que deux URLs identiques mais avec des casses différentes (exemple.com/Page vs exemple.com/page) sont techniquement considérées comme deux URLs distinctes par les moteurs de recherche. Google tentera certes de détecter qu'il s'agit de contenu dupliqué et de les regrouper, mais ce n'est pas garanti.

Cette sensibilité à la casse s'applique également au fichier robots.txt, où les règles doivent correspondre exactement à la casse des URLs à bloquer ou autoriser. Une directive bloquant /Admin/ ne bloquera pas /admin/.

- Les URLs sont sensibles à la casse pour les moteurs de recherche

- Google peut choisir une version canonique différente selon les variations de casse

- Le fichier robots.txt nécessite une correspondance exacte de la casse

- Compter sur Google pour corriger automatiquement n'est pas une stratégie fiable

- La cohérence est indispensable pour éviter les problèmes de canonicalisation

Avis d'un expert SEO

Cette déclaration confirme ce que les professionnels SEO observent régulièrement lors des audits techniques : les incohérences de casse génèrent des problèmes de duplication qui fragmentent l'autorité des pages. Dans la pratique, Google parvient souvent à consolider ces variations, mais au prix d'un gaspillage de crawl budget et d'une dilution temporaire du signal de ranking.

Il faut nuancer selon les environnements : les serveurs Windows sont historiquement insensibles à la casse, tandis que les serveurs Linux/Unix font la distinction. Cette différence crée parfois des surprises lors de migrations ou de changements d'hébergement, où des URLs auparavant interchangeables deviennent soudainement distinctes.

L'aspect robots.txt est encore plus critique : j'ai constaté des situations où des sections entières restaient accessibles aux robots simplement parce que la règle de blocage utilisait une casse différente de celle des URLs réellement crawlées. C'est un vecteur de risque pour la sécurité et la stratégie d'indexation.

Impact pratique et recommandations

- Auditer immédiatement toutes les URLs de votre site pour identifier les variations de casse existantes

- Implémenter des redirections 301 depuis toutes les variantes vers une version canonique unique (idéalement en minuscules)

- Configurer votre serveur web pour forcer automatiquement les URLs en minuscules via des règles de réécriture

- Vérifier le fichier robots.txt et s'assurer que chaque règle correspond exactement à la casse des URLs crawlées

- Standardiser les liens internes en utilisant systématiquement la même casse (minuscules recommandées)

- Mettre à jour le sitemap XML pour n'inclure que les versions canoniques en minuscules

- Surveiller les logs serveur pour détecter les accès avec des casses variées et les corriger

- Former les équipes éditoriales à respecter la convention de casse choisie lors de la création de contenus

- Tester systématiquement les variations de casse après chaque déploiement ou migration

- Documenter la politique de casse dans les guidelines techniques du projet

La gestion rigoureuse de la casse représente un enjeu technique fondamental mais souvent sous-estimé. Les impacts peuvent être considérables : dilution du PageRank, duplication de contenu, gaspillage du crawl budget, et failles potentielles dans les directives robots.txt.

La mise en conformité nécessite une approche systématique combinant audit technique approfondi, configuration serveur, redirections stratégiques et gouvernance éditoriale. Ces optimisations touchent à des aspects critiques de l'infrastructure web et requièrent une expertise pointue pour éviter les erreurs qui pourraient impacter négativement la visibilité.

Face à la complexité de ces interventions techniques et à leurs ramifications potentielles, l'accompagnement par une agence SEO expérimentée permet de sécuriser la démarche, d'identifier exhaustivement tous les cas de figure spécifiques à votre plateforme, et de mettre en œuvre les corrections avec la rigueur nécessaire pour préserver et optimiser votre référencement.

💬 Commentaires (0)

Soyez le premier à commenter.