Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Le HTML invalide nuit-il vraiment au référencement naturel ?

- □ Pourquoi vos métadonnées cassées sabotent-elles votre SEO sans bloquer l'indexation ?

- □ Faut-il encore utiliser la balise meta keywords en SEO ?

- □ Les commentaires HTML ont-ils un impact sur le référencement Google ?

- □ Les noms de classes CSS influencent-ils vraiment votre référencement naturel ?

- □ Votre thème WordPress sabote-t-il votre référencement sans que vous le sachiez ?

- □ Les Core Web Vitals sont-ils vraiment un levier de classement dans Google ?

- □ Comment vérifier que JavaScript ne bloque pas l'indexation de votre contenu ?

- □ Pourquoi l'API d'indexation Google reste-t-elle bloquée sur deux types de contenus ?

- □ Angular bénéficie-t-il d'un traitement de faveur chez Google ?

- □ La structure HTML sémantique est-elle vraiment un facteur de compréhension pour Google ?

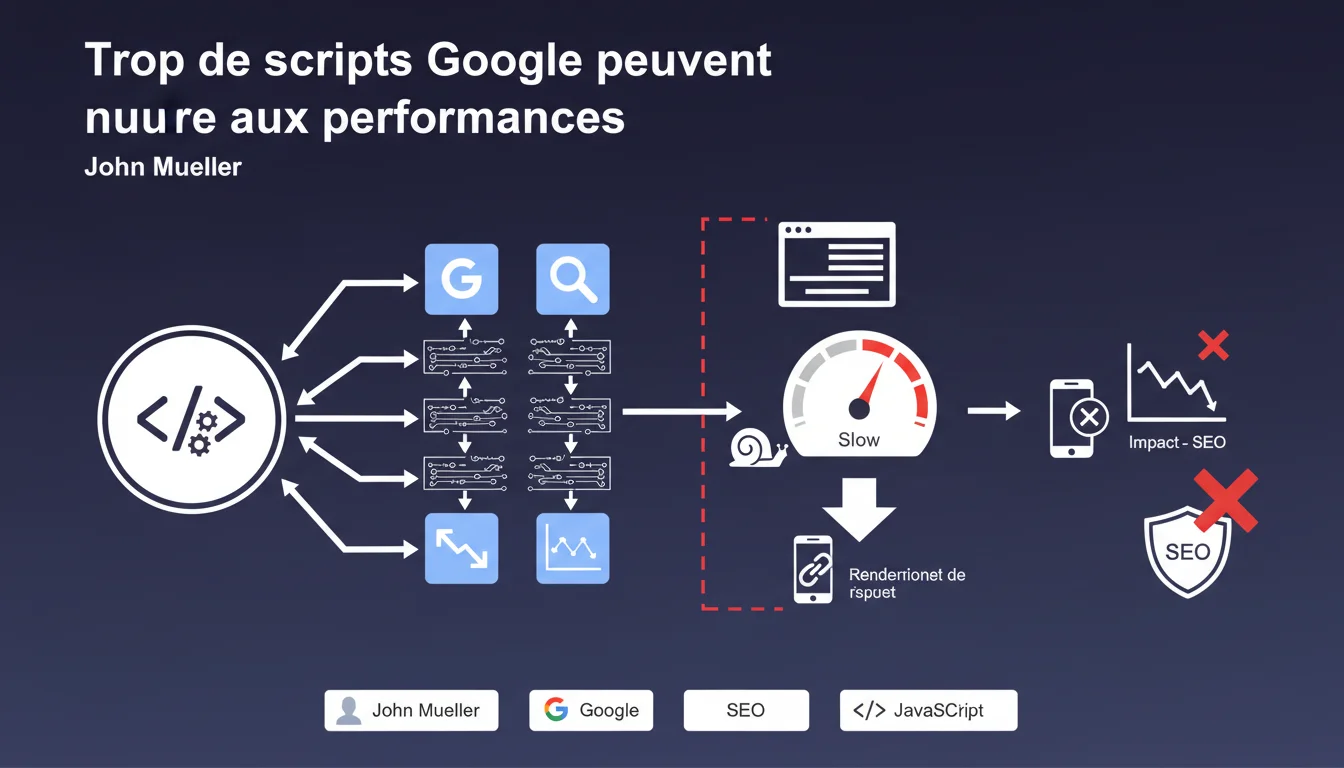

John Mueller confirme que l'accumulation de snippets JavaScript Google (Analytics, Tag Manager, Ads, etc.) peut dégrader sérieusement les performances d'un site et impacter son SEO. Le rendu devient lent, les Core Web Vitals s'effondrent, et Google en fait les frais. La solution ? Faire le tri impitoyablement et charger uniquement ce qui sert vraiment.

Ce qu'il faut comprendre

Pourquoi Google tire-t-il la sonnette d'alarme sur ses propres outils ?

L'ironie est savoureuse : Google reconnaît officiellement que ses propres scripts peuvent plomber les performances d'un site. On parle ici de Tag Manager, Analytics, Google Ads, Optimize, reCAPTCHA, Maps, Fonts... La liste est longue, et beaucoup de sites les empilent sans réfléchir.

Le problème, c'est que chaque script charge ses dépendances, exécute du code, consomme de la bande passante et du temps CPU. Résultat : le rendu ralentit, l'interactivité se dégrade, et les Core Web Vitals (LCP, FID, CLS) partent en vrille. Ce n'est pas théorique — c'est mesurable et documenté.

Quel est le lien direct avec le SEO ?

Depuis l'introduction de la Page Experience comme signal de ranking, les Core Web Vitals comptent officiellement. Un site qui charge 8 scripts Google différents peut facilement exploser son Time to Interactive et son Cumulative Layout Shift.

Google le dit franchement : ces ralentissements peuvent avoir des effets négatifs sur le SEO. Ce n'est pas une menace — c'est un constat. Les sites qui ne gèrent pas leur charge JavaScript sont pénalisés, qu'ils utilisent des scripts Google ou non.

Tous les scripts Google se valent-ils en termes d'impact ?

Non. Tous les scripts ne pèsent pas le même poids. Google Tag Manager, bien configuré, peut même améliorer les performances en centralisant le chargement. Mais un GTM mal configuré avec 15 tags qui s'exécutent au chargement initial est un boulet.

Google Analytics 4 est plus léger que Universal Analytics, mais reste gourmand. Google Ads Remarketing, Google Optimize en mode A/B test visible, reCAPTCHA v2 avec iframe... chaque couche ajoute sa latence. Il faut peser le ROI de chaque script — pas juste les installer par défaut.

- Les scripts Google ne sont pas exemptés des contraintes de performance — Mueller le dit explicitement

- Le cumul fait la différence : 1 ou 2 scripts passent, 6 ou 8 tuent les Core Web Vitals

- Le rendu bloquant est le vrai ennemi — un script asynchrone mal placé peut tout ralentir

- Les Core Web Vitals restent un signal de ranking, même si Google minimise souvent leur poids réel

- La transparence de Google ici est rare — ils admettent un conflit d'intérêts entre monétisation (Ads, Analytics) et expérience utilisateur

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Sur des audits concrets, on voit régulièrement des sites avec 6 à 10 scripts Google différents qui affichent des scores PageSpeed catastrophiques. Le FID explose, le LCP dépasse 4 secondes, et le CLS fait des bonds à chaque chargement de script.

Ce qui est intéressant ici, c'est que Mueller ne donne aucun chiffre précis. Combien de scripts, c'est trop ? Quel seuil éviter ? Aucune réponse. [À vérifier] : il faudrait des études de cas Google internes pour quantifier l'impact réel script par script.

Quelle nuance faut-il apporter à cette alerte ?

L'impact dépend énormément de comment les scripts sont chargés. Un GTM bien configuré avec chargement différé des tags non critiques peut être quasi invisible. Mais un GTM qui déclenche 8 balises en synchrone au premier pixel affiché est un désastre.

Il y a aussi une question de priorité business. Un site e-commerce a besoin de tracking conversion, de remarketing, d'A/B testing. Supprimer ces outils peut coûter plus cher en CA perdu qu'en SEO gagné. Le vrai enjeu, c'est l'optimisation technique — pas la suppression aveugle.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Sur un site purement informationnel sans enjeu conversion, on peut se permettre de virer 80% des scripts Google sans impact business. Mais sur un site transactionnel, le calcul change. Un script Google Ads qui ralentit le site de 200ms mais génère 50k€/mois de CA ne doit pas être supprimé — il doit être optimisé.

Autre cas : les sites avec infrastructure technique solide (CDN performant, serveur puissant, cache agressif) peuvent absorber plus de scripts sans dégradation visible. Le problème touche surtout les sites mid-market avec hébergement moyen et développement fragile.

Impact pratique et recommandations

Que faut-il faire concrètement pour limiter les dégâts ?

Premier réflexe : auditer tous les scripts Google présents sur votre site. GTM, Analytics, Ads, Optimize, Fonts, Maps, reCAPTCHA, Search Console, YouTube embed... listez-les tous. Ensuite, posez-vous la question simple : est-ce que ce script sert vraiment ? Est-ce qu'on l'utilise activement ?

Deuxième étape : configurer le chargement asynchrone et différé. Utilisez les attributs async/defer intelligemment. GTM doit être en async, les tags non critiques doivent être déclenchés après interaction utilisateur ou après chargement complet de la page.

Troisième action : mesurer l'impact réel dans PageSpeed Insights et Chrome User Experience Report. Regardez les Core Web Vitals avant/après retrait de chaque script. Parfois, un seul script pèse 70% du temps de chargement — c'est lui qu'il faut dégager en priorité.

Quelles erreurs éviter absolument ?

Ne chargez jamais tous les scripts en mode synchrone dans le

. C'est le meilleur moyen de bloquer le rendu pendant 2 à 3 secondes. Même les scripts Google doivent être asynchrones ou différés, sauf cas exceptionnel (genre protection anti-fraude critique).Évitez aussi de dupliquer les scripts. On voit régulièrement Analytics chargé deux fois (une fois en dur, une fois via GTM), ou Google Fonts appelé depuis 3 emplacements différents. Consolidez tout dans GTM si possible, et désactivez les doublons.

Dernière erreur classique : installer des scripts « au cas où ». Google Optimize sur un site qui ne fait jamais d'A/B test. Google Ads Remarketing sur un site sans budget Ads. reCAPTCHA v2 sur un formulaire qui reçoit 3 soumissions par mois. Chaque script inutile coûte des points de performance pour zéro ROI.

Comment vérifier que mon site est conforme aux bonnes pratiques ?

Utilisez PageSpeed Insights et Lighthouse pour identifier les scripts qui bloquent le rendu. La section « Réduire l'impact du code tiers » vous donnera la liste exacte des scripts Google qui pèsent lourd.

Installez Chrome DevTools Coverage pour voir quel pourcentage du code JavaScript chargé est réellement exécuté. Souvent, 60% du code Google chargé ne sert à rien sur la page actuelle — c'est du gâchis pur.

Enfin, surveillez les Core Web Vitals en conditions réelles via Google Search Console. Si vos métriques terrain sont mauvaises malgré un bon score Lighthouse, c'est que vos scripts posent problème sur mobile ou connexion lente.

- Lister tous les scripts Google présents sur le site (GTM, Analytics, Ads, Fonts, Maps, etc.)

- Vérifier que chaque script a un usage actif et mesurable — supprimer les scripts « au cas où »

- Configurer GTM pour charger les tags non critiques en différé ou après interaction utilisateur

- Utiliser async/defer sur tous les scripts, sauf exception justifiée

- Éliminer les doublons de scripts (Analytics chargé deux fois, Fonts en triple, etc.)

- Mesurer l'impact de chaque script dans PageSpeed Insights avant/après retrait

- Surveiller les Core Web Vitals réelles dans Search Console et ajuster en continu

- Désactiver Google Optimize, reCAPTCHA v2, ou autres scripts lourds si leur ROI est faible

❓ Questions frequentes

Combien de scripts Google maximum peut-on installer sans risque SEO ?

Google Tag Manager ralentit-il forcément un site ?

Faut-il supprimer Google Analytics pour améliorer les Core Web Vitals ?

Les scripts Google sont-ils traités différemment par Googlebot en termes de performance ?

Peut-on charger tous les scripts Google via un seul GTM pour optimiser les performances ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 26/06/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.