Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Pourquoi Google a-t-il vraiment créé les XML Sitemaps ?

- □ Pourquoi Google a-t-il vraiment lancé Search Console à l'origine ?

- □ Comment réduire de 80% vos emails de support grâce à une documentation SEO-friendly ?

- □ Pourquoi Google cache-t-il certaines informations SEO aux webmasters ?

- □ Pourquoi Google a-t-il ciblé les SEO en priorité avec ses premiers outils pour webmasters ?

- □ Les tirets dans les URLs sont-ils vraiment un critère de ranking essentiel ?

- □ Sous-domaines vs sous-répertoires : pourquoi Google refuse-t-il de trancher ?

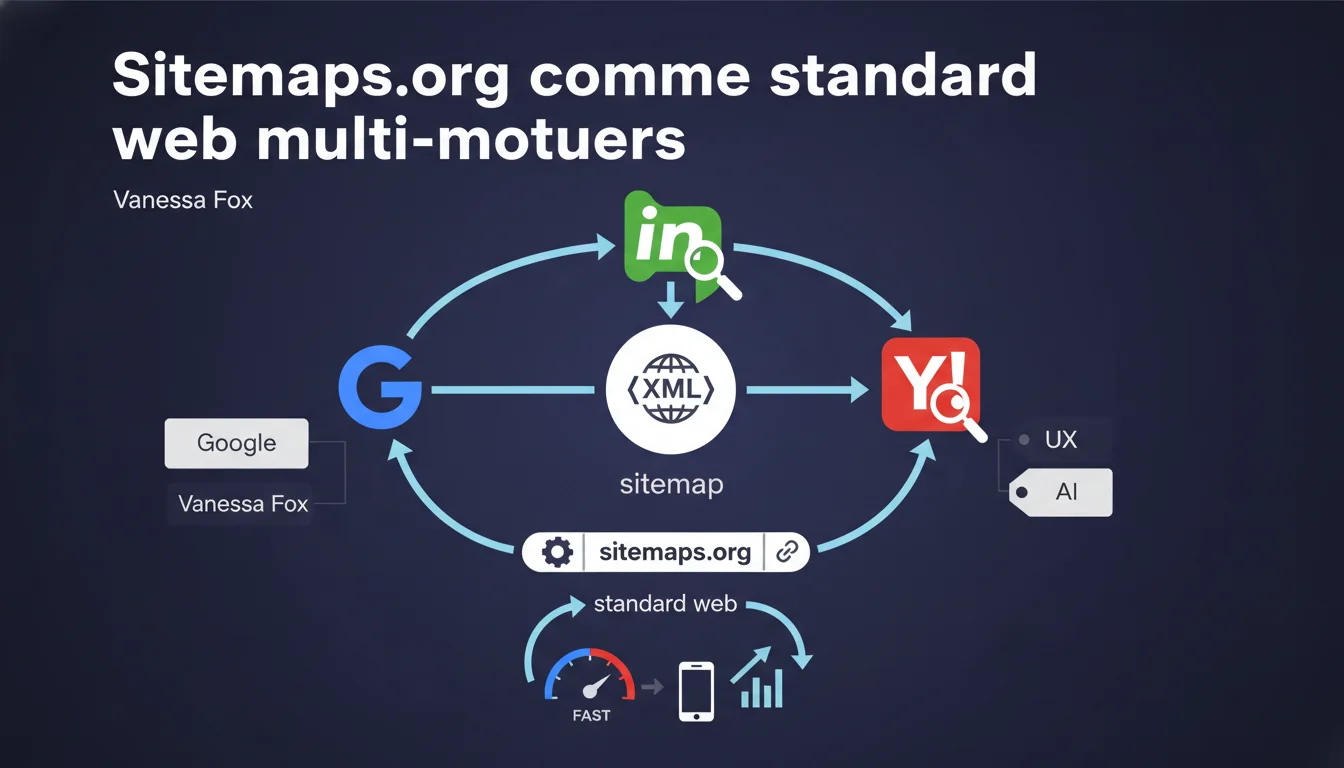

Google a collaboré avec Microsoft et Yahoo pour transformer les XML Sitemaps en standard web accepté par tous les principaux moteurs, donnant naissance à sitemaps.org. Cette démarche visait à unifier les protocoles de communication entre sites web et crawlers, simplifiant ainsi la gestion technique pour les webmasters qui n'avaient plus à créer plusieurs versions de sitemaps selon les moteurs.

Ce qu'il faut comprendre

Pourquoi créer un standard commun plutôt que garder des protocoles propriétaires ?

Avant cette initiative, chaque moteur avait potentiellement ses propres spécifications pour les sitemaps. Google aurait pu garder son protocole pour lui et forcer les webmasters à s'adapter spécifiquement à ses exigences.

Mais l'approche choisie a été radicalement différente : mutualiser les efforts avec Microsoft et Yahoo pour créer un protocole unifié. Le site sitemaps.org avec ses couleurs neutres symbolise cette volonté de neutralité — aucun moteur ne s'approprie le standard.

Quel bénéfice concret pour les professionnels du SEO ?

La standardisation signifie qu'un seul fichier XML Sitemap fonctionne pour Google, Bing, et historiquement Yahoo. Plus besoin de variations techniques selon le crawler ciblé.

Cette harmonisation a permis aux CMS et générateurs de sitemaps de se concentrer sur une seule norme plutôt que de gérer plusieurs formats. Le protocole est devenu prévisible et stable dans le temps.

Cette initiative était-elle vraiment altruiste de la part de Google ?

Soyons honnêtes — Google avait tout à y gagner. En favorisant l'adoption massive des XML Sitemaps via un standard commun, le moteur facilitait la découverte de contenus à crawler.

Plus les webmasters soumettent des sitemaps clairs et structurés, moins Google doit dépenser de ressources à découvrir des URLs cachées ou mal architecturées. C'est un gain d'efficacité pour les crawlers de tous les moteurs participants.

- Standardisation multi-moteurs via sitemaps.org pour éviter la fragmentation des protocoles

- Un seul fichier XML Sitemap compatible avec Google, Bing et Yahoo

- Adoption facilitée par les CMS et outils grâce à une norme unique et documentée

- Gain mutuel : simplicité pour les webmasters, efficacité de crawl pour les moteurs

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Totalement. Dans la pratique quotidienne, le même fichier sitemap.xml soumis dans Google Search Console et Bing Webmaster Tools fonctionne sans adaptation. Le protocole est respecté par tous les acteurs majeurs.

Ce qui est moins souvent dit : bien que le standard existe, Google et Bing ne traitent pas forcément les sitemaps de la même manière en termes de priorités d'indexation ou de fréquence de crawl. Le format est identique, l'interprétation diffère.

Quels points méritent une attention particulière aujourd'hui ?

La neutralité affichée par sitemaps.org est réelle au niveau du protocole technique. Mais dans les faits, Google reste le moteur dominant — les optimisations se font principalement pour lui, Bing suivant en second plan.

Un piège courant : considérer que soumettre un sitemap suffit pour garantir l'indexation. [À vérifier] Google a toujours été évasif sur le poids exact des sitemaps dans les décisions de crawl versus découverte par liens internes. Le sitemap aide, il ne force rien.

Le standard a-t-il évolué depuis sa création ?

Le protocole de base est resté stable — c'est justement sa force. Mais Google a ajouté des extensions : sitemaps vidéo, sitemaps images, sitemaps actualités.

Ces extensions ne sont pas toujours supportées de la même manière par Bing. On retombe donc sur une forme de fragmentation, limitée mais réelle, malgré le standard initial.

Impact pratique et recommandations

Que faut-il faire concrètement avec son sitemap XML ?

Générer un fichier sitemap.xml conforme au protocole sitemaps.org et le soumettre dans Google Search Console et Bing Webmaster Tools. Les deux plateformes utilisent le même format, donc un seul fichier suffit.

Vérifier régulièrement que le sitemap ne contient que des URLs canoniques, accessibles en 200, sans redirections. Exclure les URLs paginées inutiles, les contenus dupliqués ou les pages bloquées par robots.txt.

Quelles erreurs éviter absolument ?

Ne jamais inclure dans le sitemap des URLs en noindex ou bloquées par robots.txt. Google le signale comme erreur dans Search Console — ça crée une incohérence qui peut ralentir le crawl.

Éviter les sitemaps géants non segmentés. Au-delà de 50 000 URLs ou 50 Mo, découper en plusieurs fichiers et utiliser un sitemap index. Les crawlers gèrent mieux des fichiers modulaires.

Ne pas oublier de mettre à jour la balise <lastmod> quand une page change réellement. Une date bidon ou jamais actualisée réduit la confiance accordée au sitemap.

Comment vérifier que le sitemap est correctement traité ?

Consulter les rapports Sitemaps dans Google Search Console : nombre d'URLs découvertes, erreurs détectées, statut de traitement. Comparer avec Bing Webmaster Tools pour croiser les informations.

Analyser les logs serveurs pour vérifier que Googlebot et Bingbot accèdent régulièrement au fichier sitemap.xml. Un sitemap jamais crawlé est souvent signe d'un problème de configuration (robots.txt, redirections).

- Générer un sitemap.xml conforme au standard sitemaps.org (max 50 000 URLs, 50 Mo par fichier)

- Soumettre dans Google Search Console et Bing Webmaster Tools

- Inclure uniquement des URLs canoniques accessibles en 200, sans noindex ni blocage robots.txt

- Mettre à jour la balise <lastmod> uniquement lors de modifications réelles du contenu

- Segmenter en plusieurs fichiers et utiliser un sitemap index si nécessaire

- Surveiller les rapports de traitement dans les outils webmaster pour détecter erreurs et anomalies

- Vérifier dans les logs que les crawlers accèdent régulièrement au sitemap

❓ Questions frequentes

Un sitemap XML est-il obligatoire pour être indexé par Google ?

Faut-il soumettre un sitemap différent pour Google et Bing ?

Quelle est la taille maximale recommandée pour un fichier sitemap ?

Dois-je inclure toutes les pages de mon site dans le sitemap ?

La balise <lastmod> a-t-elle un réel impact sur le crawl ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 22/09/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.