Declaration officielle

Ce qu'il faut comprendre

Pourquoi Google privilégie-t-il certains champs dans les sitemaps XML ?

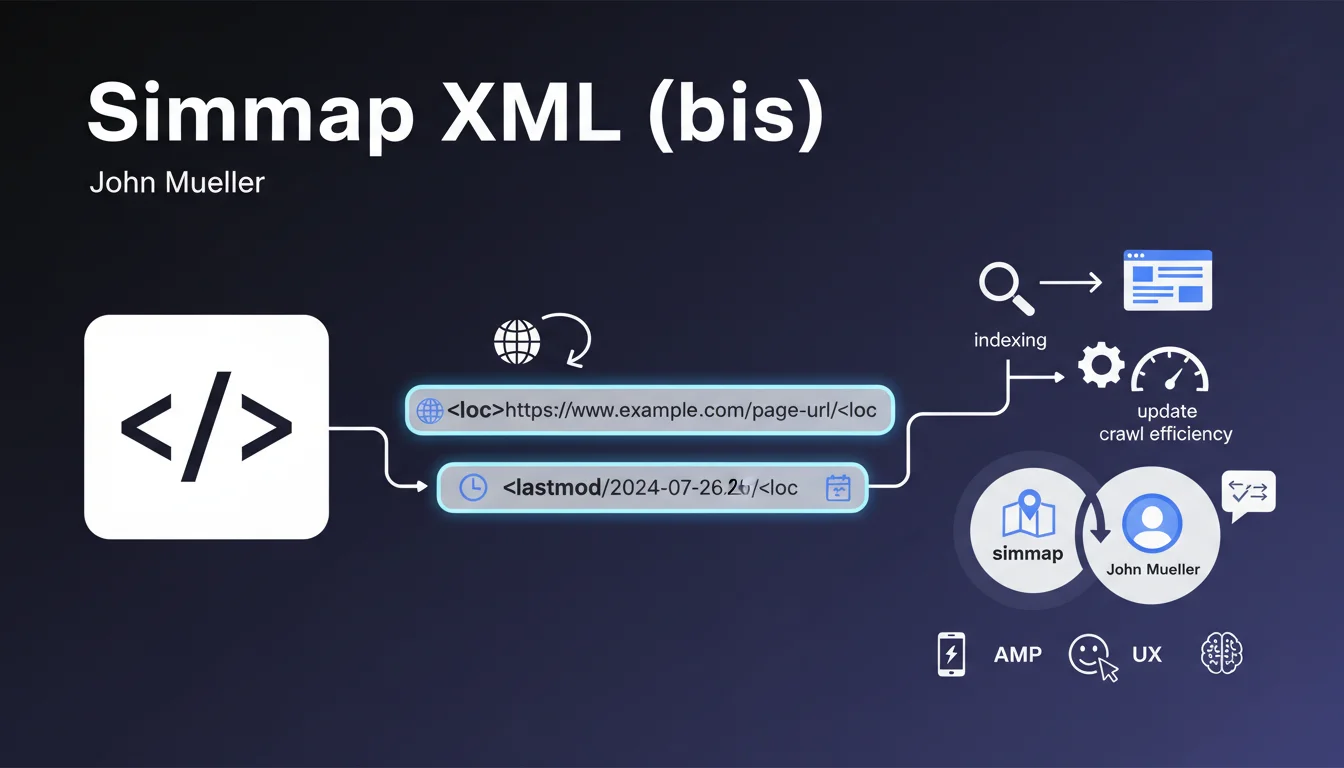

John Mueller a clarifié la position de Google sur les fichiers sitemap XML en identifiant deux champs prioritaires : l'URL (<loc>) et la date de dernière modification (<lastmod>).

Cette précision intervient alors que les sitemaps XML peuvent contenir jusqu'à 5 champs différents (loc, lastmod, changefreq, priority, image). Google indique clairement que seuls deux d'entre eux ont une valeur réelle pour le crawl et l'indexation.

Que signifie concrètement cette hiérarchisation des champs ?

Le champ <loc> (URL) est évidemment indispensable : il indique à Google quelles pages doivent être crawlées. Sans lui, le sitemap n'a aucune utilité.

Le champ <lastmod> (dernière modification) aide Googlebot à prioriser ses ressources de crawl. Il permet d'identifier les pages récemment mises à jour qui méritent un recrawl en priorité.

- Les champs <priority> et <changefreq> sont officiellement ignorés par Google

- Le champ <lastmod> doit être fiable et précis pour être pris en compte

- Un sitemap peut contenir jusqu'à 50 000 URLs ou peser 50 Mo maximum

- Les sitemaps spécifiques (images, vidéos, actualités) suivent des règles distinctes

Quelle différence avec l'en-tête HTTP last-modified ?

Il ne faut pas confondre le champ <lastmod> du sitemap XML avec l'en-tête HTTP Last-Modified. Ce sont deux éléments techniques distincts.

L'en-tête HTTP Last-Modified est renvoyé lors de chaque requête serveur, tandis que le champ lastmod du sitemap est consulté lors de la lecture du fichier XML. Ils peuvent se compléter mais fonctionnent de manière indépendante.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. Les observations terrain confirment que Google ignore depuis des années les champs <priority> et <changefreq>. Ces champs ont été dépréciés de facto bien avant cette clarification officielle.

La réalité du crawl montre que Google utilise son propre algorithme de priorisation basé sur la popularité des pages, leur historique de mise à jour et le budget de crawl alloué. Les indications du webmaster via priority/changefreq n'ont jamais eu d'impact mesurable.

Quelles nuances importantes faut-il apporter à cette recommandation ?

La présence des URLs est effectivement cruciale, mais la qualité de la sélection l'est tout autant. Un sitemap exhaustif n'est pas toujours optimal.

Il est préférable d'inclure uniquement les pages indexables et stratégiques : exclure les pages paginées, les filtres, les doublons potentiels. Un sitemap ciblé de 5 000 URLs pertinentes est supérieur à un sitemap gonflé de 50 000 URLs incluant du contenu de faible valeur.

Dans quels cas cette approche minimaliste ne suffit-elle pas ?

Pour les sites d'actualités et contenus frais, un sitemap XML classique n'est pas optimal. Google recommande d'utiliser un sitemap actualités (news sitemap) ou un flux RSS pour les contenus nécessitant une indexation rapide.

De même, pour les sites riches en médias, les sitemaps spécifiques images et vidéos apportent des métadonnées supplémentaires (titre, description, licence) qui enrichissent l'indexation. Le principe minimaliste loc/lastmod ne s'applique donc pas uniformément à tous les types de sitemaps.

Impact pratique et recommandations

Que faut-il faire concrètement avec vos sitemaps actuels ?

Commencez par un audit de vos sitemaps existants. Vérifiez que toutes les URLs stratégiques sont présentes et que les URLs non-indexables (canonicalisées, noindex, redirections) sont exclues.

Simplifiez vos sitemaps en ne conservant que les champs <loc> et <lastmod>. Supprimez priority et changefreq qui alourdissent inutilement le fichier sans apporter de valeur.

Assurez-vous que votre système génère des dates <lastmod> fiables. La date doit refléter une vraie modification du contenu principal, pas un changement cosmétique de l'interface.

Quelles erreurs critiques éviter dans la gestion des sitemaps ?

Ne listez jamais dans vos sitemaps des URLs qui retournent des erreurs 404, des redirections 301/302, ou qui contiennent une balise noindex. Cela envoie des signaux contradictoires à Google.

Évitez les sitemaps trop volumineux qui dépassent les limites techniques. Au-delà de 50 000 URLs, fragmentez en plusieurs fichiers et utilisez un fichier d'index (sitemap index).

Ne mettez pas à jour la date lastmod de toutes vos pages simultanément. Cela suggère une manipulation artificielle et peut être contre-productif pour votre budget de crawl.

- Vérifier que toutes les URLs du sitemap sont accessibles en HTTP 200

- S'assurer que le sitemap est déclaré dans le fichier robots.txt et dans Google Search Console

- Exclure les URLs avec canonical vers une autre page

- Implémenter un système de génération de lastmod précis et fiable

- Créer des sitemaps séparés pour images, vidéos et actualités si pertinent

- Monitorer les erreurs de sitemap dans Search Console régulièrement

- Limiter chaque fichier sitemap à 50 000 URLs maximum

- Utiliser un sitemap dynamique plutôt que statique pour les sites évolutifs

Comment vérifier l'efficacité de votre stratégie sitemap ?

Consultez régulièrement le rapport de couverture dans Search Console. Vérifiez que les URLs soumises via sitemap sont effectivement crawlées et indexées dans des délais raisonnables.

Analysez les logs serveur pour observer le comportement réel de Googlebot : crawle-t-il en priorité les pages récemment modifiées selon votre lastmod ? Respecte-t-il votre architecture de sitemaps ?

L'optimisation des sitemaps XML repose sur la simplicité et la précision : privilégiez les champs essentiels (loc et lastmod), assurez la fiabilité des données, et excluez les URLs non stratégiques. Cette approche épurée améliore l'efficacité du crawl et l'indexation de vos contenus prioritaires.

La mise en œuvre technique de sitemaps optimisés peut s'avérer complexe, notamment pour garantir la fiabilité du lastmod ou segmenter intelligemment vos URLs. Pour les sites de moyenne et grande envergure, l'accompagnement par une agence SEO spécialisée permet de mettre en place une architecture de sitemaps parfaitement adaptée à votre contexte technique et éditorial, avec un monitoring continu de leur performance.

💬 Commentaires (0)

Soyez le premier à commenter.