Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Le Client-Side Rendering met-il vraiment votre indexation en danger ?

- □ Pourquoi la visibilité du contenu conditionne-t-elle réellement l'indexation par Google ?

- □ L'hydration est-elle vraiment la solution miracle aux problèmes SEO du JavaScript ?

- □ Le pré-rendering est-il la solution ultime pour l'indexation des sites JavaScript ?

- □ L'hydration est-elle vraiment un compromis technique acceptable pour le SEO ?

- □ Comment choisir la bonne stratégie de rendu pour optimiser son référencement naturel ?

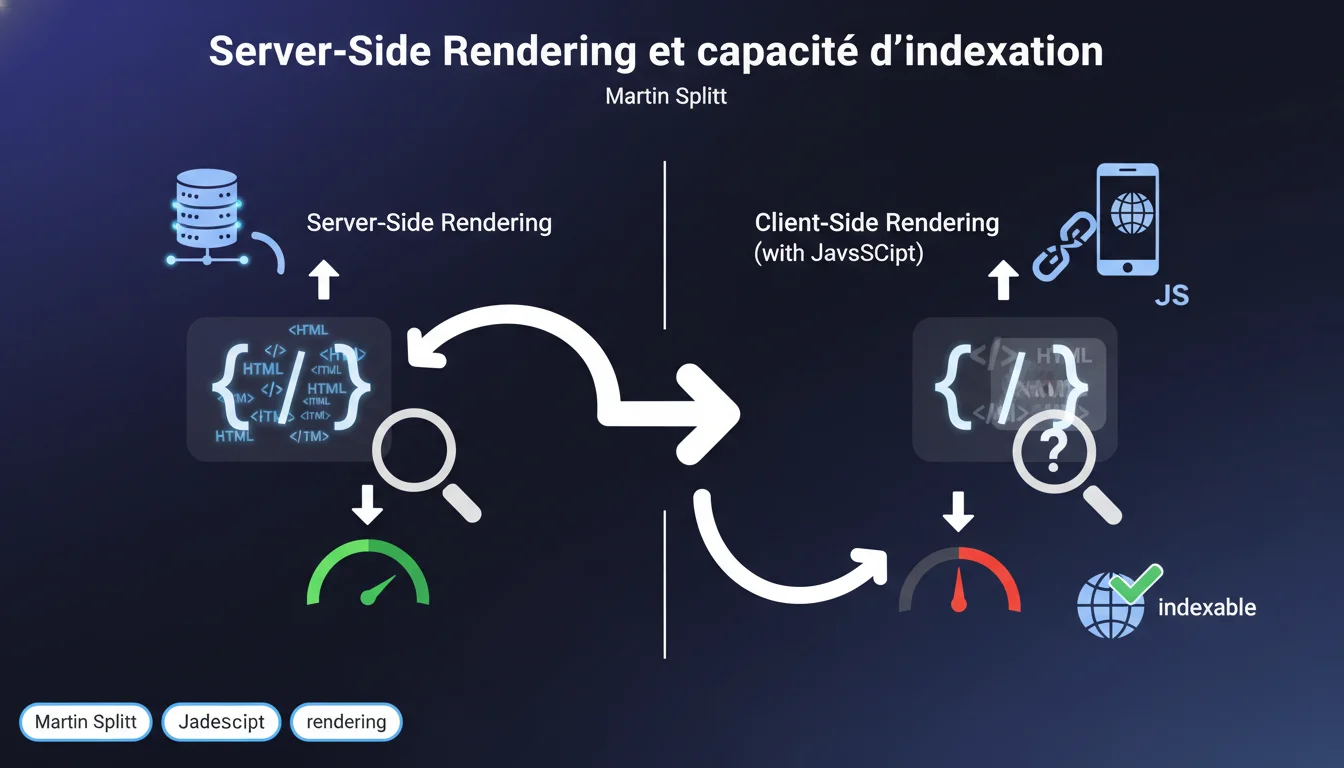

Google confirme que le Server-Side Rendering (SSR) élimine la dépendance à l'exécution JavaScript côté client pour l'indexation, en délivrant du HTML complet directement au serveur. Cette approche garantit que le contenu est immédiatement visible et indexable par les moteurs de recherche, sans attendre le rendu JavaScript.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur le SSR pour l'indexation ?

Le SSR résout un problème fondamental : la latence et l'imprévisibilité du rendu JavaScript côté client. Quand Googlebot crawle une page en CSR (Client-Side Rendering), il doit exécuter le JavaScript, attendre que le DOM se construise, puis indexer le résultat. Ce processus consomme du crawl budget et introduit des risques — timeouts, erreurs JS, ressources bloquées.

Avec le SSR, le serveur envoie directement du HTML complet et prêt à l'emploi. Googlebot n'a plus qu'à parser le code comme pour une page statique classique. Pas d'attente, pas d'aléas liés à l'exécution JavaScript dans un environnement contraint.

Concrètement, qu'est-ce qui change pour l'indexation ?

Le contenu devient immédiatement accessible au premier passage de Googlebot. Plus besoin d'attendre une seconde vague de crawl pour le rendu JavaScript. Les éléments critiques — titres, textes, liens internes, métadonnées structurées — sont tous présents dans le HTML initial.

Cela accélère l'indexation des nouvelles pages et réduit les risques de contenu invisible. Les sites e-commerce avec des milliers de fiches produits générées en JS, par exemple, gagnent en réactivité et en fiabilité d'indexation.

Le SSR supprime-t-il tous les problèmes liés au JavaScript ?

Non, et c'est là que la nuance compte. Le SSR garantit que le contenu initial est indexable, mais si votre page charge ensuite du contenu additionnel via JavaScript côté client (lazy loading, infinite scroll, filtres dynamiques), ces éléments restent soumis aux mêmes contraintes qu'en CSR pur.

Google devra toujours exécuter ce JavaScript pour découvrir ce contenu secondaire. Le SSR n'est donc pas une solution miracle — c'est une fondation solide, mais qui n'exonère pas d'une architecture JS bien pensée.

- HTML complet dès le premier passage : plus de dépendance au rendu différé

- Réduction du crawl budget gaspillé : moins de ressources consommées pour indexer le même contenu

- Amélioration de la vitesse d'indexation : les nouvelles pages sont découvertes et indexées plus rapidement

- Compatibilité étendue : fonctionne pour tous les crawlers, même ceux qui n'exécutent pas JavaScript

- Limitation : le contenu chargé après le premier rendu reste soumis aux contraintes JavaScript habituelles

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui — et c'est même un euphémisme. Depuis des années, les SEO constatent que les sites en SSR ou en pré-rendu s'indexent plus vite et plus complètement que ceux en CSR pur. Les audits montrent régulièrement des contenus manquants dans l'index sur des sites React ou Vue.js mal configurés, alors que leurs équivalents en Next.js (SSR) ou Nuxt affichent des taux d'indexation proches de 100%.

Google n'invente rien ici — il formalise une réalité que les praticiens connaissent déjà. Mais dire que le SSR "garantit" l'indexabilité reste une simplification. Il garantit que le contenu initial sera visible, pas que tout sera parfaitement indexé si l'architecture comporte des failles ailleurs (canoniques mal gérées, robots.txt restrictifs, etc.).

Quelles nuances faut-il apporter à cette affirmation ?

Première nuance : le SSR n'est pas binaire. Entre le SSR pur et le CSR pur, il existe tout un spectre — SSG (Static Site Generation), ISR (Incremental Static Regeneration), hydratation partielle, islands architecture. Chacune de ces approches a des implications différentes pour l'indexation et la performance.

Deuxième nuance : Martin Splitt parle de "garantie" d'indexabilité, mais il ne mentionne pas les coûts d'infrastructure et de complexité. Le SSR impose un serveur Node.js en production, une gestion des caches, des temps de réponse serveur à surveiller. Un site mal optimisé en SSR peut être plus lent qu'un site bien ficelé en CSR avec pré-rendu statique. [A vérifier] : Google pénalise-t-il les sites SSR avec des TTFB élevés de la même manière qu'il valorise leur indexabilité ?

Troisième nuance : tous les moteurs de recherche n'exécutent pas JavaScript de la même façon. Le SSR garantit une compatibilité maximale, mais Google, lui, exécute très bien le JS depuis plusieurs années. Cette déclaration vise-t-elle à simplifier la vie des développeurs ou à compenser des limites internes de Googlebot que Google ne veut pas admettre publiquement ?

Dans quels cas le SSR n'est-il pas la solution optimale ?

Sur des sites à très fort trafic avec des contenus très dynamiques (dashboards, applications métier), le SSR peut créer une charge serveur disproportionnée. Le CSR avec API reste alors plus adapté, quitte à pré-rendre uniquement les pages publiques destinées à l'indexation.

Pour des sites vitrine légers ou des blogs, le SSG (génération statique) est souvent préférable : fichiers HTML servis directement depuis un CDN, TTFB minimal, aucun serveur Node.js à maintenir. Le SSR a du sens pour du contenu personnalisé ou mis à jour en temps réel, pas pour tout.

Impact pratique et recommandations

Que faut-il faire concrètement pour bénéficier du SSR ?

Si votre site actuel fonctionne en CSR pur (React, Vue, Angular sans SSR), évaluez d'abord l'impact réel sur votre indexation. Utilisez Google Search Console pour identifier les pages non indexées ou lentes à apparaître dans l'index. Comparez le HTML source (curl ou "Afficher le code source") avec le contenu rendu visible — si l'écart est massif, le SSR devient prioritaire.

Ensuite, choisissez la bonne approche technique. Pour React, Next.js est le framework SSR de référence. Pour Vue, Nuxt. Pour Angular, Angular Universal. Ces outils gèrent le rendu serveur sans réécrire toute l'application. Mais attention : la migration n'est pas triviale et nécessite des compétences backend en plus du frontend habituel.

Quelles erreurs éviter lors de la mise en place du SSR ?

Erreur classique : activer le SSR sans optimiser les temps de réponse serveur. Si votre HTML met 2 secondes à se générer côté serveur, vous venez de dégrader votre TTFB (Time To First Byte) et vos Core Web Vitals. Le SSR doit s'accompagner de stratégies de cache efficaces — Redis, CDN edge, mise en cache des composants lourds.

Autre piège : croire que le SSR dispense de tester le rendu JavaScript. Même en SSR, une partie du contenu peut être hydratée ou chargée après le rendu initial. Continuez à vérifier avec l'outil "Inspection de l'URL" dans Search Console que tout le contenu attendu apparaît bien dans le rendu Googlebot.

Enfin, ne négligez pas la compatibilité des bibliothèques tierces. Certaines librairies JavaScript ne fonctionnent que côté client (accès au `window`, `document`, etc.). Il faudra les isoler ou les remplacer pour éviter les erreurs côté serveur.

Comment vérifier que votre implémentation SSR fonctionne correctement ?

Premier réflexe : désactivez JavaScript dans votre navigateur et rechargez la page. Si le contenu essentiel (titres, textes, liens) reste visible, votre SSR fonctionne. Si la page est vide ou cassée, le rendu dépend encore du client.

Deuxième check : utilisez `curl` ou `wget` pour récupérer le HTML brut sans exécution JavaScript. Le contenu critique doit apparaître directement dans le code source. Comparez ensuite avec le HTML rendu dans l'outil d'inspection de Google Search Console — l'écart doit être minimal.

Troisième vérification : surveillez vos Core Web Vitals après la migration. Le SSR peut améliorer le FCP (First Contentful Paint) si bien implémenté, mais dégrader le TTFB si le serveur est trop lent. Utilisez PageSpeed Insights et les données terrain de la Search Console pour valider l'impact réel.

- Auditer l'indexation actuelle avec Search Console (pages découvertes vs indexées)

- Identifier les pages critiques où le contenu est invisible dans le HTML source

- Choisir le framework SSR adapté à votre stack technique (Next.js, Nuxt, Angular Universal)

- Mettre en place une stratégie de cache robuste (Redis, CDN edge, composants mis en cache)

- Tester le rendu sans JavaScript activé dans le navigateur

- Vérifier le HTML brut avec curl/wget et comparer avec le rendu Googlebot

- Surveiller les Core Web Vitals (TTFB, FCP, LCP) avant et après migration

- Isoler les bibliothèques JavaScript incompatibles avec le rendu serveur

- Documenter les pages restant en CSR (dashboards, espaces clients) et leurs stratégies d'indexation alternatives

❓ Questions frequentes

Le SSR améliore-t-il forcément le classement dans Google ?

Peut-on combiner SSR et CSR sur un même site ?

Le pré-rendu statique (SSG) est-il équivalent au SSR pour le SEO ?

Le SSR ralentit-il le TTFB et les Core Web Vitals ?

Google recommande-t-il officiellement le SSR plutôt que le CSR ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/01/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.