Declaration officielle

Ce qu'il faut comprendre

Quel est le rôle de l'outil de suppression d'URL dans la Search Console ?

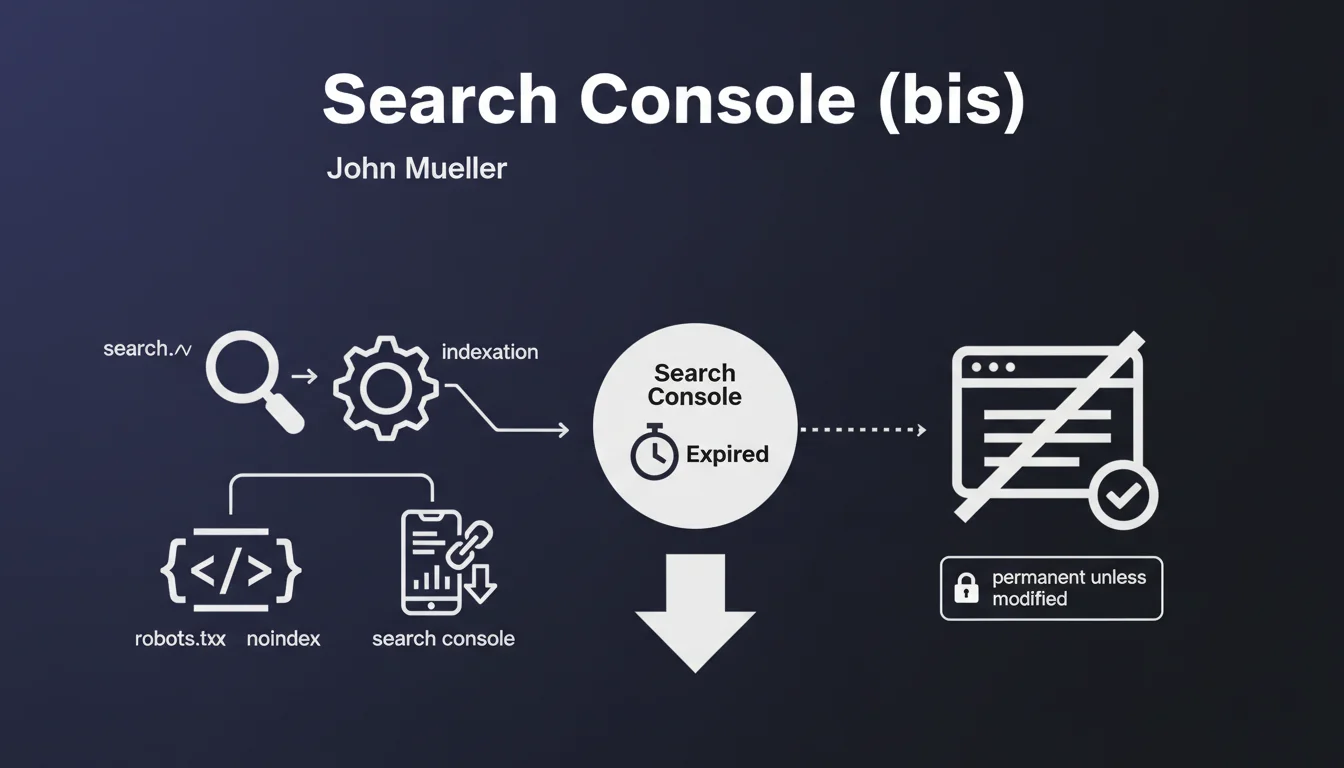

L'outil de suppression d'URL de la Google Search Console permet de demander temporairement le retrait d'une page des résultats de recherche. Cette action est généralement limitée à 90 jours, après quoi Google peut réindexer la page si elle reste accessible.

Cet outil est conçu pour des situations d'urgence, comme la suppression rapide de contenu sensible ou d'informations confidentielles. Il ne constitue pas une solution permanente de désindexation.

Que signifie concrètement le statut « Expired » ou « Obsolète » ?

Le statut « Expired » indique que la demande de suppression temporaire a expiré, mais qu'une action de désindexation permanente est désormais en place sur l'URL concernée. Cela peut être un fichier robots.txt bloquant, une balise meta robots noindex, ou un code HTTP 404/410.

Contrairement à ce que le terme pourrait suggérer, ce statut n'est pas une alerte négative. Il signifie que la page reste désindexée grâce aux mécanismes permanents que vous avez mis en place.

Pourquoi cette mention prête-t-elle à confusion ?

Le terme « Expired » évoque généralement quelque chose qui ne fonctionne plus, ce qui porte à confusion. Les SEO pourraient croire que leur demande de suppression n'est plus active et que la page va être réindexée.

En réalité, Google indique simplement que la demande temporaire n'est plus nécessaire, car une solution permanente a pris le relais. La page ne sera pas réindexée tant que vous maintenez ces directives actives.

- « Expired » ne signifie pas que la protection est terminée

- Une action permanente (noindex, robots.txt, 404) maintient la désindexation

- Le délai de 90 jours ne s'applique plus dans ce cas précis

- La page reste hors index tant que vous ne modifiez pas vos directives

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Cette clarification de John Mueller est parfaitement cohérente avec les observations des professionnels du SEO. De nombreux praticiens ont constaté que des pages avec le statut « Expired » restaient bien désindexées au-delà des 90 jours habituels.

L'explication confirme ce que les experts suspectaient : Google fait la distinction entre une suppression temporaire isolée et une suppression accompagnée de directives permanentes. C'est une logique technique solide qui évite les réindexations accidentelles.

Quelles nuances importantes faut-il apporter à cette information ?

La première nuance concerne le fichier robots.txt. Bien que Mueller mentionne cette méthode, elle n'empêche pas Google de garder l'URL dans son index avec une description générique. C'est la balise noindex qui assure une vraie désindexation.

Deuxième point crucial : cette protection ne fonctionne que si Google peut crawler régulièrement la page pour vérifier la présence des directives. Bloquer l'accès dans robots.txt tout en espérant maintenir un noindex est contradictoire et inefficace.

Dans quels cas ce mécanisme pourrait-il ne pas fonctionner comme attendu ?

Le mécanisme peut échouer si vous modifiez vos directives après avoir obtenu le statut « Expired ». Retirer un noindex ou rendre accessible une page bloquée relancera immédiatement le processus d'indexation.

Autre cas problématique : les erreurs de configuration technique. Un noindex dans un fichier JavaScript non exécuté, une directive dans une page avec un code 5xx intermittent, ou des redirections mal configurées peuvent compromettre la désindexation permanente.

Impact pratique et recommandations

Que faut-il faire concrètement pour maintenir une désindexation permanente ?

La méthode la plus fiable consiste à implémenter une balise meta robots noindex dans le code HTML de la page concernée. Cette directive doit être placée dans la section

et être accessible au crawler Google.Pour une suppression définitive, privilégiez un code HTTP 404 ou 410. Le code 410 (Gone) est particulièrement efficace car il signale explicitement que la ressource a été supprimée de manière permanente et ne reviendra pas.

- Vérifier que la balise noindex est bien présente dans le code source HTML

- S'assurer que le fichier robots.txt n'empêche pas le crawl de la page

- Contrôler dans la Search Console que le statut reste « Expired » ou « Excluded »

- Tester avec l'outil d'inspection d'URL que Google voit bien vos directives

- Documenter les URLs désindexées pour éviter toute modification accidentelle

- Monitorer régulièrement avec une recherche site:votreurl.com dans Google

Quelles erreurs critiques faut-il absolument éviter ?

L'erreur la plus fréquente consiste à bloquer une page dans robots.txt tout en espérant qu'elle soit totalement retirée de l'index. Cette approche empêche Google de voir la balise noindex et maintient l'URL visible avec une description limitée.

Autre piège : retirer prématurément la directive noindex après avoir vu le statut « Expired ». Ce statut confirme simplement que la protection fonctionne, pas qu'elle n'est plus nécessaire. Maintenez vos directives en place indéfiniment.

Comment auditer et optimiser la gestion de vos URLs désindexées ?

Mettez en place un système de monitoring qui vérifie régulièrement le statut de vos pages désindexées dans la Search Console. Créez une feuille de suivi avec les URLs, les dates, les méthodes utilisées et les statuts actuels.

Effectuez des audits trimestriels pour identifier d'éventuelles incohérences : pages qui réapparaissent dans l'index, erreurs de configuration, ou modifications non documentées de vos directives de désindexation.

💬 Commentaires (0)

Soyez le premier à commenter.