Declaration officielle

Ce qu'il faut comprendre

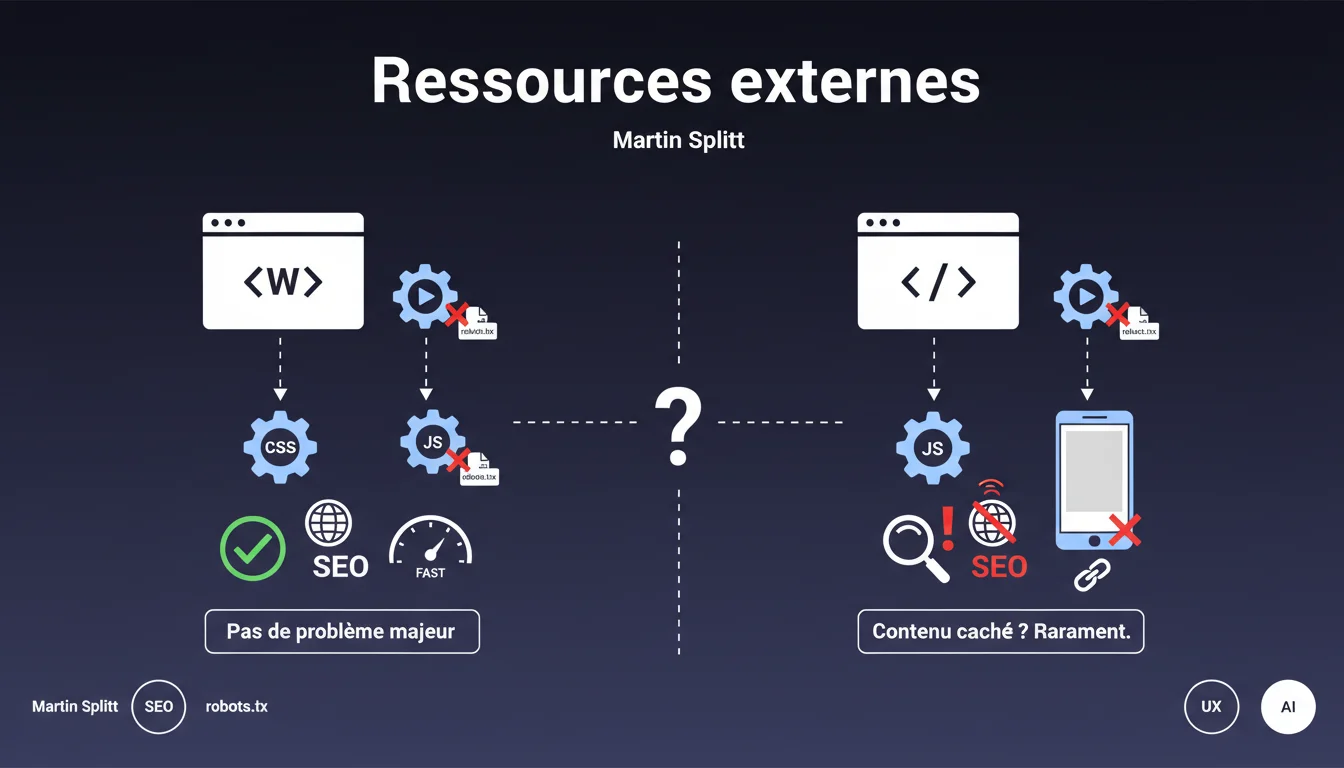

Cette déclaration aborde une situation courante : l'utilisation de fichiers JavaScript ou CSS hébergés sur des domaines externes (CDN, bibliothèques tierces, services externes). La question est de savoir si leur blocage par robots.txt impacte négativement le référencement.

Selon Martin Splitt, ingénieur chez Google, le blocage de ces ressources externes ne pose généralement pas de problème majeur. Google sait gérer les situations où certaines ressources ne sont pas accessibles lors du crawl.

Cependant, un risque existe : si ces ressources bloquées sont indispensables à l'affichage du contenu principal, le robot pourrait ne pas voir certains éléments importants. Heureusement, cette situation reste relativement rare dans la pratique.

- Le blocage de ressources externes (JS/CSS) via robots.txt n'est généralement pas problématique pour le SEO

- Le vrai risque survient quand ces ressources bloquées empêchent l'affichage du contenu aux robots

- Dans la plupart des cas, vous n'avez pas le contrôle sur le fichier robots.txt des domaines externes

- Il faut vérifier que votre contenu reste accessible même sans ces ressources externes

Avis d'un expert SEO

Cette position de Google est cohérente avec ce que nous observons sur le terrain. Le moteur de recherche a considérablement amélioré sa capacité à interpréter les pages, même avec des ressources manquantes. Il utilise des mécanismes de fallback et peut souvent déduire la structure malgré l'absence de certains fichiers.

Néanmoins, une nuance importante s'impose : l'impact réel dépend du rôle de la ressource bloquée. Si un fichier JavaScript externe gère uniquement des animations décoratives, aucun souci. En revanche, si ce même script charge dynamiquement tout le contenu textuel de votre page, vous avez un problème sérieux.

Le commentaire éditorial soulève un point crucial : vous ne contrôlez pas les robots.txt externes. C'est pourquoi il est préférable d'auto-héberger les ressources critiques ou d'avoir une stratégie de rendu qui ne dépend pas entièrement de sources tierces.

Impact pratique et recommandations

- Utilisez l'outil d'inspection d'URL de la Search Console pour vérifier comment Googlebot voit effectivement vos pages avec les ressources externes actuelles

- Identifiez les ressources externes critiques : listez tous les fichiers JS/CSS hébergés sur des domaines tiers utilisés par votre site

- Auto-hébergez les ressources essentielles : téléchargez et hébergez sur votre propre serveur les fichiers JavaScript et CSS indispensables à l'affichage du contenu principal

- Implémentez un rendu hybride : assurez-vous que le contenu textuel important est présent dans le HTML initial, sans dépendre uniquement du JavaScript pour s'afficher

- Testez avec les ressources bloquées : simulez le blocage de vos ressources externes pour vérifier que le contenu reste visible

- Surveillez les performances : l'auto-hébergement peut améliorer la vitesse de chargement, mais nécessite une optimisation appropriée (compression, cache, CDN)

- Documentez vos dépendances : maintenez un inventaire des bibliothèques tierces pour anticiper les problèmes potentiels

Ces optimisations techniques touchent à l'architecture même de votre site et nécessitent une expertise approfondie en développement web et en SEO technique. La configuration du rendu, l'audit des dépendances externes et la mise en place d'une stratégie d'hébergement optimale sont des tâches complexes qui requièrent une vision d'ensemble. Pour un accompagnement personnalisé et une mise en œuvre professionnelle de ces recommandations, l'intervention d'une agence SEO spécialisée peut vous faire gagner un temps précieux et éviter des erreurs coûteuses en visibilité.

💬 Commentaires (0)

Soyez le premier à commenter.