Declaration officielle

Ce qu'il faut comprendre

Qu'entend-on exactement par répétition dans les URL ?

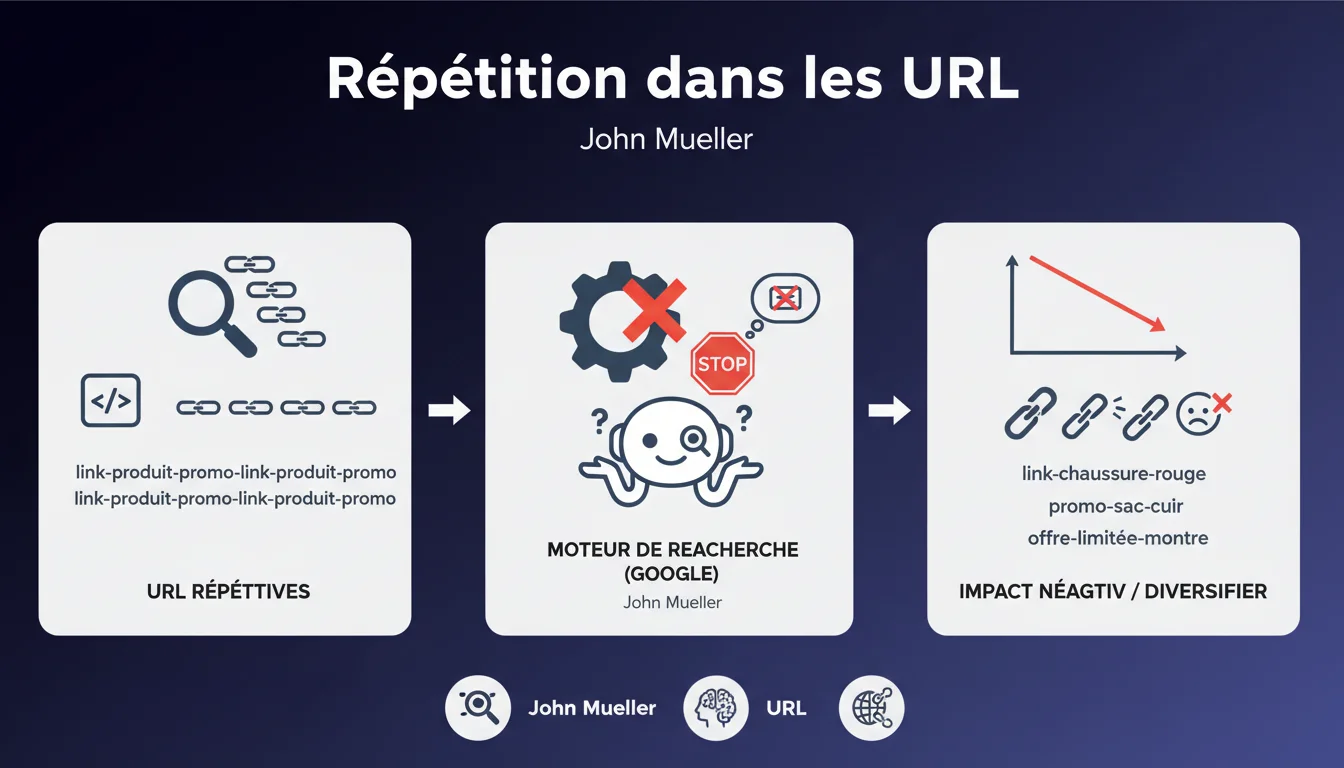

La répétition dans les URL désigne l'utilisation excessive et récurrente des mêmes schémas, mots-clés ou structures dans vos adresses web. Par exemple, si vous créez des milliers de pages avec des URL contenant systématiquement les mêmes termes comme "produit-bleu-pas-cher" déclinés à l'infini.

Google peut alors considérer ces pages comme peu différenciées et potentiellement problématiques. Le moteur pourrait ignorer certaines de ces URL lors de l'indexation, les percevant comme du contenu dupliqué ou de faible valeur.

Pourquoi Google prendrait-il cette mesure ?

L'objectif de Google est d'offrir des résultats diversifiés et pertinents à ses utilisateurs. Lorsqu'un site génère massivement des URL avec des schémas identiques, cela ressemble à des techniques de sur-optimisation ou de génération automatique de contenu.

Le moteur cherche à détecter les manipulations potentielles de son index. Des milliers d'URL similaires peuvent signaler une tentative de créer artificiellement du volume sans réelle valeur ajoutée pour l'internaute.

Dans quels cas cette situation se produit-elle concrètement ?

Cette problématique touche particulièrement les sites e-commerce avec filtres multiples, les sites immobiliers générant des combinaisons infinies, ou les plateformes avec paramètres d'URL dynamiques mal gérés.

Les sites d'annonces et les agrégateurs de contenu sont également concernés s'ils créent automatiquement des pages pour chaque variation possible d'un critère.

- Éviter les schémas d'URL trop répétitifs sur des milliers de pages

- Google peut ignorer les URL perçues comme redondantes ou de faible valeur

- La diversification des structures d'URL est essentielle pour l'indexation

- Les sites avec génération automatique massive sont particulièrement exposés

- Cette mesure vise à combattre la sur-optimisation et le spam

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. De nombreux audits SEO révèlent effectivement des problèmes d'indexation massifs sur des sites avec des structures d'URL répétitives. Les sites e-commerce avec des milliers de combinaisons de filtres voient régulièrement des portions entières de leur catalogue ignorées.

Les données de la Search Console confirment souvent ce phénomène avec des pages marquées comme "Détectée, actuellement non indexée" ou "Explorée, actuellement non indexée". La corrélation avec des schémas d'URL répétitifs est flagrante.

Quelles nuances importantes faut-il apporter à cette règle ?

Il ne s'agit pas d'interdire toute logique structurée dans vos URL. Avoir une architecture cohérente avec des catégories clairement identifiées reste une bonne pratique. Le problème survient uniquement avec la répétition excessive et mécanique.

La notion de "trop nombreuses fois" reste subjective et contextuelle. Un site de 500 pages avec quelques répétitions ne sera pas impacté de la même façon qu'un site de 500 000 pages générant mécaniquement des millions d'URL similaires.

Quels sont les signaux complémentaires que Google analyse ?

Google ne se base pas uniquement sur la structure des URL pour prendre cette décision. Le moteur évalue également la qualité du contenu, le taux de similarité entre les pages, les signaux d'engagement utilisateur et la valeur ajoutée réelle.

Des URL similaires avec du contenu véritablement unique et pertinent ont plus de chances d'être indexées. À l'inverse, des URL diversifiées mais avec du contenu dupliqué ou de faible qualité n'échapperont pas aux filtres.

Impact pratique et recommandations

Comment auditer votre site pour détecter ce problème ?

Commencez par extraire l'ensemble de vos URL depuis votre sitemap XML ou via un crawler SEO professionnel. Analysez les patterns récurrents en décomposant la structure de vos URL par segments.

Utilisez la Search Console pour identifier les pages "Détectée, actuellement non indexée". Examinez si ces pages partagent des schémas d'URL similaires. Un taux d'indexation inférieur à 70% peut signaler un problème.

Créez une analyse de fréquence des termes dans vos URL. Si certains mots apparaissent dans plus de 30-40% de vos adresses et que votre indexation est faible, c'est un signal d'alerte.

Quelles actions concrètes mettre en place pour corriger le problème ?

Pour les sites e-commerce, implémentez une gestion intelligente des facettes avec des balises canonical vers les pages principales. Bloquez l'indexation des combinaisons peu pertinentes via robots.txt ou meta robots.

Repensez votre architecture d'URL en créant des structures plus variées et sémantiquement riches. Plutôt que "/produit-rouge", "/produit-bleu", optez pour des variations comme "/collection-ecarlate", "/gamme-azur".

Utilisez les paramètres d'URL dans la Search Console pour indiquer à Google comment traiter les paramètres dynamiques et éviter l'indexation de variations inutiles.

- Auditer l'ensemble des URL de votre site pour identifier les patterns répétitifs

- Analyser le taux d'indexation dans la Search Console et corréler avec les structures d'URL

- Implémenter des canonical tags pour consolider les pages similaires

- Diversifier la nomenclature des URL en enrichissant le vocabulaire utilisé

- Bloquer l'indexation des combinaisons de filtres peu pertinentes

- Configurer correctement les paramètres d'URL dans la Search Console

- Privilégier la qualité à la quantité dans la génération de pages

- Surveiller régulièrement l'évolution du taux d'indexation après modifications

Faut-il modifier toute votre structure existante immédiatement ?

Non, procédez par étapes progressives. Commencez par identifier les sections les plus problématiques où le taux d'indexation est critique. Testez vos modifications sur un échantillon limité avant un déploiement global.

Gardez un historique des changements et mesurez l'impact sur l'indexation et le trafic. Certaines redirections 301 seront nécessaires si vous modifiez des URL existantes, ce qui peut temporairement affecter votre référencement.

💬 Commentaires (0)

Soyez le premier à commenter.