Declaration officielle

Ce qu'il faut comprendre

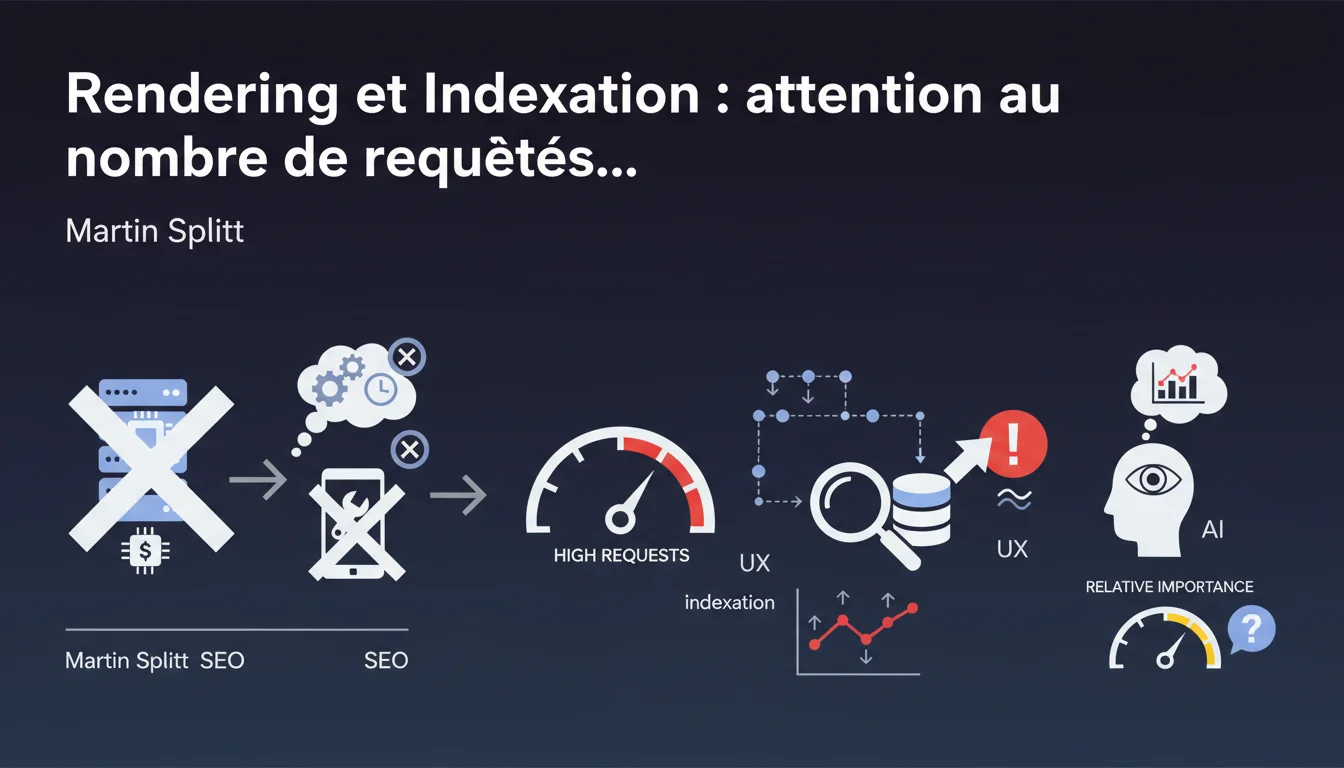

Google a clarifié sa position concernant les critères techniques prioritaires pour le rendering et l'indexation des pages web. Contrairement aux idées reçues, les équipes de Google indiquent que certains paramètres techniques ne devraient pas être une source d'inquiétude majeure pour les SEO.

Concrètement, le coût du rendu, l'utilisation du CPU ou les ressources serveur ne sont pas des facteurs limitants pour Googlebot lors du crawl et de l'indexation. Google dispose d'une infrastructure suffisamment robuste pour gérer ces aspects sans pénaliser les sites.

Le seul élément à surveiller reste le nombre de requêtes HTTP générées par une page lors de son chargement. Même ce point doit être relativisé : il ne s'agit pas d'une contrainte absolue, mais plutôt d'un indicateur d'optimisation.

- Le coût CPU et les ressources serveur ne sont pas des facteurs bloquants pour Google

- Le nombre de requêtes HTTP est le seul élément méritant une attention particulière

- Cette métrique doit être surveillée sans tomber dans l'optimisation excessive

- Google possède les capacités techniques pour gérer des pages complexes

Avis d'un expert SEO

Cette déclaration s'inscrit dans une logique de simplification des priorités SEO que Google pousse depuis plusieurs années. Elle est cohérente avec ce que nous observons sur le terrain : des sites avec des temps de rendering importants peuvent parfaitement être indexés et bien positionnés.

Cependant, il faut apporter une nuance importante. Si Google peut techniquement gérer des pages lourdes, l'expérience utilisateur reste un facteur de ranking. Les Core Web Vitals, notamment le LCP et le FID, sont directement impactés par un nombre élevé de requêtes et un rendering coûteux. La distinction est subtile : ce qui ne bloque pas l'indexation peut tout de même affecter le positionnement.

Impact pratique et recommandations

Suite à cette clarification, voici les ajustements à opérer dans votre stratégie technique SEO :

- Arrêter l'obsession du rendering parfait : ne passez plus des semaines à optimiser chaque milliseconde de rendu côté serveur uniquement pour Googlebot

- Prioriser l'expérience utilisateur : concentrez vos efforts d'optimisation sur les Core Web Vitals qui impactent réellement le ranking

- Auditer le nombre de requêtes HTTP : utilisez les outils comme Chrome DevTools pour identifier les pages générant plus de 150-200 requêtes

- Optimiser les requêtes excessives : regrouper les fichiers CSS/JS, utiliser les sprites pour les images, implémenter le lazy loading

- Surveiller sans sur-optimiser : gardez un œil sur cette métrique sans en faire une obsession paralysante

- Distinguer indexation et performance : ce qui permet l'indexation n'est pas forcément optimal pour le positionnement

- Maintenir un crawl budget sain pour les gros sites : même si Google minimise l'impact, les sites de plusieurs millions de pages doivent rester vigilants

💬 Commentaires (0)

Soyez le premier à commenter.