Declaration officielle

Ce qu'il faut comprendre

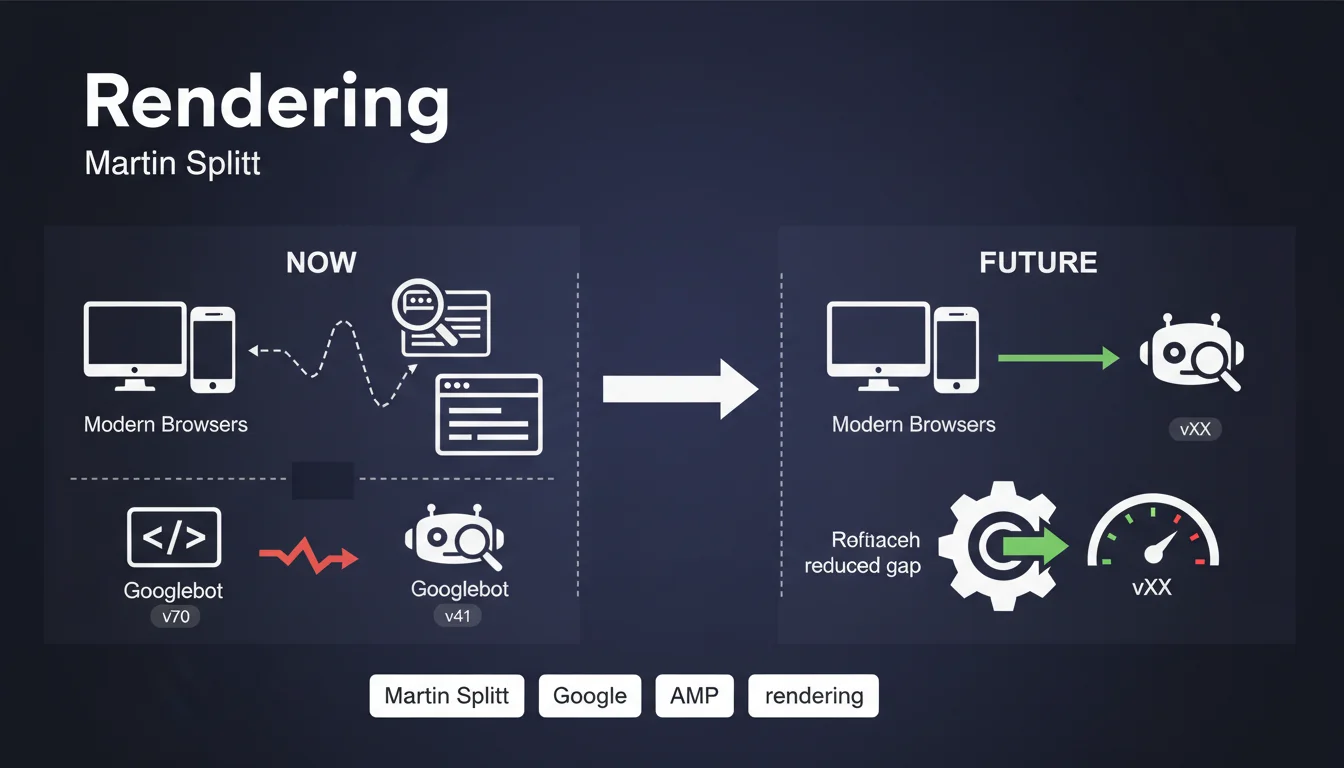

Google a clarifié sa position concernant le rendering JavaScript et les exigences pour une indexation correcte. Selon cette déclaration, il n'est pas nécessaire que toutes les fonctionnalités interactives de votre site soient pleinement opérationnelles lors du passage du bot.

Concrètement, cela signifie que des éléments comme les menus burger, les animations complexes ou certaines interactions utilisateur n'ont pas besoin de fonctionner parfaitement pour que Google comprenne et indexe votre contenu. Le moteur de recherche se concentre sur l'accès au contenu principal plutôt que sur l'expérience interactive complète.

Cependant, cette nuance cache une réalité plus complexe pour les praticiens SEO. Si le rendering côté bot diffère significativement de celui de l'utilisateur, plusieurs problèmes structurels peuvent émerger.

- Les liens non cliquables ne seront pas suivis par Googlebot, limitant le crawl de vos pages profondes

- Le contenu chargé via JavaScript doit rester accessible même si les interactions ne fonctionnent pas

- La navigation principale doit être crawlable indépendamment des fonctionnalités interactives

- Les ressources bloquées (CSS, JS) peuvent empêcher un rendering correct du contenu essentiel

Avis d'un expert SEO

Cette déclaration est globalement cohérente avec ce que nous observons sur le terrain, mais elle nécessite une interprétation nuancée. Google est effectivement tolérant sur les fonctionnalités interactives, mais cette tolérance ne s'étend pas aux éléments structurels critiques pour le SEO.

Le véritable enjeu réside dans la distinction entre fonctionnalités cosmétiques et éléments de navigation essentiels. Un carrousel d'images qui ne fonctionne pas parfaitement n'impactera pas votre indexation. En revanche, un menu de navigation entièrement dépendant de JavaScript complexe peut créer des silos d'indexation si les liens ne sont pas détectables.

Dans la pratique, nous constatons que les sites offrant un rendering cohérent entre bot et utilisateur performent mieux. Non pas parce que Google pénalise les autres, mais parce qu'ils évitent les pièges techniques qui fragmentent l'architecture du site.

Impact pratique et recommandations

- Auditez votre rendering : Utilisez l'outil d'inspection d'URL de la Search Console pour comparer ce que voit Googlebot versus ce que voit un utilisateur réel

- Testez vos liens de navigation : Assurez-vous que tous les liens structurels sont présents dans le DOM initial ou rendus de manière accessible pour Googlebot

- Priorisez le contenu critique : Titres, paragraphes principaux, liens internes et balises meta doivent être disponibles sans attendre l'exécution complète du JavaScript

- Implémentez le server-side rendering (SSR) ou la génération statique pour les pages stratégiques si votre site est en full JavaScript

- Évitez les dépendances critiques : Ne conditionnez jamais l'affichage de votre menu principal ou fil d'Ariane à des interactions JavaScript complexes

- Documentez les différences : Si le rendering bot diffère volontairement du rendering utilisateur, cartographiez ces différences pour anticiper les impacts sur le crawl

- Optimisez le temps de rendering : Réduisez le JavaScript bloquant et optimisez les ressources pour accélérer le traitement par Googlebot

- Surveillez les pages orphelines : Vérifiez régulièrement qu'aucune page importante n'est devenue inaccessible suite à des modifications JavaScript

Ces optimisations techniques autour du rendering JavaScript et de l'architecture crawlable nécessitent une expertise approfondie et une surveillance continue. Les enjeux touchent simultanément le développement front-end, l'infrastructure serveur et la stratégie SEO globale. Pour les sites complexes ou les migrations vers des frameworks JavaScript modernes, l'accompagnement par une agence SEO spécialisée permet de sécuriser ces transformations et d'éviter les pertes de visibilité qui peuvent coûter très cher en trafic organique.

💬 Commentaires (0)

Soyez le premier à commenter.