Declaration officielle

Ce qu'il faut comprendre

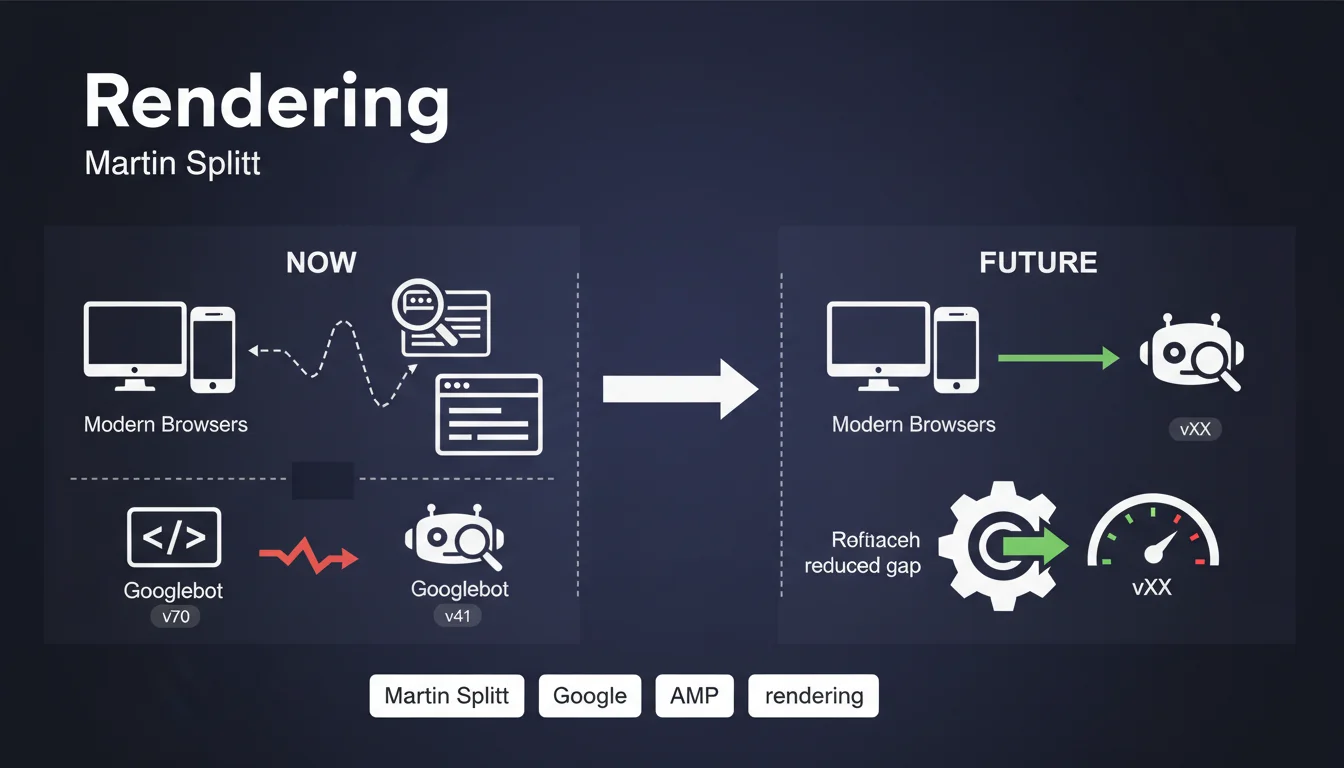

Quelle est la différence entre le rendu des navigateurs modernes et celui de Googlebot ?

Google a confirmé que Googlebot utilise une version ancienne de Chrome pour interpréter le JavaScript des pages web. Alors que les navigateurs modernes fonctionnent avec les dernières versions de Chrome (version 70+ à l'époque de cette déclaration), Googlebot utilisait l'équivalent de Chrome 41.

Cet écart technique signifie que certaines fonctionnalités JavaScript récentes ne sont pas comprises par Googlebot. Les sites utilisant des technologies de pointe peuvent donc rencontrer des problèmes d'indexation si leur contenu dépend de ces fonctionnalités modernes.

Pourquoi ce décalage technologique existe-t-il ?

Le processus de rendu JavaScript par Googlebot est extrêmement gourmand en ressources. Google doit analyser des milliards de pages, et utiliser la dernière version des technologies web pour chacune d'elles représente un défi technique et économique considérable.

Google travaille à réduire cet écart, mais l'évolution est progressive. La priorité est donnée à la stabilité et à la fiabilité du processus d'indexation plutôt qu'à l'adoption immédiate des dernières innovations.

Quels types de sites sont concernés par cette limitation ?

La majorité des sites web ne sont pas impactés par cette limitation. Les sites utilisant des frameworks JavaScript courants (React, Vue, Angular) avec des configurations standard fonctionnent généralement sans problème.

Seuls les sites exploitant les toutes dernières API JavaScript, des fonctionnalités expérimentales ou des polyfills spécifiques peuvent rencontrer des difficultés d'indexation.

- Googlebot utilise une version ancienne de Chrome pour le rendu JavaScript

- Un écart technologique existe entre navigateurs modernes et Googlebot

- Google s'engage à réduire ce fossé progressivement

- La majorité des sites ne sont pas affectés par cette limitation

- Seules les fonctionnalités JavaScript très récentes posent problème

Avis d'un expert SEO

Cette déclaration correspond-elle à la réalité observée sur le terrain ?

En tant qu'expert SEO, j'observe effectivement des problèmes d'indexation récurrents sur les sites JavaScript complexes. Cependant, dans 90% des cas, ces problèmes ne viennent pas de l'écart de version de Chrome, mais plutôt de mauvaises pratiques d'implémentation.

Les sites qui rencontrent de véritables difficultés liées à cette limitation sont généralement des applications web très avancées ou des sites exploitant des fonctionnalités expérimentales. Pour le reste, les problèmes proviennent souvent d'erreurs JavaScript, de temps de chargement excessifs ou d'une architecture mal conçue.

Quelles nuances faut-il apporter à cette information ?

Il est crucial de ne pas utiliser cette limitation comme excuse systématique pour expliquer tous les problèmes d'indexation JavaScript. Google a considérablement amélioré ses capacités de rendu depuis cette déclaration, et continue ses efforts.

Par ailleurs, même si Googlebot utilise une version ancienne de Chrome, il dispose de mécanismes spécifiques pour gérer certaines situations. L'utilisation de polyfills appropriés et de techniques de rendu hybride permet de contourner la plupart des limitations.

Dans quels cas cette limitation impacte-t-elle réellement le référencement ?

Les cas critiques concernent principalement les sites utilisant des API JavaScript natives récentes sans fallback, comme certaines fonctionnalités d'Intersection Observer avancées, Promises non polyfillées, ou des modules ES6 mal configurés.

Les Single Page Applications (SPA) mal optimisées sont également vulnérables, non pas tant à cause de la version de Chrome, mais parce qu'elles cumulent plusieurs facteurs de risque : dépendance totale au JavaScript, temps de rendu long, et absence de contenu statique.

Impact pratique et recommandations

Comment vérifier que votre site est correctement interprété par Googlebot ?

Utilisez Google Search Console et son outil d'inspection d'URL pour visualiser exactement ce que Googlebot voit. Comparez le rendu final avec ce que vous voyez dans votre navigateur moderne.

Testez également votre site avec un navigateur ancien (Chrome 41 si possible) ou utilisez des outils comme BrowserStack. Vérifiez que le contenu principal, les liens internes et les éléments structurants sont bien visibles.

Quelles sont les bonnes pratiques pour éviter les problèmes de rendu ?

Privilégiez le Server-Side Rendering (SSR) ou le rendu hybride pour les contenus critiques. Cette approche garantit que Googlebot reçoit du HTML prérendu, éliminant ainsi les problèmes liés au JavaScript.

Intégrez des polyfills appropriés pour les fonctionnalités JavaScript modernes que vous utilisez. Des services comme Polyfill.io permettent de charger automatiquement les polyfills nécessaires selon le navigateur.

Assurez-vous que votre contenu principal ne dépend pas d'interactions utilisateur (scroll infini, clics, hover) pour s'afficher. Googlebot n'interagit pas avec les pages comme un utilisateur réel.

Que faut-il implémenter concrètement sur votre site ?

- Tester systématiquement le rendu dans Google Search Console après chaque mise à jour majeure

- Implémenter du Server-Side Rendering ou de la pré-génération statique pour les contenus importants

- Ajouter les polyfills nécessaires pour les API JavaScript modernes utilisées

- Vérifier que le contenu s'affiche sans interaction utilisateur (pas de lazy loading bloquant)

- Optimiser les temps de chargement et d'exécution du JavaScript (budget < 5 secondes)

- Mettre en place un monitoring régulier de l'indexation via les rapports de couverture

- Prévoir une stratégie de fallback pour les fonctionnalités JavaScript critiques

- Documenter les dépendances techniques de votre site pour anticiper les problèmes

Le décalage technologique entre Googlebot et les navigateurs modernes existe, mais il ne concerne qu'une minorité de sites utilisant des fonctionnalités JavaScript très récentes. La clé du succès réside dans une architecture bien pensée, privilégiant le SSR ou le rendu hybride pour les contenus stratégiques.

Les optimisations techniques nécessaires pour garantir une indexation parfaite des sites JavaScript peuvent s'avérer complexes et nécessitent une expertise pointue. La mise en place d'une architecture de rendu adaptée, l'intégration de polyfills appropriés et le monitoring continu de l'indexation demandent du temps et des compétences spécialisées. Face à ces enjeux techniques, faire appel à une agence SEO expérimentée peut vous permettre de bénéficier d'un accompagnement personnalisé et d'éviter les erreurs coûteuses qui pourraient impacter durablement votre visibilité.

💬 Commentaires (0)

Soyez le premier à commenter.