Declaration officielle

Ce qu'il faut comprendre

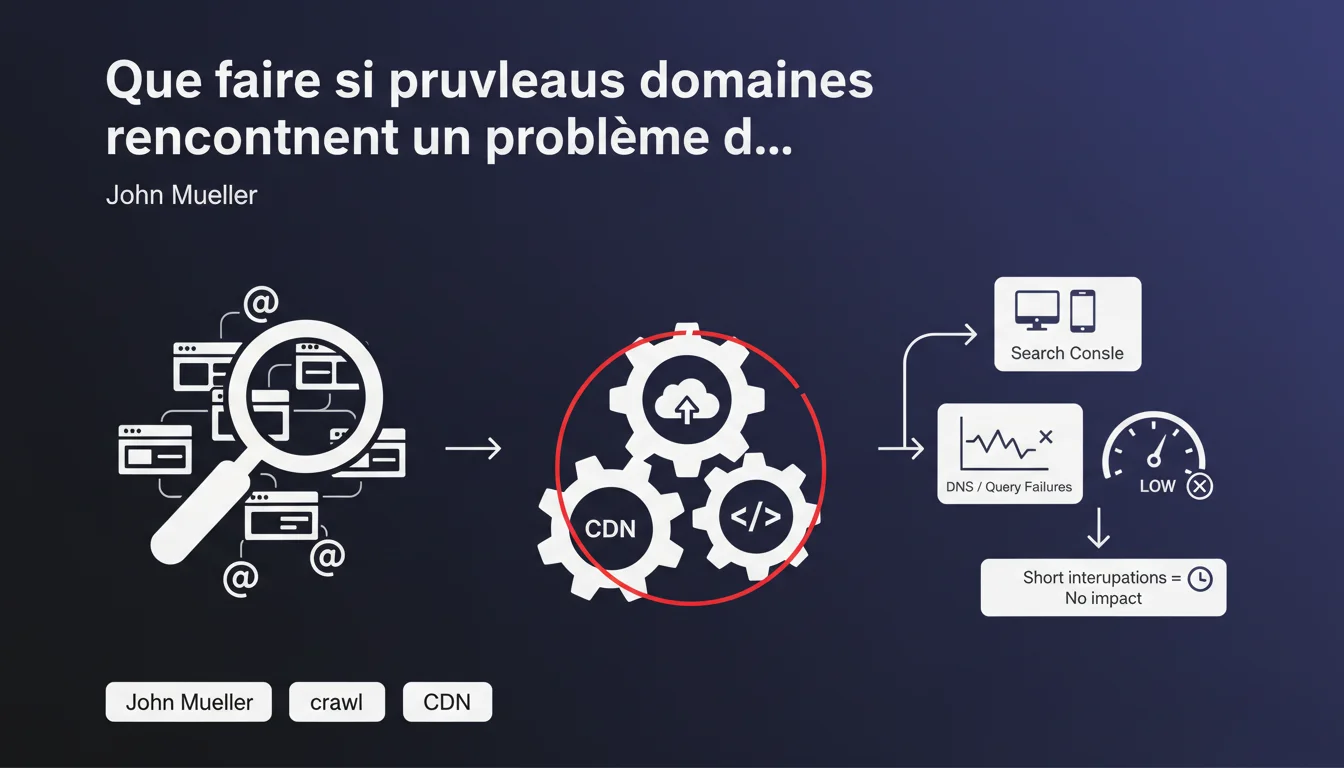

Lorsque plusieurs domaines rencontrent simultanément des problèmes de crawl, cela indique rarement une coïncidence. Google pointe vers une cause commune liée à l'infrastructure technique partagée.

Les CDN (Content Delivery Networks), les serveurs DNS mutualisés ou les hébergeurs partagés constituent souvent le point de défaillance commun. Ces infrastructures distribuées peuvent subir des pannes localisées ou générales qui impactent tous les sites qui en dépendent.

John Mueller apporte une précision rassurante : les interruptions courtes n'affectent généralement pas le classement. Googlebot est conçu pour gérer les indisponibilités temporaires et réessaiera automatiquement plus tard.

- Analyser la Search Console pour identifier les patterns d'erreurs d'exploration

- Vérifier les infrastructures partagées (CDN, DNS, hébergement) en priorité

- Examiner les échecs de requêtes DNS qui peuvent bloquer l'accès aux ressources

- Les pannes courtes ne pénalisent pas durablement le référencement

- Agir rapidement sur les problèmes persistants pour éviter une désindexation progressive

Avis d'un expert SEO

Cette déclaration est cohérente avec ce qui s'observe en pratique. Les problèmes d'exploration multi-domaines proviennent effectivement dans 80% des cas d'infrastructures partagées, notamment lors de migrations CDN ou de mises à jour système côté hébergeur.

La nuance importante concerne la définition d'une « courte interruption ». D'après les observations terrain, Google tolère bien des pannes de quelques heures. En revanche, des problèmes récurrents sur plusieurs jours, même brefs, peuvent déclencher une réduction progressive du budget crawl et impacter indirectement le positionnement des nouvelles pages.

Le conseil d'utiliser la Search Console est pertinent, mais il faut également croiser avec les logs serveur pour une vision complète. Googlebot peut échouer sans que cela soit immédiatement visible dans la console, notamment sur les problèmes de timeout ou de limitation de bande passante.

Impact pratique et recommandations

- Surveiller activement la Search Console : configurer des alertes email pour être notifié instantanément des pics d'erreurs d'exploration

- Cartographier vos dépendances techniques : lister tous les services tiers (CDN, DNS, WAF) utilisés par vos domaines

- Mettre en place un monitoring externe : utiliser des outils comme UptimeRobot ou Pingdom pour détecter les pannes avant Google

- Analyser les patterns temporels : vérifier si les erreurs coïncident avec des maintenances programmées de vos prestataires

- Tester la résolution DNS : utiliser des outils comme DNSChecker pour vérifier la propagation mondiale

- Examiner les logs serveur : croiser avec la Search Console pour identifier les requêtes Googlebot bloquées ou ralenties

- Configurer des fallbacks : prévoir des mécanismes de basculement automatique en cas de défaillance du CDN principal

- Documenter les incidents : tenir un registre des pannes pour identifier les prestataires problématiques

- Éviter les changements simultanés : ne pas migrer plusieurs services critiques en même temps

En résumé : Les problèmes d'exploration multi-domaines nécessitent une approche systémique centrée sur les infrastructures partagées. La réactivité est cruciale, mais la prévention reste la meilleure stratégie.

L'analyse technique de ces problématiques requiert une expertise pointue en architecture web et monitoring. La mise en place d'une infrastructure de surveillance robuste, le diagnostic précis des défaillances et l'optimisation des dépendances techniques peuvent s'avérer complexes à orchestrer seul. Pour les entreprises gérant plusieurs domaines stratégiques, l'accompagnement par une agence SEO spécialisée dans les aspects techniques permet de bénéficier d'une surveillance proactive, d'outils professionnels de monitoring et d'une expertise en résolution d'incidents critiques.

💬 Commentaires (0)

Soyez le premier à commenter.