Declaration officielle

Ce qu'il faut comprendre

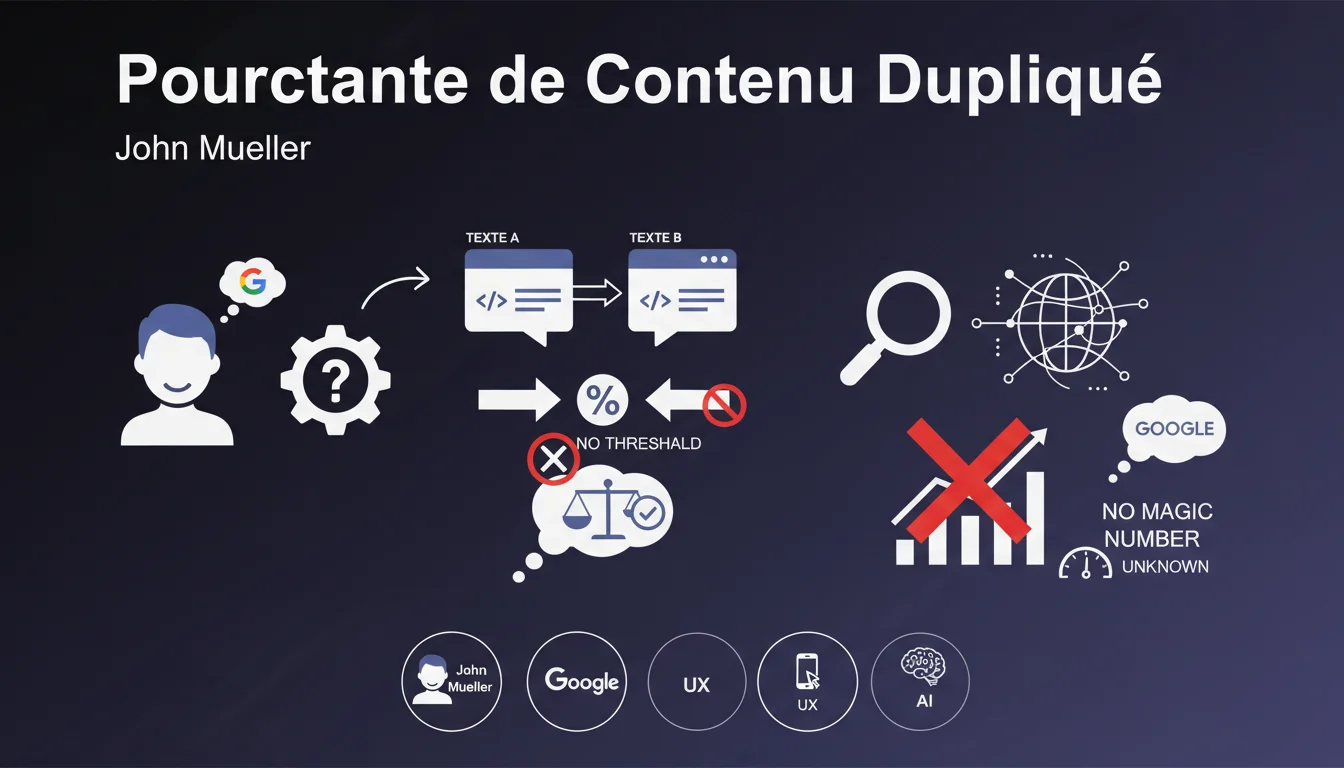

Quelle est la position officielle de Google sur les seuils de duplication ?

Google affirme clairement qu'aucun pourcentage fixe ne permet de déterminer si deux contenus sont considérés comme dupliqués. Contrairement aux idées reçues, il n'existe pas de règle absolue du type "au-delà de X% de similarité, le contenu est dupliqué".

Cette position reflète la complexité algorithmique de Google qui analyse bien plus que de simples pourcentages. L'algorithme évalue le contexte, la structure sémantique, l'intention de recherche et de nombreux autres signaux qualitatifs.

Pourquoi cette absence de seuil précis pose-t-elle question aux SEO ?

Les praticiens SEO recherchent naturellement des repères quantifiables pour auditer leurs sites. L'absence de seuil officiel crée une zone grise où chacun doit établir ses propres standards de travail.

Dans la pratique, la plupart des professionnels adoptent des seuils empiriques issus de l'expérience terrain, généralement situés entre 70% et 80% de similarité. Ces valeurs fonctionnent comme garde-fous pragmatiques.

Comment Google détecte-t-il réellement le contenu dupliqué ?

Le moteur utilise une approche multidimensionnelle qui va bien au-delà d'une simple comparaison textuelle. Il examine la structure HTML, les balises, les liens internes, la fraîcheur du contenu et son autorité.

- Analyse sémantique : Google comprend le sens et le contexte, pas seulement les mots

- Évaluation de la valeur ajoutée : deux contenus similaires peuvent coexister s'ils apportent des perspectives différentes

- Signaux de canonicalisation : les balises canonical et la structure du site influencent les décisions

- Absence de pénalité systématique : le duplicate content entraîne plutôt un filtrage qu'une sanction

- Contexte de la duplication : interne vs externe, intentionnel vs technique

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Mon expérience de 15 ans confirme totalement cette position. J'ai observé des sites avec 30% de similarité pénalisés en termes de visibilité, et d'autres avec 75% de duplication qui performaient correctement.

La différence réside dans des facteurs qualitatifs : l'autorité du domaine, la structure logique du contenu, l'expérience utilisateur globale et surtout la valeur ajoutée perçue. Un site e-commerce avec des fiches produits similaires mais bien structuré se porte mieux qu'un blog copiant du contenu même partiellement.

Quelles nuances essentielles faut-il apporter à cette déclaration ?

Bien que Google n'impose pas de seuil, cela ne signifie pas que tous les niveaux de duplication sont acceptables. L'absence de pourcentage fixe reflète une réalité : chaque situation est unique et contextualisée.

Il faut distinguer la duplication technique inévitable (pagination, filtres, versions mobiles) de la duplication éditoriale problématique. Google tolère la première avec les bons signaux techniques, mais dévalue systématiquement la seconde.

Dans quels cas cette règle flexible joue-t-elle en notre faveur ?

Cette approche nuancée avantage les sites qui travaillent sur la différenciation qualitative plutôt que quantitative. Un article reprenant 70% d'informations factuelles communes mais ajoutant 30% d'analyse unique peut surpasser un concurrent à 100% original mais superficiel.

Elle permet aussi une certaine souplesse pour les sites multilingues, les comparateurs, les agrégateurs de données ou les sites techniques où une certaine standardisation du contenu est inévitable. C'est l'exécution globale qui compte.

Impact pratique et recommandations

Comment auditer efficacement son site sans seuil de référence officiel ?

Adoptez une méthodologie à plusieurs niveaux plutôt que de vous fier à un seul pourcentage. Commencez par un crawl complet avec Screaming Frog en activant la détection de similarité interne.

Utilisez le seuil de 70% comme première alerte, mais analysez ensuite manuellement chaque cas. Vérifiez si la duplication concerne du contenu stratégique ou des éléments techniques. Priorisez les pages générant du trafic organique.

Complétez avec des outils comme Copyscape pour la duplication externe, et Search Console pour identifier les pages ignorées ou considérées comme alternatives. Croisez ces données pour avoir une vue d'ensemble.

Quelles actions concrètes mettre en place pour minimiser les risques ?

- Implémenter des balises canonical sur toutes les variations de pages (filtres, paramètres, pagination)

- Réécrire le contenu dupliqué au-delà de 70% de similarité pour les pages stratégiques

- Utiliser le noindex pour les pages techniques sans valeur SEO (résultats de recherche interne, pages de remerciement)

- Enrichir systématiquement les contenus similaires avec des éléments uniques : avis, données, analyses

- Créer des structures de contenu différenciées même pour des sujets proches

- Mettre en place une surveillance continue avec des alertes automatisées sur les nouveaux contenus publiés

- Former les équipes éditoriales aux bonnes pratiques de rédaction unique et différenciée

- Documenter les exceptions légitimes et leur justification technique pour un suivi cohérent

Quelle stratégie adopter pour transformer cette contrainte en avantage concurrentiel ?

Plutôt que de viser un pourcentage magique, concentrez-vous sur la création de contenu à forte valeur ajoutée. Analysez les contenus concurrents pour identifier les angles non traités et les opportunités de différenciation.

Développez une charte éditoriale stricte qui impose des éléments uniques obligatoires : données propriétaires, cas d'usage spécifiques, expertise métier. Cette approche qualitative vous protège naturellement de la duplication.

💬 Commentaires (0)

Soyez le premier à commenter.