Declaration officielle

Ce qu'il faut comprendre

Quelle est la véritable fonction de l'outil de gestion des paramètres d'URL ?

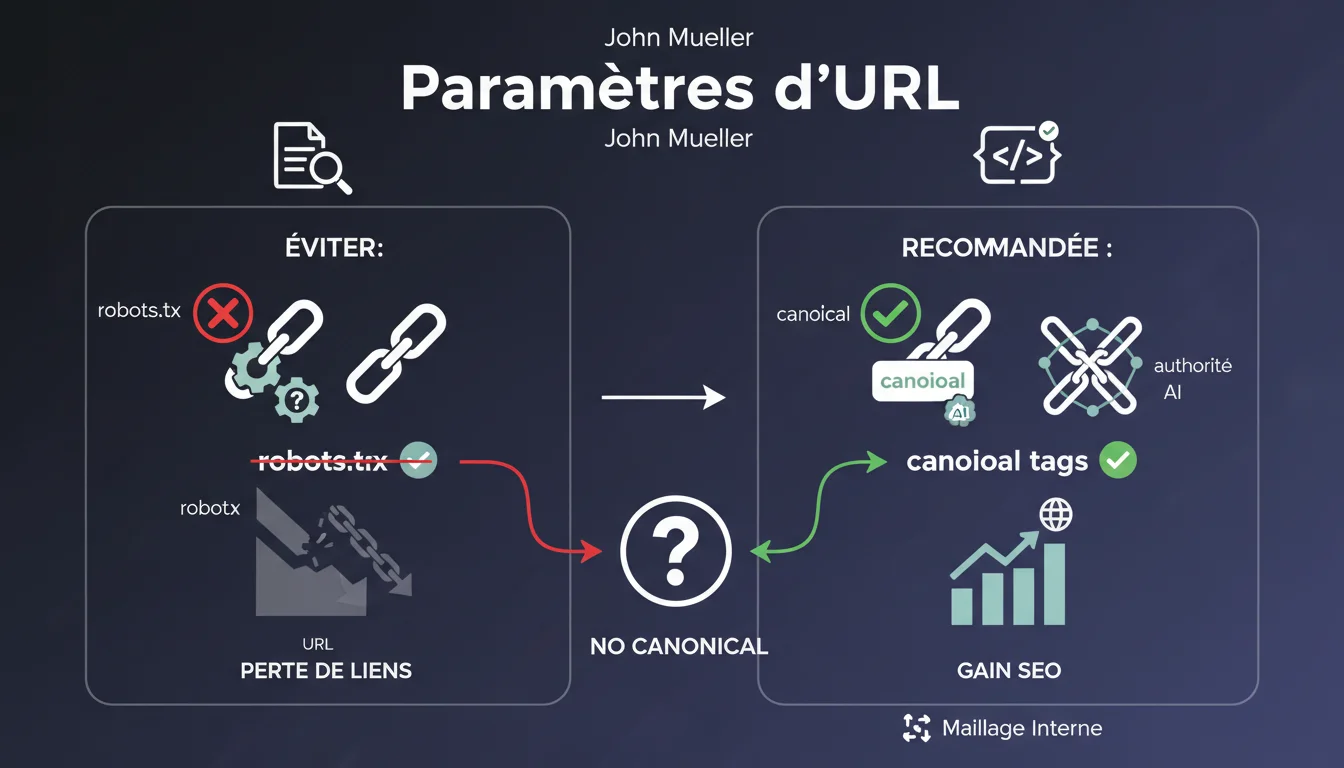

L'outil de gestion des paramètres d'URL dans la Search Console est souvent mal compris par les praticiens SEO. Il ne s'agit pas d'un outil de désindexation, mais d'un outil d'optimisation du crawl.

Son objectif principal est d'indiquer à Google comment traiter les paramètres dynamiques présents dans vos URL (comme ?id=, ?sort=, ?color=). Vous pouvez ainsi signaler quels paramètres modifient réellement le contenu de la page et lesquels ne font que filtrer ou trier sans créer de contenu unique.

Pourquoi ces URL finissent-elles par disparaître de l'index ?

Si vous indiquez à Google qu'un paramètre ne génère pas de contenu unique, le moteur va progressivement réduire le crawl de ces URL. Sans crawl régulier, ces pages finissent naturellement par sortir de l'index.

Ce processus est indirect et progressif, pas immédiat. Il résulte d'une logique d'économie de crawl plutôt que d'une action de désindexation volontaire.

Quelle est la différence avec un véritable outil de désindexation ?

Un outil de désindexation comme la balise noindex ou l'outil de suppression d'URL agit rapidement et spécifiquement. L'objectif est de retirer des pages de l'index dans un délai court.

L'outil de paramètres d'URL, lui, optimise le budget de crawl en guidant Googlebot vers les pages importantes. La désindexation éventuelle n'est qu'une conséquence secondaire.

- Fonction principale : optimiser le crawl et économiser le budget de crawl

- Effet secondaire : désindexation progressive des URL non crawlées

- Délai d'action : plusieurs semaines à plusieurs mois

- Ne remplace pas : les balises noindex ou canonical pour un contrôle précis

- Cas d'usage idéal : sites e-commerce avec nombreux filtres et paramètres

Avis d'un expert SEO

Cette approche est-elle cohérente avec les observations terrain ?

Après 15 ans de pratique SEO, cette clarification de John Mueller correspond parfaitement à ce que j'observe. L'outil de paramètres d'URL n'a jamais été un outil de désindexation rapide.

Les sites qui l'utilisent comme tel sont souvent déçus par le délai d'action. En réalité, pour désindexer rapidement, les balises noindex ou l'outil de suppression temporaire restent bien plus efficaces.

L'erreur fréquente est de confondre contrôle du crawl et contrôle de l'indexation. Ce sont deux mécanismes distincts avec des objectifs différents.

Quelles nuances faut-il apporter selon le contexte ?

Sur des petits sites avec peu de paramètres, cet outil apporte peu de valeur. Le robots.txt ou les canonicals suffisent généralement.

En revanche, sur des sites e-commerce massifs avec des milliers de combinaisons de filtres, cet outil devient stratégique. Il permet d'éviter le gaspillage du budget de crawl sur des pages à faible valeur ajoutée.

Dans quels cas cet outil devient-il contre-productif ?

Si votre site utilise des paramètres pour générer du contenu véritablement unique, indiquer à Google de les ignorer serait une erreur. Par exemple, des pages produit avec des variantes importantes selon les paramètres.

De même, sur des sites avec un excellent maillage interne et une architecture propre, l'outil apporte peu de bénéfices. Mieux vaut investir du temps sur des optimisations techniques plus impactantes.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser ses paramètres d'URL ?

Commencez par auditer vos paramètres existants. Dans la Search Console, analysez quels paramètres génèrent le plus d'URL et lesquels modifient réellement le contenu visible.

Pour chaque paramètre, posez-vous la question : ce paramètre change-t-il substantiellement le contenu de la page ou se contente-t-il de trier/filtrer ? Seuls les premiers méritent d'être crawlés activement.

Configurez l'outil en indiquant pour chaque paramètre son comportement réel (pagination, tri, filtrage, contenu unique). Soyez conservateur : en cas de doute, laissez Google décider.

Quelles erreurs critiques faut-il absolument éviter ?

Ne configurez jamais cet outil sans avoir d'abord analysé vos logs serveur. Vous devez comprendre comment Google crawle actuellement votre site avant d'intervenir.

Évitez de bloquer des paramètres qui génèrent des pages avec du contenu unique et stratégique. Par exemple, sur un site e-commerce, un paramètre de couleur peut créer des pages légitimement différentes.

Comment vérifier que votre configuration fonctionne correctement ?

Surveillez vos rapports de couverture dans la Search Console pendant 4 à 8 semaines après toute modification. Vérifiez que les pages importantes restent bien indexées.

Analysez l'évolution de votre budget de crawl via les logs serveur. Vous devriez observer une réduction du crawl sur les URL paramétrées de faible valeur et une stabilité sur les pages importantes.

- Réaliser un audit complet des paramètres d'URL présents sur le site

- Analyser les logs serveur pour comprendre le comportement de crawl actuel

- Identifier les paramètres qui ne génèrent pas de contenu unique

- Configurer l'outil de manière progressive, paramètre par paramètre

- Surveiller les rapports de couverture pendant 2 mois minimum

- Vérifier que les pages stratégiques restent bien crawlées et indexées

- Compléter avec des canonicals pour les doublons restants

- Utiliser noindex pour les désindexations rapides et ciblées

- Documenter chaque configuration pour faciliter les ajustements futurs

💬 Commentaires (0)

Soyez le premier à commenter.