Declaration officielle

Autres déclarations de cette vidéo 1 ▾

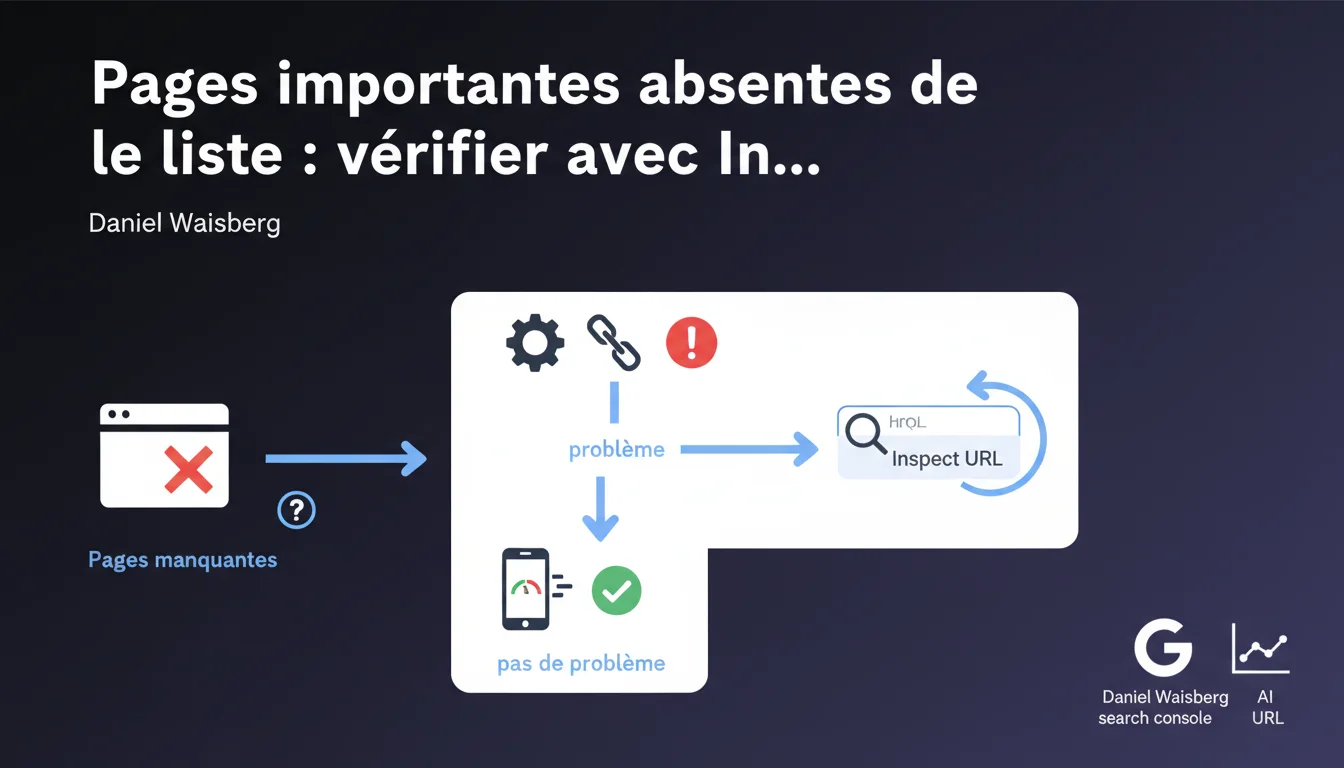

Google confirme que l'absence de pages importantes dans Search Console signale un problème d'indexation. L'outil Inspect URL reste le diagnostic de première ligne pour identifier la cause racine. Cette approche impose aux SEO de surveiller activement leur couverture d'indexation plutôt que de supposer que tout fonctionne.

Ce qu'il faut comprendre

Cette déclaration de Waisberg rappelle un principe fondamental : Search Console ne liste que ce que Google a effectivement crawlé et indexé. Si une page stratégique manque à l'appel, ce n'est pas un bug d'affichage de la console — c'est un signal d'alarme.

Le message cible les praticiens qui consultent leurs rapports d'indexation sans croiser les données avec leur inventaire de pages critiques. Trop de SEO vérifient passivement ce qui remonte, sans s'interroger sur ce qui devrait remonter.

Qu'est-ce qui provoque l'absence d'une page dans Search Console ?

Les causes sont multiples et rarement univoques. Robots.txt, noindex, canonical auto-référentiel mal configuré, soft 404, redirection en chaîne — chacun de ces facteurs peut exclure une page de l'index sans déclencher d'alerte visible dans l'interface.

Inspect URL permet de diagnostiquer en conditions réelles : Google vous dit s'il a crawlé la page, si elle est indexable, et pourquoi elle ne l'est pas si c'est le cas. C'est un feedback direct du moteur, pas une extrapolation d'un rapport générique.

Pourquoi Google insiste-t-il sur cet outil plutôt que sur les rapports globaux ?

Les rapports de couverture agrègent des milliers de pages et appliquent des seuils de significativité. Une URL isolée mais stratégique peut passer sous le radar si elle ne représente qu'une fraction du volume total.

Inspect URL force une vérification unitaire et immédiate. C'est l'équivalent d'un ping manuel : vous demandez à Google de vous dire ce qu'il voit maintenant, pas ce qu'il a vu lors du dernier crawl batch.

Quelles pages sont concernées en priorité ?

Toute page qui génère du CA, convertit, ou structure votre arborescence. Fiches produits phares, landing pages SEA réutilisées en SEO, hubs de contenu, pages catégories — ce sont elles qu'il faut monitorer en priorité.

Un site de 10 000 URLs peut dépendre de 200 pages critiques. Si l'une d'elles n'est pas indexée, l'impact business est disproportionné par rapport au volume total.

- Vérifiez l'indexation des pages stratégiques manuellement, ne vous contentez pas des rapports globaux

- Utilisez Inspect URL pour chaque page critique et archivez les résultats

- Croisez vos données Analytics avec les pages listées dans Search Console — les écarts révèlent les angles morts

- Automatisez la détection d'URLs manquantes via l'API Search Console si le volume le justifie

Avis d'un expert SEO

Cette recommandation est-elle suffisante pour diagnostiquer l'origine du problème ?

Inspect URL est un bon point de départ, mais il ne remplace pas une analyse systématique. L'outil vous dit ce que Google voit, pas toujours pourquoi il le voit ainsi. Si la page est bloquée par un robots.txt hérité, vous le saurez — mais si elle est victime d'un crawl budget insuffisant ou d'un maillage interne défaillant, Inspect URL ne vous le dira pas directement.

De plus, l'outil teste un crawl à la demande, qui peut différer du comportement du crawler en conditions réelles. Une page peut être techniquement indexable lors du test manuel, mais ignorée en pratique si elle n'est jamais crawlée spontanément. [A vérifier] : Google ne précise pas si le test live d'Inspect URL reflète fidèlement les priorités du crawl automatisé.

Quelles sont les limites de l'outil dans un contexte de site complexe ?

Sur un site de plusieurs milliers de pages, vérifier manuellement chaque URL stratégique devient impraticable. L'API Search Console permet d'automatiser ces vérifications, mais elle impose un quota quotidien et un délai de réponse — ce qui complique le monitoring temps réel.

Autre limite : Inspect URL ne détecte pas les problèmes de cannibalisation ou de contenu dupliqué entre plusieurs URLs. Si votre page stratégique est indexée mais que Google préfère afficher une variante concurrente, l'outil ne vous alertera pas. Il faut croiser avec les requêtes de marque et les logs serveur pour détecter ces cas.

Dans quels cas cette approche ne suffit-elle pas ?

Si votre problème d'indexation est structurel — par exemple un site mal maillé, avec peu de backlinks internes pointant vers les pages stratégiques — tester une URL unitairement ne changera rien. Google peut techniquement indexer la page, mais ne pas la crawler assez souvent pour la maintenir à jour.

Dans ce cas, il faut remonter en amont : revoir l'architecture du site, renforcer le maillage interne, optimiser le crawl budget via robots.txt et XML sitemaps. Inspect URL est un diagnostic, pas un remède.

Impact pratique et recommandations

Que faut-il faire concrètement pour identifier les pages manquantes ?

Croisez vos sources de données : sortez la liste de vos URLs stratégiques depuis votre CMS, votre base produit ou votre sitemap XML. Comparez-la avec les URLs listées dans le rapport de couverture de Search Console. Les absences révèlent les angles morts.

Ensuite, pour chaque URL manquante, passez par Inspect URL. Google vous dira si la page a été crawlée, si elle est indexable, et si elle est effectivement indexée. Notez la raison d'exclusion si elle apparaît — c'est cette raison qui oriente l'action corrective.

Quelles erreurs éviter lors du diagnostic ?

Ne vous contentez pas de corriger l'URL isolée sans comprendre la cause racine. Si 10 pages stratégiques sont bloquées par le même robots.txt ou la même balise noindex héritée d'un template, corriger une seule page ne résout rien. Identifiez le pattern, pas juste le symptôme.

Autre erreur fréquente : demander une réindexation via Inspect URL sans avoir corrigé le problème sous-jacent. Google recrawlera la page, constatera que le problème persiste, et vous serez au même point — sauf que vous aurez consommé votre quota de demandes de réindexation.

Comment vérifier que votre site est conforme et que les pages critiques sont bien indexées ?

Mettez en place un monitoring récurrent des URLs stratégiques. Soit manuellement via un tableur où vous archivez les résultats d'Inspect URL chaque mois, soit via l'API Search Console si vous avez les ressources techniques pour automatiser.

Croisez systématiquement avec vos logs serveur : une page indexée mais jamais crawlée depuis 3 mois est un signal faible. Elle risque de sortir de l'index si Google ne la revisite pas régulièrement.

- Extraire la liste complète des URLs stratégiques depuis votre CMS ou votre sitemap

- Comparer cette liste avec les URLs présentes dans le rapport de couverture Search Console

- Pour chaque URL absente, utiliser Inspect URL et archiver la raison d'exclusion

- Corriger les problèmes techniques identifiés (robots.txt, balises meta, redirections)

- Demander une réindexation via Inspect URL uniquement après correction

- Automatiser le monitoring des pages critiques via l'API Search Console si possible

- Croiser les données Search Console avec les logs serveur pour détecter les URLs indexées mais jamais crawlées

❓ Questions frequentes

Inspect URL remplace-t-il les rapports de couverture dans Search Console ?

Une page peut-elle être indexée sans apparaître dans Search Console ?

Combien de demandes de réindexation via Inspect URL puis-je faire par jour ?

Si Inspect URL dit qu'une page est indexable, pourquoi n'apparaît-elle pas dans l'index ?

Faut-il surveiller toutes les pages du site ou seulement les pages stratégiques ?

🎥 De la même vidéo 1

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 10/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.