Declaration officielle

Ce qu'il faut comprendre

Pourquoi Google recommande-t-il de ne pas indexer les résultats de recherche interne ?

Les pages de résultats de recherche interne sont générées dynamiquement lorsqu'un visiteur utilise le moteur de recherche de votre site. Chaque requête crée potentiellement une URL unique avec des paramètres spécifiques.

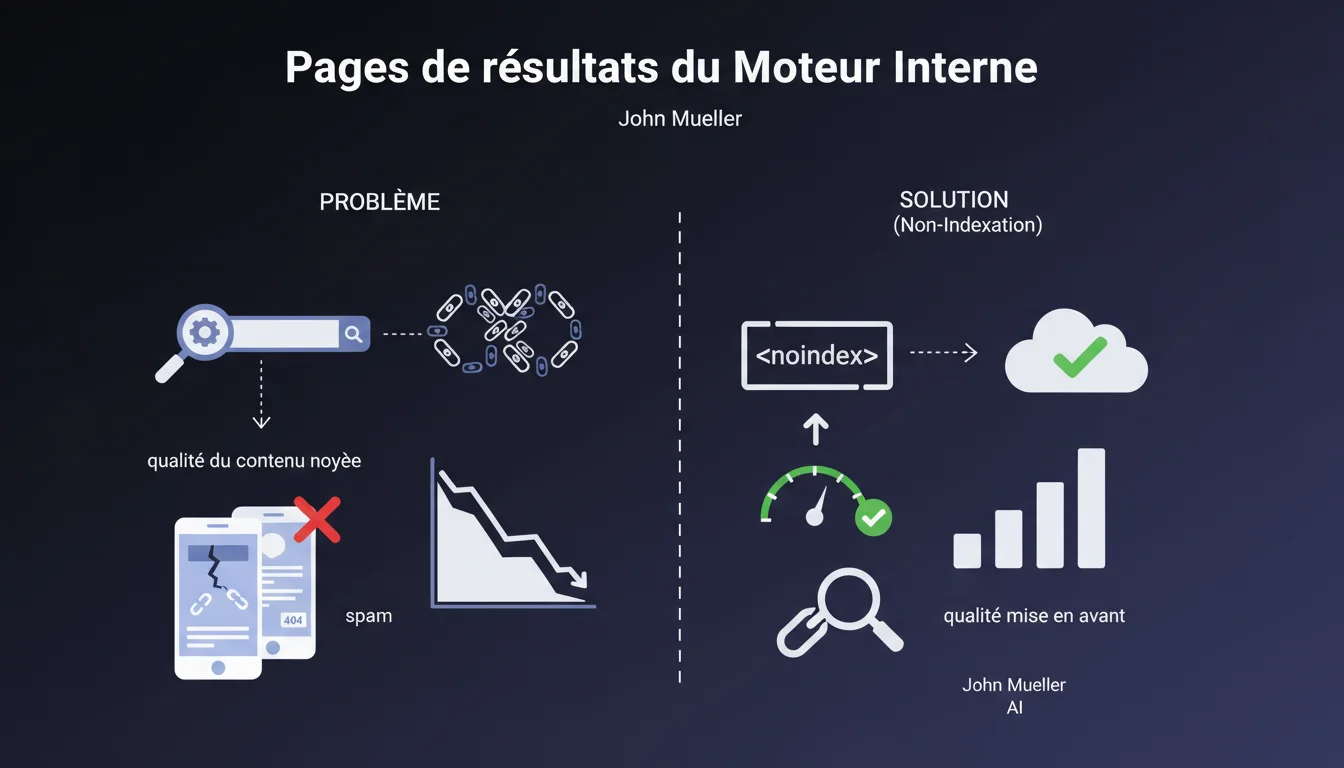

Google considère que ces pages posent un problème de dilution du contenu. Elles ne créent pas de valeur ajoutée pour les internautes venant des moteurs de recherche, mais génèrent un nombre quasi-infini de variations d'URLs. Le risque principal est de noyer vos pages de contenu de qualité dans une masse de pages générées automatiquement qui se cannibalisent mutuellement.

Quelle est la différence avec le spam selon Google ?

John Mueller précise explicitement qu'il ne s'agit pas d'une problématique de spam. Google ne pénalisera pas votre site pour cela, mais ces pages créent une inefficacité dans le crawl.

Le moteur de recherche va perdre du temps et des ressources à explorer des milliers de variations sans intérêt. Cela peut réduire la fréquence d'exploration de vos pages réellement importantes et impacter négativement votre visibilité globale.

Quels sont les risques concrets pour votre SEO ?

- Gaspillage du budget crawl : Googlebot explore des pages inutiles au lieu de vos contenus stratégiques

- Dilution du PageRank interne : le jus SEO se disperse sur des milliers d'URLs sans valeur

- Cannibalisation des mots-clés : des pages de résultats similaires entrent en compétition

- Indexation inefficace : Google peut avoir du mal à identifier vos pages prioritaires

- Duplicate content : des résultats similaires avec des paramètres différents créent du contenu dupliqué

Avis d'un expert SEO

Cette recommandation s'applique-t-elle à tous les types de sites ?

La directive de Google est particulièrement pertinente pour les sites de taille moyenne et grande avec un moteur de recherche interne actif. Les sites e-commerce, les portails d'emploi, les sites immobiliers ou les plateformes de contenu sont les premiers concernés.

Pour les petits sites avec un moteur de recherche basique et peu utilisé, l'impact sera négligeable. Cependant, bloquer ces pages reste une bonne pratique préventive qui ne présente aucun inconvénient.

Existe-t-il des cas où l'indexation peut être bénéfique ?

Dans de rares cas spécifiques, certaines pages de résultats peuvent mériter l'indexation. Par exemple, une page regroupant tous les produits d'une catégorie via une recherche peut avoir de la valeur si elle est correctement optimisée et offre un contenu unique.

Cependant, ces cas doivent être traités comme des pages catégories traditionnelles, avec des URLs propres, du contenu éditorial ajouté et une canonicalisation appropriée. Il ne s'agit plus vraiment de pages de résultats dynamiques classiques.

Comment cette directive s'inscrit-elle dans une stratégie SEO globale ?

Le blocage des résultats de recherche interne fait partie d'une gestion rigoureuse du crawl budget. C'est un élément d'une stratégie plus large visant à guider efficacement les robots vers vos contenus prioritaires.

Cette approche doit être cohérente avec d'autres optimisations : pagination maîtrisée, facettes filtrées correctement, paramètres d'URL gérés via la Search Console, et architecture de liens internes optimisée. L'objectif global est de maximiser l'efficacité de chaque visite de Googlebot.

Impact pratique et recommandations

Comment bloquer efficacement les pages de résultats de recherche interne ?

La méthode recommandée consiste à utiliser le fichier robots.txt pour empêcher l'exploration de ces URLs. Identifiez d'abord le paramètre utilisé par votre moteur interne (souvent ?s=, ?search=, ?q=, ou ?recherche=).

Ajoutez ensuite une directive de type : Disallow: /*?s= ou Disallow: /search? selon votre configuration. Cette approche empêche dès le départ l'exploration et l'indexation.

Alternativement, vous pouvez utiliser la balise meta robots noindex sur ces pages, mais cela nécessite que Googlebot les explore d'abord. Le robots.txt est donc plus efficient pour préserver votre budget crawl.

Quelles erreurs courantes faut-il absolument éviter ?

L'erreur la plus fréquente est de bloquer trop largement et d'empêcher l'accès à des sections importantes du site. Testez minutieusement vos directives robots.txt avant la mise en production.

Autre piège : ne pas identifier tous les paramètres utilisés par votre moteur de recherche. Certains sites utilisent plusieurs syntaxes d'URL ou des paramètres multiples qui doivent tous être bloqués.

Enfin, attention à ne pas confondre pages de résultats internes et pages de catégories légitimes. Les catégories naturelles de votre site doivent absolument rester indexables.

Comment vérifier que votre configuration est correcte ?

- Testez votre fichier robots.txt avec l'outil de test de Google Search Console

- Vérifiez dans la Search Console (section Couverture) qu'aucune page de résultat n'apparaît dans l'index

- Analysez vos logs serveur pour confirmer que Googlebot ne crawle plus ces URLs

- Utilisez la commande site:votredomaine.com inurl:search dans Google pour détecter d'éventuelles pages indexées

- Configurez des alertes dans votre outil d'analytics pour monitorer le trafic organique vers ces pages

- Documentez les paramètres bloqués pour les futures évolutions du site

- Réalisez un audit semestriel pour vérifier que de nouveaux paramètres n'ont pas été introduits

Le blocage des pages de résultats de recherche interne est une optimisation SEO fondamentale pour tout site disposant d'un moteur de recherche. Cette mesure protège votre budget crawl, évite la dilution de votre PageRank et prévient la cannibalisation entre pages.

La mise en œuvre requiert une analyse technique précise de votre architecture et une configuration rigoureuse du robots.txt. Ces optimisations techniques, bien que cruciales, peuvent s'avérer complexes à implémenter correctement, surtout sur des sites volumineux avec des architectures sophistiquées. Pour garantir une configuration optimale sans risque d'erreur et bénéficier d'un audit complet de votre crawl budget, l'accompagnement d'une agence SEO spécialisée peut vous faire gagner un temps précieux et sécuriser vos performances organiques sur le long terme.

💬 Commentaires (0)

Soyez le premier à commenter.