Declaration officielle

Autres déclarations de cette vidéo 5 ▾

- □ L'API de vérification Search Console change-t-elle vraiment la gestion de propriété à grande échelle ?

- □ Comment déboguer efficacement les Core Web Vitals avec les DevTools du navigateur ?

- □ Comment positionner votre contenu sur les nouvelles surfaces de recherche de Google ?

- □ Search Labs : l'IA générative de Google va-t-elle redéfinir les stratégies SEO ?

- □ Google fait-il vraiment évoluer ses standards de recherche ou est-ce du vent ?

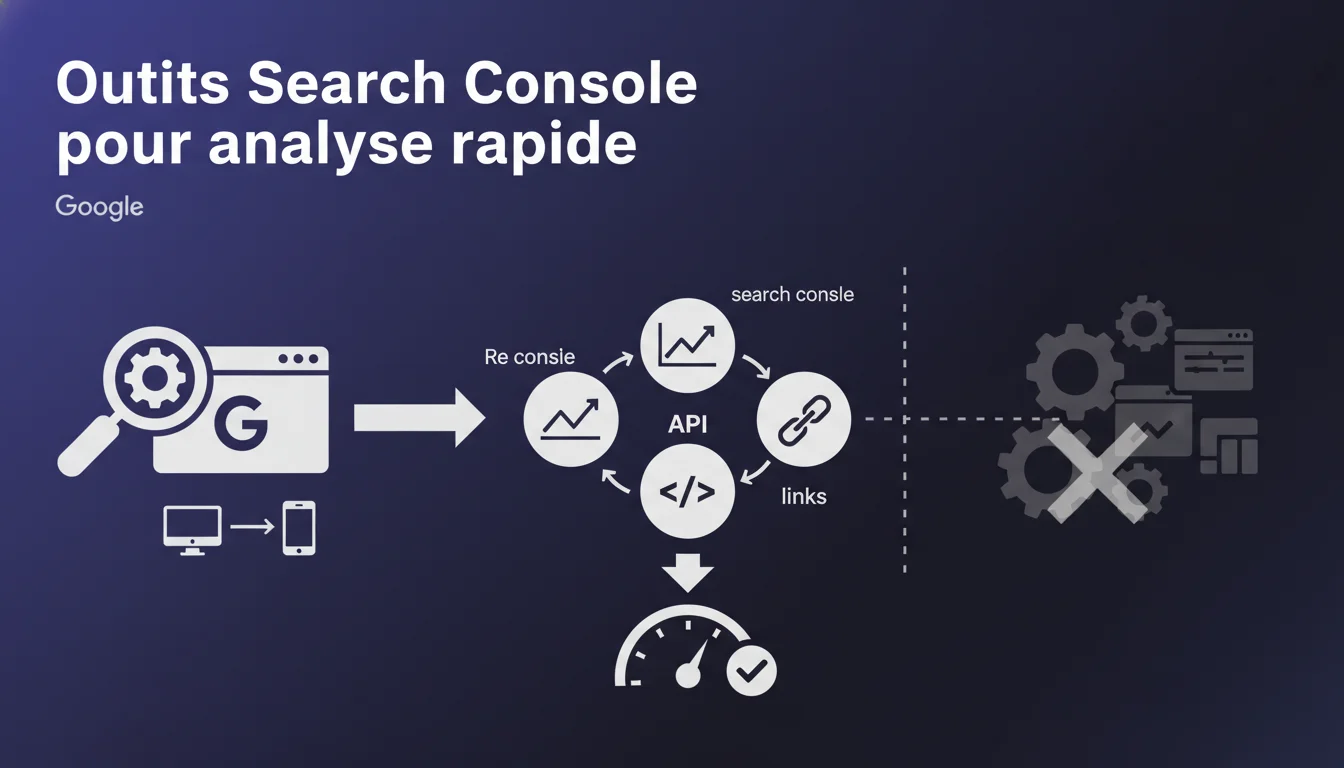

Google recommande d'utiliser le navigateur et la Search Console comme premiers outils d'analyse avant de recourir à des solutions tierces plus sophistiquées. Cette approche permet d'obtenir une vue « officielle » et non filtrée des données de crawl et d'indexation directement depuis la source. Soyons honnêtes : c'est aussi une façon de recentrer l'attention sur les outils propriétaires Google.

Ce qu'il faut comprendre

Google suggère une approche méthodique : diagnostiquer d'abord avec les outils natifs avant de déployer l'artillerie lourde. Cette recommandation s'inscrit dans une logique pragmatique — Search Console offre un accès direct aux données de crawl, d'indexation et de performances que Googlebot lui-même utilise.

Le message sous-jacent ? Les outils tiers, aussi performants soient-ils, ne peuvent que simuler ou extrapoler ce que Google voit réellement. Partir de la source évite les biais d'interprétation.

Pourquoi privilégier Search Console en première intention ?

La Search Console fournit des données non intermédiées : rapports d'erreurs d'exploration, couverture d'index, problèmes d'expérience de page. Aucun outil externe ne peut affirmer avec certitude ce que Googlebot a crawlé ou pourquoi une URL n'est pas indexée — seule la GSC le peut.

Le navigateur, quant à lui, permet de vérifier rapidement le rendu côté client, la vitesse perçue, les ressources bloquées. Couplé à l'onglet Réseau des DevTools, c'est un duo redoutablement efficace pour identifier les blocages évidents avant même d'ouvrir Screaming Frog.

Quels sont les risques d'une analyse uniquement basée sur des outils tiers ?

Les outils de crawl traditionnels (Screaming Frog, Oncrawl, Botify) simulent un robot mais ne reproduisent pas exactement le comportement de Googlebot. Ils peuvent manquer des contenus chargés en JavaScript, mal interpréter des redirections conditionnelles ou ignorer des directives spécifiques.

Résultat : des diagnostics parfois décalés de la réalité. Si vous optimisez sur la base d'un crawl qui ne reflète pas ce que Google indexe vraiment, vous risquez de corriger des problèmes inexistants et d'ignorer les vrais blocages.

Est-ce que cela signifie qu'il faut se passer des outils tiers ?

Non. Google ne dit pas que les outils tiers sont inutiles — il suggère une hiérarchie. Commencer par la GSC permet de poser un diagnostic fondé sur la réalité technique de Google, puis d'approfondir avec des outils spécialisés pour l'analyse concurrentielle, le suivi de positions, l'audit de logs ou le monitoring en continu.

Les outils externes apportent des fonctionnalités que la GSC n'offre pas : analyse de logs serveur, détection de contenu dupliqué interne, extraction de données structurées en masse, suivi historique granulaire. Mais ils ne remplacent pas l'autorité de la source.

- Search Console = vision officielle de Google sur votre site (crawl, indexation, erreurs)

- Navigateur + DevTools = validation rapide du rendu et de la performance perçue

- Outils tiers = approfondissement et automatisation pour des analyses que la GSC ne couvre pas

- Ne jamais présumer qu'un outil externe voit exactement ce que Googlebot indexe

Avis d'un expert SEO

Cette recommandation est-elle vraiment nouvelle ou juste un rappel ?

C'est avant tout un rappel pédagogique. Les praticiens expérimentés savent depuis longtemps que la GSC est la référence pour tout diagnostic d'indexation. Mais beaucoup de juniors ou d'équipes habituées aux dashboards tiers négligent cette étape initiale et foncent directement dans les outils payants.

Google recentre le débat : avant de souscrire à un énième SaaS SEO, posez-vous la question — qu'est-ce que Google lui-même me dit sur mon site ? Si vous ignorez les alertes de la GSC, aucun outil tiers ne les résoudra à votre place.

Quelles nuances faut-il apporter à cette déclaration ?

La GSC a des limites bien documentées. Les données de requêtes sont échantillonnées, les métriques de crawl agrégées, l'historique limité à 16 mois. Pour un site de plusieurs millions de pages, un audit logs serveur est indispensable — la GSC ne vous dira jamais précisément quelles sections sont sous-crawlées ou ignorées.

De même, le navigateur seul ne suffit pas pour tester le rendu à grande échelle. [A vérifier] : Google ne précise pas comment gérer l'audit de sites dynamiques complexes où le contenu varie selon la géolocalisation, la session utilisateur ou les A/B tests. Dans ces cas, une approche hybride (GSC + logs + tests automatisés) reste incontournable.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Sur des sites à fort volume (e-commerce multi-pays, médias avec des millions d'articles), la GSC atteint ses limites. L'analyse de logs devient alors le seul moyen de cartographier le crawl réel et d'identifier les zones négligées par Googlebot.

Pour du monitoring concurrentiel ou du suivi de SERP, la GSC ne sert à rien : elle ne vous dira jamais où vos concurrents se positionnent ni quels mots-clés ils captent. Là, les outils tiers (SEMrush, Ahrefs, Sistrix) sont irremplaçables.

Impact pratique et recommandations

Que faut-il faire concrètement pour suivre cette recommandation ?

Intégrez la GSC comme première étape systématique de tout audit SEO. Avant d'ouvrir Screaming Frog ou de lancer un crawl massif, consultez les rapports de couverture, les erreurs d'exploration, les Core Web Vitals, les actions manuelles éventuelles.

Utilisez le test d'URL en direct pour vérifier exactement comment Googlebot rend une page problématique. Comparez avec ce que votre navigateur affiche. Si un écart existe, vous avez un point de blocage à corriger — inutile de chercher plus loin tant que ce delta persiste.

Quelles erreurs éviter lors de cette phase d'analyse ?

Ne vous contentez pas d'un coup d'œil rapide sur le tableau de bord général. Creusez les rapports granulaires : pages exclues, redirections en chaîne, soft 404, erreurs serveur. Beaucoup d'audits ratent des signaux faibles parce qu'ils ne descendent pas au niveau des sous-catégories de la GSC.

Autre piège : ignorer les données d'expérience utilisateur (Core Web Vitals). Google les lie désormais explicitement au classement. Si votre CLS explose ou votre LCP dépasse 4 secondes, aucune optimisation on-page classique ne compensera.

Comment vérifier que cette approche suffit avant d'aller plus loin ?

Si après un passage en revue de la GSC et des DevTools vous identifiez des blocages majeurs (robots.txt mal configuré, noindex accidentel, rendu JavaScript défaillant, erreurs 5xx récurrentes), corrigez-les d'abord. Attendez que Google recrawle et réindexe.

Ce n'est que si tout semble propre côté GSC mais que les performances SEO restent médiocres qu'il faut sortir l'artillerie : audit de logs, analyse sémantique, crawl profond, analyse de la concurrence. Ne brûlez pas les étapes — vous risquez de noyer les vrais problèmes dans un océan de données secondaires.

- Consulter systématiquement la Search Console avant tout audit SEO tiers

- Utiliser le test d'URL en direct pour comparer rendu Googlebot vs navigateur

- Vérifier les Core Web Vitals et corriger les métriques critiques avant toute optimisation avancée

- Ne pas ignorer les alertes de couverture d'index (pages exclues, erreurs serveur)

- Croiser les données GSC avec un crawl externe uniquement si les diagnostics initiaux sont insuffisants

- Pour les sites à fort volume, compléter la GSC par une analyse de logs serveur

❓ Questions frequentes

La Search Console suffit-elle pour un audit SEO complet ?

Pourquoi Google insiste-t-il sur le navigateur comme outil d'analyse ?

Les outils tiers comme Screaming Frog sont-ils devenus obsolètes ?

Faut-il attendre les mises à jour de la GSC avant d'agir ?

Que faire si la GSC et un outil tiers donnent des résultats contradictoires ?

🎥 De la même vidéo 5

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/12/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.