Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Les Core Web Vitals influencent-ils vraiment le classement du contenu utile ?

- □ La compatibilité mobile n'est-elle vraiment plus un facteur de classement Google ?

- □ Pourquoi Google abandonne-t-il le FID au profit de l'INP dans les Core Web Vitals ?

- □ Les Core Web Vitals ne suffisent-ils vraiment pas à garantir une bonne expérience utilisateur ?

- □ Search Generative Experience (SGE) : comment l'IA générative de Google va-t-elle bouleverser les SERPs ?

- □ Le rich results test avec édition de code change-t-il vraiment la donne pour tester vos données structurées ?

- □ Search Console Insights sans Google Analytics : la fin d'une dépendance contraignante ?

- □ Le rapport d'indexation vidéo de Google révèle-t-il enfin les vrais problèmes bloquants ?

- □ Faut-il vraiment arrêter d'utiliser le ping endpoint pour soumettre vos sitemaps ?

- □ Le nouveau rapport de spam de Google change-t-il vraiment la donne pour les SEO ?

- □ Faut-il revoir sa stratégie de noms de domaine maintenant que le .ai devient un ccTLD générique ?

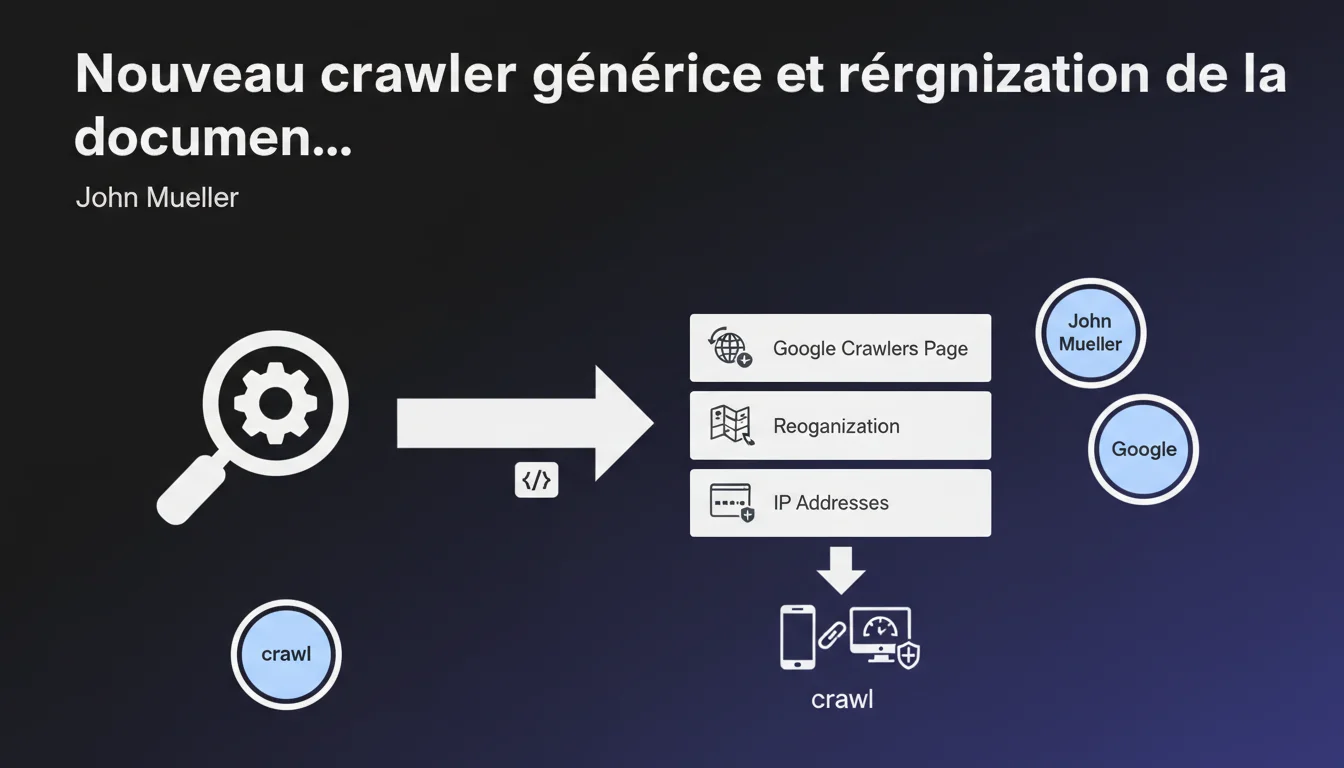

Google a officialisé l'existence d'un nouveau crawler générique dans sa documentation, réorganisé la liste complète de ses robots d'exploration et publié les plages d'adresses IP utilisées. Cette transparence accrue permet aux SEO de mieux identifier le trafic Google légitime et d'affiner leurs stratégies de gestion du crawl budget.

Ce qu'il faut comprendre

Qu'est-ce que ce nouveau crawler générique et à quoi sert-il ?

Google a ajouté à sa documentation officielle un nouveau crawler générique dont l'existence n'était pas formellement documentée jusqu'à présent. Ce robot vient compléter l'écosystème déjà complexe des crawlers Google — Googlebot pour le web classique, Googlebot pour smartphone, Google-InspectionTool, etc.

La fonction exacte de ce crawler générique reste floue dans la communication de Google. Il pourrait servir à des tâches d'exploration spécifiques non couvertes par les autres bots, ou à des tests internes. Ce qui compte vraiment ? Sa documentation officielle change la donne pour l'analyse des logs serveur.

Pourquoi Google publie-t-il maintenant ses adresses IP ?

Jusqu'ici, identifier avec certitude le trafic Google nécessitait une vérification DNS inverse — un processus technique pas toujours fiable. En publiant les plages IP officielles de ses crawlers, Google permet une identification plus directe et plus sûre.

Cette transparence répond à une demande ancienne des professionnels SEO et des équipes techniques. Elle facilite la configuration de règles firewall, l'analyse de logs et la détection d'éventuels crawlers se faisant passer pour Googlebot.

Qu'est-ce qui a changé dans la documentation des crawlers ?

La page de référence sur les crawlers Google a été restructurée et clarifiée. Les différents robots sont désormais mieux catégorisés, avec des descriptions plus précises de leurs fonctions respectives.

Cette réorganisation rend la documentation plus accessible, mais elle ne change rien au fonctionnement technique des crawlers eux-mêmes. C'est avant tout une amélioration de la transparence documentaire.

- Nouveau crawler générique documenté — fonction exacte encore floue

- Publication des plages IP officielles pour tous les crawlers Google

- Réorganisation de la documentation pour plus de clarté

- Meilleure identification du trafic Google légitime dans les logs serveur

- Facilitation des configurations firewall et des règles de sécurité

Avis d'un expert SEO

Cette transparence change-t-elle vraiment la donne pour les SEO ?

Oui et non. La publication des IP est un vrai progrès — elle simplifie l'analyse des logs et réduit les risques de blocage accidentel de Googlebot. Mais concrètement, les SEO qui travaillaient déjà sérieusement sur le crawl budget utilisaient déjà des méthodes de vérification DNS inverse.

Le nouveau crawler générique, lui, pose plus de questions qu'il n'apporte de réponses. Google reste délibérément vague sur son usage exact. [À vérifier] : on ne sait pas si ce crawler impacte le crawl budget de la même manière que Googlebot classique, ni s'il respecte les mêmes règles robots.txt.

Faut-il s'attendre à des changements dans les patterns de crawl observés ?

Sur le terrain, les professionnels qui analysent leurs logs quotidiennement n'ont pas forcément remarqué de bouleversement majeur lié à ce crawler générique. Soit il opère déjà depuis un moment sans qu'on l'ait identifié formellement, soit son volume d'activité reste marginal.

Ce qui est certain : Google multiplie les robots spécialisés (Mobile-Friendly Test, AdsBot, Google-InspectionTool...), et cette fragmentation complique l'analyse globale du comportement de crawl. Avoir une doc claire, c'est bien — mais ça ne compense pas le manque de données chiffrées sur la répartition du budget entre ces différents crawlers.

Cette annonce masque-t-elle d'autres évolutions non documentées ?

Google communique rarement sur ses crawlers sans raison. Cette documentation formelle d'un crawler "générique" pourrait indiquer une rationalisation interne de l'infrastructure de crawl — ou au contraire une spécialisation accrue des tâches d'exploration.

Ce qui manque cruellement ? Des guidelines claires sur comment optimiser pour chacun de ces crawlers. Dire "voici notre nouveau robot" sans expliquer ce qu'il indexe, comment il priorise ou comment il consomme le crawl budget, c'est donner une information incomplète.

Impact pratique et recommandations

Que faut-il faire concrètement avec ces adresses IP ?

Première étape : intégrer ces plages IP dans vos outils d'analyse de logs. Cela vous permettra d'isoler précisément le trafic Google et de mesurer son évolution dans le temps, crawler par crawler.

Deuxième action : si vous gérez des règles de pare-feu ou de rate limiting, assurez-vous que ces IP ne sont jamais bloquées accidentellement. Un blocage même temporaire peut avoir des conséquences désastreuses sur votre indexation.

Comment adapter sa stratégie de crawl budget ?

Avec plusieurs crawlers Google actifs sur votre site, l'analyse du crawl budget se complexifie. Il faut désormais segmenter les logs par type de robot pour comprendre où Google investit réellement ses ressources.

Surveillez particulièrement ce nouveau crawler générique : s'il consomme une part significative de votre budget sans apporter de valeur indexation claire, vous pourriez vouloir investiguer. Mais attention — bloquer un crawler Google non documenté peut être risqué.

Quelles erreurs éviter absolument ?

Ne vous précipitez pas pour bloquer ce nouveau crawler sous prétexte qu'il consomme des ressources. Sans comprendre son rôle exact, vous pourriez compromettre votre visibilité sur certains segments de recherche.

Autre piège : se reposer uniquement sur les IP pour identifier Googlebot. Ces listes changent — Google peut ajouter de nouvelles plages sans communication préalable. Maintenez toujours une vérification DNS inverse en complément.

- Mettre à jour vos outils d'analyse de logs avec les nouvelles plages IP Google

- Vérifier que vos règles firewall n'excluent aucune IP officielle Googlebot

- Segmenter vos rapports de crawl par type de robot (Googlebot classique, mobile, générique, etc.)

- Surveiller l'activité du nouveau crawler générique dans vos logs sans le bloquer

- Documenter les patterns de crawl observés pour chaque type de robot

- Maintenir une veille régulière sur la documentation Google pour détecter les ajouts d'IP

- Combiner vérification IP et DNS inverse pour une identification fiable

❓ Questions frequentes

Dois-je bloquer le nouveau crawler générique de Google dans mon robots.txt ?

Comment vérifier que les IP qui crawlent mon site sont bien celles de Google ?

Ce nouveau crawler consomme-t-il du crawl budget comme Googlebot classique ?

Faut-il modifier mes sitemaps ou ma structure pour ce nouveau crawler ?

Où trouver la liste officielle des adresses IP de Google ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/07/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.