Declaration officielle

Ce qu'il faut comprendre

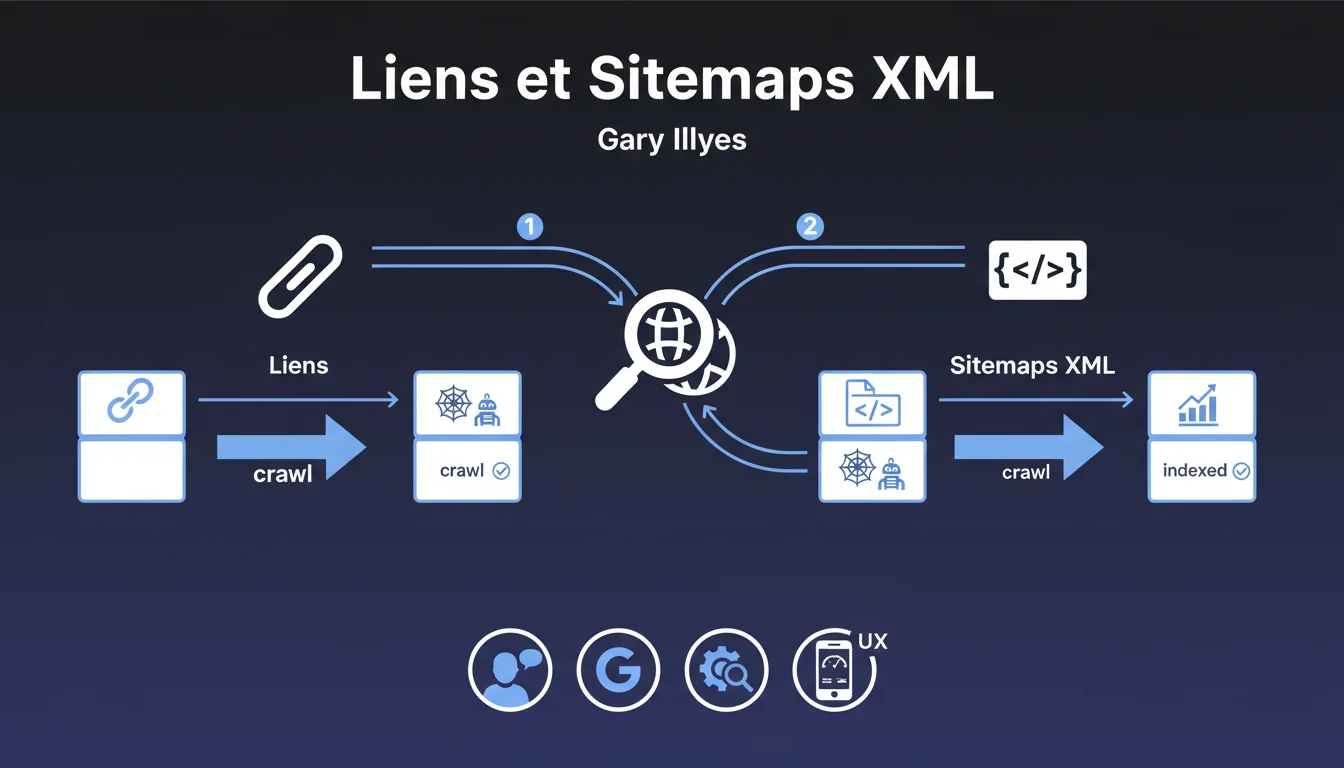

Gary Illyes a confirmé lors d'une conférence que Google utilise deux méthodes principales pour découvrir de nouvelles URL à crawler. La première et la plus importante reste le suivi des liens hypertexte par les robots d'exploration.

La seconde méthode passe par les fichiers Sitemaps XML, qui constituent un canal complémentaire mais essentiel. Cette hiérarchisation n'est pas anodine : elle révèle que l'architecture de liens reste le fondement de la découverte de contenu par Google.

D'autres mécanismes existent certes, comme l'échange de données entre robots Google ou les informations remontées par Chrome. Mais leur contribution reste marginale comparée aux deux canaux principaux.

- Les liens hypertexte constituent la méthode prioritaire de découverte d'URL

- Les Sitemaps XML servent de complément pour faciliter l'indexation

- L'architecture de liens interne et externe demeure cruciale pour la visibilité

- Les autres canaux de découverte représentent un volume négligeable

Avis d'un expert SEO

Cette déclaration confirme ce que l'observation terrain démontre depuis des années. Les sites avec une architecture de liens solide voient leurs nouvelles pages découvertes en quelques heures, tandis que les pages orphelines restent invisibles même avec un Sitemap.

La nuance importante réside dans le fait que découverte ne signifie pas indexation. Un Sitemap peut accélérer la découverte, mais seule la qualité du contenu et l'autorité transmise par les liens internes garantissent l'indexation effective. J'observe régulièrement des sites dont 80% des URL du Sitemap ne sont jamais indexées.

Pour les sites de grande envergure, la combinaison intelligente des deux méthodes reste indispensable. Les liens assurent la transmission du PageRank, tandis que le Sitemap sécurise la découverte des contenus profonds dans l'arborescence.

Impact pratique et recommandations

- Auditez votre maillage interne : assurez-vous que chaque page importante est accessible en maximum 3 clics depuis l'accueil

- Éliminez les pages orphelines en créant des liens contextuels depuis vos contenus à forte autorité

- Optimisez votre Sitemap XML en n'incluant que les URL indexables, à jour et stratégiques (pas de pages en noindex, 404 ou bloquées par robots.txt)

- Segmentez vos Sitemaps par typologie de contenu pour les sites volumineux (produits, catégories, articles)

- Surveillez la Search Console pour identifier les URL découvertes mais non crawlées ou non indexées

- Renforcez le linking interne vers vos nouvelles pages dès leur publication pour accélérer leur découverte

- Créez un hub de contenu récent accessible depuis votre navigation principale pour faciliter le crawl des nouveautés

La mise en place d'une stratégie de découverte optimale nécessite une vision globale de votre écosystème technique et éditorial. Entre l'analyse de crawl, l'optimisation du maillage interne, la gestion des Sitemaps et le monitoring continu, ces optimisations requièrent une expertise pointue.

Pour les sites complexes ou en forte croissance, l'accompagnement par une agence SEO spécialisée permet d'identifier rapidement les blocages structurels et de déployer une architecture de découverte performante, adaptée à vos enjeux spécifiques.

💬 Commentaires (0)

Soyez le premier à commenter.