Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google supprime-t-il 7% de son index vidéo et comment éviter d'en faire partie ?

- □ Pourquoi les incidents d'indexation paralysent-ils autant les sites d'actualités ?

- □ Pourquoi Google laisse-t-il des incidents 'ouverts' sur son tableau de bord même après résolution ?

- □ Faut-il s'inquiéter des incidents techniques mineurs chez Google ?

- □ Comment Google décide-t-il de communiquer publiquement sur un incident technique ?

- □ Pourquoi Google utilise-t-il des messages pré-approuvés lors d'incidents techniques ?

- □ Pourquoi votre contenu n'apparaît-il pas dans les SERP malgré la résolution de votre incident d'indexation ?

- □ Pourquoi les expériences de Google provoquent-elles des incidents dans les résultats de recherche ?

- □ Google va-t-il enfin communiquer sur les bonnes nouvelles de son moteur ?

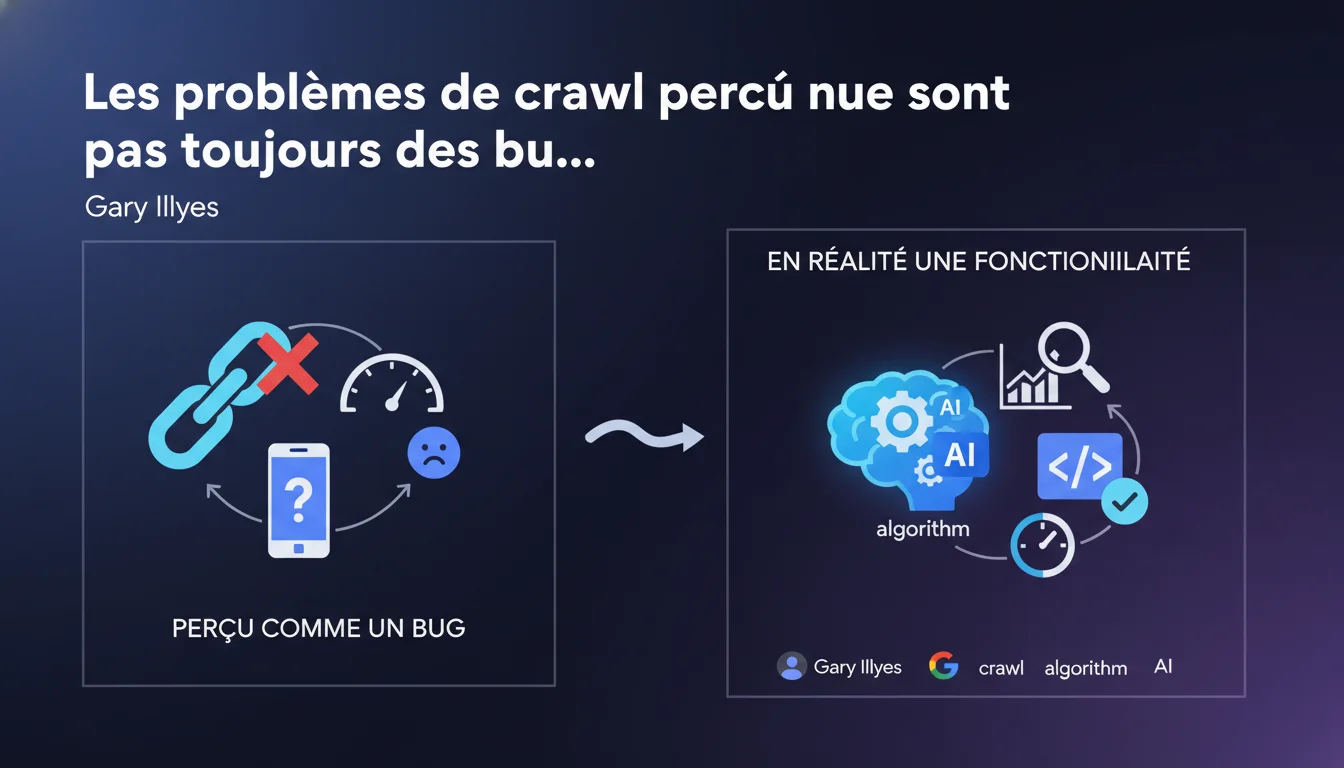

Google assume pleinement que certains comportements de crawl jugés problématiques par les propriétaires de sites sont en réalité des décisions algorithmiques intentionnelles. Si votre site n'est pas crawlé aussi fréquemment que vous l'espériez, ce n'est pas un dysfonctionnement technique mais une évaluation de la pertinence et de la valeur de votre contenu par l'algorithme. Cette position rappelle que Google optimise son budget de crawl selon ses propres critères, pas selon les attentes des webmasters.

Ce qu'il faut comprendre

Google distingue-t-il vraiment les bugs des choix algorithmiques ?

La déclaration de Gary Illyes introduit une nuance essentielle : ce qui ressemble à un problème technique n'en est pas toujours un. Beaucoup de professionnels SEO diagnostiquent des "bugs" lorsque le comportement de Googlebot ne correspond pas à leurs attentes. Soyons honnêtes — on a tous râlé devant un crawl budget qui semblait insuffisant.

Google affirme que ces situations relèvent souvent d'une décision algorithmique délibérée. Le moteur de recherche évalue en permanence la valeur du contenu et ajuste la fréquence de crawl en conséquence. Si votre site est peu visité par le bot, c'est potentiellement un signal que Google considère votre contenu comme moins prioritaire que d'autres.

Quels sont les critères qui influencent cette évaluation algorithmique ?

Google ne détaille évidemment pas l'intégralité de sa formule. Ce qu'on sait : la fraîcheur du contenu, l'autorité du domaine, la qualité perçue et la popularité jouent un rôle majeur. Un site qui publie rarement, avec peu de backlinks et un trafic faible, sera logiquement moins crawlé qu'un média d'actualité à forte autorité.

Le problème — et c'est là que ça coince — c'est que Google ne fournit pas de seuils précis. Vous ne savez jamais si vous êtes juste en dessous du radar ou si votre site est carrément considéré comme négligeable. Cette opacité rend difficile la distinction entre un problème de qualité réel et une simple fluctuation algorithmique.

Cette logique s'applique-t-elle à tous les types de sites ?

Non, et c'est un point crucial. Les sites e-commerce avec des milliers de pages produits, les agrégateurs de contenu ou les sites d'actualité subissent cette réalité différemment. Pour un site vitrine de 20 pages, la fréquence de crawl importe peu. Pour un média qui publie 50 articles par jour, chaque heure de retard dans l'indexation peut représenter un manque à gagner.

Les sites dont le contenu change fréquemment — prix, stock, actualités — sont particulièrement exposés. Google ajuste le crawl en fonction de la vélocité de changement perçue, mais cette perception n'est pas toujours synchronisée avec la réalité terrain.

- La fréquence de crawl est une conséquence, pas un levier direct que vous contrôlez

- Google optimise son propre budget de crawl, pas celui de votre site selon vos objectifs business

- Ce qui semble être un bug peut être une dépriorisation algorithmique intentionnelle

- L'opacité des critères rend le diagnostic difficile — impossible de savoir si c'est un problème de qualité ou de priorité

- Les sites à fort volume de contenus frais sont les plus impactés par cette logique

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui et non. Sur le principe, c'est indéniable : Google n'a aucune obligation de crawler votre site selon vos désirs. Le moteur gère des milliards de pages et doit prioriser. L'approche algorithmique est rationnelle du point de vue de Google, mais elle ignore complètement la réalité opérationnelle des sites.

Concretement ? J'ai vu des sites parfaitement optimisés, avec du contenu frais quotidien, attendre plusieurs jours avant qu'une page stratégique soit indexée. Dans ces cas, difficile de ne pas parler de dysfonctionnement — même si Google considère que tout fonctionne "comme prévu". [A verifier] : la frontière entre "décision algorithmique" et "bug" reste floue et Google ne fournit aucun moyen de différencier les deux.

Quelles nuances faut-il apporter à cette affirmation ?

Gary Illyes simplifie. Il existe bel et bien des bugs de crawl avérés — erreurs serveur, boucles de redirections, problèmes de rendering JavaScript mal gérés. Ces situations ne relèvent pas d'une "évaluation de contenu" mais de défaillances techniques réelles que Google doit corriger.

Mélanger les deux sous l'étiquette "ce n'est pas un bug, c'est une fonctionnalité" est pratique pour Google, moins pour nous. Ça permet d'évacuer des reproches légitimes en invoquant l'opacité algorithmique. Soyons clairs : si votre site perd 80% de son crawl du jour au lendemain sans changement technique, ce n'est pas juste une "réévaluation".

Par ailleurs, cette position ne dit rien sur les incohérences observées. Pourquoi un site concurrent avec un contenu objectivement plus faible bénéficie d'un crawl deux fois supérieur ? Google répondra "algorithme", mais ça ne rend pas la situation moins frustrante ni plus compréhensible.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Quand vous avez des preuves techniques d'un dysfonctionnement : erreurs 5xx répétées côté Google, pages rendues vides alors qu'elles s'affichent correctement, crawl bloqué par un robots.txt que vous n'avez jamais configuré. Dans ces situations, invoquer "l'évaluation algorithmique" est une esquive.

De même, si vous constatez un changement brutal sans modification de votre côté — mise à jour d'algorithme non annoncée, bug chez Google — il est légitime de parler de problème, pas de "fonctionnalité". Le discours de Gary Illyes ne doit pas servir d'excuse universelle pour ignorer des signaux d'alerte réels.

Impact pratique et recommandations

Que faut-il faire concrètement pour maximiser son crawl budget ?

Première étape : auditez vos logs serveur pour identifier les patterns réels de crawl. Googlebot visite-t-il des pages inutiles ? Des URLs en double, des facettes de filtres e-commerce, des pages paginées infinies ? Chaque page crawlée inutilement grignote du budget qui pourrait aller vers vos contenus stratégiques.

Ensuite, optimisez votre architecture. Réduisez la profondeur des pages importantes, améliorez le maillage interne, éliminez les chaînes de redirections. Plus vos pages critiques sont accessibles rapidement, plus Google les visitera fréquemment. Et c'est là que ça devient compliqué — parce que toucher à l'architecture d'un site de 10 000 pages sans casser quelque chose demande une expertise solide.

Enfin, publiez régulièrement du contenu de qualité. Google ajuste le crawl en fonction de la vélocité de mise à jour perçue. Un site qui publie tous les jours sera crawlé plus souvent qu'un site statique. Mais attention — publier pour publier ne sert à rien. Le contenu doit apporter de la valeur, sinon vous risquez l'effet inverse : une dépriorisation.

Quelles erreurs éviter pour ne pas aggraver la situation ?

Ne bloquez jamais des ressources essentielles dans le robots.txt en pensant "économiser" du crawl budget. Google a besoin d'accéder au CSS et JavaScript pour évaluer correctement vos pages. Bloquer ces ressources peut entraîner un rendering incomplet et, paradoxalement, réduire encore plus votre crawl.

Évitez aussi de sur-optimiser au détriment de l'expérience utilisateur. J'ai vu des sites supprimer des pages utiles pour "concentrer" le crawl budget, alors que ces pages généraient du trafic. Le crawl budget n'est pas une fin en soi — il sert à indexer des pages qui apportent de la valeur, pas à maximiser un KPI déconnecté du business.

Enfin, ne tombez pas dans le piège de la sur-indexation. Soumettre frénétiquement des URLs via la Search Console ou le sitemap ne fera pas crawler Google plus vite si l'algorithme a décidé que votre site n'est pas prioritaire. Vous risquez même d'être perçu comme du spam.

Comment vérifier que votre site est correctement évalué par Google ?

Comparez votre fréquence de crawl observée dans les logs avec votre fréquence de publication. Si vous publiez quotidiennement mais que Google ne passe qu'une fois par semaine, il y a un problème — soit technique, soit de qualité perçue. Croisez ces données avec les stats de la Search Console, section "Statistiques d'exploration".

Analysez aussi les pages effectivement crawlées versus les pages stratégiques. Si Googlebot passe 70% de son temps sur des pages sans valeur SEO (archives, tags, facettes) et 30% sur vos contenus piliers, vous avez un problème d'architecture à corriger. Les outils d'analyse de logs comme Screaming Frog Log Analyzer ou OnCrawl sont précieux ici.

Enfin, surveillez l'évolution dans le temps. Une baisse progressive du crawl peut indiquer une dépriorisation algorithmique — souvent liée à une baisse de qualité perçue ou de popularité. Une baisse brutale suggère plutôt un problème technique ou une pénalité.

- Auditez vos logs serveur pour identifier les pages crawlées inutilement

- Optimisez l'architecture pour réduire la profondeur des pages stratégiques

- Améliorez le maillage interne pour guider Googlebot vers les contenus prioritaires

- Publiez régulièrement du contenu de qualité pour augmenter la vélocité perçue

- Ne bloquez jamais CSS/JS essentiels au rendering dans le robots.txt

- Comparez fréquence de crawl réelle et fréquence de publication pour détecter les écarts

- Analysez quelles pages consomment votre crawl budget — éliminez les gaspillages

- Surveillez les tendances long terme dans la Search Console

❓ Questions frequentes

Comment savoir si la faible fréquence de crawl de mon site est un bug ou une décision algorithmique ?

Peut-on forcer Google à crawler son site plus souvent ?

Pourquoi un site concurrent est-il crawlé plus souvent que le mien avec un contenu similaire ?

Un crawl budget faible impacte-t-il nécessairement mon SEO ?

Google peut-il se tromper dans son évaluation algorithmique du contenu ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 06/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.