Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Faut-il vraiment ignorer les fluctuations quotidiennes dans Search Console ?

- □ Pourquoi les petits changements SEO peuvent-ils provoquer des effets imprévisibles sur Google ?

- □ La vitesse de crawl peut-elle vraiment faire fluctuer votre indexation ?

- □ Les signaux sociaux influencent-ils vraiment le classement Google ?

- □ Faut-il vraiment arrêter de surveiller les positions quotidiennes en SEO ?

- □ Faut-il vraiment s'inquiéter des pics soudains dans la Search Console ?

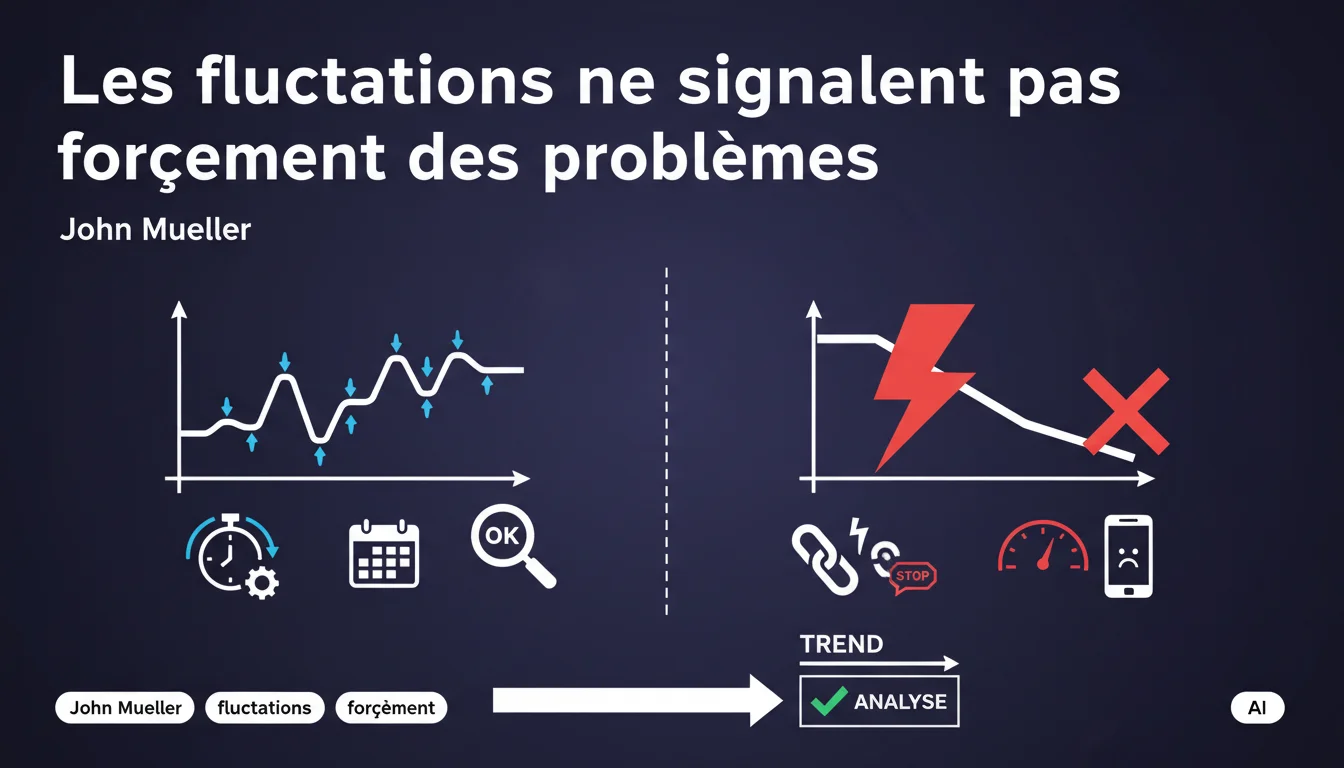

Google confirme que les petites variations de positions au quotidien sont normales et ne signalent aucun problème. Seuls les changements brutaux ou les tendances longues sur plusieurs semaines méritent une analyse approfondie. L'erreur classique : réagir à chaque micro-mouvement au lieu de garder une vision d'ensemble.

Ce qu'il faut comprendre

Qu'est-ce que Google entend exactement par « petites fluctuations » ?

Mueller ne donne volontairement aucun seuil chiffré. Pas de « +/- 3 positions, c'est normal » ou « -10%, c'est grave ». Cette déclaration reste dans le flou — et c'est probablement voulu.

La raison ? Google veut éviter que les SEO fixent des seuils arbitraires et déclenchent des alertes inutiles. Mais concrètement, comment distinguer une fluctuation normale d'un vrai problème sans indicateur précis ? Ça, Mueller ne le dit pas.

Pourquoi ces variations existent-elles si rien n'a changé sur le site ?

Les SERP ne sont pas statiques. L'algorithme teste en permanence : nouveaux contenus indexés, sites concurrents mis à jour, intentions de recherche réinterprétées, variantes géographiques ou personnalisées.

Votre site peut descendre de 2 places un jour et remonter le lendemain sans qu'aucune action de votre part n'explique ce mouvement. C'est l'écosystème qui bouge autour de vous.

Sur quelle période surveiller les « tendances plus larges » ?

Mueller évoque les tendances mais reste vague sur la durée. Une semaine ? Trois semaines ? Un mois ? Impossible de savoir précisément.

L'expérience terrain suggère qu'une tendance baissière observée sur 14 jours consécutifs mérite investigation. Mais Google ne valide ni n'invalide ce délai — encore une zone grise.

- Les micro-variations quotidiennes ne sont pas des signaux d'alerte exploitables

- Les changements soudains et importants (chute de trafic organique >20% en 48h) nécessitent une analyse immédiate

- Les tendances longues (baisse progressive sur plusieurs semaines) doivent déclencher un audit structurel

- Surveiller la visibilité globale du domaine, pas seulement quelques requêtes isolées

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment ce qu'on observe sur le terrain ?

Oui et non. Les fluctuations quotidiennes existent bel et bien — n'importe quel outil de suivi le confirme. Mais Mueller omet un point crucial : certaines niches sont bien plus volatiles que d'autres.

Un site e-commerce en mode/tech peut voir ses positions bouger tous les jours sans raison apparente. Un site institutionnel B2B reste souvent stable pendant des semaines. Le contexte sectoriel change tout, et Google ne le mentionne jamais dans ce type de déclaration générique.

Qu'est-ce qui manque dans cette recommandation ?

Mueller ne dit rien sur comment identifier le seuil entre « normal » et « problématique ». Pour un site à 1000 visites/jour, perdre 50 visites est-il normal ou inquiétant ? Et pour un site à 100 000 ?

[À vérifier] : Google dispose de ces données à l'échelle de milliards de requêtes, mais ne partage aucune métrique permettant d'objectiver ce conseil. On reste sur du ressenti et de l'expérience personnelle — ce qui est loin d'être idéal pour prendre des décisions data-driven.

Dans quels cas une fluctuation apparemment « petite » cache-t-elle un problème réel ?

Si la variation concerne vos requêtes de conversion principales, même une perte de 2-3 positions peut impacter sérieusement le CA. Mueller parle en termes de visibilité globale — mais un SEO doit raisonner en revenus.

Autre angle mort : les fluctuations synchronisées avec des événements externes (saisonnalité, actualité, campagnes concurrentes) peuvent signaler un décrochage structurel masqué par le bruit ambiant.

Impact pratique et recommandations

Comment distinguer concrètement une fluctuation normale d'un signal d'alerte ?

Première règle : arrêter de surveiller les positions quotidiennes comme un trader devant ses cours de Bourse. Passez à une fréquence hebdomadaire minimum pour lisser le bruit.

Deuxième règle : ne jamais analyser une seule métrique isolément. Combinez positions moyennes + trafic organique + taux de clics + pages indexées. Un faux mouvement sur un indicateur se neutralise si les autres restent stables.

- Paramétrer des alertes uniquement sur les variations >15% du trafic organique sur 7 jours glissants

- Segmenter les alertes par typologie de requêtes (marque / transactionnelles / informationnelles)

- Créer un tableau de bord avec tendances sur 30 et 90 jours, pas des snapshots quotidiens

- Croiser les données GSC avec les logs serveur pour détecter les anomalies de crawl qui précèdent souvent les chutes

- Documenter toutes les modifications faites sur le site pour corréler cause et effet

Quelles erreurs éviter face aux fluctuations ?

L'erreur numéro un : réagir précipitamment. Modifier le contenu, changer la structure, ajuster le maillage interne… alors que la « baisse » n'était qu'un mouvement temporaire. Résultat : vous créez vous-même un vrai problème.

Autre piège classique : ignorer les signaux faibles en se disant « c'est juste une fluctuation normale ». Quand plusieurs micro-baisses s'accumulent sur 4-5 semaines, ce n'est plus du bruit — c'est une tendance.

Que mettre en place pour garder une vision saine de vos performances ?

Définissez des seuils d'alerte adaptés à votre contexte : volume de trafic habituel, saisonnalité, niveau de concurrence. Un site qui génère 500 sessions/jour n'aura pas les mêmes tolérances qu'un média à 50 000.

Mettez en place un processus de revue mensuelle structurée : tendances organiques, évolutions techniques (Core Web Vitals, erreurs de crawl), analyse de la concurrence. Ça évite de tomber dans le réflexe « j'ai perdu 3 positions, je panique ».

Ces configurations demandent une expertise pointue en analyse de données et une connaissance fine des outils SEO professionnels. Si vous n'avez pas les ressources internes pour mettre en place ce monitoring stratégique, une agence SEO spécialisée peut structurer ce dispositif et vous accompagner dans l'interprétation des signaux — ce qui évite à la fois les fausses alertes et les angles morts dangereux.

❓ Questions frequentes

À partir de quel pourcentage de baisse de trafic faut-il s'inquiéter ?

Les outils de suivi de positions sont-ils fiables pour détecter des problèmes ?

Faut-il réagir immédiatement à une baisse soudaine de positions ?

Comment savoir si une fluctuation est liée à un update Google ?

Google Search Console suffit-il pour surveiller les tendances ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 26/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.