Declaration officielle

Ce qu'il faut comprendre

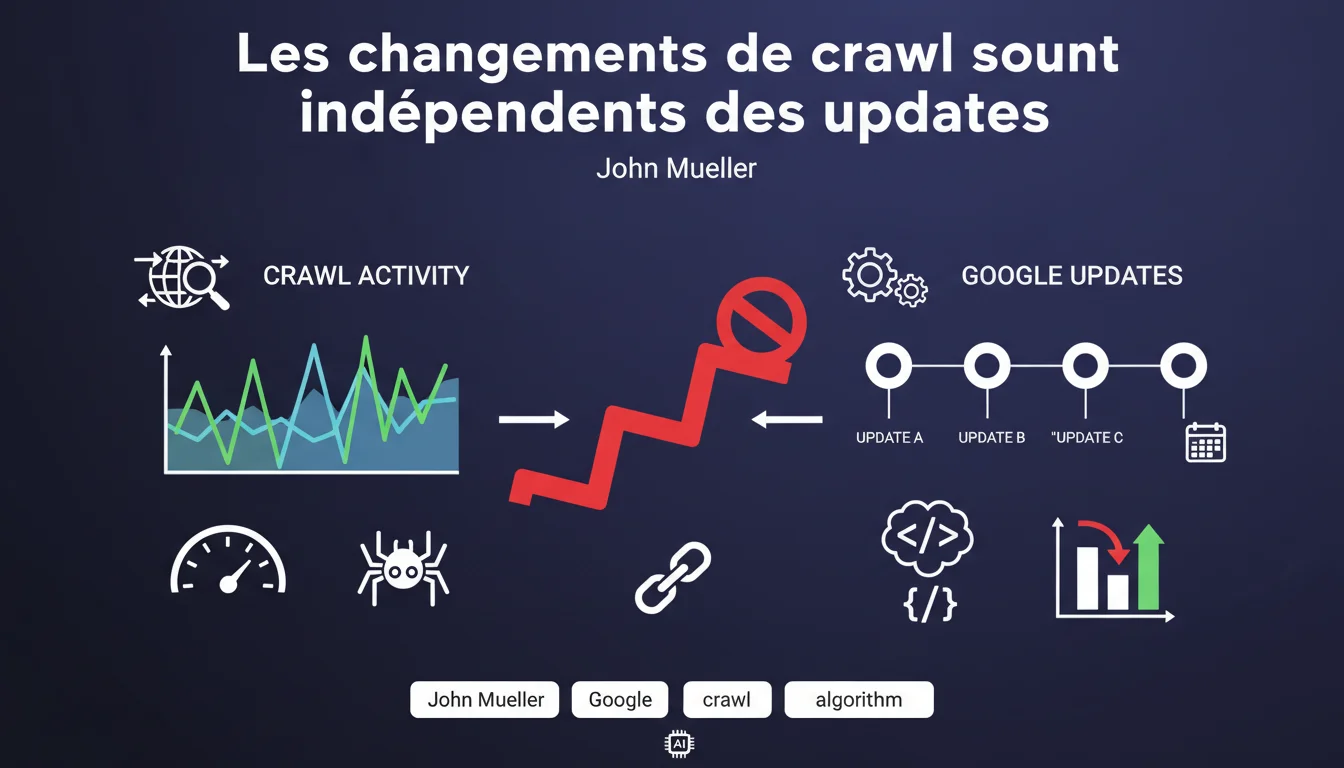

Les praticiens SEO scrutent souvent avec attention les variations d'activité de Googlebot dans leurs fichiers de logs, cherchant à y déceler des signes avant-coureurs de changements algorithmiques majeurs. Cette déclaration vient clarifier un point crucial : il n'existe aucun lien direct entre les fluctuations de crawl et le déploiement des mises à jour d'algorithme.

Concrètement, cela signifie qu'une augmentation soudaine du nombre de pages explorées par Google ne prédit pas l'arrivée d'une Core Update. De même, une baisse du crawl ne signale pas qu'une pénalité algorithmique est en préparation. Les deux systèmes fonctionnent de manière totalement indépendante.

Les variations de crawl répondent à des logiques propres au système d'exploration de Google : modifications du crawl budget alloué à votre site, changements dans votre architecture, ajout de nouvelles pages, amélioration des temps de réponse serveur, etc. Ces facteurs n'ont rien à voir avec les ajustements algorithmiques qui déterminent le classement des pages.

- Le crawl et le ranking sont deux processus distincts chez Google

- Une hausse du crawl ne garantit pas une amélioration des positions

- Une baisse du crawl n'annonce pas forcément une pénalité

- Les corrélations observées entre crawl et updates sont purement coïncidentielles

- Il faut analyser les variations de crawl selon leurs propres critères techniques

Avis d'un expert SEO

Cette déclaration est parfaitement cohérente avec les observations terrain des dernières années. Les praticiens SEO ont effectivement tendance à sur-interpréter les variations de crawl, créant parfois de fausses alertes lorsqu'ils constatent des changements dans leurs logs serveur. La réalité technique confirme cette indépendance : le système d'exploration et le système de ranking sont architecturalement séparés chez Google.

Cependant, une nuance importante mérite d'être apportée. Si le crawl n'annonce pas les updates, un site qui n'est pas correctement crawlé ne pourra pas bénéficier pleinement des améliorations algorithmiques. Un crawl insuffisant peut donc indirectement impacter vos performances lors d'une mise à jour, non pas à cause de l'algorithme lui-même, mais simplement parce que vos nouvelles pages ou modifications ne sont pas découvertes assez rapidement.

Impact pratique et recommandations

- Arrêtez de corréler les pics de crawl avec les annonces de mises à jour algorithmiques dans vos rapports

- Analysez vos logs serveur pour identifier les vraies causes des variations : changements d'architecture, nouveaux contenus, performances serveur

- Concentrez-vous sur l'optimisation du crawl budget : éliminez les pages de faible valeur, optimisez votre maillage interne, réduisez les chaînes de redirections

- Surveillez les métriques techniques : temps de réponse serveur, erreurs HTTP, profondeur des pages explorées

- Améliorez votre infrastructure technique pour faciliter le travail de Googlebot : temps de chargement, stabilité serveur, sitemap XML à jour

- Différenciez clairement dans vos analyses les problématiques de crawl (exploration) et les problématiques de ranking (positionnement)

- Priorisez l'indexation des pages stratégiques via le maillage interne et les sitemaps plutôt que d'attendre passivement une hausse du crawl

- Documentez les changements techniques effectués sur votre site pour expliquer les variations de crawl observées

L'optimisation du crawl budget et l'analyse fine des logs serveur requièrent une expertise technique pointue et des outils d'analyse avancés. Ces diagnostics impliquent souvent de croiser de multiples sources de données (logs, Search Console, crawls simulés) et d'interpréter correctement le comportement de Googlebot selon votre contexte spécifique. Pour les sites complexes ou de grande envergure, un accompagnement par une agence SEO spécialisée peut s'avérer judicieux pour mettre en place une stratégie d'optimisation du crawl véritablement efficace et personnalisée selon vos enjeux business.

💬 Commentaires (0)

Soyez le premier à commenter.