Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- 1:43 Faut-il vraiment perdre son temps à donner du feedback sur la documentation Google ?

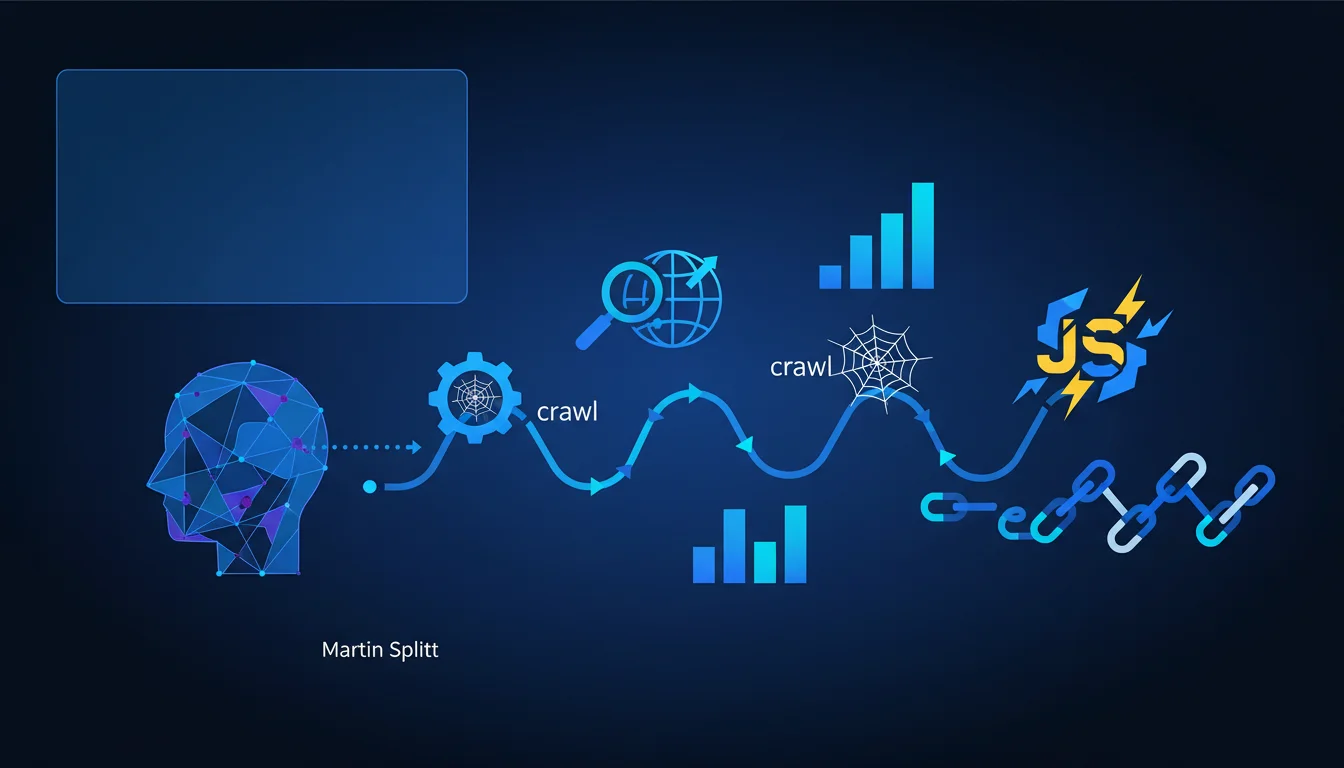

- 7:27 Pourquoi bundler son JavaScript peut-il accélérer le crawl de votre site ?

- 15:17 Le classement Google est-il vraiment une science exacte ou un art subjectif ?

- 16:36 Peut-on vraiment mesurer le poids d'un facteur de classement Google ?

- 17:55 Faut-il vraiment arrêter de se concentrer sur un seul facteur de ranking pour stabiliser ses positions ?

- 19:02 Pourquoi Google refuse-t-il de donner une liste ordonnée de facteurs de classement ?

- 22:05 Pourquoi les algorithmes Google évoluent-ils sans cesse et comment s'adapter ?

- 23:15 Comment Google valide-t-il vraiment ses changements d'algorithme avant déploiement ?

- 24:18 Pourquoi votre classement peut-il baisser même si votre site reste excellent ?

- 25:20 L'expérience utilisateur peut-elle vraiment faire basculer votre classement face à un concurrent aussi pertinent que vous ?

Google affirme que l'utilisation de JavaScript et sa structure technique (bundling, splitting) ne sont pas des facteurs de classement directs. Cependant, ces choix impactent l'expérience utilisateur et l'efficacité du crawl, deux éléments qui influencent indirectement le positionnement. La nuance est capitale : un site JS mal implémenté peut se retrouver pénalisé sans que ce soit officiellement un « facteur de classement ».

Ce qu'il faut comprendre

Que signifie exactement « pas un facteur de classement direct » ?

Quand Martin Splitt affirme que le JavaScript n'est pas un facteur de classement, il établit une distinction technique précise. L'algorithme de Google ne dispose pas d'un signal nommé « score JavaScript » qui booste ou pénalise directement votre position.

La façon dont vous organisez votre code — que vous utilisiez du code splitting, du lazy loading, ou un bundle monolithique — ne déclenche pas de bonus ou de malus dans le ranking. C'est une différence fondamentale avec des signaux confirmés comme les Core Web Vitals ou les backlinks.

Pourquoi cette déclaration prête-t-elle à confusion ?

Le piège, c'est que JavaScript influence massivement des facteurs qui, eux, sont confirmés comme critères de classement. Un site qui charge 2 Mo de JavaScript mal optimisé aura un First Contentful Paint désastreux — et ça, c'est mesurable dans les Core Web Vitals.

Si votre contenu principal est rendu uniquement côté client et que Googlebot doit attendre 8 secondes pour l'exécuter, vous avez un problème de crawl budget et d'indexation. Pas directement un problème de « facteur JavaScript », mais le résultat est identique : visibilité réduite.

Quelle est la position réelle de Google sur le rendu JavaScript ?

Google crawle et indexe le JavaScript depuis des années, mais avec des limitations documentées. Le second wave of indexing — cette file d'attente où Googlebot rend les pages JS — peut introduire des délais de plusieurs jours, voire semaines pour les sites peu prioritaires.

La déclaration de Splitt ne change rien à cette réalité technique. Elle précise simplement que l'utilisation de JavaScript en elle-même n'est pas pénalisante, à condition que l'implémentation reste compatible avec le crawl et l'indexation. C'est une nuance énorme.

- JavaScript n'est pas un signal de ranking — aucun bonus ni malus algorithmique direct

- L'expérience utilisateur générée par le JS impacte les Core Web Vitals, qui eux sont des facteurs confirmés

- Le crawl et l'indexation peuvent être ralentis ou compromis par une mauvaise architecture JS

- Le bundling et le code splitting sont des choix techniques neutres pour le ranking, mais déterminants pour la performance perçue

- Google recommande le SSR ou l'hydratation pour les sites avec des enjeux SEO critiques, même si ce n'est pas obligatoire

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui et non. Sur le papier, affirmer que JavaScript n'est pas un facteur de classement direct est techniquement exact. Mais cette formulation masque une réalité plus complexe : les sites full-JS client-side mal implémentés se retrouvent systématiquement désavantagés dans les SERPs.

J'ai observé des dizaines de migrations de SPA (Single Page Applications) vers du Server Side Rendering qui ont généré des gains de trafic de 30 à 60 % en quelques semaines. Si le JS n'était vraiment pas un problème, ces gains seraient inexplicables. [A vérifier] : Google minimise-t-il l'impact réel pour encourager l'adoption de frameworks modernes ?

Quelles nuances faut-il apporter à cette affirmation ?

La distinction entre facteur direct et impact indirect est une pirouette sémantique. Pour un praticien SEO, ce qui compte c'est le résultat dans les SERPs — pas la taxonomie interne de Google. Un site qui perd 40 % de trafic parce que son contenu n'est pas crawlé correctement se fiche de savoir si c'est un « facteur direct » ou non.

Deuxième nuance : Splitt parle de bundling et splitting comme neutres, mais il omet de mentionner que ces choix déterminent le temps de parsing du navigateur. Un bundle de 500 Ko ralentit le Time to Interactive, qui lui impacte les Core Web Vitals. La chaîne de causalité est indirecte, mais l'effet est mesurable.

Dans quels cas cette règle ne s'applique-t-elle pas pleinement ?

Pour les sites d'actualités, les e-commerces avec des milliers de pages produits, ou les marketplaces, la réalité est moins indulgente. Le crawl budget n'est pas infini — et si Googlebot doit rendre 10 000 pages en JavaScript, vous allez rencontrer des problèmes d'indexation que les concurrents en HTML classique n'auront pas.

Les sites avec un contenu généré dynamiquement (filtres, facettes, recommandations) doivent particulièrement se méfier. Si ce contenu n'existe que côté client et nécessite des interactions utilisateur pour apparaître, Googlebot ne le verra probablement jamais — indépendamment du fait que JavaScript soit ou non un « facteur de classement ».

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser un site JavaScript ?

Première priorité : garantir que votre contenu critique soit accessible dès le HTML initial, sans attendre l'exécution du JavaScript. Utilisez du Server Side Rendering (SSR) ou de la pré-génération statique pour les pages stratégiques — landing pages, fiches produits, articles de blog.

Deuxième action : auditez votre temps de rendu avec les outils Search Console et Lighthouse. Si le First Contentful Paint dépasse 2 secondes ou si le Time to Interactive atteint 5 secondes, vous avez un problème qui impactera vos Core Web Vitals, donc indirectement votre classement.

Quelles erreurs courantes faut-il absolument éviter ?

Ne bloquez jamais le crawl des fichiers JavaScript et CSS dans le robots.txt — une erreur encore fréquente. Google a besoin d'accéder à ces ressources pour rendre correctement vos pages. Sans accès, vous forcez Googlebot à indexer une version dégradée de votre site.

Évitez les frameworks full client-side (React, Vue, Angular en mode SPA pur) pour des sites avec des enjeux SEO critiques, sauf si vous mettez en place du SSR ou de l'hydratation. Les solutions Next.js, Nuxt.js, ou Gatsby existent précisément pour combler ce gap.

Comment vérifier que votre implémentation JavaScript est SEO-friendly ?

Utilisez l'outil d'inspection d'URL dans la Search Console et comparez la version « explorée » avec la version « rendue ». Si vous constatez des différences majeures dans le contenu visible, c'est un signal d'alarme. Le rendu doit être identique ou quasi-identique.

Testez également avec des outils comme Screaming Frog en mode JavaScript activé/désactivé. Si des sections entières de votre site disparaissent sans JS, vous avez un problème structurel. Vérifiez les logs serveur pour identifier les pages que Googlebot rend effectivement — certaines peuvent rester coincées dans la seconde vague d'indexation indéfiniment.

- Implémenter du SSR ou de la pré-génération pour les pages stratégiques

- Mesurer et optimiser les Core Web Vitals (FCP, LCP, TBT, CLS)

- Vérifier l'accessibilité des fichiers JS/CSS dans le robots.txt

- Comparer les versions crawlée et rendue dans la Search Console

- Auditer le temps de rendu avec Lighthouse et PageSpeed Insights

- Tester le site avec JavaScript désactivé pour identifier les dépendances critiques

❓ Questions frequentes

Google indexe-t-il réellement tout le contenu généré en JavaScript ?

Le Server Side Rendering est-il obligatoire pour ranker avec un site en JavaScript ?

Les frameworks comme React ou Vue sont-ils pénalisants pour le SEO ?

Comment savoir si mon site JavaScript est correctement crawlé par Google ?

Le code splitting améliore-t-il le référencement ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · durée 33 min · publiée le 08/12/2020

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.