Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Google peut-il vraiment identifier le niveau technique de votre audience ?

- □ Les noms de domaine ont-ils vraiment perdu leur pouvoir de classement dans Google ?

- □ Faut-il vraiment éviter les mots-clés génériques en SEO ?

- □ Faut-il vraiment privilégier le trafic qualifié au volume de visiteurs ?

- □ Faut-il privilégier rel=canonical à noindex pour gérer les contenus similaires ?

- □ Les redirections 301/302 sont-elles vraiment un problème pour l'expérience utilisateur ?

- □ Faut-il sacrifier du trafic pour cibler la bonne audience ?

- □ Pourquoi les impressions et les clics ne suffisent-ils pas à mesurer le succès SEO ?

- □ La meta description est-elle vraiment inutile pour le classement Google ?

- □ Pourquoi le contenu générique tue-t-il votre différenciation SEO ?

- □ Le taux de satisfaction utilisateur révèle-t-il un problème de ciblage SEO ?

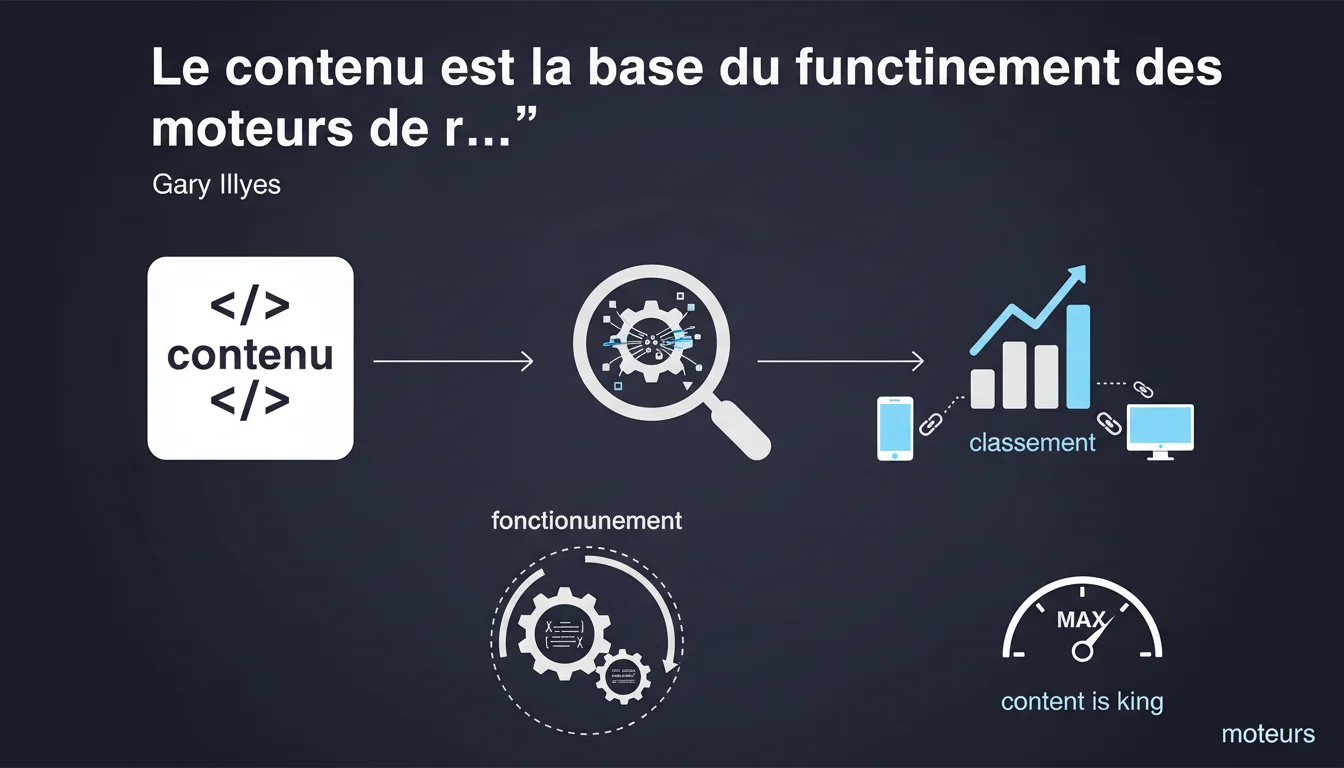

Gary Illyes rappelle que les moteurs de recherche fonctionnent avant tout sur l'analyse du contenu textuel : tokens, mots-clés, sémantique. Le fameux 'content is king' n'est pas un slogan marketing — c'est le reflet direct du fonctionnement technique des algorithmes de classement. Sans contenu analysable, impossible de ranker.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il encore sur le contenu textuel ?

Parce que l'algorithme de Google repose toujours sur l'analyse linguistique : découpage en tokens, identification des entités, compréhension sémantique, détection de la pertinence. Même avec l'IA générative et les modèles de langage, le moteur doit pouvoir lire, parser et interpréter du texte.

Les visuels, vidéos, animations ? Utiles pour l'expérience utilisateur, certes — mais sans texte associé (balises alt, transcriptions, descriptions), Google reste aveugle. Le contenu texte demeure l'unique matériau exploitable pour le classement.

Qu'entend-on exactement par 'tokens' et 'mots-clés' ?

Un token, c'est l'unité minimale que Google extrait du texte : un mot, une portion de mot, parfois même une ponctuation. L'algorithme découpe chaque phrase en tokens, analyse leur fréquence, leur position, leur co-occurrence.

Les mots-clés sont les termes jugés significatifs pour déterminer le sujet d'une page. Mais attention — on ne parle plus de densité mécanique. Google évalue désormais la richesse sémantique : synonymes, champs lexicaux, variation de formulation.

Ce principe invalide-t-il les autres facteurs de ranking ?

Non. Gary Illyes ne dit pas que le contenu est le seul facteur — il dit que c'est la base. Sans contenu analysable, les backlinks ou les Core Web Vitals ne servent à rien : impossible de classer ce qu'on ne comprend pas.

En revanche, à qualité de contenu équivalente, les autres signaux (autorité, UX, fraîcheur, EEAT) deviennent déterminants. Le contenu est nécessaire mais pas suffisant.

- Le contenu textuel reste l'élément fondamental analysé par Google

- Les tokens et la structure sémantique conditionnent le classement initial

- Sans contenu exploitable, aucun autre signal SEO ne peut compenser

- Les éléments non-textuels doivent être accompagnés de descriptions textuelles

- La richesse sémantique prime sur la répétition mécanique de mots-clés

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Complètement. Les sites qui performent en SEO ont systématiquement un contenu texte structuré, riche et ciblé. Les expériences de pages ultra-minimalistes (full image, vidéo sans transcription) échouent presque toujours à se classer sur des requêtes compétitives.

Mais voilà le problème : cette déclaration reste très générique. Gary Illyes ne dit rien sur les seuils quantitatifs (combien de mots ?), la densité optimale de mots-clés (si elle existe encore), ou la pondération exacte entre contenu principal et contenu secondaire. [À vérifier] : comment Google traite-t-il les contenus générés par IA, qui respectent techniquement cette règle mais manquent parfois de profondeur ?

Quelles nuances faut-il apporter à ce principe ?

D'abord, la qualité du contenu ne se mesure pas qu'à la quantité de tokens. Un texte bourré de mots-clés mais sans valeur ajoutée ne rankera pas mieux qu'un contenu concis mais pertinent. Google a multiplié les filtres anti-spam (Helpful Content, Product Reviews) précisément pour ça.

Ensuite, certains types de requêtes privilégient désormais d'autres formats : les featured snippets favorisent les listes structurées, les recherches locales valorisent les GMB, les recherches visuelles s'appuient sur Google Lens. Le contenu texte reste central, mais son format et sa structure évoluent.

Dans quels cas cette règle ne s'applique-t-elle pas strictement ?

Sur les recherches d'images ou de vidéos, le contenu textuel joue un rôle indirect : Google s'appuie sur les métadonnées (alt, titres, descriptions, transcriptions) mais aussi sur le contexte de la page. Une image isolée sans texte environnant aura du mal à ranker.

Idem pour les applications web (SPA, PWA) où le contenu est chargé dynamiquement en JavaScript. Techniquement, Google peut crawler le JS — mais si le rendu est trop lent ou le contenu inaccessible au premier chargement, le crawler risque de ne rien indexer. Le principe reste : le contenu doit être lisible, textuel, et accessible.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser son contenu textuel ?

Première étape : auditer les pages qui ne rankent pas. Vérifiez qu'elles contiennent suffisamment de contenu texte exploitable, pas seulement des images ou des vidéos. Un outil comme Screaming Frog permet de repérer les pages avec un ratio texte/HTML trop faible.

Ensuite, enrichissez sémantiquement : variez les formulations, intégrez des synonymes et termes connexes, structurez avec des balises Hn. Google comprend de mieux en mieux le contexte — profitez-en pour écrire naturellement au lieu de bourrer mécaniquement les mots-clés.

Quelles erreurs éviter absolument ?

Ne sacrifiez jamais le contenu texte au profit du design. Un site 100% visuel, même magnifique, sera invisible pour Google. Les sliders, animations, infographies doivent toujours être accompagnés de texte (légendes, descriptions, transcriptions).

Évitez aussi le piège du contenu dupliqué ou du thin content. Google valorise la densité informationnelle : un paragraphe de 50 mots qui répond précisément à une intention vaut mieux que 500 mots de remplissage générique.

Comment vérifier que mon site respecte ce principe ?

Testez vos pages avec l'outil d'inspection d'URL dans la Search Console. Regardez la version rendue par Googlebot : le contenu texte est-il bien visible ? Les éléments dynamiques sont-ils chargés ?

Comparez aussi le ratio texte visible / code HTML. Si votre page pèse 200 Ko de code pour 100 mots de contenu, vous avez un problème. Privilégiez un contenu substantiel et directement accessible.

- Auditer les pages sous-performantes pour vérifier leur volume de contenu texte

- Enrichir sémantiquement : synonymes, champs lexicaux, variantes de formulation

- Structurer avec des balises Hn et des listes pour faciliter la lecture par les crawlers

- Ajouter des transcriptions pour les vidéos, des descriptions alt pour les images

- Tester le rendu Googlebot via la Search Console

- Éviter le thin content et le bourrage de mots-clés artificiel

- Privilégier la densité informationnelle sur la quantité brute

❓ Questions frequentes

Le contenu généré par IA est-il considéré comme du 'vrai' contenu textuel par Google ?

Combien de mots minimum faut-il pour qu'une page soit bien classée ?

Les pages en JavaScript pur (SPA) peuvent-elles bien ranker ?

Faut-il privilégier le texte visible ou peut-on cacher du contenu pour les crawlers ?

Les images et vidéos ont-elles encore un intérêt SEO si seul le texte compte ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 24/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.