Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google ignore-t-il vos balises meta placées dans le <body> ?

- □ Pourquoi Google refuse-t-il les balises canonical placées dans le <body> ?

- □ Les balises hreflang dans le <body> sont-elles vraiment ignorées par Google ?

- □ Le code HTML valide W3C améliore-t-il vraiment le référencement ?

- □ Pourquoi modifier les canonicals en JavaScript crée-t-il des signaux contradictoires pour Google ?

- □ Faut-il optimiser les hints de préchargement pour Googlebot ?

- □ Le markup sémantique HTML5 est-il vraiment inutile pour le SEO ?

- □ Google parse-t-il vraiment le HTML comme un navigateur ?

- □ Pourquoi Googlebot ignore-t-il vos hints de préchargement des ressources ?

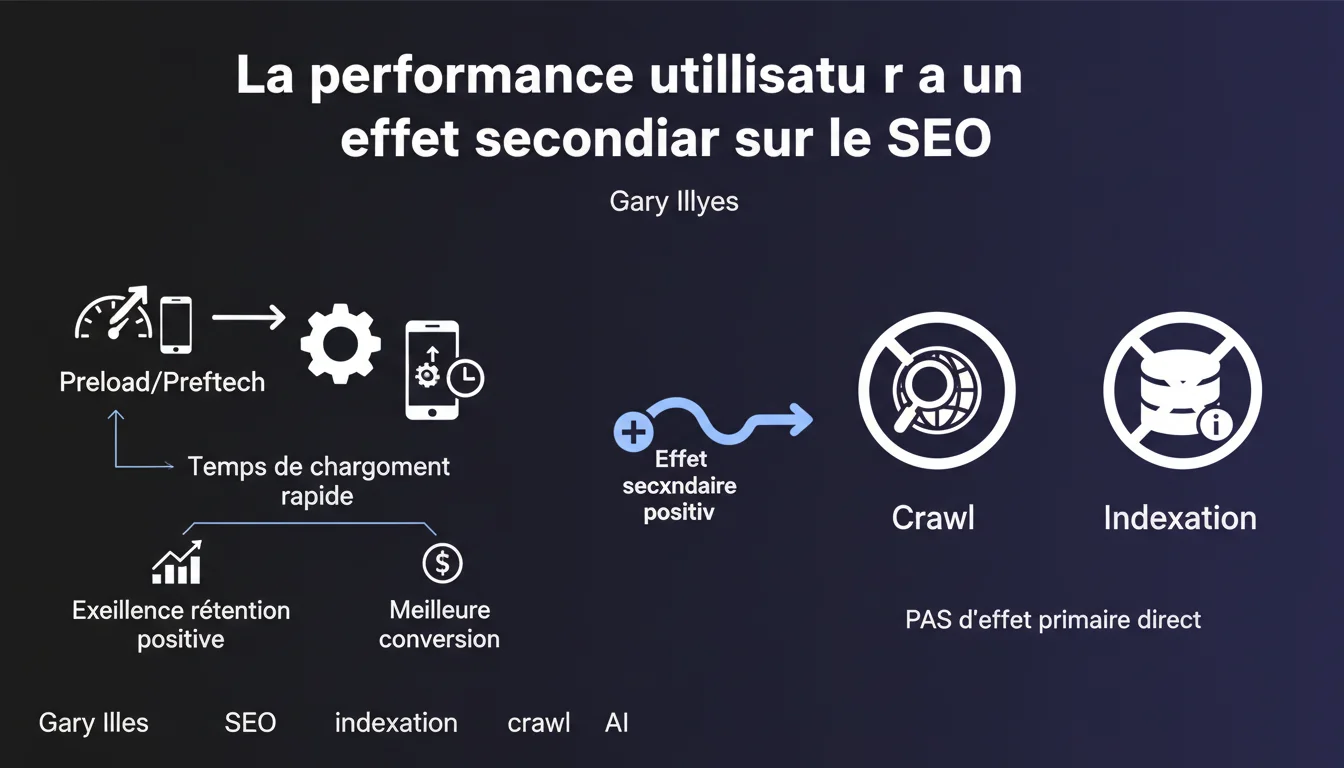

Google confirme que les optimisations de performance (preload, prefetch) n'ont pas d'effet direct sur le crawl ou l'indexation. En revanche, elles améliorent l'expérience utilisateur, ce qui influence indirectement le SEO via la rétention et les conversions. La nuance est capitale : vous n'optimisez pas pour Googlebot, mais pour vos visiteurs.

Ce qu'il faut comprendre

Quelle différence entre effet direct et effet secondaire en SEO ?

Gary Illyes établit une distinction fondamentale que beaucoup confondent encore. Un effet primaire direct signifierait que Google utilise les métriques de performance comme signal de classement dans son algorithme. Un effet secondaire signifie que la performance impacte le comportement utilisateur, et que ce comportement influence ensuite le SEO.

Concrètement ? Vos optimisations techniques (preload, prefetch, compression) ne modifient pas la vitesse à laquelle Googlebot crawle vos pages ni la façon dont il les indexe. Elles améliorent en revanche le temps de chargement perçu par l'utilisateur réel.

Pourquoi Google insiste-t-il sur cette nuance sémantique ?

Parce que trop de professionnels optimisent encore la performance pour Googlebot plutôt que pour leurs visiteurs. Le message est clair : les études montrent que les utilisateurs préfèrent les sites rapides, restent plus longtemps, convertissent mieux. C'est ce cercle vertueux qui impacte votre visibilité — pas un boost algorithmique magique.

Cette clarification évite aussi que les sites se contentent de manipuler des métriques synthétiques sans réellement améliorer l'expérience. Un score PageSpeed de 95 ne sert à rien si votre parcours utilisateur reste désastreux.

Le crawl et l'indexation ne bénéficient-ils d'aucune amélioration ?

C'est ce qu'affirme Illyes — et c'est là que ça devient intéressant. Googlebot n'a pas besoin de vos optimisations frontend pour explorer efficacement vos pages. Il dispose de ressources propres et ne subit pas les mêmes contraintes qu'un navigateur classique.

En revanche, un site structurellement lent (temps serveur élevé, redirections multiples, ressources bloquantes) peut effectivement ralentir le crawl. Mais ce n'est pas de ça qu'on parle ici : preload et prefetch sont des techniques côté client, invisibles pour le bot.

- La performance utilisateur n'améliore pas directement le crawl ou l'indexation selon Google

- Les optimisations frontend (preload, prefetch) ciblent l'expérience utilisateur réelle

- L'impact SEO passe par la rétention, l'engagement et les conversions

- Googlebot ne bénéficie pas des mêmes optimisations qu'un navigateur classique

- La distinction entre effet primaire et secondaire est stratégique pour prioriser vos efforts

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui et non. Sur le papier, la distinction fait sens : Google n'utilise pas directement vos Core Web Vitals comme signal de ranking majeur. Les études de corrélation montrent d'ailleurs des liens faibles entre CWV et positions organiques. Le fameux Page Experience Update a eu un impact dérisoire sur la plupart des sites.

Mais — et c'est là que ça coince — personne n'a accès aux données comportementales réelles de Google (durée de session, taux de retour, navigation post-clic). Si ces signaux pèsent dans l'algorithme, et que la performance les influence fortement, alors l'effet indirect devient mécaniquement significatif. Google ne ment pas techniquement, mais l'effet concret peut être bien plus puissant qu'un simple "secondaire".

Quelles nuances faut-il apporter à cette affirmation ?

Premier point : Illyes parle de preload et prefetch, des techniques relativement avancées. Beaucoup de sites ont des problèmes de performance bien plus basiques — serveur lent, images non optimisées, JavaScript bloquant. Ces facteurs peuvent effectivement impacter l'exploration si le serveur répond trop lentement aux requêtes de Googlebot.

Deuxième nuance : la performance mobile. Sur mobile, un site lent provoque des abandons massifs avant même le premier clic. Si Google mesure le CTR post-SERP ou le pogo-sticking, vous avez là un effet indirect qui devient prépondérant. [A vérifier] — Google n'a jamais confirmé officiellement l'utilisation du pogo-sticking comme signal, mais les brevets et observations vont dans ce sens.

Dans quels cas cette règle pourrait-elle ne pas s'appliquer ?

Si votre site est tellement lent que Googlebot timeout régulièrement, vous avez un problème de crawl — pas d'expérience utilisateur. Idem si vos temps serveur dépassent systématiquement 2-3 secondes : le bot ajustera son crawl rate à la baisse pour ne pas surcharger votre infrastructure.

Autre cas limite : les sites à très fort volume de pages. Un crawl budget limité peut être aggravé par une architecture technique déficiente. Là, optimiser les temps de réponse serveur a bel et bien un effet primaire direct sur l'indexation — contrairement aux optimisations frontend mentionnées par Illyes.

Impact pratique et recommandations

Que faut-il faire concrètement après cette clarification ?

Arrêtez d'optimiser la performance uniquement pour améliorer vos positions Google. Adoptez une approche holistique : la performance doit servir vos objectifs business (conversions, engagement, rétention). Si elle impacte le SEO, c'est un bonus — pas l'objectif premier.

Concrètement, priorisez les optimisations qui améliorent le temps de chargement perçu par l'utilisateur réel : preload des ressources critiques, lazy loading des images below the fold, optimisation du Critical Rendering Path. Ne vous contentez pas de satisfaire Lighthouse ou PageSpeed Insights si l'expérience reste médiocre.

Quelles erreurs éviter dans vos audits de performance ?

Première erreur classique : optimiser pour un score PageSpeed parfait en sacrifiant les fonctionnalités ou l'expérience. Un score de 95 ne garantit rien si votre parcours utilisateur est cassé ou si votre contenu met 5 secondes à devenir interactif.

Deuxième erreur : confondre performance serveur et performance frontend. Les optimisations mentionnées par Illyes (preload, prefetch) n'impactent pas le crawl — mais un TTFB de 3 secondes, si. Auditez séparément ces deux dimensions et corrigez les problèmes structurels avant de peaufiner le frontend.

Troisième piège : mesurer uniquement en conditions de laboratoire. Les Core Web Vitals de terrain (CrUX) reflètent l'expérience réelle de vos utilisateurs, avec leurs connexions 4G médiocres et leurs appareils bas de gamme. C'est ça qui compte — pas votre test sur fibre optique avec un MacBook Pro.

Comment s'assurer que vos optimisations servent vraiment votre SEO ?

Suivez les métriques qui comptent réellement : temps de session, taux de rebond, pages par visite, conversions. Si vos optimisations de performance améliorent ces KPIs, vous êtes sur la bonne voie — indépendamment de l'impact direct ou indirect sur le ranking.

Mettez en place du RUM (Real User Monitoring) pour capturer les performances réelles, pas synthétiques. Segmentez par device, par géographie, par type de connexion. Identifiez où vous perdez vos utilisateurs et corrigez en priorité.

- Auditez séparément performance serveur (TTFB, temps de réponse) et performance frontend (CWV, rendu)

- Priorisez les optimisations qui améliorent le temps de chargement perçu par l'utilisateur réel

- Mesurez l'impact sur les métriques comportementales (engagement, conversions) plutôt que sur les positions

- Utilisez le RUM pour capturer les performances terrain, pas uniquement les tests synthétiques

- Ne sacrifiez jamais l'expérience utilisateur pour un score PageSpeed artificiel

- Corrigez les problèmes structurels (serveur lent, architecture déficiente) avant de peaufiner le frontend

- Suivez l'évolution des Core Web Vitals CrUX pour mesurer l'expérience réelle de vos visiteurs

❓ Questions frequentes

Les Core Web Vitals sont-ils un facteur de ranking direct ou indirect ?

Faut-il abandonner les optimisations de performance si elles n'impactent pas le crawl ?

Googlebot bénéficie-t-il des optimisations comme preload ou prefetch ?

Un site lent peut-il quand même bien se positionner dans Google ?

Quelles optimisations de performance peuvent réellement impacter le crawl ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 26/02/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.