Declaration officielle

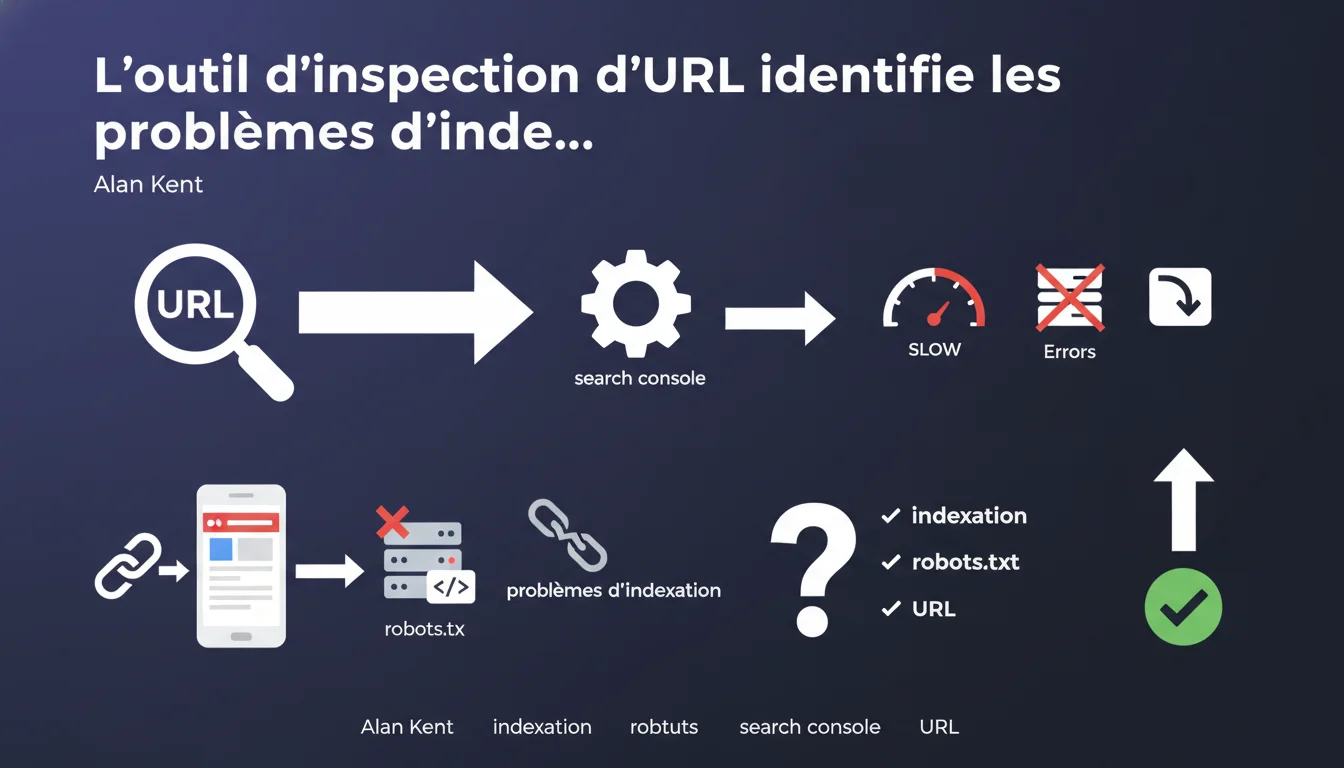

L'outil d'inspection d'URL de Search Console diagnostique les raisons pour lesquelles une page n'est pas indexée, en pointant notamment les blocages techniques comme robots.txt. Google confirme que cet outil reste votre premier réflexe face à un problème d'indexation, mais sa fiabilité dépend de la fraîcheur des données et de votre capacité à interpréter correctement les messages d'erreur.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il autant sur cet outil ?

Search Console regorge de fonctionnalités, mais l'outil d'inspection d'URL reste le diagnostic de première ligne quand une page refuse de s'indexer. Alan Kent, responsable ingénierie chez Google, rappelle ici une évidence que trop de praticiens négligent : avant de chercher midi à quatorze heures, commencez par regarder ce que Google vous dit explicitement.

L'outil vérifie l'état d'indexation en temps réel et teste la version live de votre page. Contrairement aux rapports de couverture qui peuvent accuser un retard de plusieurs jours, l'inspection URL vous donne une photo quasi instantanée de ce que Googlebot voit — ou ne voit pas.

Quels types de problèmes l'outil détecte-t-il concrètement ?

Les blocages robots.txt sont l'exemple le plus basique, mais l'outil remonte bien d'autres anomalies : redirections en chaîne, pages orphelines sans liens entrants, contenu dupliqué, balises noindex oubliées, erreurs serveur 5xx intermittentes.

Chaque diagnostic s'accompagne d'un message explicatif — parfois cryptique, certes — qui oriente vers la nature du problème. Le piège ? Ces messages ne sont pas toujours suffisamment granulaires pour identifier la cause racine, surtout sur des architectures complexes.

L'outil remplace-t-il une analyse technique approfondie ?

Non. Il pointe le symptôme, rarement la maladie complète. Si votre page est bloquée par robots.txt, l'outil vous le dira — mais il ne vous expliquera pas pourquoi votre CMS génère cette règle ni comment la corriger définitivement.

C'est un point de départ, pas une solution clé en main. Vous devrez souvent croiser ces données avec des crawls Screaming Frog, des logs serveur et une bonne connaissance de votre stack technique.

- L'inspection URL teste la version live, contrairement aux rapports de couverture qui peuvent être obsolètes

- Elle identifie les blocages robots.txt, redirections, erreurs serveur et autres freins techniques

- Les messages d'erreur orientent le diagnostic mais ne remplacent pas une analyse approfondie

- Toujours croiser avec un crawl complet et l'analyse des logs pour comprendre le contexte

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées ?

Oui, mais avec des réserves. L'outil d'inspection fonctionne bien pour les blocages évidents — robots.txt, noindex, 404, 500. En revanche, il reste muet sur les problèmes plus subtils : budget de crawl insuffisant, pénalités algorithmiques non documentées, contenus jugés non pertinents sans explication claire.

J'ai vu des centaines de cas où l'outil affichait "URL soumise mais non indexée" sans donner la moindre piste exploitable. Google vous dit que la page est accessible, qu'elle respecte les consignes techniques… mais qu'elle ne sera pas indexée. Point final. [À vérifier] si cette opacité relève d'une limitation technique ou d'une volonté de ne pas trop dévoiler les critères de qualité.

Quelles nuances faut-il apporter à cette affirmation ?

D'abord, l'outil ne détecte pas tout. Les problèmes de qualité de contenu, le duplicate interne, les signaux E-E-A-T défaillants — rien de tout ça ne remonte clairement. Vous aurez au mieux un message générique sur la "faible priorité d'exploration".

Ensuite, les délais de mise à jour peuvent être trompeurs. Une page peut afficher "indexée" alors qu'elle a disparu de l'index quelques heures après. Inversement, une correction technique peut mettre plusieurs jours à se refléter dans l'outil, même après un test en direct.

Dans quels cas l'outil montre-t-il ses limites ?

Sur les gros sites avec millions de pages, l'inspection URL devient anecdotique. Vous ne pouvez pas tester manuellement 500 000 URLs. Il faut alors s'appuyer sur les rapports de couverture, les logs et des outils tiers pour identifier les patterns de non-indexation.

site: et surveiller les fluctuations dans les logs.Autre limite connue : les pages JavaScript lourdes. L'outil teste le rendu, mais pas toujours dans les mêmes conditions qu'un crawl réel. Vous pouvez avoir une validation verte alors que la page est mal indexée à cause de timeouts JS en production.

Impact pratique et recommandations

Que faut-il faire concrètement avant de paniquer ?

Dès qu'une page refuse de s'indexer, commencez par l'inspection URL. Notez le statut exact, le message d'erreur, et la date du dernier crawl. Si le diagnostic pointe un blocage robots.txt, vérifiez votre fichier et vos règles CMS.

Si l'outil dit "URL découverte, actuellement non indexée", c'est plus subtil. Cela signifie souvent que Google a trouvé la page mais ne la juge pas prioritaire — ou pas assez qualitative. Là, il faut creuser : maillage interne faible ? Contenu trop mince ? Duplication ?

Quelles erreurs éviter lors de l'utilisation de l'outil ?

Ne vous fiez pas aveuglément au bouton "Tester l'URL en direct". Ce test simule un crawl, mais ne garantit pas l'indexation. Une page peut passer tous les tests techniques et rester hors index pour des raisons de qualité ou de budget de crawl.

Autre piège : soumettre des centaines d'URLs manuellement via "Demander une indexation". Google a clairement dit que ce bouton ne fait pas de miracle. Si votre page n'est pas indexée pour des raisons de fond, la soumettre 10 fois n'y changera rien.

Comment intégrer cet outil dans un workflow SEO efficace ?

Automatisez la surveillance avec l'API Search Console. Vous pouvez scripter des vérifications régulières sur vos pages stratégiques et recevoir des alertes dès qu'un statut change. Croisez ces données avec vos crawls hebdomadaires et vos analyses de logs pour repérer les anomalies récurrentes.

- Inspecter systématiquement toute page stratégique non indexée avant toute autre intervention

- Noter le message d'erreur exact et la date du dernier crawl pour suivre l'évolution

- Ne pas abuser du bouton "Demander une indexation" — réserver aux corrections urgentes uniquement

- Croiser les diagnostics avec un crawl Screaming Frog et une analyse des logs serveur

- Automatiser la surveillance via l'API Search Console pour les sites de taille importante

- Identifier les patterns de non-indexation plutôt que traiter chaque URL isolément

❓ Questions frequentes

L'outil d'inspection d'URL détecte-t-il les problèmes de contenu dupliqué ?

Combien de temps faut-il attendre après une correction technique pour voir un changement dans l'outil ?

Peut-on se fier au statut "indexée" affiché par l'outil ?

L'outil remplace-t-il un crawl complet du site ?

Que signifie "URL découverte, actuellement non indexée" ?

🎥 De la même vidéo 2

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 17/10/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.